在2026年NVIDIA年度GTC大会上,NVIDIA正式发布了面向智能体AI长上下文推理场景的全新存储解决方案——BlueField-4 STX模块化存储参考架构。该方案旨在针对性破解传统数据中心存储在AI场景下的性能瓶颈,为下一代智能体AI打造高效、低延迟的专用“存储大脑”,助力大模型与智能代理规模化部署。

一、传统存储方式的核心局限

随着智能体AI的快速发展,模型上下文窗口从数万令牌拓展至数百万、数千万令牌级别,这对存储系统的响应速度与带宽提出了前所未有的严苛要求。传统数据中心存储的短板在此背景下暴露无遗:

- 延迟高、吞吐量不足:传统的通用存储偏重大容量设计,无法适配AI推理所需的低延迟数据访问需求。

- GPU利用率偏低:存储系统与GPU内存需要频繁交换海量上下文数据,这个过程不仅造成算力浪费,也严重限制了推理的吞吐量。

- HBM容量瓶颈:GPU内置的高带宽内存(HBM)成本高昂且容量有限,难以支撑超长上下文的KV缓存与大规模模型权重切片的存储。

这些存储层面的短板,直接制约了智能体进行跨步骤、跨工具协作的效率,已成为拖累整个AI系统性能提升的核心瓶颈。那么,如何才能构建一个真正为AI而生的存储架构呢?

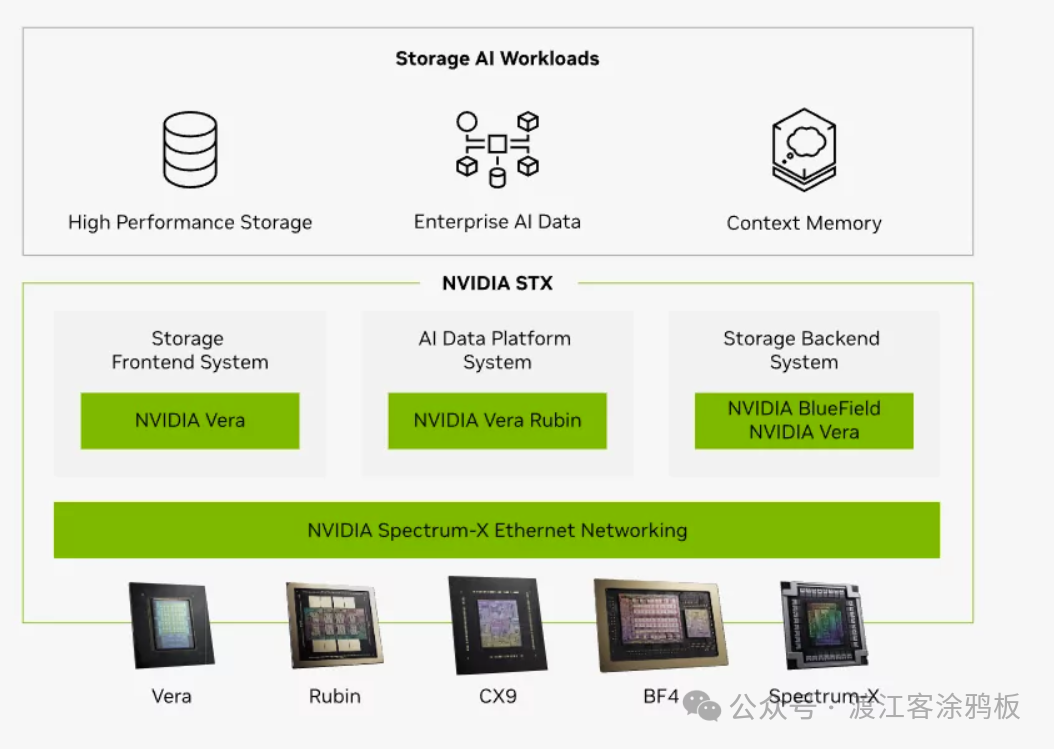

二、BlueField-4 STX架构核心

针对现代数据中心在AI推理、训练和数据分析环节面临的存储与算力瓶颈,NVIDIA BlueField-4 STX架构提供了一套全链路的解决方案。它通过深度的软硬件协同优化,旨在实现高性能、低延迟的数据处理能力。

这套方案的核心设计理念是 “存储节点贴近计算资源” 。它彻底打破了存储与算力之间的传统传输壁垒,摒弃了繁琐的跨节点数据传输,让GPU能够实现对数据的高吞吐、低延迟直连访问,从而大幅提升整体计算效率。

从核心价值来看,该架构全面覆盖了智能体AI推理、训练以及大规模数据分析的全流程。凭借其高吞吐数据访问与极速响应能力,能够有效杜绝模型在处理海量数据时可能遇到的I/O瓶颈,适配各类核心AI业务场景。

作为首款集成NVIDIA CMX上下文内存存储平台的机架级方案,BlueField-4 STX实现了部署形态上的重要突破。它依托高性能的上下文存储来扩展GPU内存容量,据称可将令牌处理速度提升5倍,完美适配超长上下文推理需求,保障大规模大语言模型、多模态AI模型的高效低延迟运行。

在底层技术层面,其硬件以 “Vera Rubin平台” 为底座,核心搭载了BlueField-4 DPU、ConnectX-9 SuperNIC以及Spectrum-X高性能以太网,实现了算力加速与高速数据互连。软件层面则依托DOCA开发套件与AI企业级软件生态,搭建起完整的软硬件协同体系,实现存储与算力的无缝融合,致力于打造真正一体化的存算融合平台。这为解决大规模AI训练和云原生环境下的数据调度提供了新的基础设施思路。

三、NVIDIA CMX:GPU外置上下文存储核心

CMX(Context Memory eXpansion)是STX架构中的核心存储层,专为GPU提供高性能、低延迟的外置上下文内存。它作为GPU内存的扩展层,专门用于存储长上下文KV缓存、向量数据库、模型权重切片等热点数据,以支撑大规模计算与高速数据访问。

想要实现高效的外置上下文存储,离不开硬核的硬件支撑。CMX的核心硬件配置在容量、算力与互连速度上做了精心权衡,以适配高密度AI部署场景:

- 高密度NVMe SSD/NAND池:单GPU对应16TB容量,单机柜(搭载72个Rubin GPU)总容量高达1152TB。

- BlueField-4 DPU:内置Vera CPU和ConnectX-9 800Gbps超级网卡,负责存储调度、协议转换与数据加速。

- 高速互连:提供16TB/s的水平带宽直连GPU,依靠NVLink-C2C与Spectrum-X保障低延迟网络传输。

- 全液冷设计:专为适配Vera Rubin机架的高密度部署与散热需求。

除了硬件打底,CMX更依靠三大核心技术特性实现性能突破,从存储架构、算力卸载到调度逻辑进行全方位优化:

- 分层存储架构:HBM层存储高频访问的小批量上下文与中间计算结果;CMX层承载数百万令牌的KV缓存与向量库;后端存储则负责冷数据归档。

- DPU卸载加速:由DPU全权接管存储I/O、协议转换、数据校验、压缩解压缩、加密等操作,无需CPU参与。支持NVMe-oF、GPUDirect Storage(GDS)、DOCA存储加速库,实现GPU与CMX之间的零拷贝数据访问。

- 上下文感知调度:依据令牌的访问频率与生命周期实现智能预取、交换,支持分片、并行加载与增量更新,避免全量数据的重复计算与传输。

在软硬件协同加持下,CMX交出了亮眼的关键性能指标,全方位超越了传统存储架构:令牌处理量提升5倍,数据摄取速度翻倍,能源效率较传统CPU架构提升4倍。

四、BlueField-4 STX模块化存储架构

STX(存储扩展)是基于Vera Rubin平台的机架级存储参考架构,它通过将存储与计算资源紧密耦合,致力于打造一个高吞吐、低延迟的AI原生数据平台。

STX采用模块化全液冷机架作为底层平台设计,无需复杂的外部布线即可实现高速互连与高效散热,其核心硬件规格充分考虑了算力密度与传输效率:

- 机架配置:单机柜包含18个计算托架,搭载72个Rubin GPU和72个BlueField-4 DPU。

- 高速互连:通过NVLink 3.6TB/s、Spectrum-X光子交换机、ConnectX-9 800Gbps网卡,实现机柜内部的超高速数据传输。

这种设计实现了存储与计算资源的深度耦合,GPU可以近乎直连的方式访问数据,省去了长距离传输带来的损耗,既大幅降低了访问延迟,又显著提升了数据吞吐效率。

该架构的稳定运行离不开两大核心组件的支撑,它们分别负责算力调度与内存扩展,实现了存算的深度协同:

- BlueField-4 DPU:作为存储系统的“智能大脑”,全权接管存储链路。它提供NVMe-oF、GPUDirect、RAID、压缩、加密、重复数据删除等硬件加速能力,实现存算深度融合,从而提升数据访问效率与系统可靠性。

- CMX上下文内存池:与计算托盘紧密耦合,为单GPU提供独立的低延迟内存分区。它支持弹性扩展与统一命名空间,完美适配大模型超长上下文的推理需求。

配套的软件栈则为硬件赋能,实现了存储加速、集群管控与运维的全流程覆盖,保障大规模部署的稳定与高效:

- DOCA:提供存储加速API与服务编排能力。

- AI企业版软件:集成容器管理、监控、运维等工具。

- 内存一致性协议(MCP):管控CMX内存分片与数据一致性,保障大规模部署的稳定性。

在部署形态上,STX采用标准化的托架设计,搭配高容量存储与高速背板互连,兼顾了部署效率与扩容的灵活性:

- 计算托架:单托架搭载2个Vera Rubin超级芯片、2个BlueField-4 DPU。

- 存储托架:单GPU配备16TB TLC SSD,单机柜总存储容量高达1152TB。

- 全背板互连:实现高带宽、低延迟的内部通信;单个机柜的部署时间仅需约5分钟,便于快速扩容与运维。

凭借从底层硬件到上层软件的端到端优化,BlueField-4 STX为AI原生工作负载,提供了一个高吞吐、低延迟、易扩展的机架级存算一体化平台,是构建下一代云原生AI基础设施的重要拼图。

五、市场生态与应用趋势

随着生成式AI与大模型应用的普及,市场对高性能、低延迟的上下文存储需求持续攀升。基于STX架构的下一代AI基础设施正在形成一个完整的生态,覆盖了从存储硬件、系统制造到云服务的全链条合作。

生态合作伙伴布局

- 存储层面:Cloudian、DDN、戴尔科技、日立Vantara、HPE、IBM、NetApp等头部存储厂商,正联合为STX打造高性能、可扩展的存储解决方案。

- 系统制造层面:AIC、超微(Supermicro)、广达云技术(QCT)等合作伙伴,基于STX架构构建优化的硬件系统,以满足大模型推理与AI训练的高算力需求。

- AI应用层面:CoreWeave、Mistral AI、OCI等多家AI实验室与云服务商,已计划采用STX作为其上下文记忆存储方案。这表明该架构已从研发阶段走向商用市场,并获得了行业的广泛认可。

核心应用场景

基于STX的平台预计于2026年下半年通过合作伙伴正式推出,将主要覆盖四大核心场景:

- 智能体AI:支撑多轮复杂对话、长文档理解、自主决策与跨工具协作,实现更自然、更高效的人机交互。

- 大模型推理:提供数百万令牌级别的上下文支撑,保障低延迟响应与高并发服务能力。

- 向量数据库:适配RAG(检索增强生成)、实时语义检索等场景,提升信息获取与内容生成的效率。

- AI训练:加速大规模数据集的加载过程,支持快速的训练断点恢复,从而提升训练效率与资源利用率。

整体来看,STX架构正在推动AI基础设施从单一的算力驱动模式,转向算力、高性能存储、上下文智能深度融合的全新模式。它构建起了一个相对完备的技术与市场生态,以更好地适配未来大模型与生成式AI日益复杂的业务需求。若想了解更多前沿的AI与云技术动态,欢迎在云栈社区交流探讨。

六、结束语

NVIDIA BlueField-4 STX架构采用模块化机架设计,深度集成了GPU外置上下文存储、DPU加速与高性能网络,旨在打造一个端到端优化的AI原生数据平台。该方案不仅精准地破解了智能体AI长上下文推理与大模型训练中的存储瓶颈,更构建了一个覆盖存储、系统制造、云服务的完整产业生态。凭借其高吞吐、低延迟的存算协同能力,STX为企业与云服务商提供了一个可扩展的智能数据基础设施选项,有望加速生成式AI与大模型技术的规模化落地。