软件革新释放硬件潜能,MoE推理成本大幅下探

2026年初,NVIDIA再次用数据刷新了AI推理的性能上限。

英伟达官方披露,基于Blackwell架构的推理软件栈重大升级,让混合专家模型(MoE)的推理效率迎来阶跃式突破——单GPU吞吐量飙升2.8倍,显著拉低了推理服务成本。

GB200 NVL72:为MoE而生的算力基座

英伟达此次纯靠软件升级就兑现了如此显著的性能红利,其背后的根源在于MoE模型独特的运行机制。

以DeepSeek-R1为例,这个6710亿参数的稀疏MoE模型,每次推理仅需激活370亿参数,看似身轻如燕,实则暗藏算力挑战:专家模块间的动态路由需要极高频率的数据交换,预填充与解码阶段的计算负载差异悬殊,传统架构极易因通信瓶颈或精度损失撞上“性能墙”。与此同时,MoE架构中多个模型间的密集通信也进一步加剧了系统的负担。

英伟达给出的解法,并非简单粗暴地堆砌硬件,而是在自身硬件基础上,通过极具针对性的软件调优,将硬件的潜力压榨到了极致。

GB200 NVL72机架级平台是本次突破的物理基石。

它利用第五代NVLink将72块Blackwell GPU紧密互连,GPU之间具备1800GB/s的双向带宽,这一设计可以说是为稀疏MoE架构量身打造,如同给72个专家大脑装上了超高速神经突触,让专家间的数据交换彻底告别拥堵。

软件层面的升级,首先体现在NVFP4这一四比特浮点格式上。相比传统的FP4,NVFP4借助NVIDIA自研的数值分布优化,在极力压缩数据量的同时,最大限度地保住了模型精度——这对MoE的稀疏激活至关重要,足以避免因精度受损而导致路由错误。配合硬件级NVFP4加速单元,Blackwell让模型能够跑在低精度计算上,却获得了比其他FP4格式更出色的准确性。

此外,“分解服务”策略进一步释放了GB200的软硬件协同红利:它将计算密集型的预填充与内存密集型的解码分配给不同的GPU组,利用NVLink Switch的灵活拓扑实现“计算-内存”解耦,避免单一资源成为系统瓶颈。

软件引擎:TensorRT-LLM三个月狂飙2.8倍吞吐

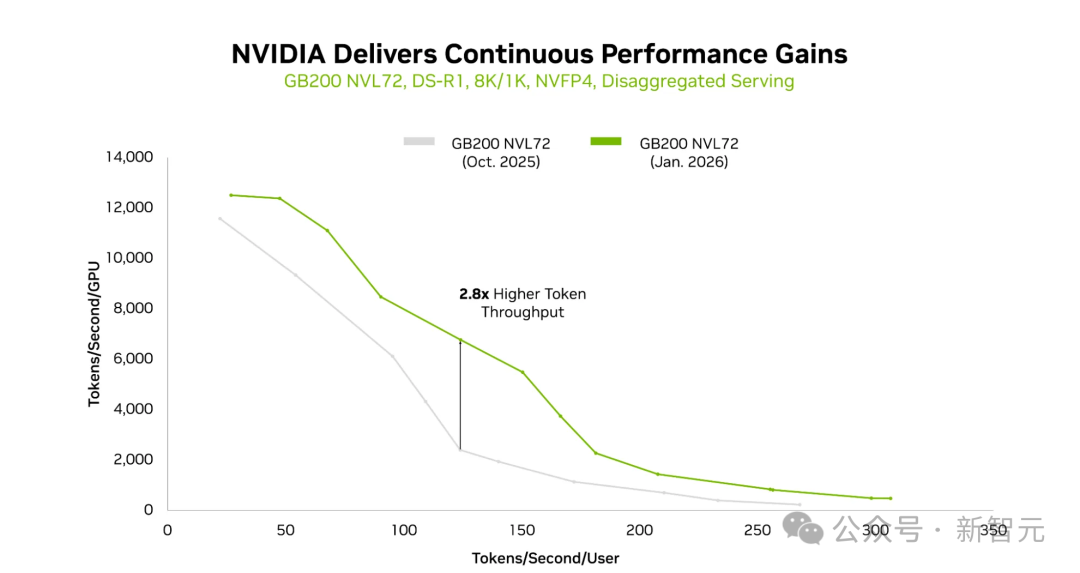

如果说硬件是基础,那软件就是精密的引擎调校。NVIDIA TensorRT-LLM开源库近期的优化,让GB200 NVL72在运行DeepSeek-R1时,单GPU吞吐量在短短三个月内直接飙升了2.8倍。

具体来看,三大优化构成了这次性能跃迁的催化剂:

- 程序化依赖启动:通过削减内核启动延迟,让GPU时刻保持待命状态,尤其在低交互性的高吞吐场景下,显著降低了空转损耗。

- 底层内核优化:针对Blackwell Tensor Core的微架构特性,重构了计算流水线,让每一分宝贵的算力都精准地使在刀刃上。

- 全对全通信原语革新:消除了接收端的中间缓冲区,直接减少了数据传输的绕路成本——这对于MoE专家间高频通信而言,无异于缩短了关键路径。

上述三项创新,使得GB200在运行DeepSeek R1时,相比2025年10月的软件版本,获得了显著更高的吞吐量。

随着AI从“能用”迈向“好用”,用户对交互性的要求急剧攀升——聊天机器人需要秒回,代码助手需要实时补全。而吞吐量的上升,则意味着更低的延迟、更好的用户体验以及更经济的基础设施成本。

小机柜也疯狂:HGX B200同样能驯服DeepSeek

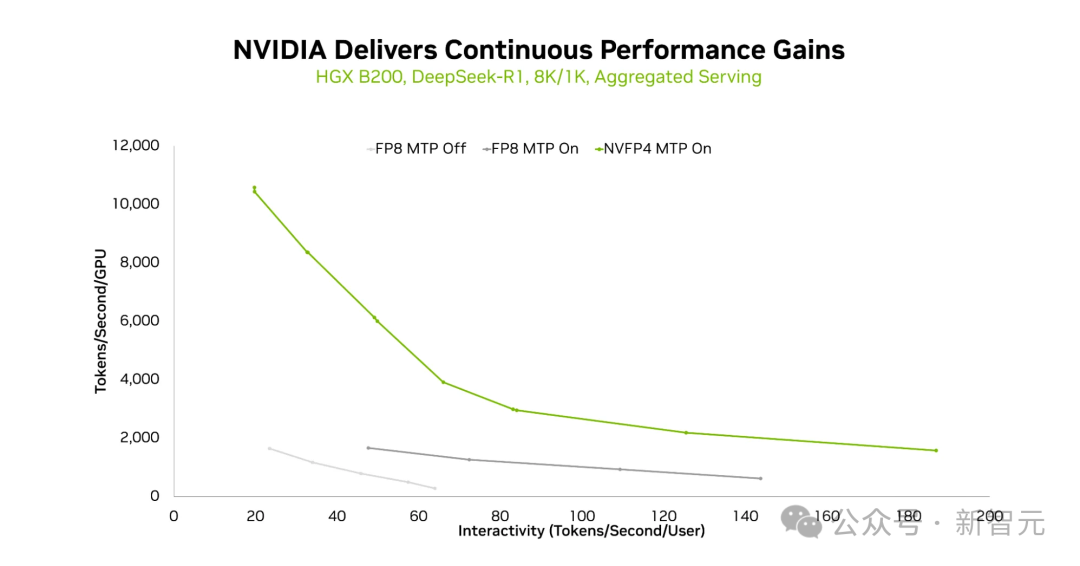

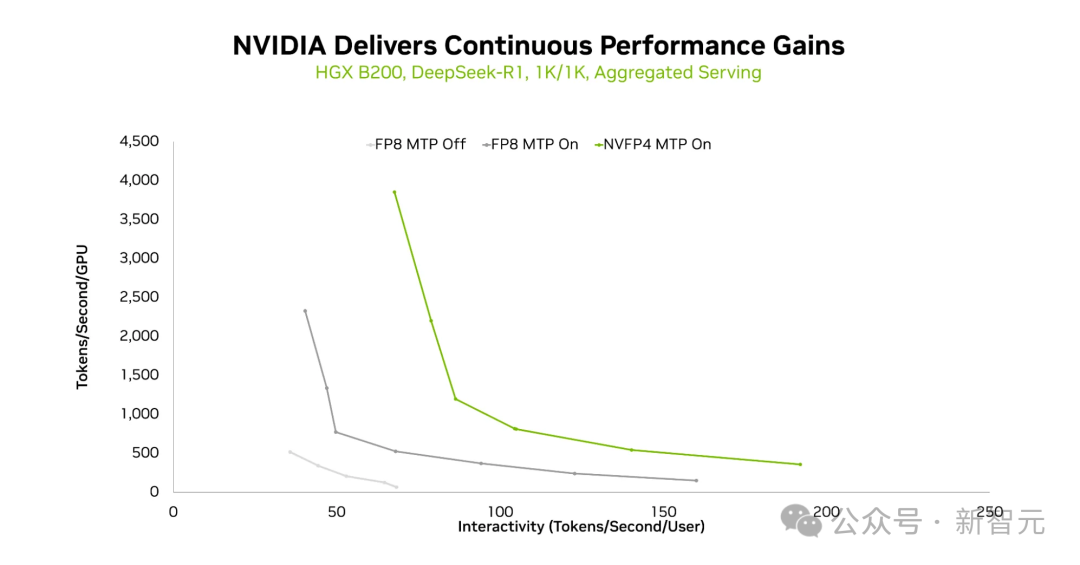

并非所有场景都需要GB200 NVL72这样的包含72块显卡的“巨无霸”。对于偏好风冷部署的企业或云服务商,NVIDIA HGX B200同样交出了惊艳的答卷——其核心武器是多token预测与NVFP4的组合拳。

传统推理中,模型逐token生成,每一步都必须等待前一步完成;而多token预测技术则通过一次预测多个候选token,让GPU在一次计算中覆盖更多的生成步骤,相当于在解码任务中实现了批处理,可谓“一次思考,多步输出”。

实测显示,在各种输入输出序列组合下,多token预测均显著提升了吞吐量,且交互性要求越高的场景,其收益越明显。当多token预测遇上NVFP4,性能增益被进一步放大。NVFP4不仅通过四比特压缩降低了内存带宽压力,更依托Blackwell的张量核心实现了高效计算。结合TensorRT-LLM与TensorRT Model Optimizer的全栈支持,HGX B200在保持精度的前提下,吞吐曲线持续右移——这意味着在相同交互性下能服务更多用户,或在相同用户数下提供更流畅的体验。

对于企业和云服务商而言,现有Blackwell GPU仅需通过软件升级,即可获得高达2.8倍的吞吐提升,这无异于一次“免费扩容”,极大延长了硬件生命周期。对于模型开发者来说,TensorRT-LLM提供了高级API与原生PyTorch架构,兼具易用性与扩展性,大大降低了优化门槛,让更多人能够聚焦于模型创新而非底层调优。

这种“不依赖换硬件就能猛提性能”的实力,让英伟达在专业计算领域的护城河,相比AMD、英特尔等竞争者而言,挖掘得更深。Blackwell架构加TensorRT-LLM的组合,在MoE推理问题上,成功实现了在“高精度、低延迟、高吞吐、低成本”这几大相互制约的指标间的精妙平衡。英伟达的护城河,远不止芯片本身,更是那套能将硬件潜力“从石头里榨出血来”的强大软件生态。

参考资料: https://developer.nvidia.com/blog/delivering-massive-performance-leaps-for-mixture-of-experts-inference-on-nvidia-blackwell/

在云栈社区,你可以与更多开发者探讨大模型的推理部署与性能调优,共享技术红利。