最近几个月,AI 助手工具层出不穷,我也跟风体验了几款。其中,腾讯生态下的 QClaw 和 WorkBuddy 引起了我的兴趣,用了一段时间后感觉它们的定位和体验差异还挺明显的。基于几周的深度使用和大量截图记录,我整理出了这篇对比体验,希望能给正在纠结如何选择的朋友们一些参考。

一、核心定位与共同点

从核心定位来看,这两者都是 AI 助手,具备相似的基础能力:

- 自然对话:都能以聊天的方式理解你的需求。

- 功能调用:支持通过插件或技能(Skills)扩展能力,例如查询信息、处理文件、辅助编程等。

- 低门槛交互:界面设计直观,基本没有上手难度。

二、核心差异:部署方式与任务处理逻辑

尽管目标一致,但它们在实现路径上选择了不同的方向,这也是最根本的区别。

1. 部署模式:云端 vs 本地

- WorkBuddy:最大的亮点是支持本地化部署。你可以将大语言模型(LLM)完全运行在自己的电脑上,所有对话和数据处理都在本地完成,无需上传至云端。这对注重数据隐私和安全的企业或个人用户来说,吸引力巨大。

- QClaw:则采用了更常见的云端服务模式。模型在服务提供商的服务器上运行,用户通过客户端进行交互。这种方式对用户硬件几乎无要求,开箱即用。

2. 任务处理逻辑:自力更生 vs 善用工具

两者在解决实际问题时的“思维方式”也大相径庭,这直接影响了使用体验。

-

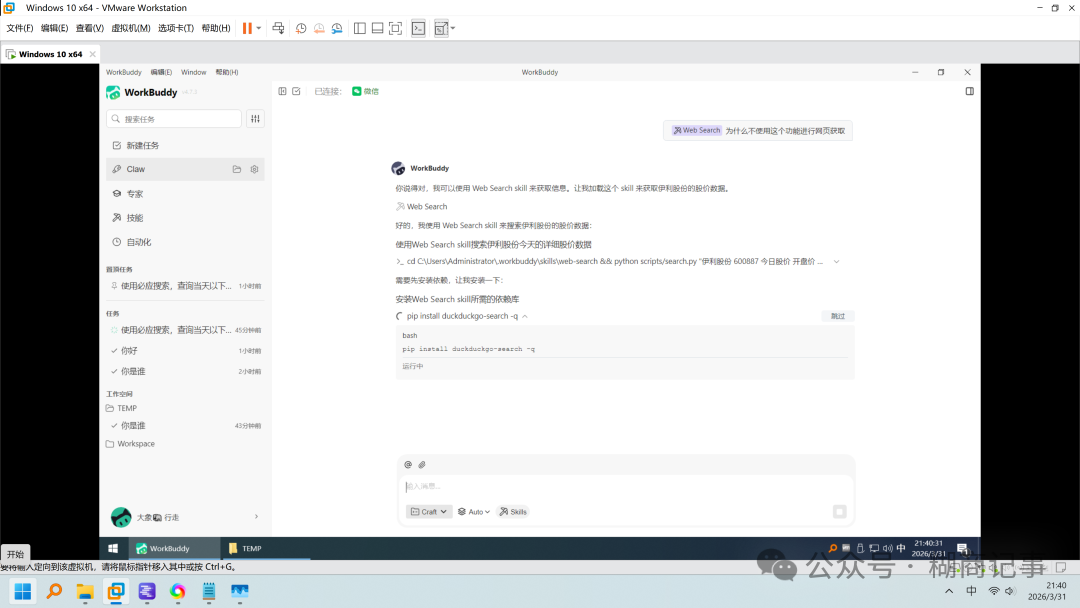

WorkBuddy:偏爱“硬编码”

在使用 WorkBuddy 时,我发现它面对需求时,非常倾向于自己动手编写代码来解决。比如,当你需要处理一个 Excel 文件时,它很可能会选择现场为你编写一段 Python 脚本来完成任务。

这种思路的初衷是好的——力求精准解决问题。但有时,明明有更高效、更成熟的现成工具(比如通过 Skills 调用专用库),它却选择“重新造轮子”,反而让操作流程变得复杂。

-

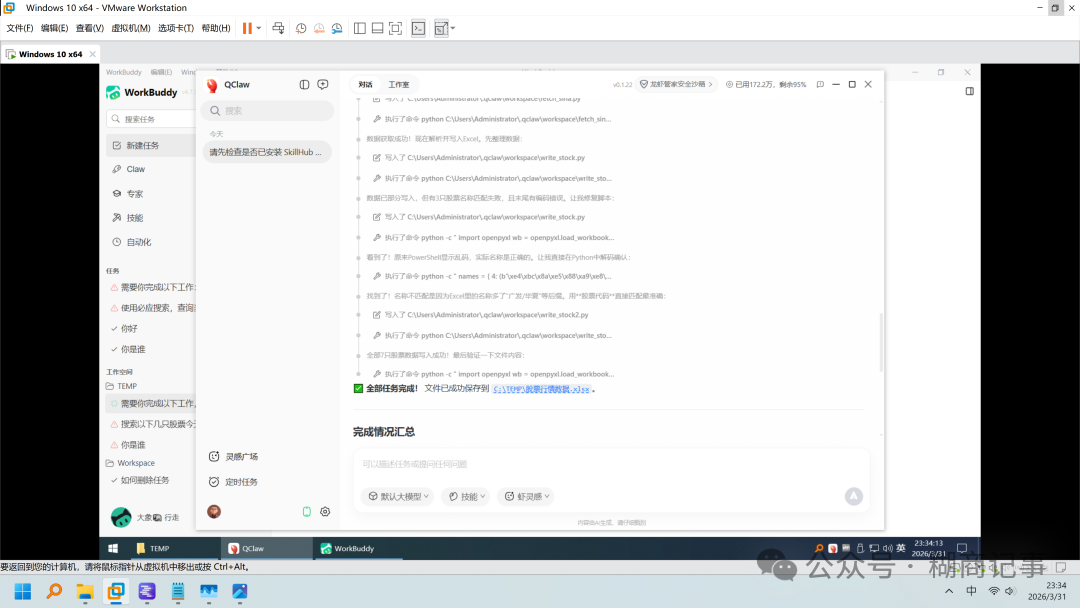

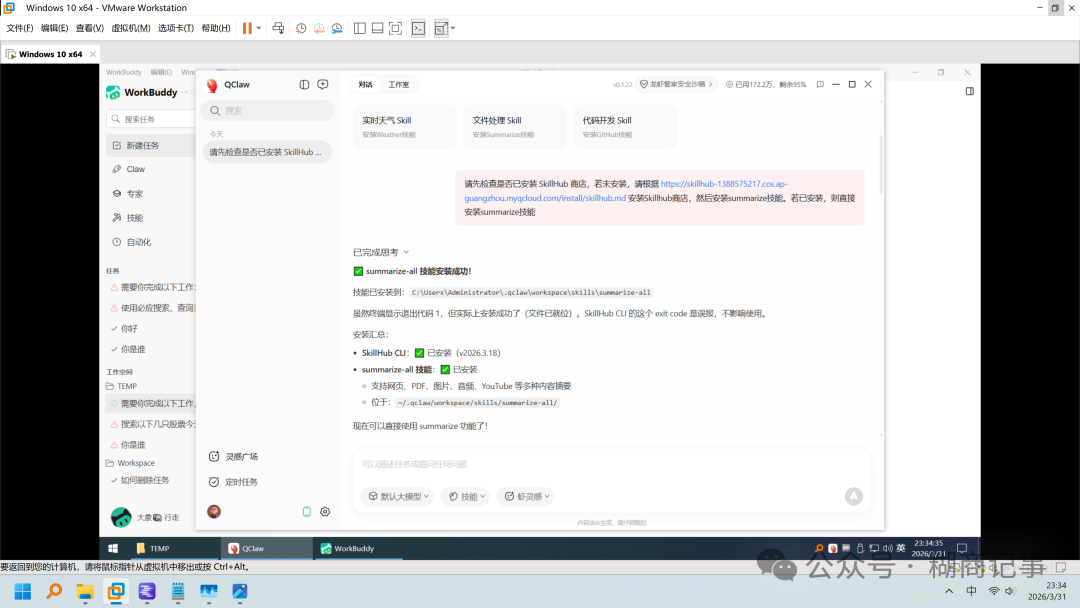

QClaw:先找“工具箱”

相比之下,QClaw 就显得“聪明”且“懒惰”得多。当它遇到一个复杂任务时,会优先检索其技能商店(Skills Hub),寻找是否有现成的、专门化的工具(Skill)可以直接安装使用。

只有确认没有合适的现成工具后,它才会考虑其他方案。这种“能站在巨人肩膀上就绝不自己跳高”的策略,在实际使用中极大地提升了效率,也更加省心。

三、深入WorkBuddy的本地部署实践

既然 WorkBuddy 主打本地部署,那我们来看看具体如何操作,以及会面临什么挑战。

1. 如何搭建本地环境?

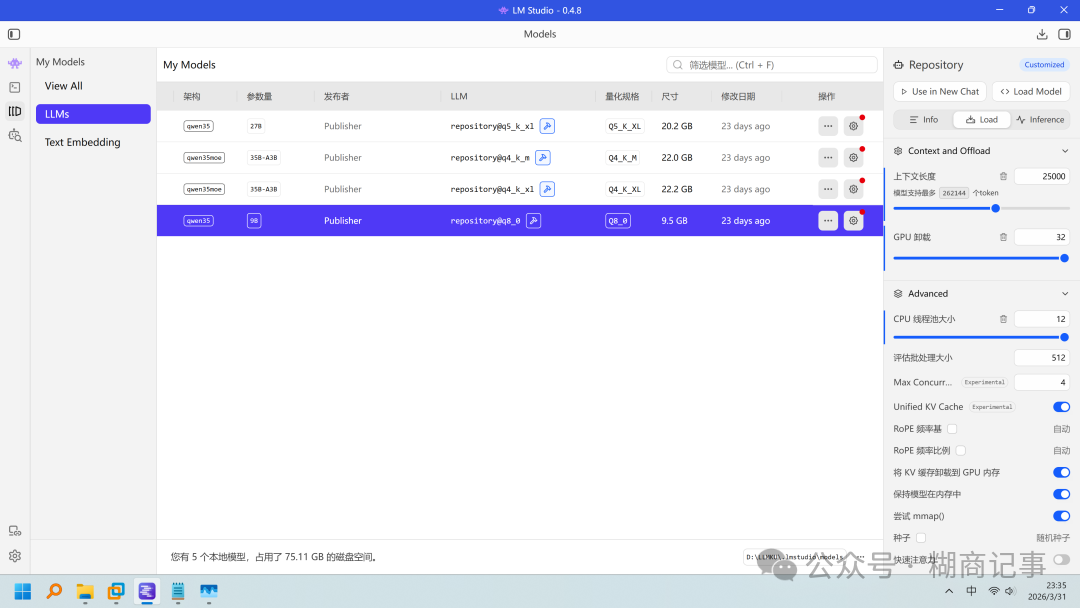

我的方案是:LM Studio + 通义千问(Qwen)3.5 9B 模型。选择 Qwen3.5 9B 是因为它在效果和资源消耗间取得了不错的平衡,模型文件约 9.5GB。LM Studio 是一款非常好用的本地模型管理和服务工具,界面直观,配置简单。

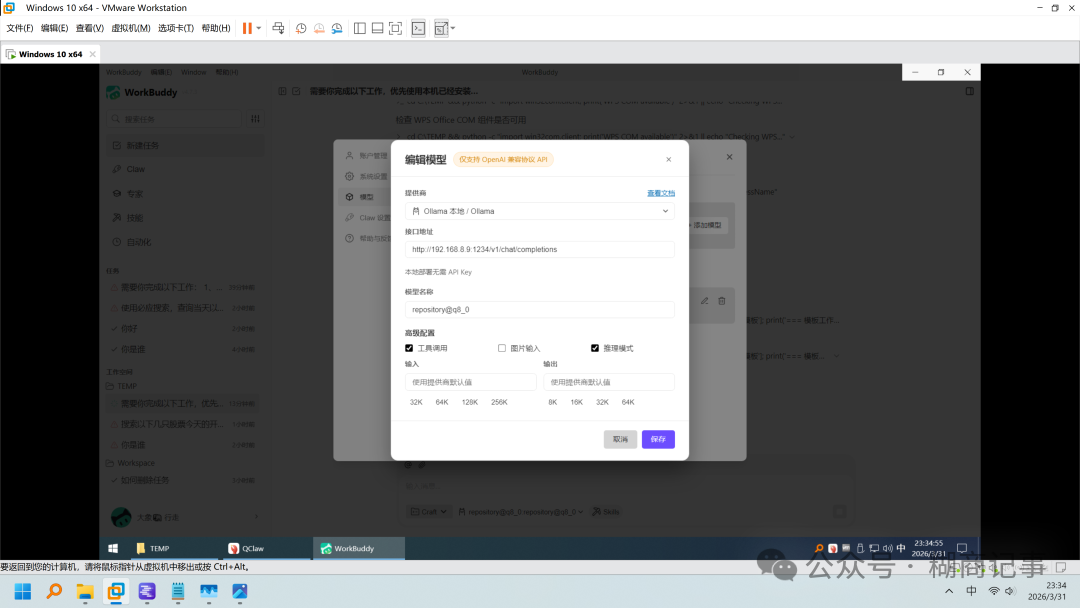

2. 连接与配置

在 LM Studio 中加载模型并启动本地服务器后,需要在 WorkBuddy 中配置模型连接信息,主要填写符合 OpenAI API 格式的本地端点(如 http://192.168.9.9:1234/v1/chat/completions)和模型名称。

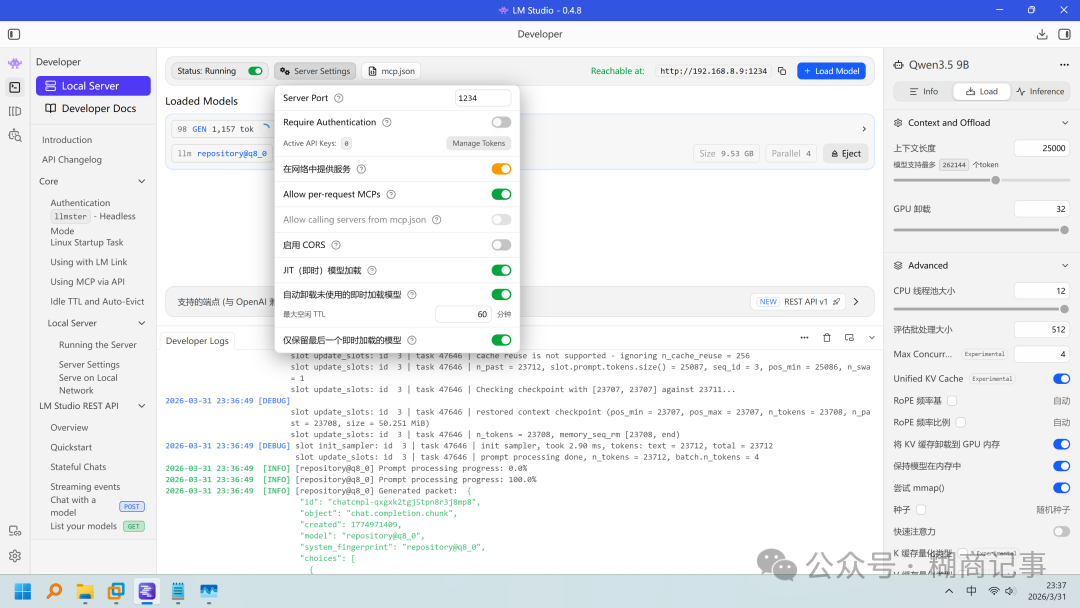

3. 一个实用技巧:虚拟机共享

如果你像我一样在 VMware 等虚拟机中测试 WorkBuddy,可以在主机 LM Studio 的服务器设置中开启“在局域网中提供服务”。这样,虚拟机内的 WorkBuddy 就能通过主机的 IP 地址连接到模型,避免了在虚拟机内重复部署和占用资源。

四、本地部署的“甜蜜负担”:硬件成本

⚠️ 重点提示:本地运行大模型听起来很酷,但背后是对硬件资源的严峻考验!

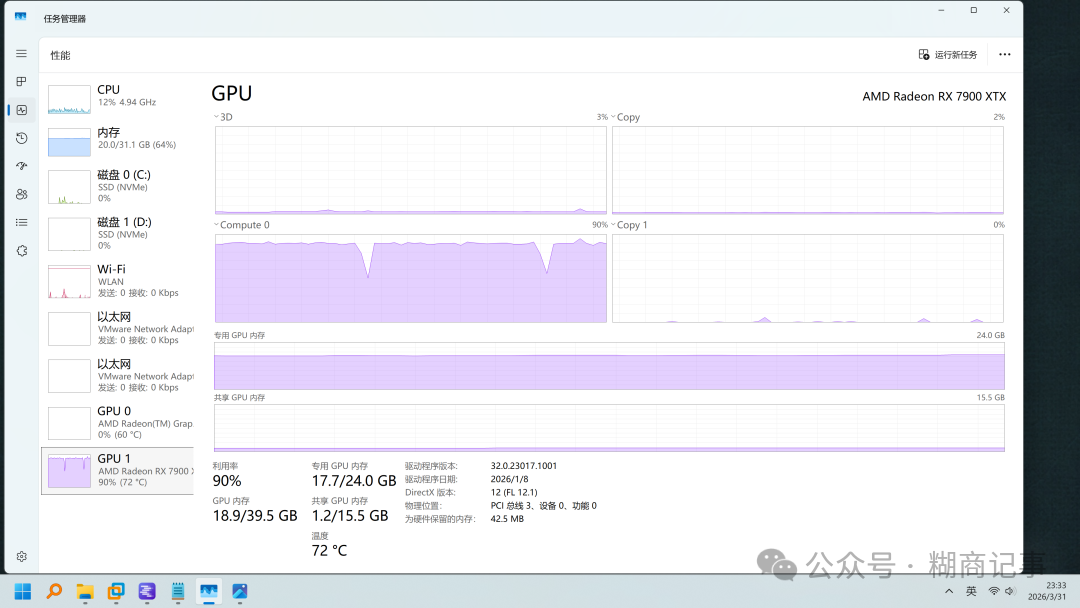

在实际测试中,当 WorkBuddy 调用本地 Qwen3.5 9B 模型进行复杂任务推理时,电脑风扇立刻进入“起飞模式”。查看任务管理器,GPU 占用率瞬间飙升至 90% 以上,显存占用接近 18GB(我使用的是 AMD RX 7900 XTX 24GB 显存)。

这还仅仅是 9B 参数量的“小模型”。因此,如果你考虑使用 WorkBuddy 的本地部署功能,请务必审视你的硬件条件:

- 显卡:显存至少 16GB 起步,推荐 24GB 或以上,否则寸步难行。

- 功耗与散热:高性能 GPU 满载运行意味着更高的电费和显著的发热量,笔记本用户或在安静环境(如卧室)中使用需慎重。

- Token消耗:在开发或调试模式下,模型推理会快速消耗输入/输出的 Token,需要有一定的心理预期。

五、总结与选择建议

经过这一轮的对比体验,我的结论如下:

| 用户类型 |

推荐选择 |

关键理由 |

| 极度注重隐私/有合规要求 |

WorkBuddy |

数据完全本地处理,安全可控。但你需要拥有一块高性能大显存显卡。 |

| 追求效率、省心、开箱即用 |

QClaw |

云端服务免部署,智能调用 Skills 更高效,综合体验更流畅。 |

| 电脑配置普通/笔记本用户 |

建议放弃本地模型 |

云端方案(如 QClaw)是更实际、更经济的选择。 |

总而言之,QClaw 和 WorkBuddy 代表了当前 AI 助手两种不同的产品思路:一个追求云端协同与开箱即用的便捷,一个深耕本地化与数据安全的可控。两者都在快速迭代中,未来功能也许会趋同。但目前的选择,很大程度上取决于你对数据隐私的重视程度以及你愿意(且能够)为之付出的硬件成本。

希望这篇来自真实体验的对比,能帮助你做出更适合自己的决定。如果你想了解更多关于人工智能工具或本地部署的实战技巧,欢迎来云栈社区的开发者广场一起交流探讨。 |