近日,AI领域发生了一起引人关注的安全事件。Anthropic公司一名负责发布 claude-code npm 包的工程师,因在发布包时包含了源代码映射(source maps)文件,导致公司内部大量敏感代码被意外公开。随后,该工程师确认已被公司解雇。

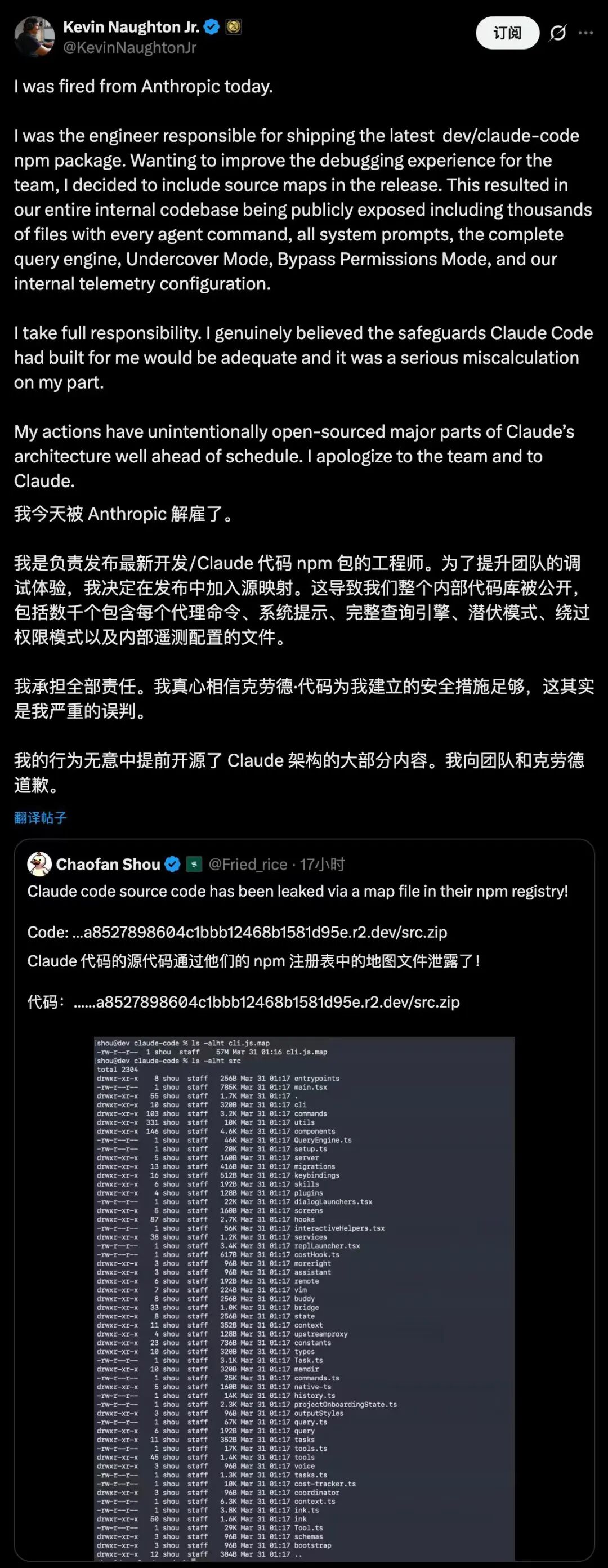

根据其在社交媒体上发布的帖子,该工程师的本意是为了“改善团队的调试体验”,故决定在 npm 包的发布版本中加入 source maps。然而,这一操作导致包含“数千个文件”的整个内部代码库被暴露。泄露的内容涉及每个代理命令、所有系统提示、完整的查询引擎、Undercover Mode、Bypass Permissions Mode以及内部的遥测配置。

该工程师在帖子中承认了错误,表示自己“承担全部责任”,并为其“严重的误判”道歉。他提到,自己的行为“无意中提前开源了Claude架构的大部分内容”。帖子下方的评论则指出了泄露代码的具体存储链接。

这一事件迅速在技术圈内引发了讨论,特别是在关注AI模型安全与内部架构保密的开发者群体中。有观点认为,这暴露了大型AI公司在研发流程和发布审计上可能存在的疏漏。也有声音指出,使用 source maps 虽便于调试,但在生产包中发布却是一把双刃剑,需要极其严格的审查机制。

“我的行为无意中提前开源了Claude架构的大部分内容。我向团队和Claude道歉。”——涉事工程师

坊间传闻称,这起事件可能是愚人节假消息,并提及该工程师本人此前就是谷歌工程师。无论真相如何,此事都为所有涉及敏感代码部署的团队敲响了警钟:在追求开发效率的同时,必须将代码安全和发布流程的严谨性置于首位。

对于这类涉及前沿技术、安全与职场动态的混合话题,欢迎到云栈社区的相应板块进行更深入的交流与探讨。 |