2026年3月31日,人工智能开发商Anthropic经历了一场由发布流程失误引发的风波。其旗下的AI编程开发工具Claude Code,在生产环境的最新版本中意外打包了完整的Source Map文件。

这一失误直接导致约1,900个TypeScript源文件被公开泄露,涉及超过51.2万行未经混淆的原始代码。消息一出,立即在开发者社区中引发关注,不少技术爱好者迅速镜像了完整的代码库,开始深度挖掘其中隐藏的内部工作机制。

需要澄清的是,此次事件并非外部黑客攻击所致,而是一次典型的“自爆”式打包错误。在正常的软件发布流程中,用于开发调试的Source Map文件理应被排除在外。值得注意的是,这并非Claude Code首次发生类似问题。

此外,需要特别强调的是,本次泄露的范围严格限定于Claude Code产品本身的客户端代码。Anthropic的核心资产,包括模型权重、训练数据以及后端服务等均未涉及。开发者若想使用Claude Code,仍然需要通过配置合法的API密钥或账户来完成。

产品中内置“卧底模式”

代码分析揭示了一个名为“卧底模式”(Undercover Mode)的内部功能,该模式专为Anthropic员工设计。当员工使用Claude Code向公开的代码仓库(如GitHub)提交代码时,此模式会自动激活。

卧底模式的核心指令是要求模型隐藏其AI身份。它明确禁止在提交信息(commit message)中提及Claude Code、AI助手身份、内部项目代号以及任何尚未发布的版本信息。更有趣的是,该模式还特别要求模型移除提交记录中的 Co-Authored-By 行,旨在让由Claude AI生成的代码贡献看起来完全出自人类开发者之手,避免因声明行而暴露。

部分账号封禁策略浮出水面

对于部分地区的用户而言,在使用Claude Code时遭遇账号封禁并不罕见。泄露的代码显示,这背后源于一套完善的用户行为检测机制。

根据代码逻辑,Claude Code在运行时默认会收集多种信息并回传至其API平台,包括但不限于机器硬件信息、跨会话生成的持久标识符、用户使用的提示词特征模式以及网络地理位置数据等。这些收集到的特征数据最终由API平台进行分析与判定。

换句话说,Claude Code客户端本身并不直接执行封号操作,它更像是一个“情报收集端”。最终的封禁决策权在API平台手中,平台会综合各项特征进行评估。因此,那些信誉记录较差或来自高风险地区的IP地址,显然更容易触发平台的封禁规则。

后续:是否会遭遇DMCA删除?

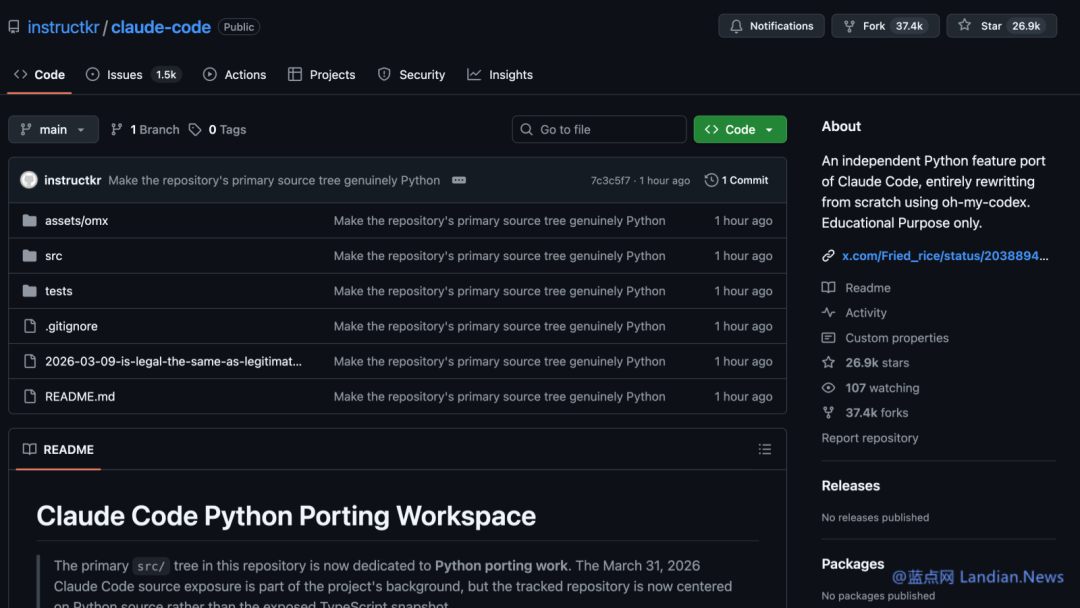

理论上,任何泄露到互联网上的数据都难以被彻底清除。尽管此前Anthropic确曾向GitHub发出过数字千年版权法(DMCA)通知,要求删除涉及Claude Code早期代码的仓库,但在此次大规模泄露事件发生后,并未立即看到相关行动。

这也给感兴趣的开发者提了个醒:如果希望深入研究这些代码,最好尽快将源代码整体下载到本地环境进行保存和分析,以防Anthropic后续采取法律行动导致GitHub上的相关仓库被批量删除。

事件更新:目前,Anthropic已正式向GitHub提交DMCA通知,要求删除超过8100个包含此次泄露代码的仓库。GitHub方面也已遵照执行,移除了相关仓库。尽管如此,这些源代码在互联网的其他角落依然不难找到。

对于关注人工智能领域动态与技术安全的开发者来说,这次事件无疑提供了一个罕见的机会,可以一窥顶级AI公司产品层的设计思路与内部逻辑。如果你想与技术同好交流更多类似的行业洞察或安全分析,欢迎来云栈社区的相应板块参与讨论。 |