最近,不少读者在后台询问我之前提到的那个“信源可靠性研判工具”能否分享出来。

说实话,这有点让我受宠若惊。熟悉我的老读者都知道,我一向乐于分享。今天,我就把这个工具彻底开源了,文末会附上详细的安装方式。

不过,在介绍这个工具之前,我想先探讨一个更前置的问题:信息从哪来。信源验证的前提是你得有信息可验。昨天我在X上看到一个名为 last30days 的 Claude Code Skill 正在刷屏,上线66天就攒了16K Stars,作者是 Lyft 的联合创始人 Matt Van Horn。

这篇内容将是一次完整的实践记录:使用 last30days 采集热点信息,再调用信源验证工具来判断这些信息你究竟该信几分。

我们先简单了解一下 last30days 在做什么。

它和普通搜索最大的区别并非“搜得更多”,而是“搜的东西不一样”。Google 搜索的结果通常是媒体文章和官方内容,而 last30days 搜的是社区里的真实讨论:Reddit 里的吐槽、X 上的争论、Hacker News 的技术辩论,甚至包括 Polymarket 上人们用真金白银下注的预测。

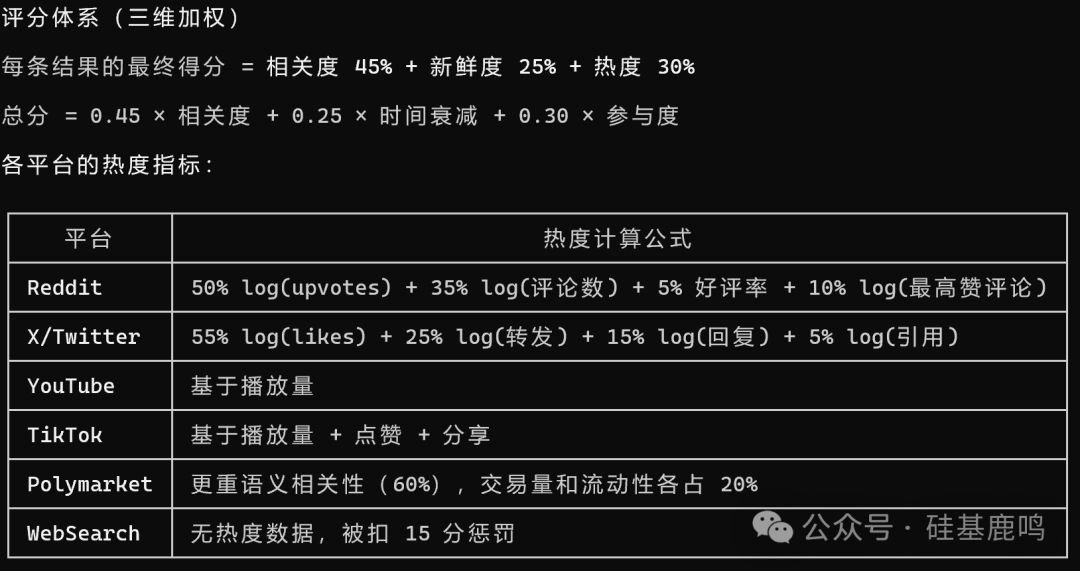

它还引入了一套三维评分体系:每条结果的最终得分 = 相关度 45% + 新鲜度 25% + 热度 30%。不同平台的热度计算方式各异:Reddit 看 upvotes 和评论数,X 看 likes 和转发,Polymarket 则看交易量和流动性。普通的网页搜索结果由于缺乏热度数据,会被直接扣除15分作为惩罚。

设计思路确实不错,但实际跑起来效果如何呢?

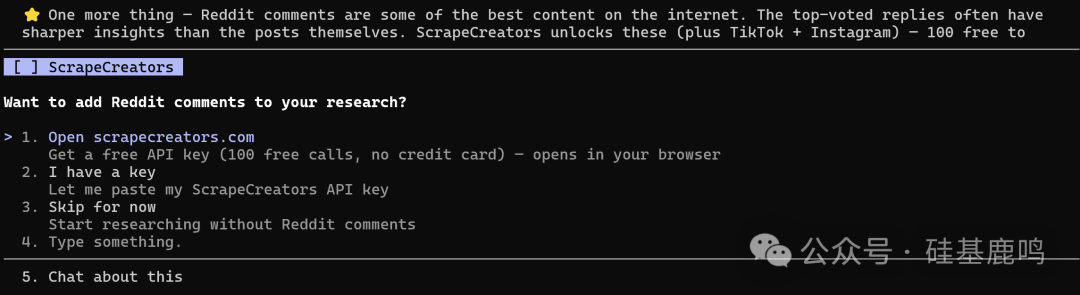

安装过程非常简单,只需执行 git clone 到 ~/.claude/skills/last30days 目录即可。在零配置状态下,它会提供三个免费数据源:Reddit、Hacker News 和 Polymarket。不过,我的测试环境是 Windows 11,这里有个重要的提醒:last30days 是一个 macOS 优先开发的项目,在 Windows 上可能会遇到 python3 路径问题和超时机制不兼容,需要手动修改几处配置。macOS 用户可以跳过这段,Windows 用户强烈建议使用 WSL 来运行,能省去很多麻烦。

修复了兼容性问题后,我先用“AI coding assistants”这个宽泛的话题进行测试,覆盖率只有大约60%。脚本只成功跑通了 Hacker News 和部分 Reddit 帖子,X 和 YouTube 全挂了,最后是依靠 Claude 自带的 WebSearch 功能来补足信息。说白了,这个结果和直接让 Claude 去搜索差别不大。

后来我换了个思路。既然 Hacker News 和 Reddit 天然适合技术对比类话题,那我就拿“Claude Code vs Cursor”来测试。

效果立刻变得不一样了。

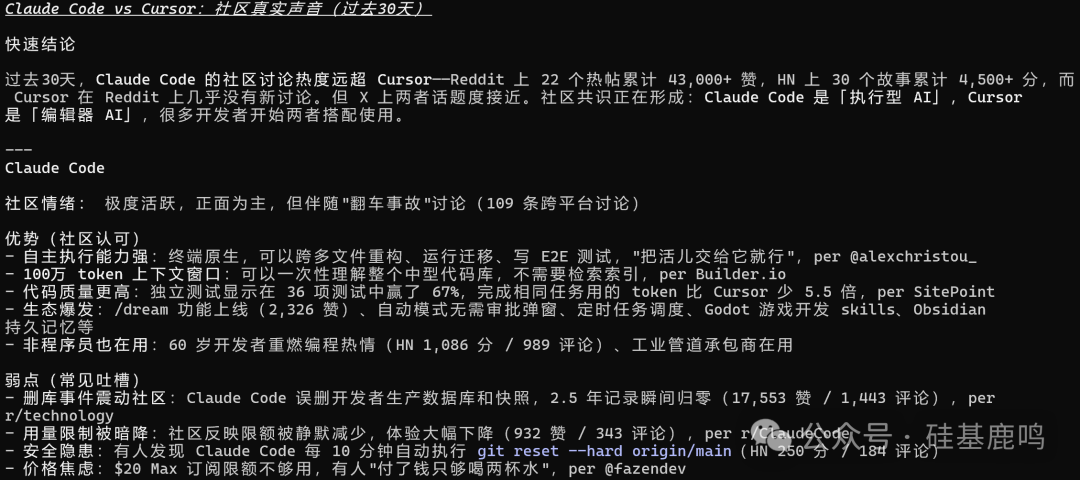

这次,脚本成功抓取到了22条 Reddit 讨论、189条 X 推文和69条 Hacker News 帖子,覆盖率接近80%。报告里提供的社区情绪分析、优劣势对比、关键意见领袖排名,确实是普通搜索引擎无法给出的信息增量。

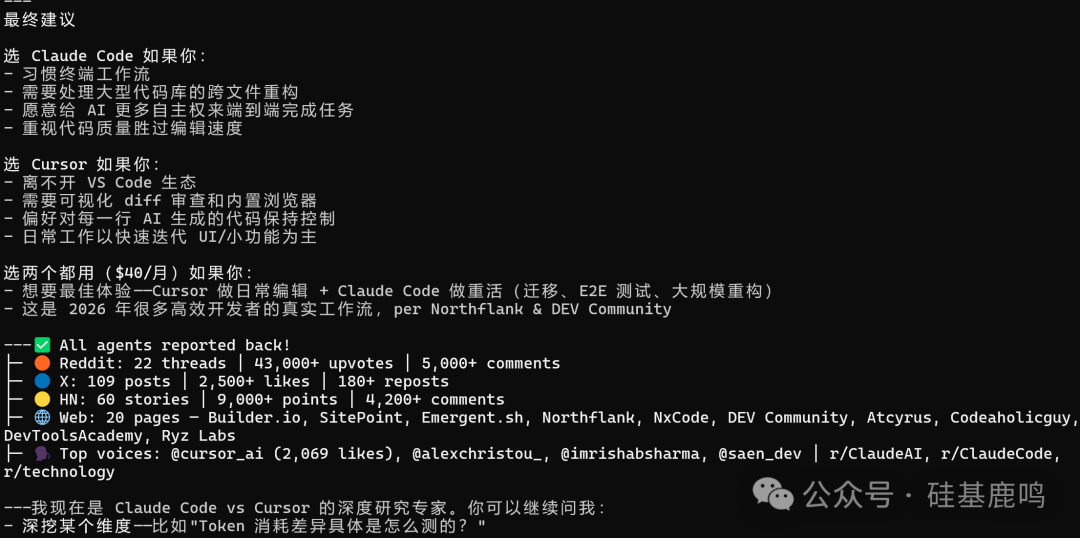

(last30days生成的对比报告部分内容)

(报告中的最终建议与数据汇总)

简单总结一下:话题选对,数据源才能喂饱。用这些英文社区平台去搜索泛泛的概念,得到的数据会很稀疏。但如果是具体的工具对比、技术争议或行业事件这类话题,last30days 所采集的社区讨论数据,其信息密度和真实性确实远超普通搜索。

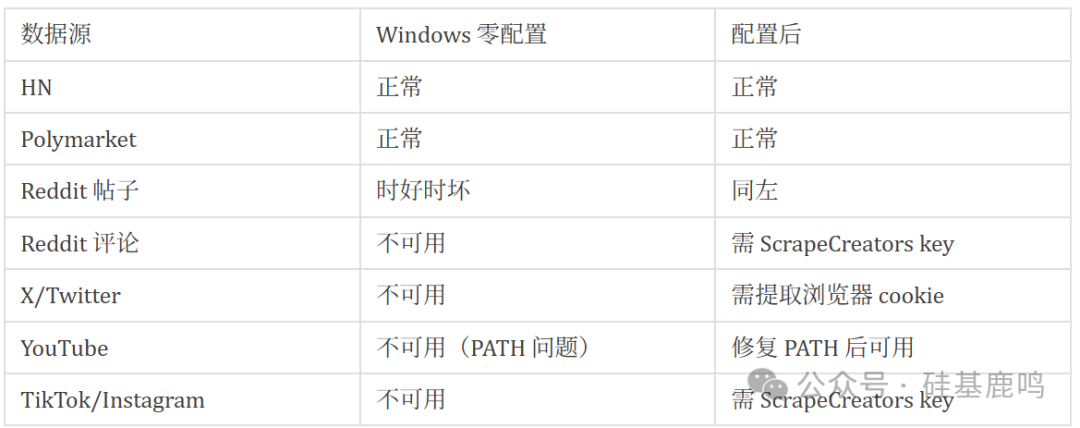

(不同数据源在不同系统下的配置情况对比)

说回信源验证。

last30days 帮你把信息聚合起来了,但聚合不等于可信。例如,它的报告中提到“Claude Code 在 36 项独立测试中赢了 67%”,还有“Claude Code 完成相同任务的 token 比 Cursor 少 5.5 倍”。这些数据到底准不准?引用源头在哪里?有没有被断章取义?

这就是“信源可靠性研判引擎”要解决的问题。

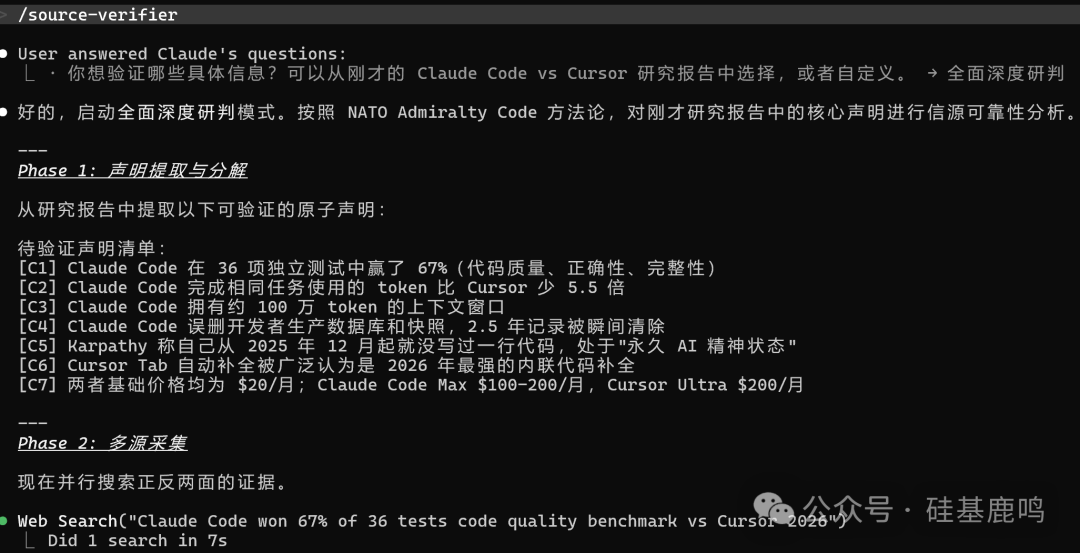

我在 Claude Code 里直接输入 /source-verifier,选择对 last30days 生成的报告进行“全面深度研判”。工具会自动提取报告中的所有可验证声明,并按照 NATO Admiralty Code(北约海军部代码)的双维度评估体系(信源可靠性、信息可信度)逐条进行交叉验证。

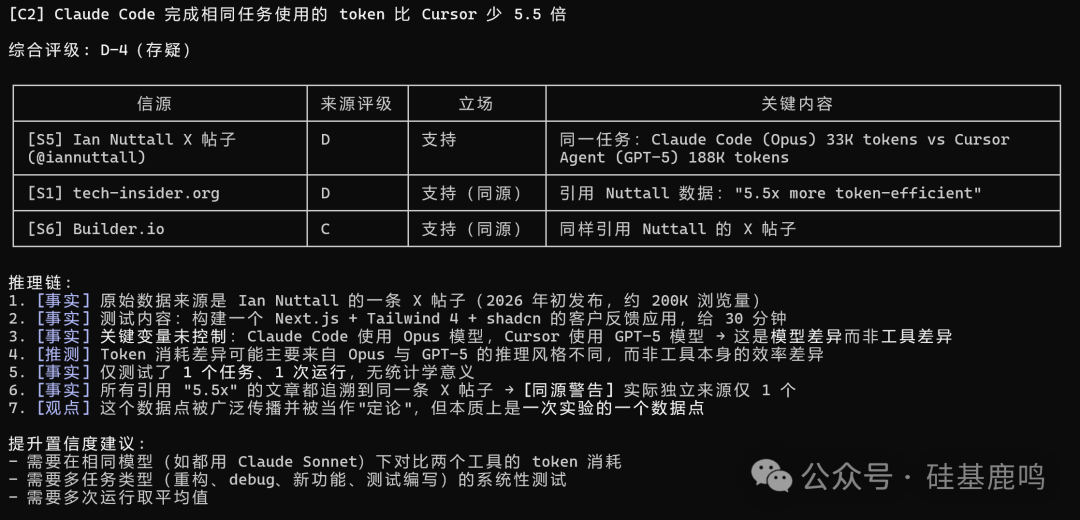

举个例子。针对“Claude Code 完成相同任务的 token 比 Cursor 少 5.5 倍”这条声明,验证工具给出的综合评级是 D-4(存疑)。分析显示,原始数据仅来源于 Ian Nuttall 的一条 X 帖子,属于单一独立信源。并且,测试场景局限在一个特定的 Next.js 项目上,对比双方使用的模型也不同(Claude Code 用 Opus,Cursor 用 GPT-5)。这个单一数据点在被广泛引用后,就被放大成了“Claude Code 效率碾压 Cursor”的结论,但其本质上只是一次非标准实验的观察结果。

这就是信源验证的核心价值。它并非简单地告诉你某条信息是对是错,而是客观地评估“你该信这条信息几分”以及“为什么”,帮助你建立起对信息质量的量化判断能力。

最终结论

last30days 和 source-verifier 这个组合,解决了信息处理链条上的两个关键环节:从哪获取信息 + 信息该信几分。前者帮助你跳出算法推荐的信息茧房,直接触达社区的真实声音;后者则帮助你在信息洪流中保持清醒的判断力,避免被片面或存疑的数据误导。

安装方式

-

last30days Skill 安装(推荐 macOS/Linux 用户):

git clone https://github.com/mvanhorn/last30days-skill.git ~/.claude/skills/last30days

-

信源可靠性研判引擎 (source-verifier) 安装:

这是 Claude Code 的原生插件安装方式,支持一键更新。

claude plugin marketplace add Luxuzhou/source-verifier-skill

claude plugin install source-verifier

后续可通过 claude plugin update source-verifier 进行更新。Gemini CLI 用户可以使用 gemini extensions install 命令。习惯手动操作的用户,也可以直接 git clone 到 skills 目录。这是一个纯文本 Skill,不依赖任何二进制文件,macOS、Windows、Linux 均可运行。

安装完成后,在 Claude Code 中直接输入 /source-verifier 即可使用,无需额外的 API Key。Skill 内部的检索工具链(如 Tavily、Brave Search 等 MCP 服务)也可以根据你的需求自行扩充,以增强搜索覆盖范围。

关于更多优秀的开源实战项目与深度解析,可以关注像云栈社区这样的开发者聚集地,那里是获取灵感和交流技术的好去处。

写在最后

本文分享的 source-verifier-skill 是一个新发布的版本,旨在为研究和工作流增加一层事实核查的保障。在 AI 应用日益深入的今天,如何高效获取并审慎评估信息,已经成为一项关键技能。

GitHub 项目地址:https://github.com/Luxuzhou/source-verifier-skill

如果在使用中遇到任何问题或发现了未覆盖的边界情况,欢迎在 GitHub 仓库提交 Issue 反馈。如果你觉得这个工具对你有帮助,也请不吝点个 Star,这对独立开发者来说意义重大。