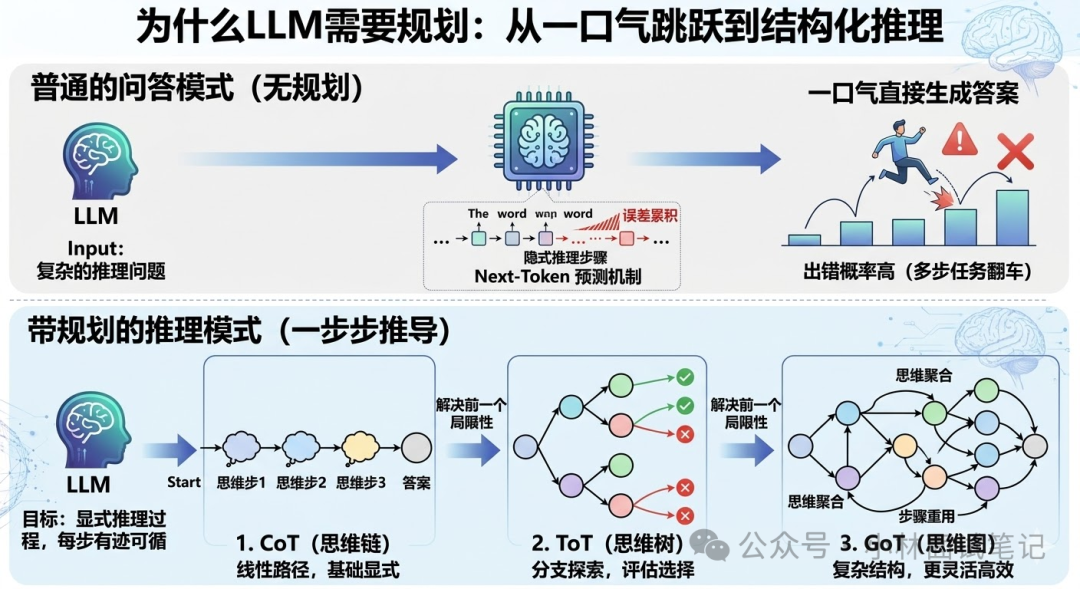

要理解为什么需要为大语言模型(LLM)赋予规划能力,首先得看看它在没有任何规划机制时是如何运作的。

在普通的问答模式下,LLM 接到一个问题,就直接「一口气」生成答案,中间没有任何推理过程。这对简单问题没啥大问题,但遇到需要多步推导的任务就很容易翻车。比如让它做一道需要 3 步推导的逻辑题,如果直接让它给答案,出错概率会远高于让它把每步都写出来。

背后的原因是 Transformer 的 next-token 预测机制,每个 token 是基于前面所有 token 生成的,推理链越长、隐式的跳步越多,误差就越容易在中间某一步悄悄累积,最后给出一个看起来很自信但其实是错的答案。

「规划能力」要解决的就是这个问题:把 LLM 隐式的推理过程显式化,让它不再是「一步跳到答案」,而是「一步一步推到答案」,每步都有迹可循。

CoT、ToT、GoT 是人工智能领域为解决规划能力问题而依次演进的三种核心方案,每一个都在解决前一个的局限性。

CoT:最简单的激活方式,加一句话就够了

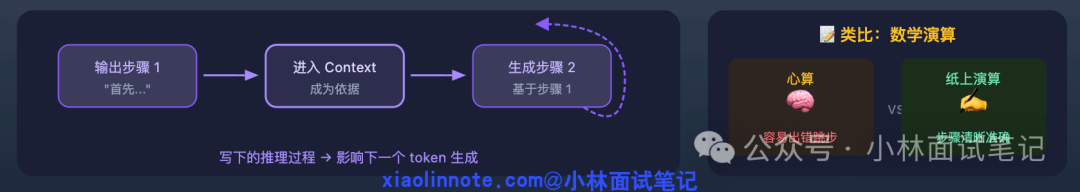

CoT 的全称是 Chain of Thought(思维链),核心思路极其简单:在 prompt 里加一句「请一步步思考」,LLM 就会把推理过程逐步写出来,而不是直接蹦出答案。

为什么这么简单的改变就有效?

本质是因为 LLM 的输出是顺序生成的,当它先输出推理步骤,这些推理内容会进入上下文,影响下一个 token 的生成。换句话说,「写下来的推理过程」本身就成为了后续生成的依据,帮助 LLM 不跳步、不乱想。就好比你在纸上演算数学题,把每一步写出来之后,下一步出错的概率会比在脑子里算要低得多,原理是一样的。

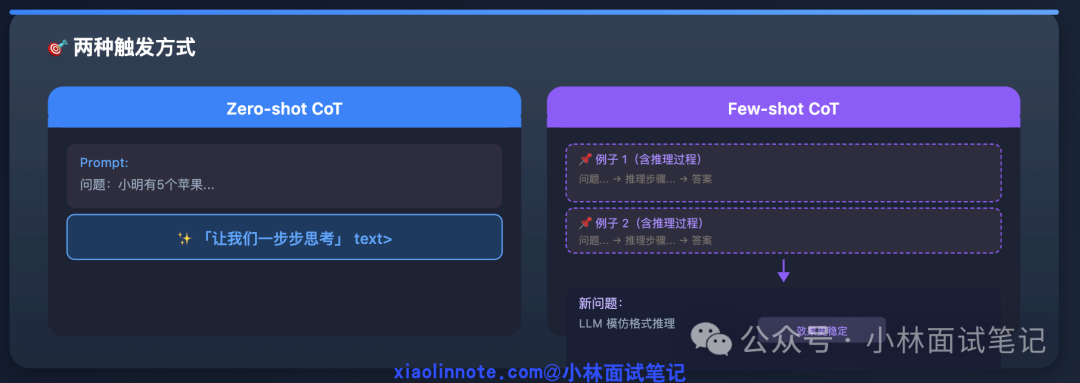

CoT 有两种触发方式。

- 第一种叫 Zero-shot CoT,就是直接在 prompt 末尾加「让我们一步步思考」,LLM 自己展开推理,不需要额外例子;

- 第二种叫 Few-shot CoT,给几个带有完整推理过程的例子,让 LLM 模仿这种推理格式来回答新问题,效果通常更稳定。

CoT 的局限很明显:它只有「一条推理路径」。如果一开始走错了方向,整条链就歪了,没有任何纠偏机制。

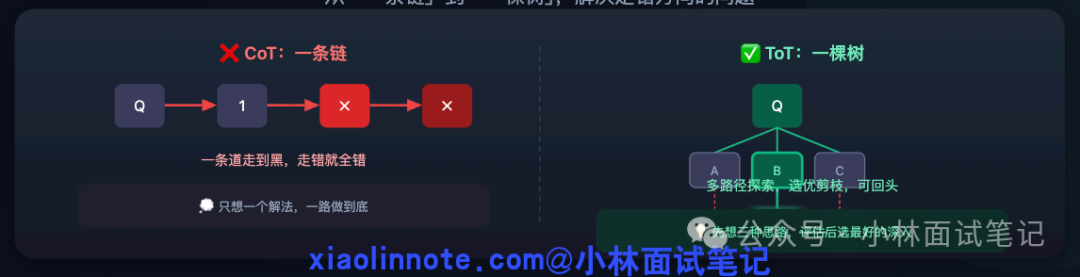

ToT:从「一条链」到「一棵树」,解决走错方向的问题

ToT 的全称是 Tree of Thoughts(思维树),针对的正是 CoT「一旦走错就全错」的问题。

核心改变是把「生成一条推理链」变成「同时探索多条推理路径,边探索边剪枝,最终选出最优路径」。用一个生活类比来理解:CoT 像你做题时只想了一个解法,一路做到底;ToT 像你先想了三种可能的解题思路,评估了一下哪种最靠谱,选了最好的那条继续深入,另外两条直接放弃。这种思路不仅在技术开发中有用,在做技术面试求职时规划解题路径也是一种类似的思维训练。

ToT 的执行流程可以分三步来理解。

- 生成多个候选思路:让 LLM 针对同一个问题给出 3 个不同的初步方向,而不是只走一条路。

- 评估可行性:用另一个 LLM 调用(或同一个 LLM 带上评估 prompt)给每个思路打分,判断哪个最有希望。

- 选优继续深入、剪掉差的:只保留分数高的思路,再展开下一层推理,反复循环直到得出最终答案。

这个「生成 -> 评估 -> 剪枝」的循环,让 LLM 不再是「一条道走到黑」,而是有了探索多条路、选好的走、发现走错了还能回头的能力。代价也很明显:原来 CoT 一次生成就搞定,ToT 需要多次 LLM 调用(多条路径 × 多层深度 × 每层还要评估),成本是 CoT 的 3-5 倍甚至更高。

GoT:从「树」到「图」,解决推理结果不能复用的问题

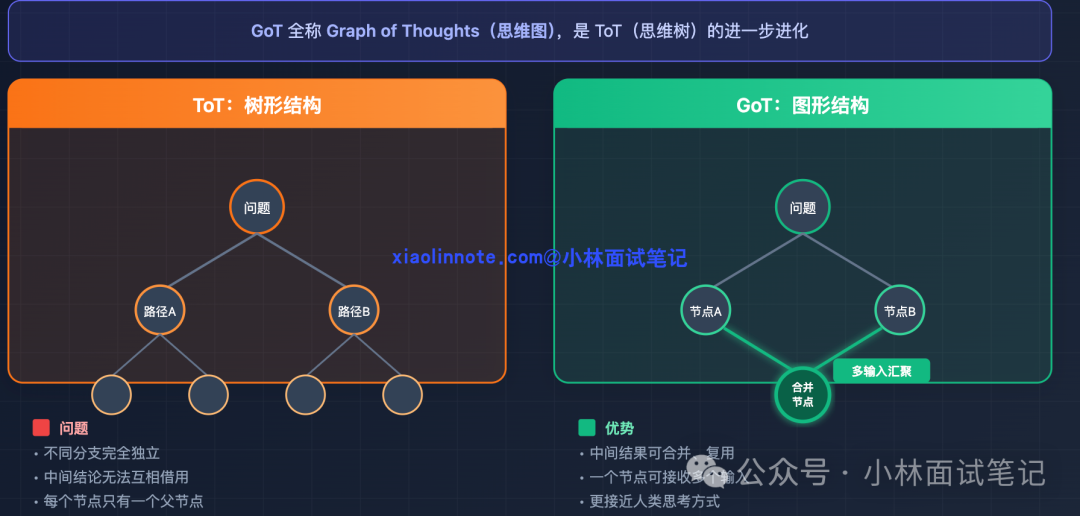

GoT 的全称是 Graph of Thoughts(思维图),是在 ToT 基础上再进一步的进化。

ToT 虽然引入了多路径探索,但它是树形结构,不同分支之间完全独立,两条推理路径上的中间结论无法互相借用。

GoT 把推理结构换成了图,允许不同路径的中间结果合并、复用,也就是说一个推理节点可以接收来自多个前置节点的输出作为输入。

举个具体例子:如果任务是「分别研究竞品 A 和竞品 B,然后做综合对比分析」。

ToT 里研究 A 和研究 B 是两条独立的路径,各自得出结论;但「综合对比分析」这一步需要同时用到两条路径的结论,在树形结构里很难自然表达,因为树的每个节点只有一个父节点。

GoT 的图结构允许把「研究 A 的节点」和「研究 B 的节点」的输出,汇聚到「综合对比分析节点」,这种「多个中间结论合并输入到下一步」的操作在图里是一等公民,表达起来非常自然。

GoT 能建模的推理模式比 ToT 更丰富,也更接近人类实际处理复杂任务的思考方式。但落地复杂度很高,目前主要还是学术研究场景,生产环境里极少见到真正用起来的。

三者的演进关系与工程选型

把这三者放在演进视角里看,逻辑非常清晰。

- CoT 解决了「要不要把推理显式化」的问题,答案是要,把过程写出来就能显著减少跳步出错。

- ToT 解决了「走错方向怎么办」的问题,答案是先多探索几条路,边走边评估边剪枝。

- GoT 解决了「不同推理路径的中间结论能不能复用」的问题,答案是把结构从树换成图,自然支持结论汇聚与复用。每一步都是在前一步的基础上发现局限、针对性改进。

工程上怎么选?

- CoT 几乎是所有任务的标配,加一句话、零成本,直接加到 system prompt 里就行。这是最基础的技术文档中都应提及的优化技巧。

- ToT 在准确率要求很高、任务比较复杂的场景值得考虑,但要做好调用成本增加 3-5 倍的心理准备。

- GoT 目前工程落地不成熟,主要了解它的思想即可,真实项目里不必强行引入。

希望这篇从原理到实践对比的解析,能帮助你更系统地理解 LLM 的规划能力。如果你想深入探讨这些技术在实际项目中的应用,欢迎到 云栈社区 与更多开发者交流。