作为中国互联网史上最“长寿”的国民级IM,QQ过去25年的架构演进,堪称一部“业务倒逼技术升级”的活教材。从1999年OICQ单台服务器支撑90人在线,到2024年支撑1.4亿用户同时在线、日处理万亿级消息,QQ历经了六次关键的架构跃迁。本文将结合详实的时间线与架构图,深度拆解其“业务需求 → 技术挑战 → 解决方案”的完整逻辑,为你还原一个IM系统从单体走向云原生的全貌。

第一章:初创求生期(1999.02-2001.12):UDP + 单体,抢下IM生死线

1.1 业务背景

- 1999.02.10:OICQ 99b正式上线,核心功能仅文字聊天、好友列表、在线状态,对标ICQ。

- 1999年底:注册用户突破100万,同时在线峰值从初期的90人突破1万。

- 2000年:正式更名为QQ,上线QQ群(初期上限10人)、QQ秀、视频聊天,用户数呈指数级增长。

- 2001年底:注册用户破1亿,同时在线冲击百万级,跻身国内顶级IM产品。

- 核心诉求:在带宽稀缺、服务器昂贵的年代“先活下来”,在ICQ、MSN等竞品的围剿中快速抢占市场。

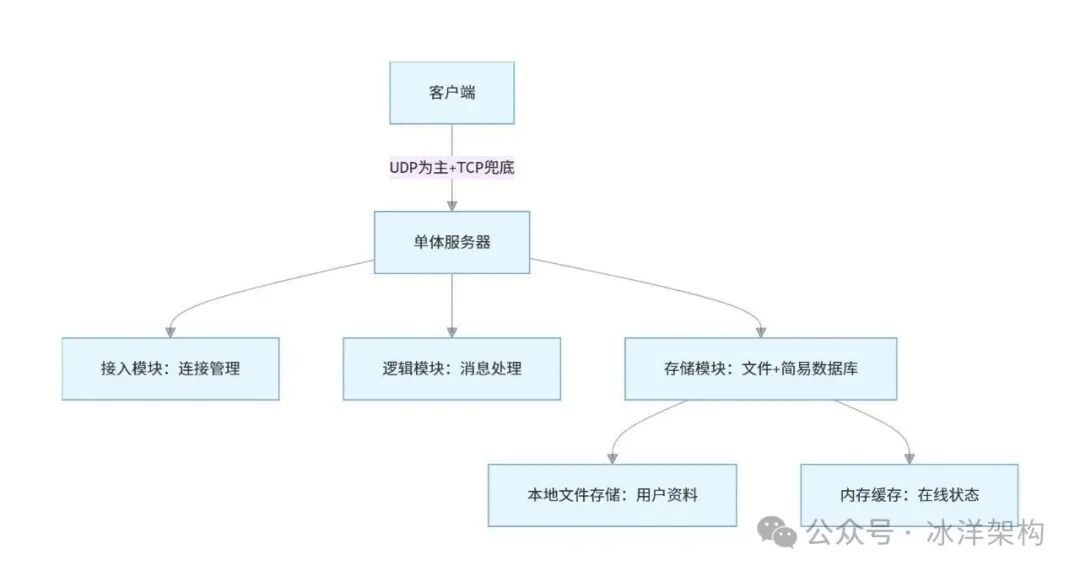

1.2 核心架构设计

架构模型:极简的C/S单体架构(接入、逻辑、存储合一)。

关键技术选型:

- 传输协议:以UDP为主,并在应用层补充可靠性机制(超时重传、去重、有序化)。UDP头部仅8字节,相比TCP能节省大量带宽。

- 存储方案:用户资料采用文件存储,在线状态全部加载到内存,离线消息暂存于服务器。

- 通信流程:在应用层封装UDP数据报,并限制单包大小≤1472字节,以避免IP分片。

1.3 核心业务痛点→技术挑战→解决方案

| 业务痛点 |

技术挑战 |

解决方案 |

| 带宽成本高,TCP三次握手延迟影响实时体验 |

带宽稀缺 + 连接建立开销大,并发连接扛不住 |

选用UDP协议,在应用层实现可靠性机制(超时重传、校验和、消息有序化) |

| 单服务器撑不住万级在线,扩容只能堆机器 |

C10K瓶颈初现,单机连接数上限限制用户增长 |

拆分接入模块为独立接入机,通过轻量状态同步实现水平扩展 |

| 消息传输易丢失,离线用户无法接收消息 |

UDP无连接特性导致消息不可靠,无离线存储 |

服务器落地存储消息,客户端上线后拉取;设计消息回执机制,未确认则重传 |

| 开发周期短(仅3个月),需快速上线验证市场 |

架构设计与开发效率矛盾,无时间做复杂设计 |

采用单体架构,业务与架构强耦合,优先保障核心通信功能可用 |

1.4 架构痛点

- 单点故障:全链路高度耦合,单台服务器宕机将导致全服不可用。

- 扩容困难:缺乏集群架构,扩容只能垂直升级硬件或简单堆叠机器。

- 功能扩展受限:新增业务(如QQ群、视频聊天)需要修改核心代码,迭代效率低下。

- 监控缺失:没有实时监控系统,服务状态依赖人工查看日志。

1.5 阶段成果

- 2001年底注册用户突破1亿,同时在线达到百万级,成功抢占IM市场主导地位。

- UDP协议的使用使带宽利用率提升了约30%,消息延迟控制在100ms以内,优于同期竞品。

- 验证了“轻量级协议 + 极简架构”在早期互联网环境下的可行性。

第二章:百万在线攻坚期(2002-2004):分拆服务,扛住指数增长

2.1 业务背景

- 2002年:同时在线突破300万,上线文件传输、远程协助功能。

- 2003年:推出网络硬盘、QQ邮箱绑定,业务边界从即时通信向工具化延伸。

- 2004年6月16日:腾讯港股上市,QQ成为核心营收支柱;同时在线突破3000万。

- 核心诉求:解决单体架构的扩容瓶颈,支撑百万级并发,保障多业务稳定运行。

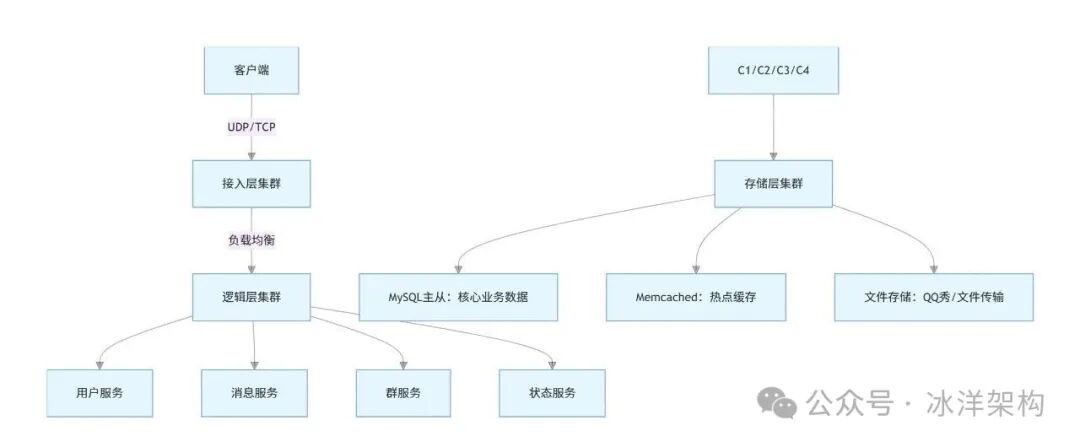

2.2 核心架构优化

核心优化方向:三层架构拆分(接入层 + 逻辑层 + 存储层)+ 服务化雏形。

关键技术突破:

- 接入层独立:负责长连接管理、负载均衡、协议解析,支持水平扩容。

- 逻辑层拆分:按业务域拆分为用户、消息、群、状态等服务,降低耦合度。

- 存储层升级:引入MySQL主从架构实现读写分离,使用Memcached缓存热点数据。

- 协议标准化:自研QDP协议替代原始的ICQ兼容层,提升通信效率。

2.3 核心业务痛点→技术挑战→解决方案

| 业务痛点 |

技术挑战 |

解决方案 |

| 百万级并发连接打满单机,接入层成为瓶颈 |

单机连接数上限不足,负载不均 |

接入层集群化部署,采用“最小连接数”负载均衡策略,支持动态扩容 |

| 数据库查询量暴增,读写冲突严重 |

单库并发瓶颈,查询响应超时 |

实施MySQL主从分离,写操作走主库、读操作走从库;热点数据缓存至Memcached |

| 群聊消息扩散延迟高,多人聊天卡顿 |

群消息需向所有成员推送,同步处理阻塞 |

采用“写扩散”模型,消息批量投递;引入消息队列异步处理扩散逻辑 |

| 多端登录(PC + 手机)导致状态同步混乱 |

多设备登录时在线状态、消息同步不一致 |

搭建统一状态中心,会话原子更新,确保多端状态实时同步 |

2.4 关键决策与技术细节

- 读写分离策略:主库仅处理用户注册、消息发送等写操作;从库负责好友列表查询、历史消息拉取等读操作,将读请求压力分散至多个从库。

- 缓存设计:Memcached集群缓存用户在线状态、好友关系链等高頻访问数据,缓存命中率达90%以上,数据库压力降低60%。

- 容灾雏形:建立深圳主IDC + 上海备份节点,核心数据多副本存储,降低单点故障风险。

2.5 阶段成果

- 2004年同时在线突破3000万,支撑了文件传输、远程协助等新业务的稳定运行。

- 系统可用性提升至99.9%,数据库查询响应时间从500ms降至50ms以内。

- 奠定了“分层架构 + 服务拆分”的基础模式,为后续的业务扩张预留了空间。

第三章:生态爆炸期(2005-2010):内存架构,扛住偷菜洪峰

3.1 业务背景

- 2005年:QQ空间、QQ音乐、QQ宠物上线,QQ从IM工具向社交生态延伸。

- 2007年:同时在线突破8000万,成为全球首个同时在线破亿的IM产品。

- 2009年:QQ农场上线,“偷菜”引爆全民热潮,峰值请求量单日突破100亿次。

- 2010年:QQ空间日均上传图片超1亿张,非结构化数据呈爆炸式增长。

- 核心诉求:应对“偷菜”带来的超高并发读写,解决非结构化数据的存储压力,支撑社交生态多元化。

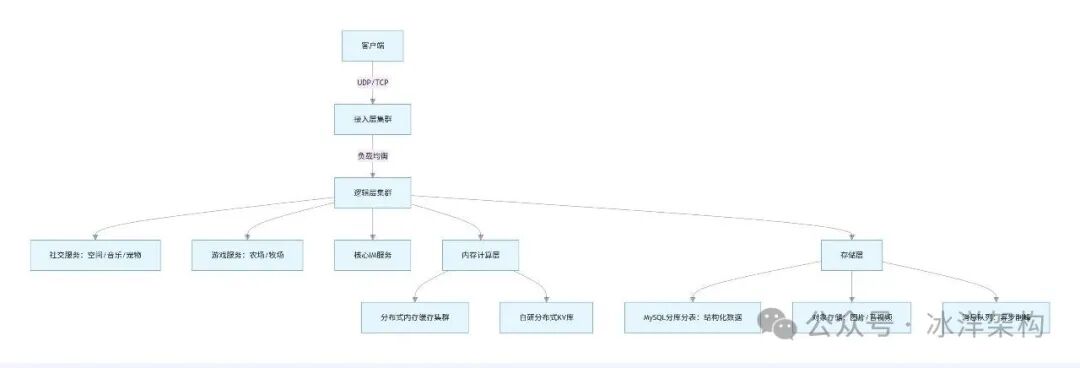

3.2 核心架构革命

核心架构变革:全链路以内存存储为主 + 分布式缓存 + 对象存储。

关键技术突破:

- 内存优先:核心业务(偷菜、消息、在线状态)数据全内存存储,异步落盘至磁盘。

- 分布式缓存:自研分布式KV库 + Memcached集群,实现冷热数据的自动调度。

- 异步化:引入消息队列进行削峰填谷,处理“偷菜”等突发流量。

- 存储分离:结构化数据使用MySQL分库分表,非结构化数据使用对象存储独立治理。

3.3 核心业务痛点→技术挑战→解决方案

| 业务痛点 |

技术挑战 |

解决方案 |

| QQ农场偷菜峰值请求达100亿次/日,数据库彻底顶不住 |

超高并发读写,磁盘IO成为瓶颈 |

采用All DRAM架构,偷菜核心逻辑全内存运行,仅异步落盘至磁盘 |

| QQ空间日均1亿张图片上传,存储成本高、访问慢 |

非结构化数据存储扩容难、效率低 |

引入对象存储服务,图片分片存储 + CDN加速,实施冷热数据分离 |

| 夜间偷菜高峰与白天低谷流量落差达20倍,资源浪费严重 |

潮汐流量导致资源供需失衡 |

建立弹性调度机制,在线服务与离线任务(数据分析、备份)混跑,提升资源利用率 |

| 社交、游戏、IM多业务共享资源,一个业务故障影响全局 |

业务耦合导致故障扩散 |

实施业务域隔离,核心IM服务资源优先保障,非核心业务(如游戏)独立部署 |

3.4 关键技术细节

- 偷菜业务架构:服务端维护全局状态机(种植→生长→成熟→可偷→冷却),客户端仅负责渲染,所有判定逻辑在服务端执行,有效防止外挂作弊。

- 缓存策略:热点数据(如作物成熟状态、用户在线状态)置于内存缓存,缓存失效时间根据业务场景动态调整,确保数据实时性。

- 分库分表:按用户ID进行哈希分片,将上亿用户数据分散至数百个数据库节点,将单库并发压力降低至可控范围。

3.5 阶段成果

- 2007年同时在线突破1亿,2010年峰值达到1.2亿。

- QQ农场峰值并发处理能力达到10万次/秒,用户体验无明显卡顿。

- 系统可用性维持在99.9%,非结构化数据存储成本降低40%。

第四章:移动互联网转型期(2011-2014):弱网优化,动态心跳保在线

4.1 业务背景

- 2011年:智能手机普及,手机QQ用户快速增长,上线移动版QQ空间、语音消息。

- 2012年:2G/3G弱网环境成为主流,用户反馈掉线频繁、费流量、费电。

- 2013年:手机QQ同时在线突破1亿,移动端占比首次超过PC端。

- 2014年:同时在线峰值达2亿,上线QQ红包,开启移动支付布局。

- 核心诉求:解决移动弱网环境下的连接稳定性问题,优化流量与电量消耗,支撑移动端业务扩张。

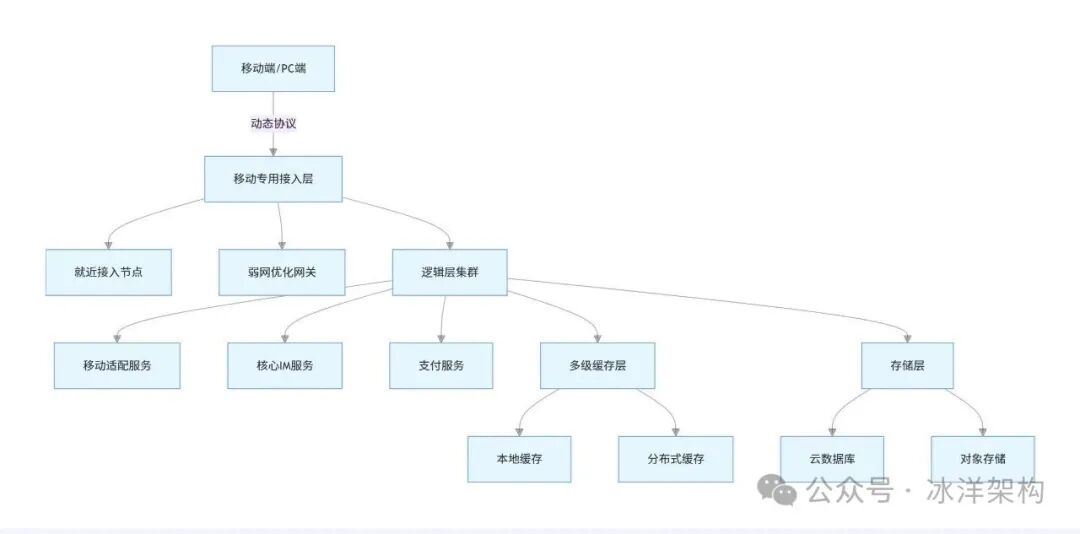

4.2 核心架构升级

核心架构特征:移动专用接入网 + 弱网优化 + 多地多中心部署。

关键技术突破:

- 动态心跳算法:根据网络类型(WiFi/4G/2G)自动调整心跳频率,在弱网环境下延长心跳间隔。

- 协议优化:采用二进制序列化 + 协议压缩,减少包体大小;合并推送消息,降低请求次数。

- 就近接入:在全国范围内部署接入节点,根据用户地理位置调度至最近节点,降低网络延迟。

- 弱网补偿:设计消息缓冲、批量同步、快速重连机制,提升弱网环境下的消息送达率。

4.3 核心业务痛点→技术挑战→解决方案

| 业务痛点 |

技术挑战 |

解决方案 |

| 2G/3G弱网环境下频繁掉线,连接稳定性差 |

网络波动大、NAT超时,长连接易断开 |

研发智能动态心跳算法,WiFi环境1分钟/次,2G环境5分钟/次;实现快速重连机制 |

| 移动端流量消耗大,用户投诉频繁 |

协议冗余、请求次数多,流量开销大 |

采用二进制协议替代文本协议,包体压缩率达60%;合并多条消息推送,减少请求次数 |

| 后台运行时电量消耗快,影响用户使用时长 |

频繁网络请求导致CPU唤醒频繁 |

优化后台保活策略,与系统级保活协同;心跳请求批量处理,减少CPU唤醒次数 |

| 跨运营商、跨地域访问延迟高,消息同步慢 |

网络路由跳转多,传输延迟大 |

全国部署20+接入节点,基于IP地理位置实现就近接入;优化跨网传输链路 |

4.4 关键技术细节

- 动态心跳机制:通过采集用户网络状态(信号强度、延迟、丢包率)动态调整心跳间隔,在连接稳定性与资源消耗之间取得平衡。

- 弱网消息传输:消息分优先级传输,文本消息优先,图片/视频等大文件在网络恢复后异步上传;支持断点续传。

- 电量优化:后台仅保留核心连接线程,非核心功能(如广告推送)在后台暂停,唤醒时进行批量处理。

4.5 阶段成果

- 移动端同时在线突破1亿,弱网环境掉线率从30%降至5%以下。

- 消息送达率提升至99.5%,流量消耗降低40%,电量消耗降低30%。

- 支撑了QQ红包业务的稳定运行,2014年春节收发总量达1亿个。

第五章:云原生与微服务期(2015-2021):解耦巨石,弹性扛洪峰

5.1 业务背景

- 2015年:业务极度复杂,涵盖聊天、群、直播、游戏、支付、小程序等数十个场景。

- 2017年:QQ开始上云,初期将15%的用户从私有云迁移至腾讯云。

- 2019年:30%的用户完成上云,采用“三云一地”混合云架构。

- 2021年:全面拥抱云原生,完成近20万台服务器的上云迁移。

- 核心诉求:解决巨石架构的迭代效率问题,支撑春节红包等极端并发场景,降低运维成本。

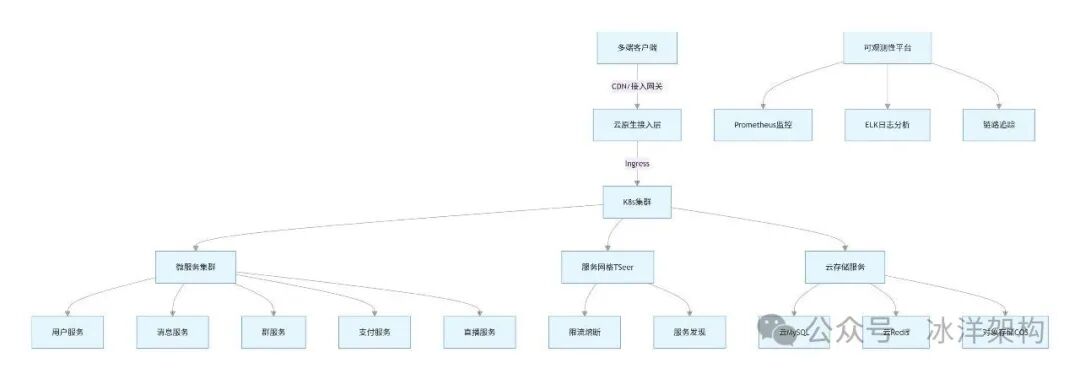

5.2 核心架构变革

架构迁移路径:私有云 → 混合云 → 全云原生。

关键技术选型:

- 微服务拆分:将巨石IM拆分为近百个微服务,按业务域独立部署和迭代。

- 容器化:基于Kubernetes实现容器编排,支持弹性伸缩。

- 服务治理:采用服务网格TSeer,实现限流、熔断、降级、服务发现。

- 全链路可观测:整合监控(Prometheus)、日志(ELK)、链路追踪,实现故障快速定位。

5.3 核心业务痛点→技术挑战→解决方案

| 业务痛点 |

技术挑战 |

解决方案 |

| 巨石架构迭代慢,改一处动全身,发布风险高 |

业务耦合严重,发布周期长,故障影响范围大 |

进行微服务拆分,按业务域解耦;引入蓝绿部署、灰度发布、一键回滚机制 |

| 春节红包、直播带货等场景突发流量,资源不足 |

流量波动剧烈,传统架构弹性伸缩响应慢 |

基于K8s的HPA(水平Pod自动扩缩容)实现自动扩缩容,采用预测式弹性调度,峰值时Pod数量可快速扩容10倍 |

| 近20万台服务器上云,数据迁移风险高、周期长 |

数据一致性难保障,业务中断风险大 |

采用“主备同步 + 切换”的迁移方案,先迁移非核心业务,再迁移核心服务;拉设4N专线保障网络稳定性 |

| 微服务依赖复杂,故障定位困难 |

服务调用链路长,问题排查效率低 |

搭建全链路可观测平台,实现监控告警、日志分析、链路追踪一体化,故障定位时间从小时级降至分钟级 |

5.4 关键技术细节

- 上云迁移策略:分三阶段推进。2017年试点迁移15%用户,2019年迁移30%用户,2021年完成全量迁移。采用“三云一地”架构(华北、华东、华南云区域 + 深圳自研机房),用户可跨区域调度。

- 微服务治理:核心服务(如消息、支付)采用多副本冗余,强弱依赖分离,确保非核心服务故障不影响核心功能;通过服务网格实现精细化的流量控制与故障隔离。

- 资源优化:利用云原生的弹性伸缩能力,将资源利用率从原来的30%提升至60%以上,运维成本降低约25%。

5.5 阶段成果

- 2021年完成全面上云,同时在线峰值稳定在1.4亿。

- 在春节红包等极端并发场景下,系统可用性达到99.99%,交易故障率低于0.001%。

- 研发迭代效率提升40%,新功能上线周期从周级缩短至天级。

第六章:多端统一新纪元(2022 - 至今):NT架构,一次编写全端运行

6.1 业务背景

- 2022年:PC/Android/iOS/macOS/Linux多端并行开发,维护成本极高,新功能同步缓慢。

- 2023年:推出QQ NT架构(New Technology),基于Electron实现跨平台统一。

- 2024年:NT架构全面普及,支持模块化插件、AI辅助功能。

- 核心诉求:解决多端开发重复劳动问题,实现全端体验一致,提升研发效率,支撑未来功能扩展。

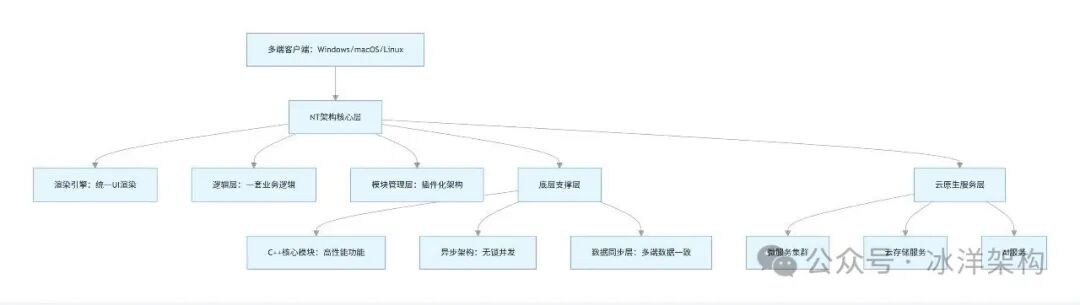

6.2 核心架构终极升级

核心架构特征:跨平台统一 + 模块化 + 异步架构。

关键技术突破:

- 跨平台统一:基于Electron技术栈,实现一套代码在Windows、macOS、Linux多端运行。

- 模块化设计:拆分为100+个业务模块,支持插件化加载,可按需启用功能。

- 异步架构:采用异步调用替代传统的线程锁,降低死锁风险,提升并发性能。

- 性能优化:关键功能(如消息处理)使用C++原生实现,在跨平台便利性与核心性能之间取得平衡。

6.3 核心业务痛点→技术挑战→解决方案

| 业务痛点 |

技术挑战 |

解决方案 |

| 多端代码重复开发,维护成本高,新功能同步慢 |

多端技术栈不统一,代码复用率低 |

基于Electron实现跨平台统一,一套逻辑多端复用,开发效率提升60% |

| 传统架构卡顿臃肿,内存占用高 |

线程锁导致并发性能差,资源消耗大 |

采用异步架构,减少线程锁使用;优化进程管理,将典型聊天场景内存占用压至300MB内 |

| 多端数据同步不一致,体验碎片化 |

各端存储逻辑不同,同步机制复杂 |

设计统一数据同步层,基于云服务实现多端数据实时一致,同步延迟≤1秒 |

| 未来功能扩展困难,新特性接入成本高 |

架构耦合严重,模块依赖复杂 |

采用插件化+模块化设计,新功能以插件形式接入,不影响核心架构;支持热更新 |

6.4 关键技术细节

- NT架构组成:Electron提供跨平台能力,C++实现核心高性能模块(如音视频、加密),异步架构保障并发性能,模块化设计支持功能灵活扩展。

- 性能优化措施:安装包从210MB成功瘦身至150MB;优化了窗口进程的创建与销毁机制;禁用非核心功能可进一步降低内存占用。

- 兼容性保障:在保留传统功能的同时,支持新特性快速迭代,确保老用户能够平滑过渡。

6.5 阶段成果

- 多端开发与维护成本降低60%,新功能全端同步上线的周期从1个月缩短至1周。

- 全端体验一致性显著提升,跨平台功能同步率达到100%。

- 模块化设计为AI辅助、插件扩展等未来新功能的接入预留了充分空间。

第七章:QQ架构演进的核心规律与技术启示

7.1 四大核心设计思想

- 业务驱动的“问题导向”迭代:每一次架构升级都精准对应一个核心业务痛点。

- UDP协议 → 解决带宽稀缺问题

- 分层拆分 → 解决并发增长问题

- 内存架构 → 解决偷菜洪峰问题

- 弱网优化 → 解决移动化问题

- 云原生 → 解决迭代效率问题

- NT架构 → 解决多端统一问题

- 技术选型“顺势而为”:不盲目追求最新技术,而是选择最适配当前业务场景的方案(如早期的UDP,后期的云原生)。

- 极致优化用户体验:从带宽、延迟、流量、电量等细节入手,针对性解决用户核心痛点。

- 稳定性优先于创新:核心业务(如消息收发)始终保持高可用,新功能通过灰度发布等方式逐步验证。

7.2 关键技术启示

- IM系统架构演进的本质:是跟随用户规模与使用场景的扩展,从“集中式”向“分布式”再向“云原生”逐步升级的过程,核心始终围绕解决高并发、高可用、高扩展性三大问题。

- 弱网优化的核心方法论:动态适配(心跳、协议)+ 补偿机制(重传、缓冲)+ 资源优化(流量、电量),这套方法论可复用于绝大多数移动互联网应用。

- 跨平台架构的取舍:NT架构证明,“跨平台”与“性能”并非不可兼得,可以通过“核心功能原生实现 + 非核心功能跨平台”的策略来平衡,避免单一技术栈的局限性。

- 上云迁移的关键:分阶段迁移 + 数据一致性保障 + 网络冗余,对于大型应用而言,上云需要兼顾稳定性与效率,不可一蹴而就。

7.3 架构演进的普适规律

核心逻辑:用户规模决定架构复杂度,业务场景决定技术选型,技术演进必须与业务发展同频共振。

总结

QQ过去25年的架构演进,是中国互联网技术发展的一个缩影。从1999年的UDP单体服务,到2024年的NT云原生架构,QQ始终以“解决业务痛点”为核心驱动力,通过六次关键的技术跃迁,成功应对了从万级到亿级的并发挑战、从PC到移动的场景切换、从单一功能到多元生态的业务扩张。

其成功的关键在于:一是始终坚持“业务驱动技术”,杜绝为技术而技术的盲目升级;二是在关键节点敢于进行大规模重构,从分层拆分到全量上云,每一次架构升级都为未来的业务增长打开了空间;三是巧妙平衡短期需求与长期发展,在保障当前系统稳定的同时,为未来的扩展预留了能力。

对于广大开发者而言,QQ的演进历程提供了一个近乎完整的IM系统架构参考模型:初创期追求“极简可用”,成长期聚焦“高并发扩展”,成熟期注重“稳定高效”,创新期拥抱“生态兼容”。这种“循序渐进、问题导向”的架构演进思路,值得所有追求长期发展的互联网应用深思与借鉴。如果你对这类深度技术解析和架构演进话题感兴趣,欢迎到 云栈社区 与更多开发者交流探讨。 |