上一篇文章发表后,不少读者对“麦肯锡”这个标签表达了不喜。然而,企业的战略问题总是客观存在,也需要被丈量和解决——无论是通过管理咨询公司、内部顾问,还是未来的“麦肯锡 Agent”。

在我看来,麦肯锡 Agent 可能是未来 B2B 软件领域最大的变数。它与当前面向查询、任务和工作流的 Agent 不同,其愿景是直面商业与战略问题,并以超越麦肯锡初级顾问水准的 Problem Solving 能力,提供切实可行的解决方案。

如果有人问我如何打造麦肯锡 Agent?我的第一反应是:“100% 复刻麦肯锡顾问的‘探图’能力。”

何为“探图”?

许多人认为管理咨询不过是企业高管雇来的“一杆枪”。但无论客户出于何种目的——例如“支撑不受欢迎的决定”、“将内部矛盾外化”,甚至是为可能的失败预留“脱罪”理由——顾问最终构建的叙事,都必须由一个定性、定量的强逻辑体系来支撑。

正如李飞飞教授将代表、模拟和诠释物理世界运转的体系称为“Large World Models”;我们也可以将这个代表特定商业领域的强逻辑体系称为 World Model。

理想的 World Model 是事实及其支撑逻辑的完整合集。但在现实中,它往往是隐性且碎片化的:事实散布于各类数据、报告和专家的头脑中。顾问的核心工作“探图”,就是从这些碎片化的事实中,用逻辑确认通往问题答案的正确路径。

例如,假设我们将下述问题抛给顾问:

“如何扭转某大型连锁超市的利润下降?”

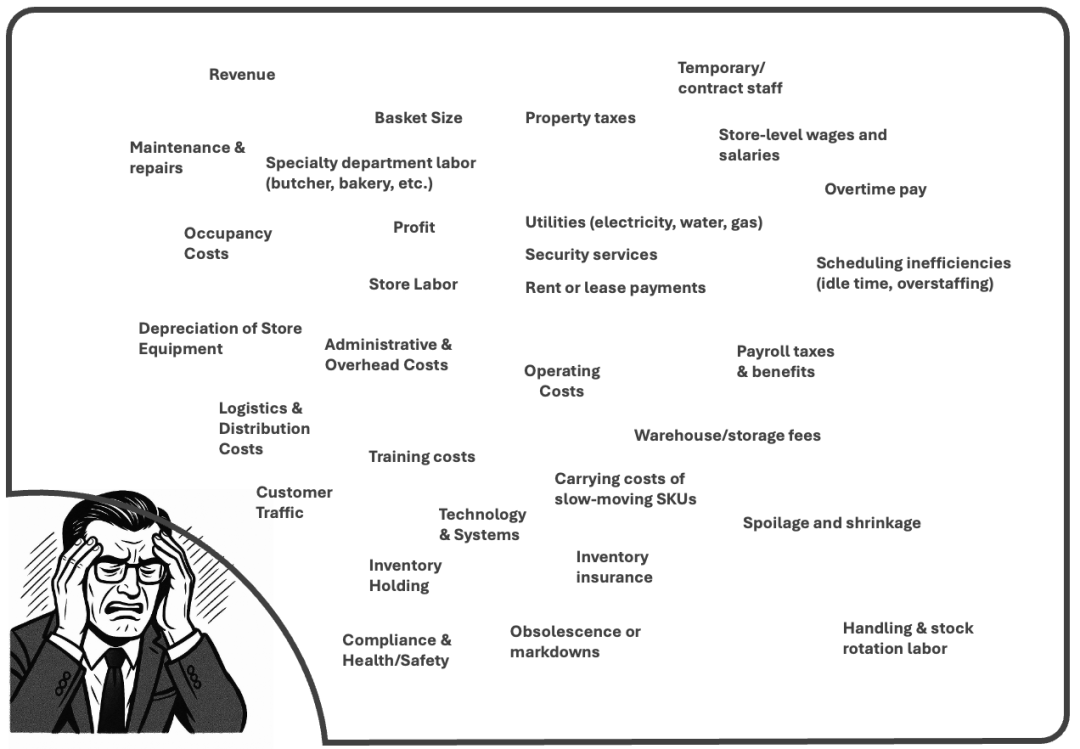

在项目开始时,顾问面对的是一家零售连锁企业横跨多个业务单元、涉及成百上千条营收与成本线的复杂业务指标海洋(图1)。

图1: 复杂、碎片化的业务指标

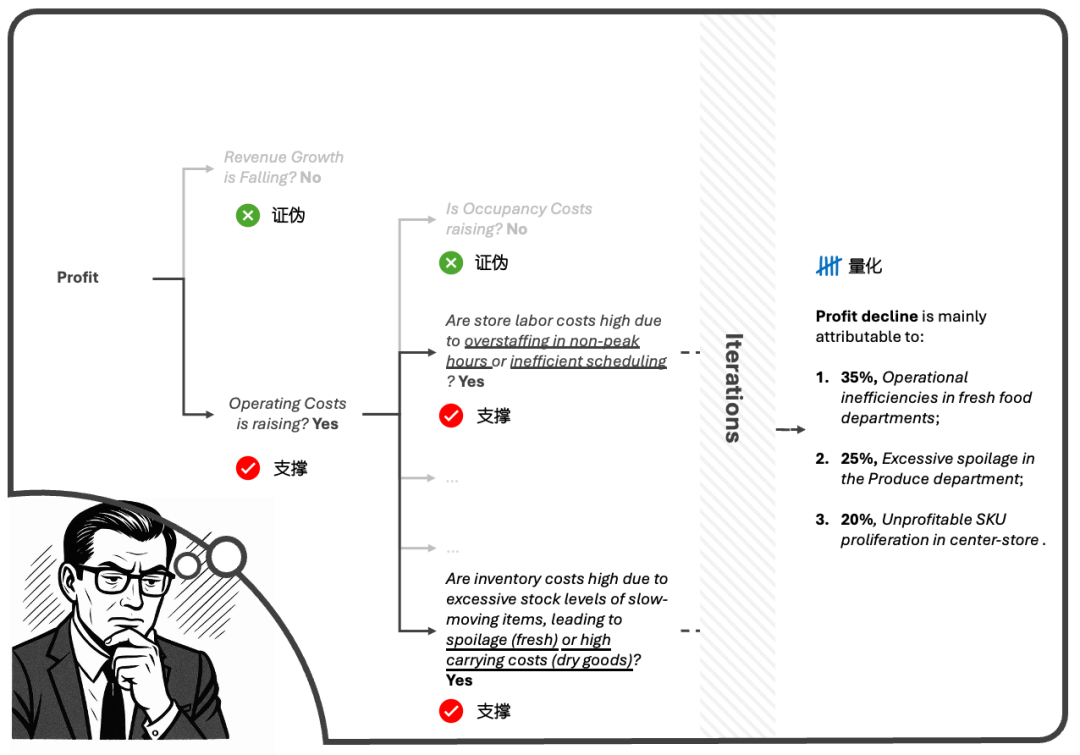

受限于项目成本、资源和复杂度,顾问无法等待所有指标都清晰后再统一求解。他们采用的是一种“探图”式策略(图2):

- 首先,凭借先验知识勾勒出一个由多种假设(Hypothesis)构成的“路线图”。

- 随后,以“利润率”为目标起点,基于实时发现的事实,运用逻辑对路线图进行动态剪裁:逐步剥离无关假设(证伪)、拓展可行假设(支撑),并不断量化各个假设的影响(量化ROI),直到锁定最终的最优路径。

图2: 顾问的“探图”式路线图剪裁过程

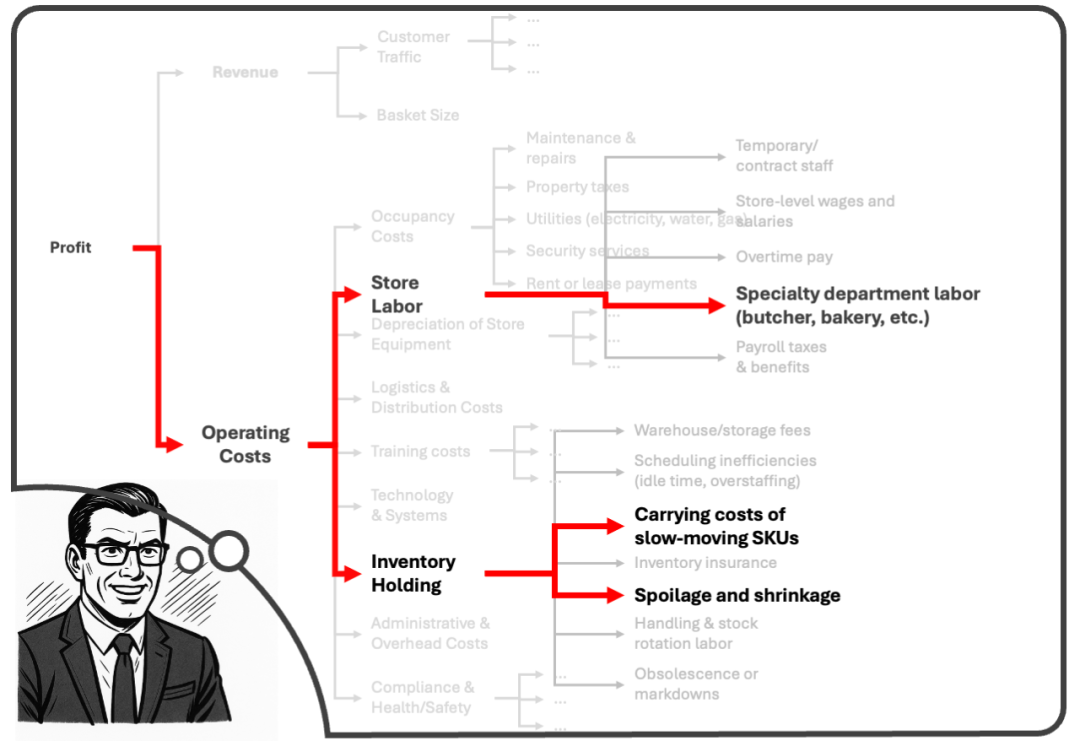

“探图”成功后,不仅利润提升的最优路径被找到,一个包含必要事实及其支撑逻辑的 World Model 切片也已在顾问脑中确立。虽然这只是全部事实的一个“切片”,且最终汇报时还需权衡收益周期、实施难度甚至办公室政治等因素,但这个定性定量的逻辑切片,已足以强力支撑顾问的最终叙事(图3)。

图3: 基于“探图”结果形成的 World Model 副本(利润下滑的因果结构)

那么,我们应该如何复刻顾问的这种“探图”能力?

一个关键的“悖论”

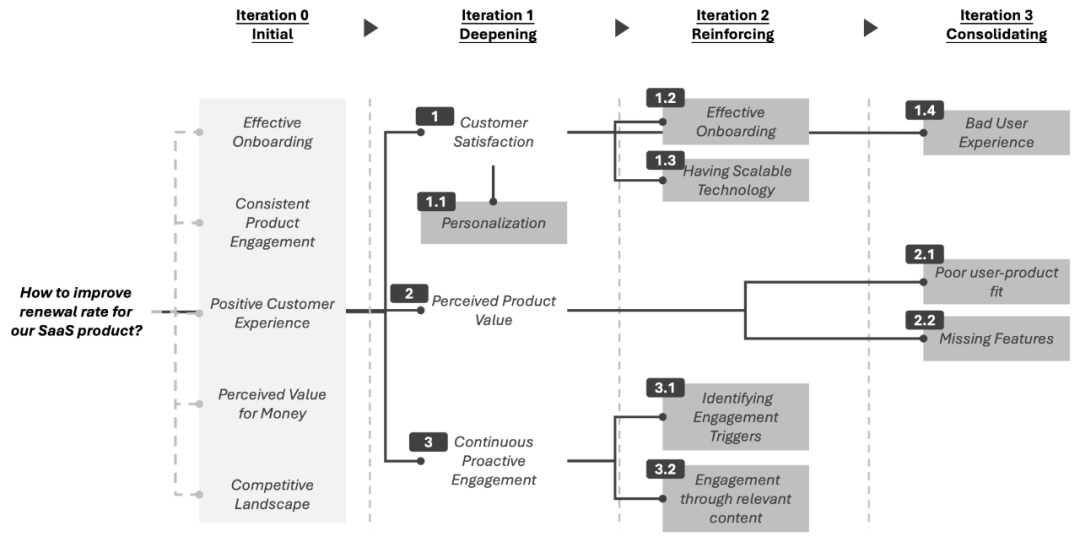

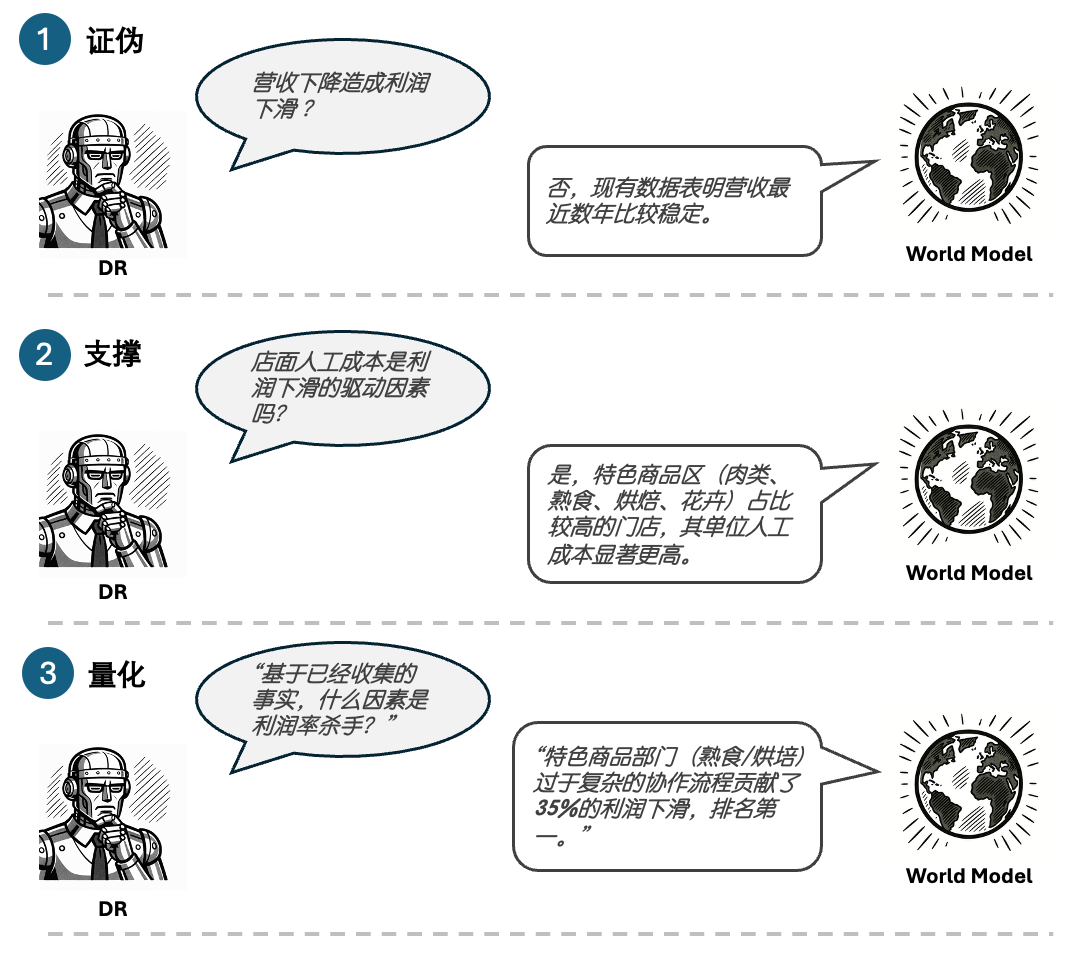

当前,最形似顾问工作的莫过于各大厂推出的深度研究(Deep Research,DR)功能。例如,Gemini Deep Research 能展示一个看似完整的迭代过程:为议题设置明确的迭代轨迹,有意识地保持主线,并在每次迭代中实现假设的分解与细化(图4)。

图4:Gemini Deep Research 生成的迭代框架(实验截图)

但是,DR 本身并不具备用事实与逻辑去支撑、证伪或量化假设的能力,其当前的“探图”能力基本为零。

因此,一个很自然的想法是:打造一个类似于“切片”的 World Model,与 DR 构成“生成器-验证器”(Generator-Verifier)模式(图5):

- DR(生成器):利用其先验知识生成假设。

- World Model(验证器):基于事实和数据,对这些假设进行支撑、证伪或量化。

图5:设想的 Generator-Verifier 协作模式

然而,悖论由此产生:World Model 之所以能充当“验证器”,是因为它内部必然已经蕴含了标准答案(即最优路径)。 如果我们可以直接从 World Model 中得到最优路径,那“探图”过程还有什么必要呢?此时的 World Model 可谓是“地图全开”,复刻顾问的探图能力反而不再必要。

所以,如果现在再问我如何打造麦肯锡 Agent?经过仔细考量,我的答案是:

“构建一个‘地图全开’的 World Model。”

如何实现“地图全开”?

在可能实现“地图全开”的技术路线中,因果分析(Causal AI) 是一个极具潜力的选项。

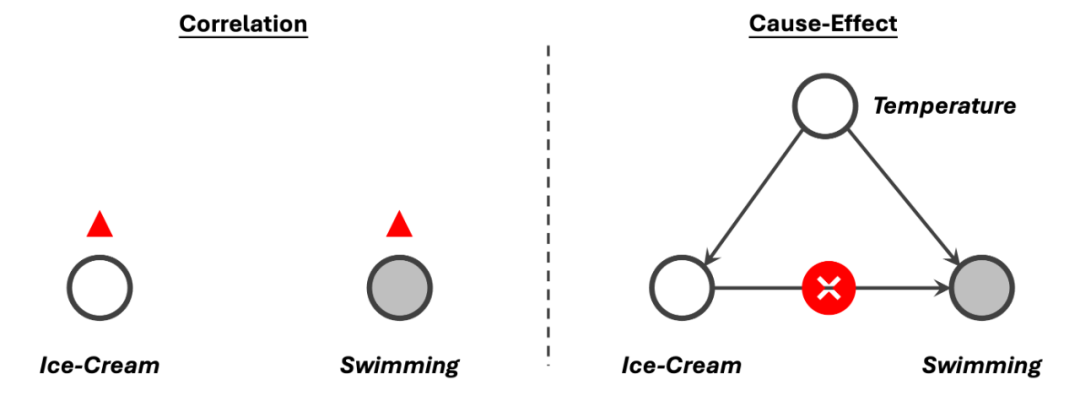

许多时候,顾问不得不利用相关性来支撑叙事,但相关性并非强逻辑。例如,夏天吃冰淇淋和游泳人数同时上升,这是相关性;但真正的驱动因素是温度,而非吃冰淇淋。只有因果关系才能拨开相关性的迷雾,找到并量化事件的真实驱动因素(图7)。

图7:相关性与因果关系的本质区别

同样,像最大化对数似然或强化学习这类基于统计拟合的方法,并不擅长表达“收入不变、成本上升必然导致利润下降”这类确定性逻辑。

因此,虽然 Causal AI 长期活在深度学习和强化学习的阴影下,但在一众依赖相关性、似然度和相似度的技术中,能够进行定性、定量分析的 Causal AI,是代表强逻辑体系的不二之选。

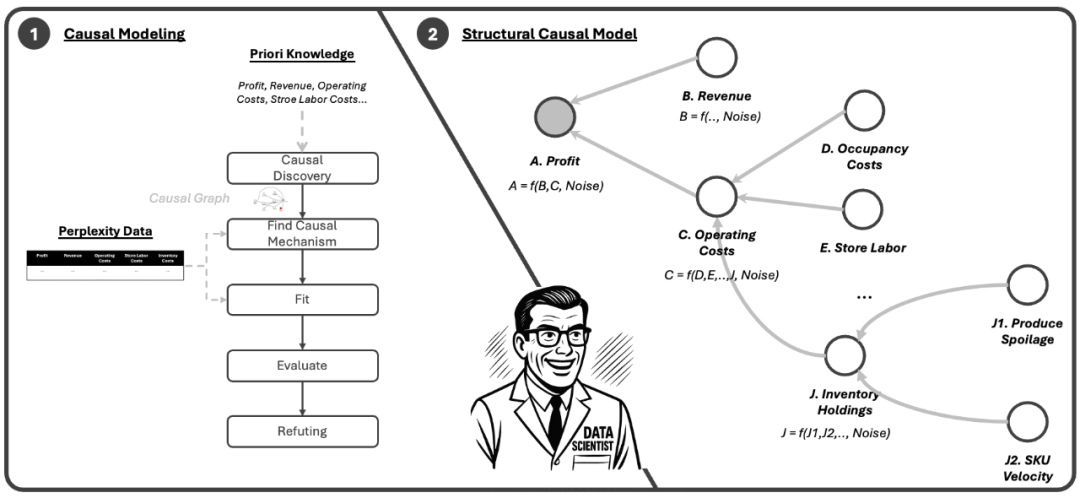

此外,业界已经开发了一整套基于因果分析构建 World Model 的工具链。以利润率问题为例,人类专家可以结合先验知识、私有数据以及 Causal-learn、DoWhy 等工具,构建一个具有统计学意义的“利润率 World Model”(图8)。

图8:从因果建模到结构因果模型的构建过程

而归因分析与ROI预测的组合,可以直接在这个 World Model 中定位最优路径:

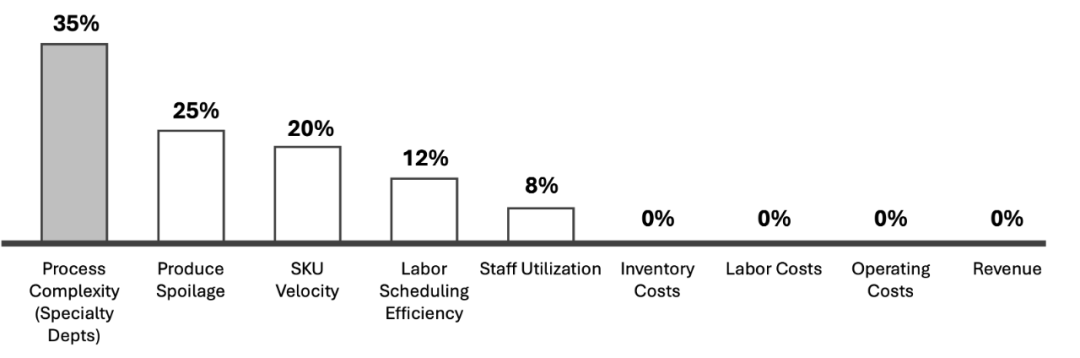

首先,归因分析。 Causal AI 的归因机制可以“量化多因素对目标变化的贡献度”,从而直接定位问题的“病根”。例如,分析可能显示:“特色商品部门(熟食/烘焙)过于复杂的协作流程”贡献了 35% 的利润率下滑,排名第一(图9)。

图9:对利润率下滑问题的归因分析结果

其次,ROI预测。 Causal AI 的干预机制可以回答:“如果我们改变 X,Y 会如何变化?”,从而量化解决“病根”带来的价值。例如,它可能产生如下预测:

“如果我们每季度对滞销品(后20%的低周转SKU)进行优化清理,可降低库存持有成本 10–15%,同时对毛利率产生2–3%的积极提升。”

Causal AI 确保了 World Model 的‘地图全开’,而‘地图全开’的 World Model 正是麦肯锡 Agent 的本质。 那么,抓住了本质,麦肯锡 Agent 是否就唾手可得了?

这里至少还有两个关键难点。

两大核心难点

第一,World Model 的构建。 Causal AI 在商业领域长期进展缓慢,主要原因是因果建模过程非常依赖于人类专家的知识和干预,难以完全自动化。

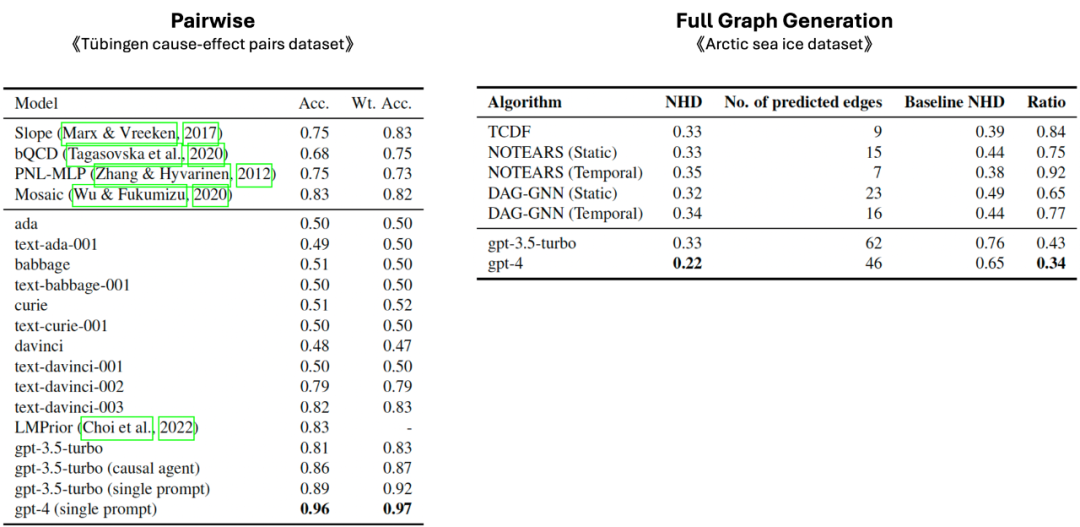

幸运的是,利用大模型替代或辅助人类专家进行因果建模的研究已取得不错进展。例如,微软的论文《Causal Reasoning and Large Language Models》表明,大模型在“点对点”和“整图”级别的因果关系识别上,其准确率均超越了传统算法(图10)。

图10:使用大模型进行因果发现,准确率显著提升(数据来源于论文)

第二,最优路径的验证。 虽然传统管理咨询可以“对结果不负责”,但这建立在乙方顾问与甲方高管长期合作形成的信任与默契之上。不具备这种“羁绊”的 Agent,恐怕没有“管杀不管埋”的特权。

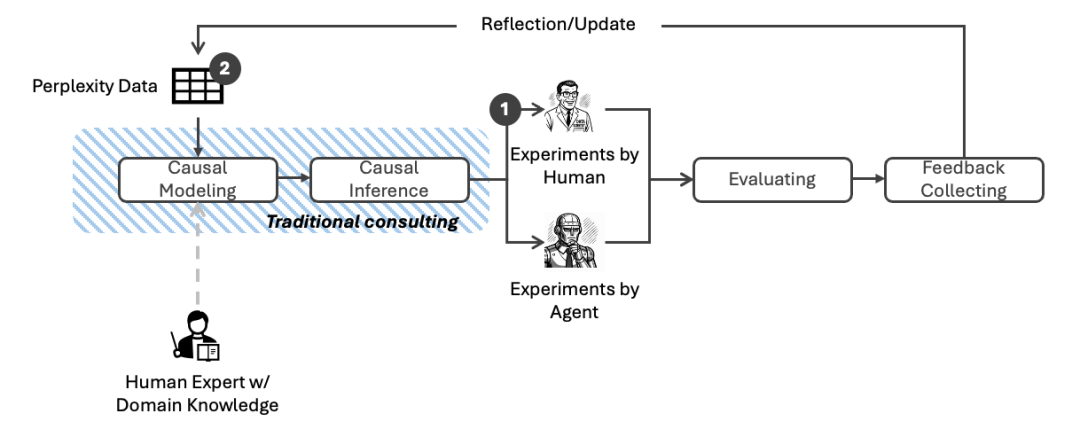

因此,相较于交完报告就离开的顾问,麦肯锡 Agent 最好能通过一个自我演进与纠错的闭环,来验证其选择的最优路径。在这个闭环中,两项能力尤为关键(图11):

- 能够设计并启动实验以验证最优路径:这些实验基于随机对照试验或 A/B 测试理论,可由人类专家或其他 Agent 执行。

- 能够利用实验结果反馈,持续优化和迭代 World Model 对问题的理解。

图11:设想的“麦肯锡Agent”自我演进与纠偏闭环

结语

当然,受篇幅所限,关于麦肯锡 Agent 的具体实现细节,我们未来再展开探讨。

我想强调的是,当整个业界都在为大模型与强化学习的结合而兴奋时,特定领域(如商业战略)的底层逻辑,却很难被现有主流技术路线完美描述。在各类编码助手之外,实现麦肯锡顾问级别的 Problem Solving 能力,仍是一片广阔的空白地带。

在 B2B 领域所要求的严谨性面前,我们需要一套真正的强逻辑体系。因果 AI,或许是一条值得探索的路径。

技术的进步离不开交流与碰撞,欢迎在 云栈社区 与更多开发者一同探讨 Agent 与因果 AI 的无限可能。