随着Stable Diffusion、Midjourney、Sora等模型的飞速进化,AI生成的图像已达到以假乱真的程度。你在社交媒体上看到的任何一张令人震惊的“新闻图片”,都有可能是凭空捏造的。更棘手的是,现实世界中的图片并非实验室里的“标准样品”,它们会经历裁剪、压缩、加滤镜、打水印等各式各样的“易容术”。一个只能在干净图片上工作的检测器,一到野外便会“失明”。

在刚结束的CVPR 2026上,一场名为“NTIRE 2026挑战赛:野外鲁棒AI生成图像检测”的竞赛,吸引了全球511支队伍的参与。这场竞赛不仅建立了一个全新的高难度评测基准,更汇聚了蚂蚁集团、中国电信、合合信息等顶尖工业界团队的实战智慧,为我们揭示了当前AI生成图像检测技术的极限与未来方向。接下来,我们就来深入拆解这份“战地报告”。

史上最严苛的“真假”考场:25万张图与36般变化

要训练出“火眼金睛”,必须先有海量的“真假样本”供其学习。本次挑战赛的组织者构建了一个堪称史上最全面、最严苛的数据集。

- 海量且高质量的真假图库:整个数据集包含约29.5万张图像,其中真实图像10.8万张,AI生成图像18.6万张。生成图像来源于42种不同的文本生成图像模型,涵盖了从2022年到2026年发布的主流开源与闭源模型(如Stable Diffusion系列、Flux、Qwen-Image等)。

- 精心设计的“易容术”管道:这是本次挑战赛的核心。为了模拟真实世界的复杂情况,组织者设计了一套包含36种不同类型的图像变换流程。这不仅仅是加噪声那么简单,而是从基础操作(高斯模糊、JPEG压缩)到进阶干扰(运动模糊、有机摩尔纹),甚至包含了“魔法攻击”——如不可见水印、神经网络压缩以及专门擦除水印的对抗性攻击。测试时,一张图片可能会被随机施加1到5种连续变换,强度随机,堪称“视觉搅拌机”。

- 评估指标:鲁棒性至上:挑战赛设定了两个核心指标:

- 干净ROC AUC:评估模型在未处理的原图上的检测能力。

- 鲁棒ROC AUC(主指标):评估模型在所有经过“易容术”处理后的图片上的表现。它直接回答核心问题:你的检测器在野外还好使吗?

在这种“地狱难度”下,最终有20支队伍提交了有效方案。其中,冠军团队MICV和亚军Ant International(蚂蚁集团) 的方案尤为亮眼,其思路高度一致,都围绕着三个核心:超大视觉基础模型、海量多样数据、以及巧妙的模型集成。

冠军方案揭秘:大模型集成与分层数据增强

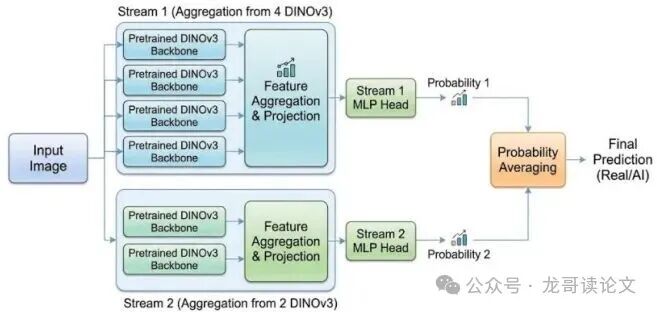

图1:MICV团队方案,基于DINOv3的双流检测框架。

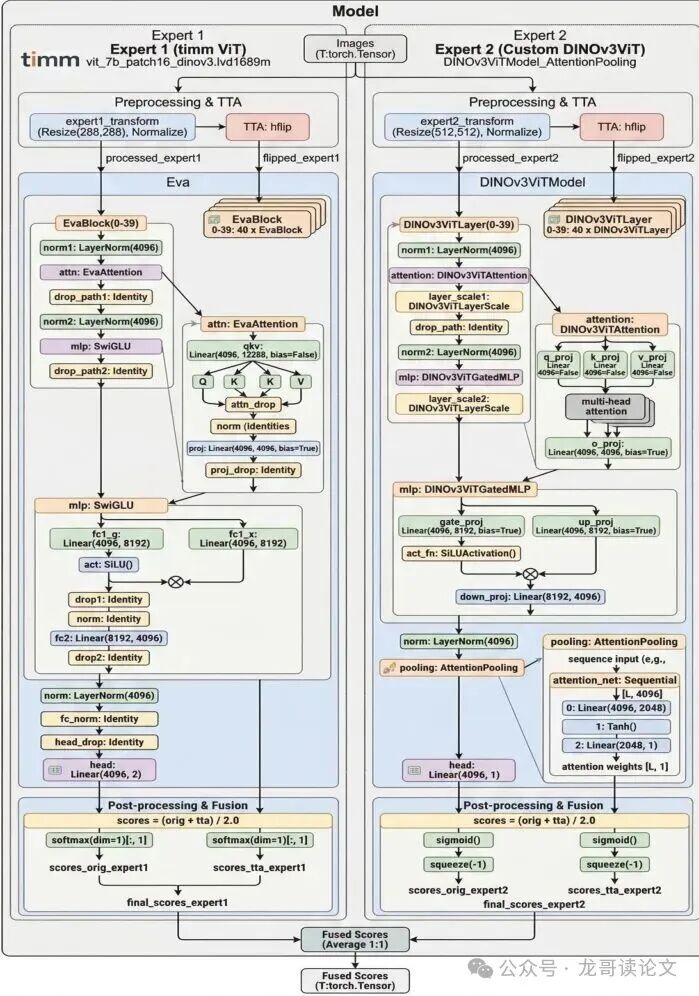

图2:Ant International(蚂蚁集团)团队的双专家模型方案。

1. 模型Backbone:越大越强

两支顶尖团队不约而同地选择了DINOv3作为核心特征提取器。DINOv3是Meta发布的通过自监督学习在大规模无标签数据上训练出的视觉基础模型,拥有强大的通用视觉表征能力。蚂蚁团队实验发现,模型越大(他们使用了DINOv3-7B,即70亿参数),输入分辨率越高,性能和对未知生成器的泛化能力就越强,再次验证了“大力出奇迹”在当前AI检测领域的有效性。

2. 数据策略:广纳开源与自建图库

仅靠官方数据不足以应对42种生成器和36种变换的组合。顶尖团队都进行了大规模数据扩充:整合GenImage、WildFake等开源数据集;使用最新开源T2I模型自生成数百万张图片;甚至调用商业API获取闭源模型的生成结果,以弥补数据分布的缺口。

3. 核心技巧:分层增强与专家集成

为了针对性提升鲁棒性,简单的数据增强不够看。蚂蚁团队设计了一个四层级离线增强管道:

- Level 1(干净):原图。

- Level 2(轻度):1-3种随机失真。

- Level 3(中度):3-6种随机失真。

- Level 4(重度):固定的6种高强度失真。

在此基础上,他们训练了两个专家模型进行集成:

- 专家1(高分辨率专家):主要用中重度失真数据训练,输入分辨率512x512,专注于捕捉清晰细节及对应失真模式。

- 专家2(鲁棒性专家):使用全部四个级别的数据训练,输入分辨率较低(288x288),侧重于学习对失真不敏感的本质特征。

最终,两个专家的预测结果通过加权平均融合,取长补短。MICV团队也采用了类似的集成思路,使用了两个分别包含4个和2个DINOv3模型的“流”来提取并融合特征。

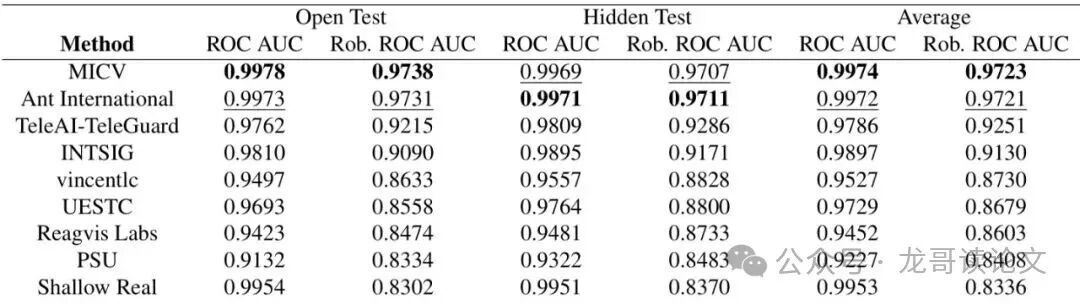

鲁棒性是关键分水岭:顶尖团队的实战效果

那么,这套组合拳的效果如何?官方发布的最终结果清晰地揭示了鲁棒性是区分顶尖高手与普通选手的关键分水岭。

表1:前9名团队的最终结果。最终排名由两个测试集的平均鲁棒ROC-AUC决定。

实验结果分析:

- “干净”环境下,众强林立:在“ROC AUC”列,几乎所有团队得分都超过0.94,冠亚军更是达到了惊人的0.997以上。这意味着,对于未经处理的“完美赝品”,现代检测器几乎能一眼看穿。

- “野外”环境下,差距立现:在“Rob. ROC AUC”列,情况急转直下。冠亚军依然保持0.972左右的超高水准,但从第三名开始,鲁棒性得分明显下滑。第九名的鲁棒性得分(0.8336)比其干净得分(0.9953)下降了超过16个百分点。这就像一场考试,大家基础题都满分,但高难度综合题立刻拉开了差距。

这说明,顶尖团队的“大模型+海量分层增强+专家集成”策略,对于提升模型在极端失真下的稳定性至关重要。他们不仅学得“精”,更学得“杂”,抗干扰能力极强。

其他亮点方案:LoRA成对训练与工程化融合

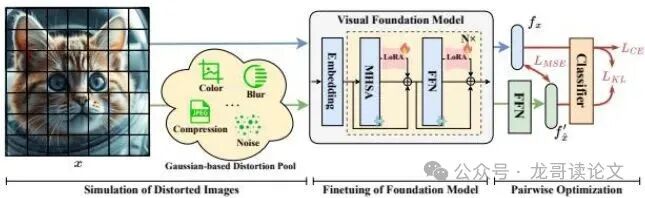

季军TeleAI-TeleGuard(中国电信) 的方案也颇具特色,他们提出了一个基于LoRA的成对训练策略。

图3:TeleAI-TeleGuard团队的LPT策略流程,包括失真模拟、基础模型微调和成对优化。

其核心思想是:在训练时,同时输入一张干净图片和它对应的失真版本。模型不仅要完成分类任务,还要通过额外的损失函数,让失真图片的特征向干净图片的特征对齐。这样做的好处是,既提升了鲁棒性,又避免了模型因过度关注失真模式而损害其在干净图片上的性能。其损失函数设计如下:

$$\mathcal{L} = \mathcal{L}_{CE}(x, y) + \alpha \cdot \mathcal{L}_{KL}(x, \hat{x}) + \beta \cdot \mathcal{L}_{MSE}(f_x, f'_x)$$

其中,$\mathcal{L}_{CE}$ 是标准的分类交叉熵损失,$\mathcal{L}_{KL}$ 用于拉近干净样本与失真样本的输出分布,$\mathcal{L}_{MSE}$ 则促使失真样本的特征 $f'_x$(经过一个矫正网络后)接近干净样本的特征 $f_x$。$\alpha$ 和 $\beta$ 是平衡系数。

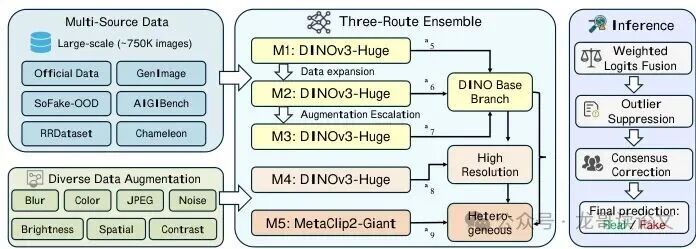

第四名INTSIG(合合信息) 则展现了极强的工程化与策略融合能力。他们训练了5个不同特点的模型(不同分辨率、数据、Backbone如DINOv3、MetaCLIP2),然后设计了一套复杂的加权分层融合与异常值修正规则进行集成。

图4:INTSIG团队的多源数据融合与三路集成模型架构。

在推理优化上,他们甚至考虑了CUDA流并行、混合精度计算(AMP)、异步I/O等细节,堪称工业级部署的典范。

挑战远未结束:局限性与未来展望

尽管冠军方案在鲁棒性上取得了接近0.97的AUC值,但这绝不意味着问题已经解决。这场挑战赛更像是一次对现有技术边界的压力测试,暴露了当前技术的局限性。

- 成本与效率困境:顶尖方案严重依赖数十亿参数的大模型和复杂集成。蚂蚁团队报告显示,其双专家模型需要约78GB显存,在A100上每秒仅能处理约2张图片。这距离社交媒体实时、大规模检测的需求相去甚远。

- 动态对抗的挑战:竞赛中的变换管道是已知且固定的。现实中,恶意用户可能使用未知的、针对性更强的攻击手段。检测器能否应对这种动态的、对抗性的环境,仍是巨大问号。

- 可解释性与可信度:即使模型判断为“假”,也难以像人类专家一样指出“假在哪里”(如纹理异常、光影矛盾)。缺乏可解释性,会降低其在司法、新闻审核等严肃场景下的可信度。

未来方向展望:

- 轻量化与效率优化:研究通过知识蒸馏、模型剪枝、设计专用高效网络结构,在保持高性能的同时大幅降低成本。

- 主动防御与动态更新:检测系统可能需要具备在线学习或快速适应新威胁的能力,形成“检测-分析-更新”的闭环。

- 多模态与溯源结合:结合文本上下文、发布者信息等多模态线索进行综合判断,并与被动取证(检测模型指纹)、主动溯源(稳健水印)技术形成互补。

核心概念解答

- 这篇论文主要解决了什么问题?

论文总结了NTIRE 2026竞赛,核心是解决AI生成图像在现实世界中的鲁棒检测问题。它不仅关注模型识别“干净”假图的能力,更关键的是评估图片被各种处理后,检测器是否还能保持高精度。

- ROC AUC是什么?为什么用它做指标?

ROC AUC(受试者工作特征曲线下面积)是衡量二分类模型整体排序能力的指标,值越接近1越好。相比准确率,它不依赖于具体分类阈值,直接评估模型将真样本排在假样本前面的能力,对输出置信度得分的任务更公平稳定。

- 什么是“鲁棒性”?

鲁棒性即系统的“抗干扰能力”。在本文中,特指AI生成图像检测模型对图像进行各种后天变换(如压缩、模糊、水印)的抵抗力。本文通过36种变换流水线量化衡量此能力,并将“鲁棒ROC AUC”作为首要评判标准。

启示与总结

这场高规格挑战赛给我们的研究和工程实践提供了宝贵范本:

- 问题定义要击中痛点:不满足于在理想数据上刷高分,而是直击“现实世界鲁棒性”这一业界真痛点。

- 数据构建即巨大贡献:一个精心设计、规模庞大、难度适中的基准数据集,其影响力可能超过单个算法改进。

- 工程与策略的价值:在模型结构趋于同质化(均采用大预训练模型)的当下,通过精巧的数据策略、增强技巧、集成方法和工程优化来拉开性能差距,成为了获胜的关键。这提醒我们,优秀的研究与解决方案也可以是系统性的工程智慧结晶。

当前,以DINOv3为代表的视觉基础模型和针对性的数据增强策略,是提升AI生成图像检测鲁棒性的有效路径,但高昂的计算成本仍是其走向大规模应用的拦路虎。未来,效率与性能的平衡将成为该领域的重要攻关方向。对这类前沿的计算机视觉与AIGC安全话题感兴趣,欢迎在云栈社区的开发者广场继续交流探讨。