今年年初,市场上就已经开始热议“CPU回归”的逻辑了。这波讨论的核心驱动力,是AI智能体的兴起。智能体应用对CPU的需求激增,一度导致CPU价格上涨。不过,当时国内云服务提供商(CSP)的CPU整体利用率并不算太高,价格涨幅也相对温和。

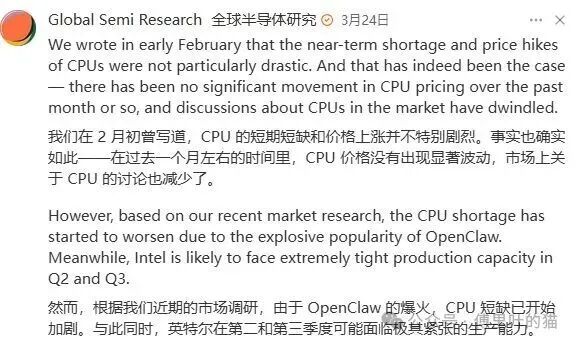

然而,随着OpenClaw以及其他各类AI智能体的广泛应用,情况正在发生显著变化。CPU短缺的问题已经开始加剧。

客户们正在疯狂采购CPU,以至于英特尔不得不将原本分配给个人电脑(PC)的产能紧急调配到服务器芯片产线上,甚至提高了2026年的资本开支计划。自2023年ChatGPT发布以来,整个行业的资金几乎都涌向了GPU,CPU市场基本处于平稳状态。如今,风向突然转变了。

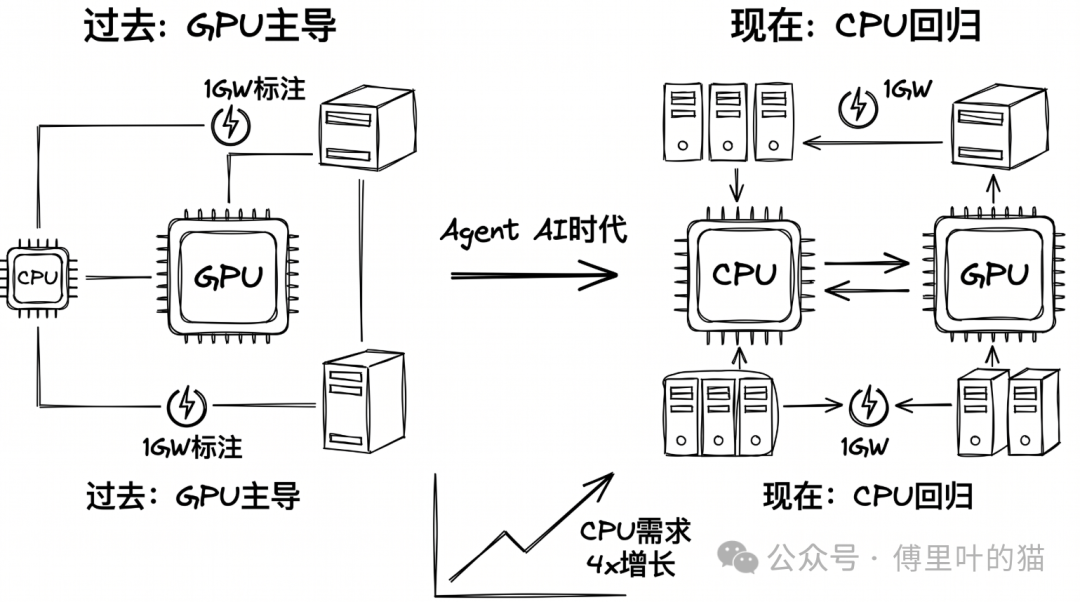

早期的AI应用模式非常简单:用户提出一个问题,模型直接给出一个答案。这个过程主要依赖GPU进行大规模的矩阵运算,CPU的任务只是把数据喂给GPU,然后再把结果传回来。因此,在那个阶段,一个CPU可以轻松服务8个甚至12个GPU,CPU的需求自然上不去。

但智能体AI不再仅仅是“回答问题”,而是要“执行任务”。

举个例子:你让AI帮你规划一次旅行。它需要先搜索目的地信息,然后查询航班,对比酒店价格,查看天气预报,可能还要调用你的日历查看空闲时间,最后综合所有这些信息给你一个完整的方案。

在这个过程中,GPU只负责理解你的初始需求和生成最终的文字回复。真正耗时的是中间那些“跑腿”的工作:调用搜索API、查询数据库、处理返回的异构数据、协调不同的子任务……这些恰恰都是CPU的职责所在。

在这类智能体任务中,CPU侧的处理时间可以占到整个流程的50%到90%。换句话说,瓶颈已经从GPU的计算能力,转移到了CPU的协调与调度能力上。

数据中心的配置正在重构

这种变化直接体现在了硬件配置上。

以前,一个数据中心如果拥有1GW的供电能力,可能会配置大约3000万个CPU核心。现在,为了支持智能体应用,这个数字需要增长到1.2亿——整整翻了4倍。

更直观的例子是微软为OpenAI建设的“Fairwater”数据中心:295MW的功率分配给GPU,48MW分配给CPU。这意味着每6瓦的GPU功率,就需要1瓦的CPU功率来支撑。而在传统的AI训练场景里,这个比例可能是20:1甚至更高。

英伟达最新的Rubin架构设计更为夸张:CPU和GPU的配比从之前的1:12变成了1:2,有些配置甚至是2:1。也就是说,未来的AI服务器里,CPU的数量可能比GPU还要多。

CPU需求的增长不只是“多买几块”这么简单,对CPU的类型也提出了新的要求。

现在数据中心里的CPU开始分化成两类:

一类是“管家型”CPU,专门负责照顾GPU。它需要高性能、大缓存、高带宽,确保GPU不会因为等待数据而闲置。英伟达专门为此设计了Vera CPU,AMD的Venice也是这个定位。这类CPU通常是1个配2到4个GPU。

另一类是“干活型”CPU,专门用来运行那些智能体的协调任务。它不需要特别高的单核性能,但要核心数多、功耗低、吞吐量大。AWS的Graviton、微软的Cobalt都属于这一类。

这种分化背后,是AI应用场景的多样化。训练模型需要前者,服务用户需要后者,而且后者的需求增长显然更快。

强化学习

除了智能体,还有一个被很多人忽视的需求来源:强化学习。

现在的大模型训练,越来越依赖强化学习来提升输出质量。但强化学习有个特点:模型生成一个动作(或输出)后,需要有一个“环境”来执行这个动作,然后给出反馈,告诉模型做得对不对。

这个“环境”就需要大量的CPU来模拟。比如训练一个编程模型,它生成一段代码后,你得用CPU去编译、运行、测试,看结果是否正确。训练一个物理模拟模型,你得用CPU跑复杂的物理计算。

微软那个48MW的CPU集群,很大一部分就是干这个的。而且随着模型越来越复杂,这部分需求还在快速增长。未来一代的GPU可能需要更高的CPU功率配比,因为GPU的性能提升速度远快于CPU。

竞争格局在重塑

CPU市场重新热闹起来,各家的策略也开始分化。

AMD:目前势头最猛。它的EPYC处理器本来就在数据中心市场占据优势,现在又拥有完整的GPU产品线(MI300、MI450),可以实现CPU、GPU、网络芯片的全栈优化。今年下半年要推出的Helios机架系统,就是把这些组件整合在一起,直接销售整套方案。这种垂直整合的打法,在功耗受限的数据中心里很有优势。

Intel:它的企业客户基础依然存在,但在AI数据中心这块一直没找到最佳节奏。不过最近的需求爆发给了它机会,关键看其能否抓住。

Arm:它推出了专门针对智能体优化的AGI处理器,号称能效比是传统CPU的两倍。Meta已经在进行测试,联想也宣布了合作意向。

但Arm面临三个挑战:

第一,它以前只卖架构授权,现在要自己做芯片、搞量产,这是完全不同的游戏。良率、供应链、客户验证,每一步都是挑战。

第二,它的很多客户本身就在用Arm架构设计自己的CPU,比如Ampere、AWS、微软。现在Arm自己下场做芯片,等于跟客户抢生意,这个生态关系很微妙。

第三,AMD和Intel肯定不会坐以待毙。它们完全可以推出功耗优化版的CPU来对标Arm,而且它们拥有更成熟的生产体系和客户关系。

所以短期内(2-3年),Arm很难撼动现有格局。但如果它真的做出来了,对整个市场会是个不小的冲击。

至于大家最关心的国内公司,目前国内的AI服务器(以8卡机为主)中,CPU基本还都是AMD或Intel的产品。虽然阿里云也采购了不少国产CPU,但主要还是用于信创领域,与这波Agent AI带来的需求关系不大。不过,这波CPU紧缺的浪潮,确实给了国产CPU一个难得的机会,就看他们能否抓住了。

对AI算力架构的演变和行业趋势感兴趣?欢迎到云栈社区的讨论区分享你的见解。