你用过的每个 AI 智能体都有同一个问题。你周一教了它一些东西,到了周二它就全忘了。你又回到了起点,重新解释项目结构、你的偏好、整个工作流。就像每天早上都在培训一个新实习生。

Nous Research 打造了 Hermes Agent 来终结这个循环。

Hermes 是一个 开源 的、自托管的 AI 智能体,运行在你自己的服务器上,从它完成的每一个任务中学习,而且用得越久变得越好,这种提升是可衡量的。自 2026 年 2 月发布以来,它已经获得了超过 64,000 个 GitHub Star,并引发了开发者们所说的「迁移潮」——从之前占主导地位的开源智能体框架 OpenClaw 转向 Hermes。

有意思的部分不是采用数字。而是底层的架构,以及对任何想要一个「价值随时间累积而不是每次会话都归零」的 AI 的人来说意味着什么。

核心思想:一个会自己写操作手册的智能体

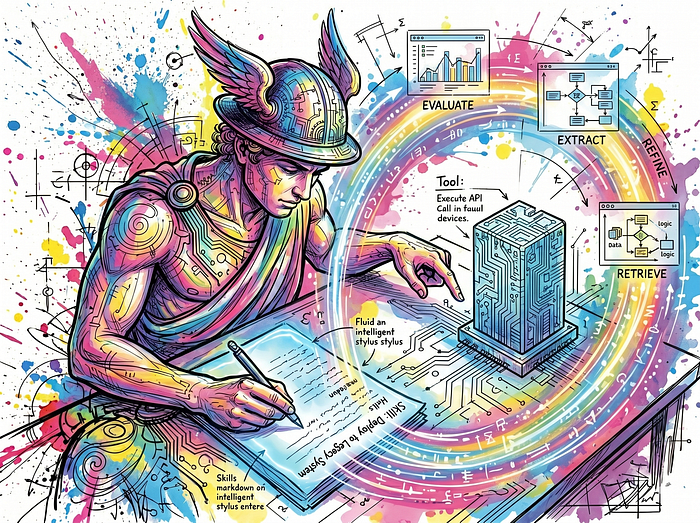

当 Hermes 成功完成一个任务时,它不只是记录结果然后继续。它会运行一次执行后评估,识别产生该结果的确切步骤序列、工具调用和推理过程,然后将这个序列编纂成一个可复用的「技能 ( Skill )」文档——一个 Markdown 文件,智能体下次遇到类似任务时会参考它。

这就是 Nous Research 所说的闭环学习循环 ( Closed Learning Loop ):执行、评估、提取、精炼、检索。而且它会累积。根据 Nous Research 发布的基准测试,使用自创技能的智能体完成研究任务比零提示调优 ( Prompt Tuning ) 的全新实例快 40%。

你在 5 美元 VPS 上跑了三个月的 Hermes 实例知道你的代码库、你的部署怪癖、你偏好的提交信息格式,以及那个针对你奇怪遗留集成 ( Legacy Integration ) 有效的精确 API 调用序列。全新安装的实例什么都不知道。

技能与工具:一个关键的区别

Hermes 在架构上对技能 ( Skill ) 和工具 ( Tool ) 做了严格区分,这比听起来重要得多。

工具 是通过 JSON 模式暴露给 AI 模型的 Python 函数。它们确定性执行。比如浏览器自动化、文件操作、流式处理。修改它们意味着编辑核心 Python 文件。

技能 是 Markdown 文档。智能体像读指令一样读取它们,并按照文档描述的流程自主执行。关键在于:智能体可以自己编写技能。不需要改代码,不需要人去编辑配置文件。智能体看着自己成功完成了某件事,写下它是怎么做到的,然后把这份知识存下来以备后用。

智能体在完全不触碰自身源代码的情况下变得更聪明。确定性工具层保持稳定和安全,知识层持续增长。

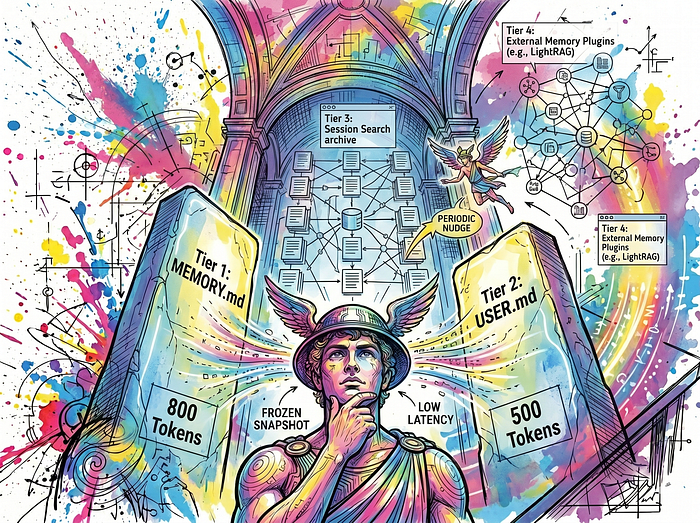

四层记忆系统

上下文太少,智能体会做出糟糕的决策。上下文太多,你会烧掉大量 Token,延迟飙升,模型开始遗忘埋在超长提示词里的指令。Hermes 用四层记忆来解决这个问题,按智能体需要信息的紧急程度分层。

第一层:智能体个人笔记 ( MEMORY.md ) 存储环境事实、项目约定和运维经验。它被限制在大约 800 个 Token,在会话开始时直接注入系统提示词。你可以把它理解为智能体的作弊小抄。

第二层:用户画像 ( USER.md ) 维护一个关于你的模型——你的技术水平、时区、沟通风格。大约 500 个 Token。同样在启动时注入。

第三层:会话搜索 将所有历史会话的所有内容归档到一个 SQLite 数据库中。智能体按需查询,使用全文搜索结合 LLM 摘要。深度历史上下文就存放在这里。

第四层:外部记忆插件 连接到基于图的检索系统 ( Graph-based Retrieval ),如 LightRAG、Supermemory 或自定义向量存储。对于企业级使用来说,这才是真正变得严肃的地方,支持跨复杂关系图的多跳查询 ( Multi-hop Query )。

前两层使用「冻结快照 ( Frozen Snapshot )」模式:变更会立即写入磁盘,但不会修改当前活跃的系统提示词,直到下一个会话开始。这保留了语言模型的前缀缓存 ( Prefix Cache ),在长会话中保持低延迟。在对话中途修改提示词会使缓存失效,导致推理速度骤降。

还有一个值得了解的「定期提醒 ( Periodic Nudge )」机制。Hermes 运行时不会被动等你告诉它保存重要信息,而是在空闲时刻主动提示智能体评估最近的交互,并在上下文窗口被填满、较早的对话轮次被压缩掉之前提取关键事实。智能体在这次显式刷新中没有标记的事实就不会存活下来。这是一种「用或丢 ( Use-it-or-lose-it )」的记忆管理方式。

深度研究:不只是高级网络搜索

当你交给 Hermes 一个复杂的研究任务时,它首先调用一个 think_tool——一次强制的战略暂停,迫使模型在做任何事情之前先阐明一个真正的调查计划。梳理数据方向,定义范围,形成假设。只有完成这个规划阶段后,智能体才开始执行。

然后它开始并行化。

ConductResearch 工具不会只发出一个查询。它将具体的研究主题分配给独立的子智能体 ( Sub-agent ),每个子智能体都运行在自己干净的上下文窗口、隔离的终端会话和受限的工具集中。一个子智能体可能通过无头浏览器 ( Headless Browser ) 抓取监管文件,另一个查询数据库,第三个运行 Python 脚本生成统计分析。它们同时执行,将结构化 JSON 返回给主编排器 ( Orchestrator )。

并行工作完成后,智能体再次调用 think_tool。第二遍强制综合:评估返回的结果,检查缺口,判断目标是否达成。如果没有,循环以新的研究方向迭代。如果达成了,它调用 ResearchComplete 并进入报告生成阶段。预定义的深度边界防止无限递归。

对于最终报告,模块化的小报告由一个大上下文模型 ( 至少 64K Token 窗口 ) 合并为一份连贯的、带引用的文档。

安全故事:为什么这比功能更重要

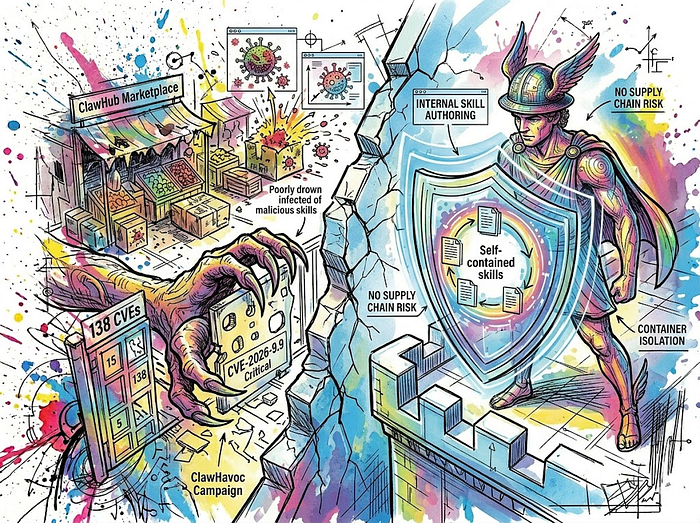

这是让 OpenClaw 用户不太舒服的对比部分。

2026 年 3 月 18 日至 21 日之间,四天内 OpenClaw 出现了 9 个 CVE 漏洞,包括一个 CVSS 9.9 严重漏洞,允许认证用户提权到管理员权限。到 4 月初,安全研究人员追踪到在 63 天内发现了 138 个 CVE。大约每天 2.2 个新漏洞。

供应链的数字更糟。安全公司 Antiy CERT 确认 ClawHub 市场中有 1,184 个恶意技能,峰值时大约占五分之一的包。SecurityScorecard 发现超过 135,000 个 OpenClaw 实例以不安全的默认配置暴露在公共互联网上。ClawHavoc ( ClawHub 破坏行动 ) 甚至不需要找漏洞,攻击者只需上传看起来很可信的技能,然后等人安装。

Hermes 采取了根本性的更保守的方法。因为智能体是基于你的特定工作流在内部生成自己的技能,它完全绕过了外部供应链攻击向量。你不是从匿名贡献者发布的公共注册中心拉取可执行代码,智能体是在你的环境中从观察到的成功经验中编写自己的运维知识。

在基础设施层面,Hermes 强制终端执行使用容器隔离,子智能体进程使用加密命名空间隔离,以及动态凭证轮换。它在将任何外部数据注入系统提示词之前扫描提示注入 ( Prompt Injection )。OpenClaw 的补丁响应速度一直很快,通常是当天修复,这个项目也不是从根本上坏了。但架构层面的攻击面差异是真实存在的。

把 Hermes 跑起来:搭建指南

你需要安装 Git。就这些。安装程序会处理 Python 3.11+、Node.js v22、ripgrep 和 ffmpeg。支持 Linux、macOS、WSL2 和 Android ( 通过 Termux )。不支持原生 Windows。

步骤 1:安装

curl -fsSL https://raw.githubusercontent.com/NousResearch/hermes-agent/main/scripts/install.sh | bash

安装程序检测你的操作系统并自动配置依赖。Python 通过 uv 运行,这是一个基于 Rust 的包管理器,无需 sudo 即可创建隔离的虚拟环境。

步骤 2:运行设置

hermes setup

交互式向导会引导你完成模型选择和初始配置。如果你是从 OpenClaw 迁移过来的,向导会自动检测 ~/.openclaw 并提供迁移你的设置、记忆、技能和 API 密钥的选项。

步骤 3:选择模型

hermes model

Hermes 与模型无关 ( Model-agnostic )。你可以连接 Anthropic、OpenAI、DeepSeek 或 OpenRouter ( 通过单一端点访问 400+ 模型 )。对于深度研究任务,你需要一个至少有 64K 上下文 Token 的模型。

如果你想要零 API 费用和完全的数据隐私,通过 Ollama 拉取一个本地模型:

ollama pull qwen2.5-coder:32b

然后将 Hermes 指向你的本地端点:http://localhost:11434/v1。完全自主,没有外部 API 调用,数据不会离开你的机器。

步骤 4:设置网关(可选但很强大)

hermes gateway setup

将 Hermes 绑定到 Telegram、Discord、Slack、WhatsApp 或 Signal。网关作为持久的后台服务运行,所以你可以从手机给智能体发消息,同时它在服务器上跑重度任务。对于 Telegram,通过 BotFather 注册一个机器人,通过 @userinfobot 获取你的 User ID,然后把两者填入配置。

一个注意事项:消息接口用于监控和异步更新很好用,但它们本质上是线性的。对于深度协作工作 ( 比如复杂的代码库变更 ),消息线程很快就会成为瓶颈。用 CLI 或专门的工作区来做这类交互。

步骤 5:容器化你的执行(一定要做)

hermes config set terminal.backend docker

这确保所有智能体生成的代码都在隔离容器内运行。如果出了问题,你的主机系统不受影响。

步骤 6:让它学习

从简单的、可重复的任务开始:周报、PR 审查、API 数据处理、研究汇总。关注技能目录。成功完成后,你会看到新的 .md 文件出现——那是智能体自己编写的操作手册。几周之后,原本需要几分钟的任务开始只需要几秒。

Hermes 的不足之处

本地推理的硬件现实。 文章自己建议通过 Ollama 拉取 qwen2.5-coder:32b 做免费本地推理,这值得打个现实补丁。用 32B 模型跑主编排器没问题。但前面描述的深度研究并行化,多个子智能体各自需要自己的活跃推理线程和干净的上下文窗口,这就需要严肃的 GPU 资源了。更现实的本地设置是用一个较小的量化模型 ( Quantized Model ) 做子智能体路由和数据提取,把 32B 模型留给主编排器和最终综合。如果你只有一块消费级 GPU,并行研究工作流会成为严重瓶颈。

自编技能是脆弱的。 内部技能系统绕过了 OpenClaw 的供应链风险,但 Markdown 操作手册在世界发生变化时就会失效。如果一个遗留 API 更新了认证流程,或者一个网站重新设计了 DOM,智能体记住的流程就会失败。不像带有可视化错误处理路径的确定性工作流工具,Hermes 必须先失败、重新评估,然后从头重写技能。学习循环可以处理这种情况,但不是即时的。

除非你真的需要,否则跳过第四层记忆。 文章提到了 LightRAG 和 Supermemory 集成,但对于大多数单服务器设置,SQLite 全文搜索 ( 第三层 ) 提供了速度和召回率的最佳平衡。将扁平的 MEMORY.md 文件与重型外部向量数据库同步会引入延迟和状态冲突问题,除非你在跑企业级多智能体工作流,否则不值得这个开销。

设置复杂度是真实存在的。 OpenClaw 能让你从安装到可用的智能体更快。如果你需要 50+ 平台集成和消费级简洁性,OpenClaw 仍然是更易用的选择。

这个框架才两个月大。 0.8.0 版本于 2026 年 4 月 8 日发布,开发速度很猛。但项目仍在成熟中,粗糙的地方在所难免。

自我改进是渐进的,不是神奇的。 40% 的基准测试提升来自持续数周的使用,不是一次快速演示。别指望一夜之间脱胎换骨。

更大的图景

AI 智能体领域正在分成两个阵营。连接性 ( OpenClaw 的赌注:连接一切,无处不在 ) 对抗认知 ( Hermes 的赌注:随时间变聪明 )。两者在不同用例下都成立。有些团队两个都在用,OpenClaw 做接入和路由,Hermes 做深度分析工作。

对于任何反复运行相同复杂工作流的人来说,一个真正会学习的智能体的累积优势很难忽视。安装只需要五分钟。学习循环会处理剩下的事情。

在云栈社区,你可以找到更多关于 Hermes Agent 及其他开源智能体的实战讨论和最佳实践。

推荐书单

《大模型RAG生成式AI开发:使用LlamaIndex、Deep Lake和 Pinecone》

《大模型RAG生成式AI开发:使用LlamaIndex、DeepLake和Pinecone》深入剖析RAG,详解多模态AI流水线的设计、管理与把控。RAG通过将输出与可追溯的源文档关联,提升了输出的准确性与上下文相关性,为海量信息管理提供了一种动态思路。书中不仅展示RAG框架的搭建方法,介绍关于向量存储、切块、索引及排序等方面的实用知识,还传授优化项目性能、加深对数据理解的技巧,例如,运用自适应RAG与人类反馈来提高检索准确性,平衡RAG与微调的关系,实施动态RAG以增强实时决策能力,以及借助知识图谱可视化复杂数据。读者可亲自上手,实践LlamaIndex和DeepLake等框架、Pinecone和Chroma等向量数据库,以及来自HuggingFace和OpenAI的模型。学完本书,读者将掌握智能解决方案的实施技能,在生产、客户服务等各类项目中稳占竞争优势。

- 扩展RAG流水线,高效处理大型数据集。

- 运用先进技术,最大幅度减少大模型幻觉,确保回复精准无误。

- 实施索引技术,借助可追溯且透明的输出,提升AI准确性。

- 跨领域定制与扩展RAG生成式AI系统。

- 探索利用DeepLake和Pinecone实现高效数据检索的方法。

- 基于真实数据,构建并掌控稳健的生成式AI系统。

- 融合文本与图像数据,丰富AI回复信息。

【5折促销中】购买链接:https://item.jd.com/15305080.html