Hugging Face 最近扔出了一个重磅炸弹——OpenRA-RL,直接把经典即时战略游戏《红色警戒》改造成了大型语言模型的 Agent 训练场。

这可不是套个壳录段视频的玩具级演示,而是真·基础设施级别的东西——50 个 MCP 游戏工具全量暴露,25Hz 实时状态流不间断推送,单进程 64 局并发训练,LLM、脚本 Bot、强化学习 Agent 三条路线全部打通。更硬核的是,它原生接入了 OpenEnv 生态,TRL、torchforge、Unsloth 等训练框架即插即用。

回想当年 DeepMind 的 AlphaStar 挑战星际争霸、OpenAI Five 征战 Dota,背后是几千块 TPU 和完全不可复现的定制架构,普通研究者连门都摸不着。现在,开源社区第一次把 RTS Agent 训练的门槛踹到了地上——一台消费级显卡,一行 pip install openra-rl,你就能站上同一条起跑线。

实战:经济满分,战斗零蛋

来看看实战表现。团队用 Ollama 本地部署了一个 Qwen3 32B 模型,在 128×128 的盟军地图上对阵游戏内置的 Beginner AI,一共跑了 5 局。Agent 通过 MCP 工具集接收结构化观测、发出动作指令,每局开始前有策略规划,结束后有反思复盘,提炼的经验会注入下一局的系统提示。

结果怎么样?全部平局收场,零次战斗交锋。

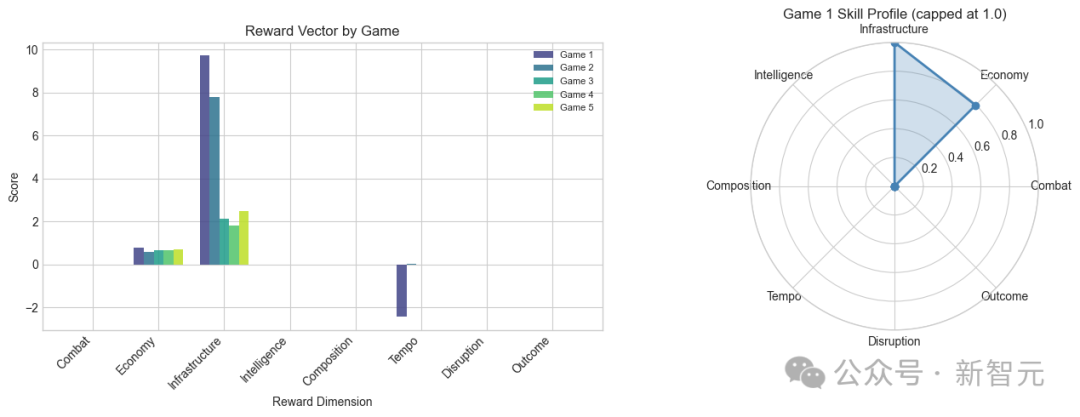

Agent 每一局都成功建起了经济体系,但自始至终没生产过一支进攻部队。有趣的是,如果只看胜负,5局全平,故事到这里就结束了。但 OpenRA-RL 提供了 8 维奖励向量,画面一下子就丰富了:经济维度得分在 0.58-0.80 之间,基建表现稳定,然而战斗和骚扰两个维度干脆挂零。这直接给出了一份精确的失败模式诊断——你可以据此设计奖励塑形和课程学习策略。

下面这段 Game 5 前 10 回合的决策日志,直观展示了模型的"思考节奏":

Turn 1 | get_faction_briefing()

Turn 2 | end_planning_phase(strategy=「」Deploy MCV, build Power

Plant (300 ticks), then Barracks/War Factory (500/750),

train E1 + 1tnk, attack AI base at (64,64).「」)

Turn 3 | deploy_unit(unit_id=120)

Turn 4 | build_and_place(building_type=「」apwr「」)

Turn 5 | advance(ticks=100)

-> tick=55, cash=$5000, units=0, buildings=1

Turn 6 | build_and_place(building_type=「」apwr「」)

Turn 7 | build_and_place(building_type=「」powr「」)

Turn 8 | advance(ticks=60)

-> tick=108, cash=$4923, units=0, buildings=1

Turn 9 | advance(ticks=130)

-> tick=159, cash=$4838, units=0, buildings=1

Turn 10 | advance(ticks=80)

-> tick=210, cash=$4753, units=0, buildings=1

清一色的三段式节奏:情报加规划、建造经济,然后用 advance 快进来弥合 LLM 推理延迟与游戏速度之间的鸿沟。工具调用分布也印证了这一点——advance 占了全部调用的约 57%,这正是异步架构设计的核心价值。

另一个耐人寻味的细节:第2局的赛后反思发现了"战争工厂应该排在发电厂后面"这个建造顺序错误,到第4局的开局计划果然改成了先建发电厂。提示注入式学习能修复建造顺序,却填不上战斗维度的零分——这恰恰是从上下文适应迈向权重更新式强化学习,能够产生可量化提升的突破口。

为什么是红警?为什么是现在?

为什么偏偏选红警当训练场?不妨先问自己一个问题:一个前沿大模型,不做任何 RTS 专项训练,能在即时战略游戏里撑多久? 诚实的答案是:没人知道。因为现有的 RTS 平台压根就不支持 LLM Agent。

SC2LE、PySC2 这些经典框架默认你的 Agent 在毫秒级别行动,动作空间是底层操作。LLM 的需求恰好相反——它要的是高层接口、异步交互,以及对推理延迟从 40 毫秒到好几秒剧烈波动的容忍。硬把 LLM 往老框架上嫁接,能跑是能跑,但结果不可比较,别的团队也没法复现。

OpenRA-RL 选择了经典 Westwood RTS《红色警戒》作为底座,基于开源项目 OpenRA 魔改游戏引擎。理由相当朴素:策略深度够,代码干净能改,自带从 Beginner 到 Hard 的 AI 对手梯队。最终效果是,不论你拿 Qwen3、Claude 还是 Python 脚本 Bot 来打,都是同一个环境,零改动。

三层"三明治"架构

OpenRA-RL 的整体架构可以看作一个"三层三明治":

最底层是魔改过的 OpenRA 游戏引擎,用 C# 编写,以大约 25Hz 的频率持续驱动游戏心跳。

中间是 gRPC 桥接层,负责实时向外推送观测数据、接收操作指令。

最上层是 Python 封装,对外暴露 Gymnasium 风格的 reset / step / close 接口。

再往上,MCP 服务器把 50 个游戏动作暴露为工具,任何兼容 MCP 的 LLM 客户端都能驱动一局游戏。

这套分层的核心目标只有一个:Agent 的计算与游戏的执行完全解耦。 一个 40 毫秒一步的脚本 Bot 和一个 2 秒一步的 LLM,跑在同一个 25Hz 引擎上,彼此互不干扰。

64 局并发:一个进程就能搞定

训练和大规模评估需要大量并发对局。早期 v1 版本每局游戏开一个 .NET 进程,跑 64 局大约需要 40GB 内存,每次重置要 5-15 秒——完全没法用。v2 版本做了一个核心优化:一个 .NET 进程承载 64 个会话。 关键发现是 ModData(单位属性、建筑参数、科技树、地图规则)在初始化后便不可变,只需加载一次就能跨会话无锁共享,仅此一项便回收了约 35GB 内存。每个会话保留独立的 World、OrderManager 和 BotBridge,彼此隔离。

效果相当暴力:重置延迟从 5-15 秒骤降到 256 毫秒(快了约 40 倍),64 会话总内存从约 40GB 降到约 6GB(省了约 7 倍),JIT 编译也从 64 次降为 1 次。

真正重要的事

OpenRA-RL 真正重要的,不是让大模型在红警里造了几座发电厂。更重要的是:这个训练场够硬、够准、够开放。

环境本身蕴含着真实的策略深度——320 亿参数的前沿模型对阵最弱 AI,5 局打下来零交战,连一次进攻都没发起过。新手难度的红警就足以暴露大模型在建造顺序、兵种搭配、进攻时机上的短板,而且暴露得非常精确。如果只看胜负,5局全是平局,一句话就说完了;但 8 维奖励向量会告诉你,经济得分 0.58-0.80,基建还行,战斗和骚扰完全挂零——弱点在哪里,课程设计该往哪开刀,一目了然。

团队在博客中列出了几个明确的下一步方向,听上去就让人兴奋:基于 Qwen3 基线跑 GRPO,用权重更新替代提示注入,看看战斗零分能不能动起来;利用 8 维奖励做课程设计,从只需战斗维度的场景开始逐级上爬;进行跨模型横评,把 Claude Sonnet、GPT 级模型、更小的本地模型放在同一张地图、同一个对手、同一个时间限制下较量;还有 Agent 对 Agent 的排行榜竞技赛。

对于整个 AI Agent 领域来说,这套工具的意义远不止于红警。AlphaStar 和 OpenAI Five 已经证明了 AI 能在 RTS 里达到超人水平,但那些成果被锁在高墙之后——几千块 TPU、定制架构、不可复现。OpenRA-RL 第一次把这堵墙推倒了一大块:一台消费级显卡,一行 pip install,你就站在了 RTS Agent 研究的起跑线上。

红警是一个信号——这是强化学习该登场的地方。而现在,登场的门票终于不再只属于 DeepMind 和 OpenAI 了。在云栈社区,我们持续关注这种能真正降低实验门槛的硬核项目,后续有新的对战数据或模型横评出来,会第一时间同步解读。

参考:https://huggingface.co/blog/jadetan/openra-rl

GitHub - https://github.com/yxc20089/OpenRA-RL

https://openra-rl.dev/