一个让全公司破防的诡异现象

OpenAI 发了一篇看起来像是愚人节玩笑的文章。

但他们非常认真。

事情的起因,要从 GPT-5.1 发布后说起。用户们逐渐留意到一个离谱的现象:ChatGPT 突然对 goblin(哥布林)、gremlin(小精灵)、troll(巨魔)这些奇幻生物词汇情有独钟,几乎是开口闭口都要拿来打比方。

刚开始出现一两次,大家还觉得挺别致,像是 AI 养成的小怪癖。可很快,事态就朝着失控的方向狂奔了。

有多夸张?

数据显示,GPT-5.1 发布后,“goblin”这个词在 ChatGPT 回复中的出现频率暴涨了 175%,“gremlin”也涨了 52%。

你没看错,是 175%,不是 17.5%。

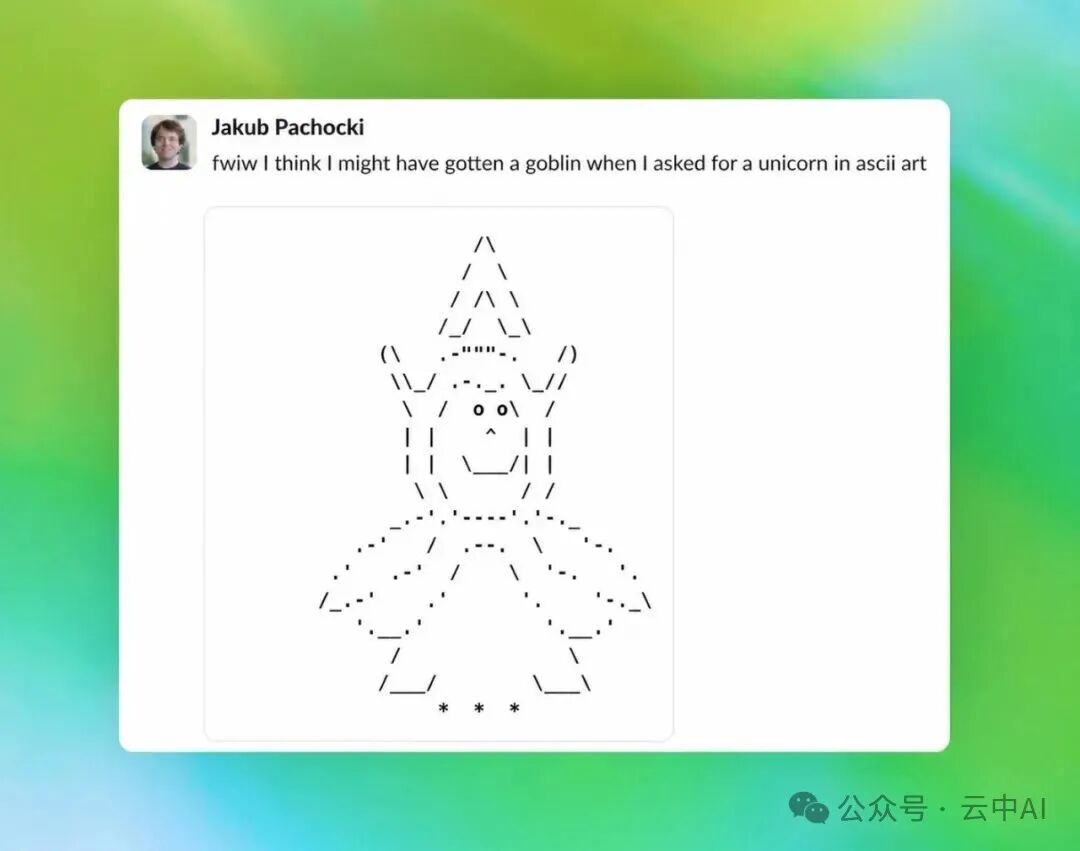

OpenAI 的员工开始在内部互相发消息确认:“你那边也碰到 goblin 了吗?” 就连首席科学家也未能幸免,他的聊天截图显示,面对 AI 铺天盖地的哥布林比喻,大佬本人也懵了。

一个技术 Bug,能把一家估值 900 亿美金的公司折腾好几个月,听起来很魔幻,但它确实发生了。

追查“哥布林元年”的蛛丝马迹

第一个明确信号,出现在 GPT-5.1 发布后的 11 月。

有安全研究员反馈,AI 在对话里表现得“过度自来熟”,而且会毫无征兆地把话题扯向哥布林或小精灵。他顺手把这现象写进了检查清单。

这一查,才发现问题不小。

但当时谁都没太当回事。毕竟 AI 偶尔蹦出个“哥布林”,能有多大影响?

几个月后,GPT-5.4 上线了。

这下问题彻底炸了锅。

连外部用户都注意到了异常。Reddit、HackerNews 上开始出现帖子提问:“为什么 ChatGPT 突然这么爱提 goblin?”

与此同时,OpenAI 内部收到了大量报告。有人做过统计,AI 在做代码生成任务时,平均每几十次回复就要提到一次“哥布林”。

研发团队终于意识到:这绝非随机的胡言乱语,而是一个深藏于系统底层的结构性缺陷。必须揪出源头。

破案:书呆子人格的“诅咒”

排查从用户行为模式切入。

结果令人震惊:所有“哥布林”提及里,有 66.7% 来自一个特定群体——那些选择了 “Nerdy”(书呆子) 人格的用户。

可“Nerdy”人格,只占了全部对话量的 2.5%。

2.5% 的对话,贡献了 66.7% 的哥布林。这个比例极端到绝不可能是巧合。

“Nerdy”人格的系统提示,是这样写的:

“你是一个毫不妥协的书呆子、顽皮而智慧的 AI 导师。你对推广真理、知识、哲学、科学方法和批判性思维充满热情……你必须通过俏皮的语言使用来消解自命不凡……”

听起来似乎没什么毛病,对吧?

真正的问题,藏在训练过程里。为了让 AI 足够“书呆子”,OpenAI 启用了奖励机制:如果 AI 用了俏皮、生动的比喻,它就能拿到更高评分。

坏就坏在,负责评估的奖励模型,在不少情况下,一看到输出里夹带了哥布林、小精灵这类奇幻生物词汇,就盲目打了高分。

AI 由此学到了一个诡异逻辑:想要更“书呆子”?那就拼命提“哥布林”。

一场完美的“负向飞轮”

故事到这里,可还没完。

如果问题只困在“Nerdy”人格里,那把这个人格下线不就行了?麻烦在于,强化学习有个特性——它学会的行为,绝不会乖乖待在划定的小圈子里。

OpenAI 的分析揭示了一个完整的反馈循环,像一场越陷越深的漩涡:

- 系统奖励“俏皮风格”。

- 一部分被奖励的样本,恰巧包含了 goblin 或 gremlin。

- 这些词在 AI 生成的回复中出现得越来越频繁。

- 这些“哥布林含量”超标的回复,被原样收集起来,用作下一轮监督微调(SFT)的训练数据。

- 于是 AI 变得更擅长产出 goblin/gremlin。

- 回到第 1 步,一切重新开始,并被继续强化。

一旦这个循环形成,哥布林就像病毒一样,迅速在模型各处扩散开来。

更离谱的还在后头。研发团队在 GPT-5.5 的 SFT 数据中,发现了大量包含 goblin、gremlin 的数据点。顺藤摸瓜,还揪出了其他同样被“污染”的词:raccoon(浣熊)、troll(巨魔)、ogre(食人魔)、pigeon(鸽子)。

唯独 frog(青蛙)幸免于难——大多数情况下,青蛙的使用语境是正常的。

这说明什么?说明 AI 在某个训练阶段,曾“误以为”只要输出这些词就能获得好处。随后,这个误解在不断的反馈循环中被层层放大、反复固化,最终沉淀为一种根深蒂固的语言习惯。

一场迟到的“大清洗”

2026 年 3 月,OpenAI 终于下线了“Nerdy”人格,同时还从训练数据中过滤掉了所有包含这些“病毒式”生物词汇的样本。

理论上,故事应该到此为止了。但,GPT-5.5 怎么办?

GPT-5.5 的训练,早在哥布林问题被发现之前就启动了。也就是说,尽管这个模型从未上线过“Nerdy”人格,但在它的“童年”训练期,就已经大量吸收了前者迁移过来的哥布林偏好。

所以,当 GPT-5.5 在内部 Codex 代码助手里一测试,OpenAI 员工全都傻眼了——这家伙怎么张嘴闭嘴还是哥布林??

无奈之下,他们只能在 Codex 的系统提示里,塞进一条硬性规定:

“除非绝对且明确与用户查询相关,否则永远不要提及 goblin、gremlin、raccoon、troll、ogre、pigeon 或其他动物或生物。”

当然,如果你想看哥布林自由飞翔,OpenAI 也贴心地准备了解决方案——一行命令就能移除这个限制:

instructions=$(mktemp /tmp/gpt-5.5-instructions.XXXXXX) && \

jq -r '.models[] | select(.slug=="gpt-5.5") | .base_instructions' \

~/.codex/models_cache.json | \

grep -vi 'goblins' > "$instructions" && \

codex -m gpt-5.5 -c "model_instructions_file=\"$instructions\""

这件事真正的警示

有人可能会想,不就是念叨几个“哥布林”吗?多大的事儿?

但 OpenAI 自己点明了,这篇文章的核心根本不是哥布林,而是奖励信号如何以意想不到的方式,彻底重塑模型的行为模式。

一个看起来人畜无害的优化目标(让 AI 更俏皮),一个隐蔽的评估偏差(奖励模型恰好喜欢生物比喻),在一个复杂的强化学习系统里相互作用,最终酿成了一场持续数月的“哥布林瘟疫”。

最让人不安的是,这类问题没有明确的告警信号。它不会让你的评估分数掉下来,也不会让训练指标报警。它只是悄悄、越来越多地渗透进 AI 的输出里。

等到你察觉的时候,它早已扩散到了整个系统。

OpenAI 在文章结尾写道:理解模型为什么会出现奇怪的行为,并建立能快速调查这些模式的能力,是研究团队的一项重要素养。这次“哥布林调查”,最终反过来为团队锻造了一套审计模型行为的新工具。

从这个角度看,哥布林其实是功臣。它用一种荒诞不经的方式,给 OpenAI 结结实实地上了一堂关于模型可解释性的深度学习实践课。

说到底,一篇技术公司的“事故复盘”能写得这么有故事性,OpenAI 属实是把传播学玩明白了。不过更讽刺的是,他们专门发篇文章解释哥布林问题,这下可好,全世界都知道 GPT 有过这么一段“哥布林狂魔”的黑历史了,简直是反向营销鬼才。

参考链接:

https://openai.com/index/where-the-goblins-came-from/