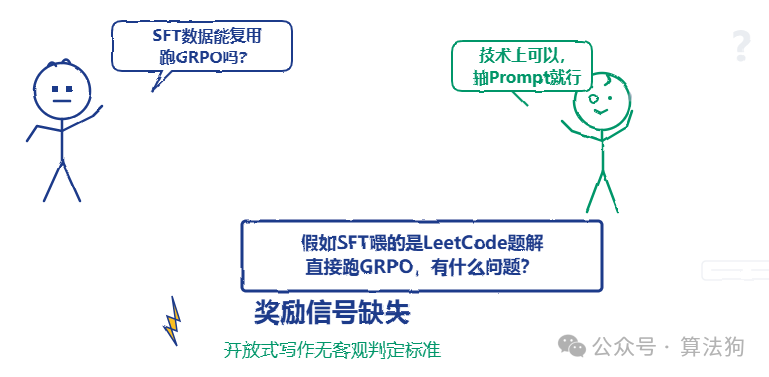

和我过得比较好的一个朋友,也是在中厂,前两天去淘天面试,聊到一个他自认为准备得很到位的问题:“GRPO和SFT能用同一份训练数据吗?”他脱口而出:“技术上可以,把SFT的Prompt抽出来,配上奖励函数就能跑GRPO。”面试官点了点头,继续追问:“那假如SFT阶段喂的是LeetCode题解,现在直接拿这些题跑GRPO,你琢磨一下会有什么问题?”他刚要开口,忽然卡住了。

他意识到这事儿没那么简单——LeetCode题的难度分布太散,简单的模型一次就做对,组内优势趋近于零;难的怎么采都错,同样没有学习信号。更要命的是,GRPO依赖的是可验证的奖励函数——代码能不能编译、测试能不能通过,而不是SFT那种直接比对参考答案的方式。

走出面试间他才真正想明白:数据可以同源,但用法必须不同。SFT是给模型装起跑线,GRPO是告诉它往哪个方向跑——赛道本就不同。

下面我们就来掰扯一下,GRPO的训练数据到底能不能直接复用SFT的,顺带聊一些基础知识,帮大家把思路理清楚。

1. 核心结论

GRPO的训练数据能不能和之前的SFT完全一样?答案是:技术上没啥问题,但实践中不建议直接拿来就用。这个问题乍一看挺普通,但深挖下去其实挺考验人的——它不是考你记不记得某个API参数,而是看你有没有真正理解强化学习的训练逻辑。在人工智能领域,这类对训练范式的深层理解正变得越来越关键。

2. SFT与GRPO的本质差异

要搞清楚这个,咱们先把两套机制放在一起看看。

SFT(监督微调) 的底层逻辑是NTP(Next Token Prediction,也就是下一词元预测)。给定一个Prompt,配上唯一确定的Completion作为标签,模型要做的就是去拟合这个输出分布。它本质上是数据驱动的黑盒优化——你喂什么数据,模型就往哪个方向学。优点是稳定、好控制,缺点是上限基本被训练数据本身锁死了。

GRPO 则走了一条完全不同的路。它的核心机制是:对同一个Prompt,让模型采样多个不同的输出;随后由奖励函数对这些输出评分,计算组内相对优势,以此信号来更新策略参数。这里关键的词是“组内相对”——它评判的不是某个输出的绝对质量,而是该输出在这一组候选中的相对位置。换句话说,GRPO给模型提供的不是“正确答案是什么”,而是“在你自己生成的这些答案里,哪些更好”。

GRPO本质上是PPO(Proximal Policy Optimization)的一个变体,核心改动是去掉了需要额外训练的Critic(价值模型),转而通过对多个采样输出的奖励归一化来估算优势函数。这个设计在显著降低显存消耗的同时,也对训练数据的构成提出了和SFT完全不一样的要求。

3. GRPO对数据的特殊要求:三重约束

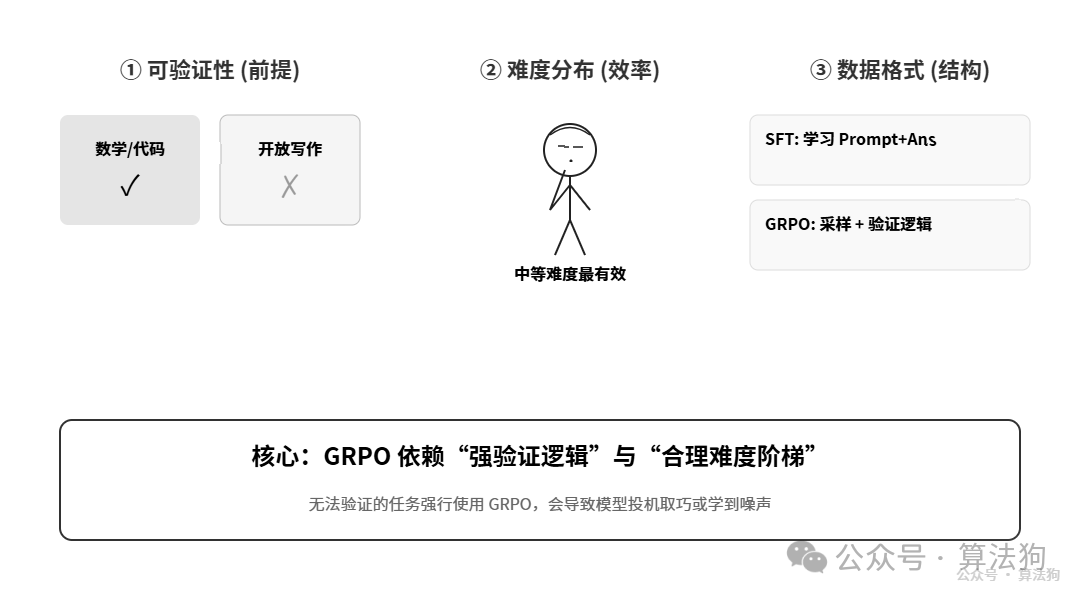

第一重约束:可验证性,这是前提条件。

GRPO依赖奖励函数来区分输出的好坏。正因如此,DeepSeek选择把GRPO主要用在数学推理和代码生成这两类任务上,原因挺直接的:这些领域有天然的二元验证逻辑——数学答案对即对、错即错;代码能跑就是能跑、报错就是报错。但开放式写作、主观问答这类任务就没这么方便了。如果硬要把SFT的开放式数据拿来做GRPO,奖励函数该怎么设计?

(说实话,这里是个挺头疼的问题。)把GRPO扩展到开放式、长文本生成任务(比如写诗、创意写作、通用指令跟随)时,核心挑战就是缺乏客观的评估标准,很难区分高质量输出和低质量输出。即便引入通用奖励模型,这类模型的评分也往往和输出长度高度相关,而不是真正反映内容质量。也就是说,一旦脱离可验证任务,GRPO的奖励信号就会变得噪声很大,甚至可能让模型学会投机取巧——比如用正确的格式包裹一个错误答案,或者生成一个能通过测试但实际上是硬编码输出的代码。

第二重约束:难度分布,这是效率问题。

GRPO对训练样本的难度其实有隐性要求,这一点经常被忽略。从机制上推一下就明白了:如果一个Prompt对当前模型来说太简单,模型采样出来的所有输出奖励都接近满分,组内优势趋近于零,基本上等于没有学习信号;反过来,如果Prompt难到模型始终全部答错,奖励同样会趋近一致,优势也会消失。(也就是说,无论全对还是全错,结果都一样——白费劲。)所以,最有价值的训练样本,其实是那些让模型“有时对、有时错”的中等难度题——也就是模型在该问题上的通过率既不是0也不是1。

实际落地时,业内团队通常会先用LLM给每道题估算一个通过率,把通过率过高或过低的样本剔除掉,同时配合N-gram和向量相似度过滤,保证数据的多样性。而SFT数据集的难度覆盖通常比较均匀,有时候还会刻意加入大量“示范性”的简单例子——这类数据如果直接拿来做GRPO训练,效率会非常低。

不过这里也有个值得提一下的反例:对于参数量比较小的模型(0.5B到3B),有研究发现只在低难度数据上训练GRPO,和用全量难度数据训练的效果差不多,而且只需要大约45%的训练步数。这说明“难度越高越好”这个直觉并不总是对的,GRPO的数据策略还得结合基础模型的实际能力来定。

第三重约束:数据格式,这是结构性差异。

SFT的数据是Prompt+Completion的完整配对,模型直接对Completion做监督学习。而GRPO训练时只需要Prompt就够了,Completion由模型自己采样生成。如果有Ground Truth答案(比如数学题的标准解),它的用途是构建奖励函数,而不是直接喂给模型。这个区别看起来不大,但实际上影响了整套数据处理流程:SFT数据的人工标注成本主要在“写出高质量答案”,而GRPO数据的成本主要在“设计可靠的验证逻辑”。

4. 为什么说“可以用一样的数据”

从工程实现的角度看,把SFT数据集里的Prompt部分抽出来、配上自定义的奖励函数,确实可以直接跑GRPO。DeepSeek-R1的训练过程也印证了这一点:他们在RL阶段使用的问题集是指令微调阶段问题集的子集,两个阶段的底层数据来源是有重叠的。所以“数据同源”在技术上没什么障碍。

但这并不意味着直接复用就是合理的。同源数据在进入GRPO流程之前,需要经过和SFT完全不一样的筛选和处理:只保留可验证的任务、剔除通过率两极化的样本、专门设计奖励函数。换句话说,原始数据可以共享,但对应的数据工程需要重做一遍。

这也呼应了GRPO在算法生态中的定位。在当前主流的后训练体系里,SFT负责建立格式和指令跟随能力,RL(包括GRPO)则在此基础上针对特定规则做二次优化。两者是接力关系,而不是替代关系。如果把GRPO当成另一个SFT来用——数据照搬、流程照抄——本质上就是把一个用于“探索与比较”的算法硬塞进了“模仿”的框架,既没能发挥它的优势,还可能因为无效的训练信号浪费大量算力。

值得一提的是,过度SFT本身也会给后面的GRPO训练埋下隐患。有研究发现,当SFT训练轮数过多时,模型在强化学习阶段的探索能力会受到明显抑制,导致采样多样性下降,最终GRPO的性能提升反而低于适度SFT的基线。这意味着SFT和GRPO之间不光是数据的接力,更是一种需要动态平衡的协同关系。

5. 总结与补充

总结一下核心逻辑:形式上可以复用相同的原始数据,但进入GRPO流程之前必须做针对性处理——任务要可验证、奖励函数要可靠、样本难度要居中。三点缺一,训练信号基本就废了。

我们回到面试官这里,当SFT数据包含不适合二元验证的任务(如开放式写作)时,怎么设计GRPO的奖励函数?其实可以这么回:GRPO依赖可验证的奖励函数来区分输出好坏,所以DeepSeek主要把它用于数学推理和代码生成这类有天然二元验证逻辑的任务。开放式写作没有客观的评估标准,即便引入通用奖励模型,它的评分也往往与输出长度高度相关,而非真正反映质量,噪声极大,甚至会让模型学会投机取巧。

如果继续深聊,还可以从算法演进的维度补充一句:GRPO本身也还不是终点。DAPO的出现就说明了一个问题——当CoT输出变长时,GRPO那种序列级的损失归一化会悄悄偏袒短输出(也就是说,越长越吃亏),训练稳定性也会跟着下降。而这些工程问题的解法,说到底都指向更精细的数据设计,而不是单纯堆算力。

数据可以同源,但用法必须不同。 更准确的说法可能是:SFT负责给模型画好起跑线,GRPO告诉它往哪个方向跑更快——两者需要的“赛道”,本来就不太一样。如果你正在准备类似的面试求职环节,不妨多从训练范式的底层逻辑入手,而不仅仅是记忆结论。