在智能化出行的浪潮下,如何让单调的驾驶旅程变得生动有趣?借助车联网的实时感知能力与大模型的强大内容生成力,我们可以将车辆变为一个博学的移动导游。本文将详细介绍如何使用Python从零构建一个车载智能导游系统原型,实现沿途地标的实时识别与趣味讲解。

项目概述与核心功能

本项目名为“智途百科”(RoadWise),其核心愿景是利用车辆的位置与视觉数据,打破车内外的信息隔阂,为乘客提供沉浸式的文化之旅体验。系统主要具备以下功能:

- 实时地标识别与播报(“那是啥”功能):基于高精度GPS定位,当车辆接近预设的文化地标时,系统自动触发语音讲解。

- 个性化叙事生成(“时光说书人”模式):利用大语言模型(LLM),将枯燥的百科知识转化为幽默、悬疑或充满故事性的口语化短音频。

- 地理围栏智能响应:当车辆驶入特定景区范围时,系统可自动调整媒体音量,无缝切入导游模式。

想象一下,驾车经过一座古桥时,系统用评书般的口吻娓娓道来其历史典故,无疑能让旅途瞬间充满趣味。

系统架构与数据流

整个系统遵循“感知-决策-执行”的闭环设计。

系统架构

系统分为三层:

- 输入层:负责数据采集,包括车载GPS/GNSS(提供经纬度、航向)、前视摄像头(获取实时图像)及麦克风(接收语音指令)。

- 处理层:作为核心大脑,包含POI检索引擎(根据位置查询地标)、视觉校验模块(可选,用于图像识别增强准确性)、RAG检索增强模块(从知识库获取地标详细信息)以及LLM叙事引擎(加工信息生成讲解稿)。

- 输出层:通过TTS(文本转语音)引擎,将生成的讲解内容以语音形式播放给用户。

数据流向

一次完整的讲解触发流程如下:车辆GPS坐标 → 地图API反向地理编码获取POI名称 → 检索知识库获取详细信息 → LLM结合Prompt生成讲解文本 → TTS转换为语音 → 车载音箱播放。

核心实现与技术解析

为了让演示更直观,我们开发了一个带图形界面(GUI)的PC端智能体模拟程序。下面深入解析其核心代码。

环境准备

首先需要安装必要的Python库。在命令行中执行以下命令:

pip install pyttsx3 geopy openai tk

注:tk 库通常随Python自带,若报错请根据操作系统安装 tkinter。

核心代码模块

1. 定义地标数据库与模拟路线

我们首先在代码中定义了一个静态的地标信息数据库和一段模拟行驶路线(北京中轴线片段)。

# 地标数据库 (POI)

POI_DB = {

"正阳门箭楼": {"coords": (39.8990, 116.3960), "desc": "老北京地标,前门,防御工事"},

"天安门": {"coords": (39.9054, 116.3976), "desc": "明清皇城正门,建国大典,庄严"},

"故宫博物院": {"coords": (39.9163, 116.3971), "desc": "紫禁城,明清宫殿,世界遗产"},

"景山公园": {"coords": (39.9240, 116.3960), "desc": "崇祯皇帝,俯瞰紫禁城,煤山"},

}

# 模拟路线数据库 (北京中轴线一段路)

ROUTE_PATH = [

(39.9000, 116.3950), # 正阳门南

(39.9020, 116.3960),

(39.9040, 116.3970),

(39.9055, 116.3976), # 天安门附近

(39.9070, 116.3980),

(39.9080, 116.3970), # 故宫午门附近

(39.9100, 116.3970),

(39.9200, 116.3970), # 景山公园附近

]

2. 智能体核心逻辑类

IntelligentAgent 类封装了系统的核心业务逻辑,包括地标检测、内容生成和语音播报。

from geopy.distance import geodesic

import pyttsx3

import threading

import time

class IntelligentAgent:

def __init__(self, log_callback):

self.engine = pyttsx3.init()

self.engine.setProperty('rate', 160) # 语速

self.client = OpenAI(api_key=OPENAI_API_KEY) if OPENAI_API_KEY else None

self.log = log_callback

self.last_poi = None # 记忆上一次播报的地点,防止重复

def generate_content(self, poi_name, keywords):

"""调用LLM或使用模拟数据生成解说词"""

if not self.client:

time.sleep(1) # 模拟网络延迟

return f"【模拟AI】:前方到达{poi_name}!这里是{keywords}。不用联网我也能告诉你,这可是个好地方,值得一看!"

try:

prompt = f"你是一个车载导游。请用幽默风趣的口语,用50个字左右介绍前方地标:{poi_name}。关键词:{keywords}。"

response = self.client.chat.completions.create(

model="gpt-3.5-turbo",

messages=[{"role": "user", "content": prompt}]

)

return response.choices[0].message.content

except Exception as e:

return f"网络连接有点问题,不过前方确实是 {poi_name}。"

def check_surroundings(self, current_lat, current_lon):

"""检查周围是否有地标"""

for name, data in POI_DB.items():

poi_lat, poi_lon = data["coords"]

# 计算距离 (单位: 米)

distance = geodesic((current_lat, current_lon), (poi_lat, poi_lon)).meters

# 触发条件: 距离小于 300米 且 不是刚刚播报过的

if distance < 300 and name != self.last_poi:

self.log(f"🔎 发现地标: {name} (距离 {int(distance)}米)")

return name, data["desc"]

return None, None

def speak(self, text):

"""语音播报 (运行在独立线程防止卡UI)"""

def _speak():

self.engine.say(text)

self.engine.runAndWait()

threading.Thread(target=_speak).start()

3. 图形界面与控制类

CarSimulationApp 类基于Tkinter构建图形用户界面,负责模拟车辆行驶并与智能体交互。

import tkinter as tk

from tkinter import ttk, scrolledtext

import threading

class CarSimulationApp:

def __init__(self, root):

self.root = root

self.root.title("车联网智能体 - 实景百科导游 (PC智能体版)")

self.root.geometry("600x500")

self.is_running = False

self.current_step = 0

# 界面布局

self._setup_ui()

# 初始化智能体

self.agent = IntelligentAgent(self.log_message)

def _setup_ui(self):

# 顶部状态栏

self.status_frame = tk.LabelFrame(self.root, text="车辆状态", padx=10, pady=10)

self.status_frame.pack(fill="x", padx=10, pady=5)

self.lbl_pos = tk.Label(self.status_frame, text="位置: 等待启动...", font=("Arial", 12))

self.lbl_pos.pack(anchor="w")

self.progress = ttk.Progressbar(self.status_frame, orient="horizontal", length=500, mode="determinate")

self.progress.pack(pady=10)

# AI 交互展示区

self.chat_frame = tk.LabelFrame(self.root, text="AI 导游互动", padx=10, pady=10)

self.chat_frame.pack(fill="both", expand=True, padx=10, pady=5)

self.txt_display = scrolledtext.ScrolledText(self.chat_frame, height=10, font=("SimHei", 11))

self.txt_display.pack(fill="both", expand=True)

self.txt_display.insert(tk.END, ">>> 系统就绪,请点击“开始行驶”...\n")

# 底部控制区

self.ctrl_frame = tk.Frame(self.root, pady=10)

self.ctrl_frame.pack(fill="x")

self.btn_start = tk.Button(self.ctrl_frame, text="🚗 开始行驶", command=self.start_simulation, bg="#4CAF50", fg="white", font=("Arial", 12, "bold"))

self.btn_start.pack(side="left", padx=20)

self.btn_stop = tk.Button(self.ctrl_frame, text="🛑 停止", command=self.stop_simulation, bg="#f44336", fg="white", font=("Arial", 12))

self.btn_stop.pack(side="right", padx=20)

def log_message(self, msg):

"""向界面文本框打印日志"""

self.txt_display.insert(tk.END, f"{msg}\n")

self.txt_display.see(tk.END)

def start_simulation(self):

if self.is_running: return

self.is_running = True

self.current_step = 0

self.btn_start.config(state="disabled")

self.log_message(">>> 引擎启动,出发!")

# 开启线程

threading.Thread(target=self.run_route_loop, daemon=True).start()

def stop_simulation(self):

self.is_running = False

self.btn_start.config(state="normal")

self.log_message(">>> 车辆停止。")

def run_route_loop(self):

"""模拟车辆沿路线行驶的主循环"""

total_steps = len(ROUTE_PATH)

while self.is_running and self.current_step < total_steps:

lat, lon = ROUTE_PATH[self.current_step]

# 更新UI位置显示

self.root.after(0, lambda l=lat, lo=lon: self.lbl_pos.config(text=f"当前坐标: [{l:.4f}, {lo:.4f}]"))

self.root.after(0, lambda v=self.current_step: self.progress.configure(value=(v+1)/total_steps*100))

# 智能体检测逻辑

poi_name, context = self.agent.check_surroundings(lat, lon)

if poi_name:

self.agent.last_poi = poi_name # 标记已读

# UI显示正在思考

self.root.after(0, lambda: self.log_message(f"🤖 AI正在为【{poi_name}】生成解说..."))

# 生成内容

story = self.agent.generate_content(poi_name, context)

# UI显示内容 & 播放语音

self.root.after(0, lambda s=story: self.log_message(f"🗣️ 导游说: {s}\n" + "-"*30))

self.agent.speak(story)

# 模拟解说时车速变慢或等待

time.sleep(5)

# 模拟行驶到下一个点的时间

time.sleep(1.5)

self.current_step += 1

if self.current_step >= total_steps:

self.root.after(0, lambda: self.log_message(">>> 到达终点,行程结束。"))

self.is_running = False

self.root.after(0, lambda: self.btn_start.config(state="normal"))

关键技术点解析

- 多线程应用:

run_route_loop 和 speak 方法均在独立线程中运行,确保了模拟行驶和语音播报不会阻塞GUI主线程,避免程序界面“卡死”,这是实现流畅交互体验的关键。

- 精确地理计算:使用

geopy 库的 geodesic 函数计算球面距离,比简单的平面坐标距离计算更准确,符合车联网场景下的实际需求。

- 模块化解耦设计:

IntelligentAgent 类专注于业务逻辑(检测、生成、播报),CarSimulationApp 类专注于界面展示与控制。这种清晰的分离使得核心智能体模块可以方便地移植到树莓派或安卓车机等真实硬件平台,只需替换或调整界面层即可。这正体现了良好的软件架构设计思想。

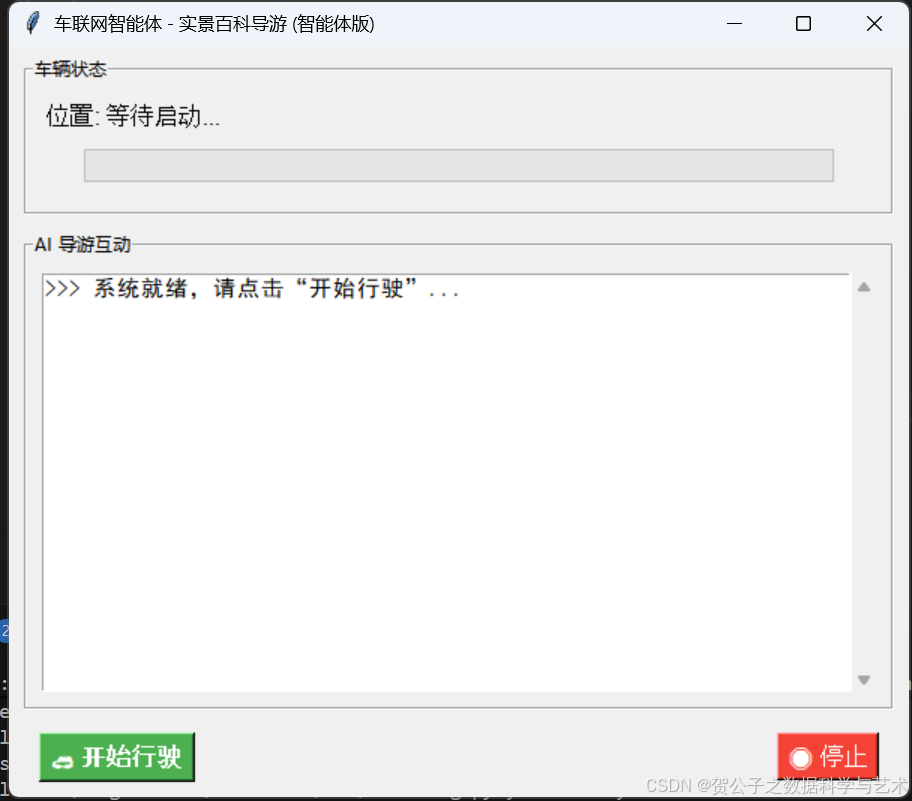

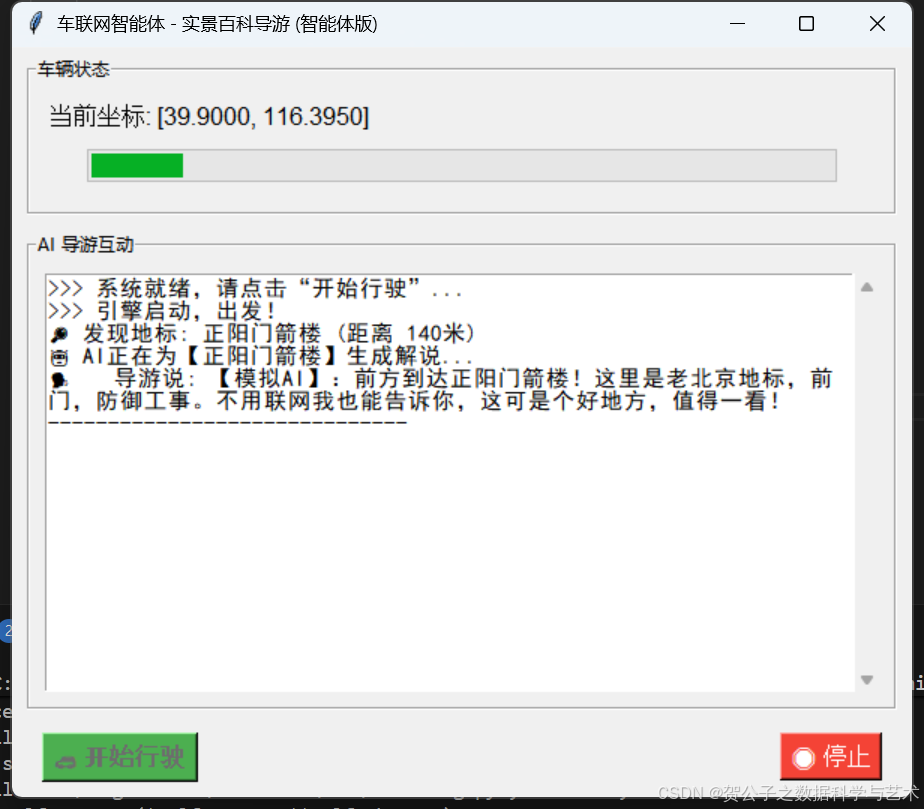

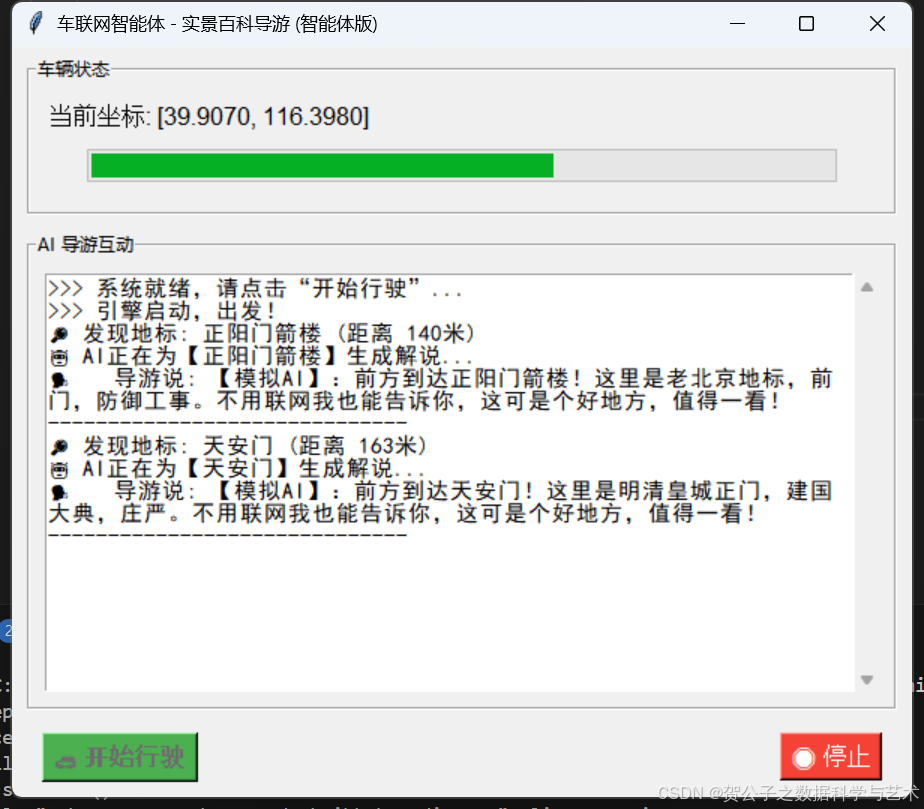

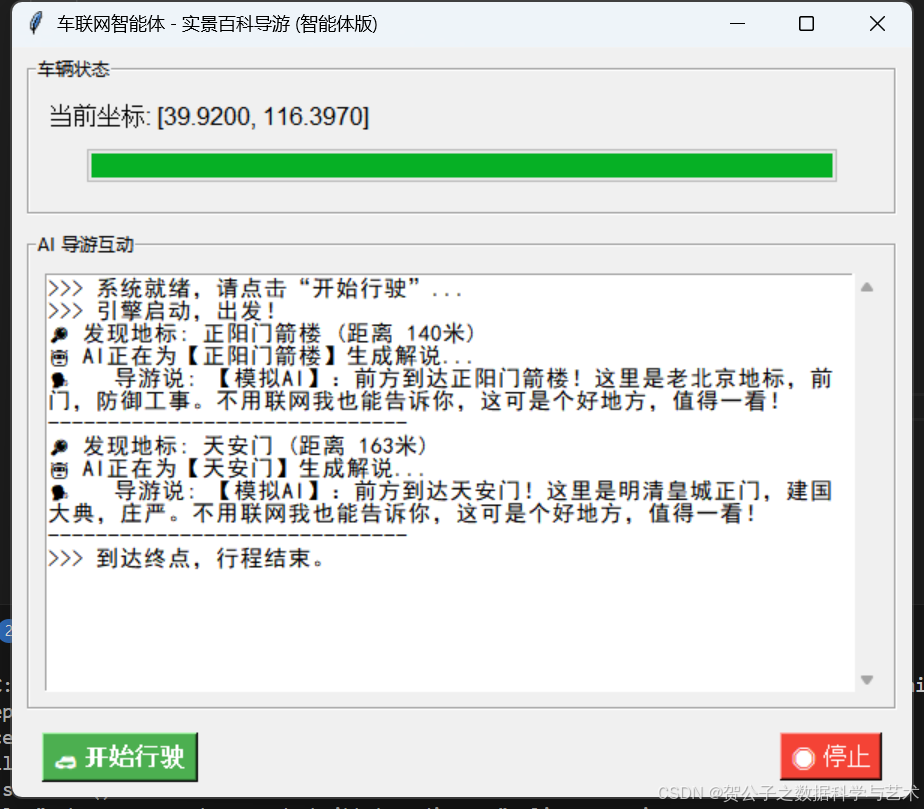

运行效果展示

将上述代码整合并运行后,会出现一个模拟驾驶界面。点击“开始行驶”,车辆将沿预设路线移动,并在接近地标时自动触发讲解。

程序启动,车辆处于就绪状态。

车辆启动,开始沿模拟路线行驶。

系统检测到“天安门”地标,并生成对应的讲解内容。

车辆继续行驶,检测到“故宫博物院”并播报讲解。

通过这个智能体,我们可以完整模拟从北京正阳门到景山公园的游览过程。你可以通过修改 ROUTE_PATH 和 POI_DB 来模拟任意路线,或清空 OPENAI_API_KEY 以测试离线降级模式。

部署扩展与优化建议

真实环境部署

在真实车联网场景中,本系统可部署在车机(Android Automotive/Linux)或边缘计算设备上:

- 硬件:可采用树莓派4B、NVIDIA Jetson Nano等作为计算单元,连接USB GPS模块和摄像头。

- 软件:需将当前桌面环境替换为相应的车载或嵌入式系统框架。

生产级优化

- 动态POI数据:将静态的

POI_DB 替换为高德、百度等地图服务的实时周边搜索API,以获取更全面、准确的地标信息。

- 高质量TTS:将本地的

pyttsx3 TTS引擎升级为云端服务(如Azure、阿里云的语音合成),以获得更自然、拟人化的播报效果。

- 集成视觉模块:接入摄像头,使用 OpenCV 和预训练模型(如YOLO)进行视觉识别,与GPS定位结果相互校验,提高地标识别的准确性与 robustness。

- 加入更多人工智能元素:例如,根据用户历史偏好调整讲解风格,或结合实时路况、天气信息生成更贴切的解说词。

结语

本文通过一个具体的Python项目,演示了如何利用车联网感知技术与大语言模型相结合,打造一个智能车载导游系统原型。从系统架构设计、核心代码实现到关键技术点,完整展示了“数据感知→智能决策→内容输出”的闭环。该项目不仅具有趣味性,也为物联网与AI结合的创新应用提供了可行的实践思路。在此基础上进行硬件适配与功能扩展,便能向一个真正的产品迈进,让每一次出行都成为发现之旅。