本帖最后由 alphaFind 于 2026-1-11 18:25 编辑

很多“换脸”演示看着很炫,但真要落地到视频和摄像头里,难点往往不在模型本身,而在工程:怎么逐帧处理、怎么合成视频、怎么兼顾速度和效果、怎么处理多人画面。

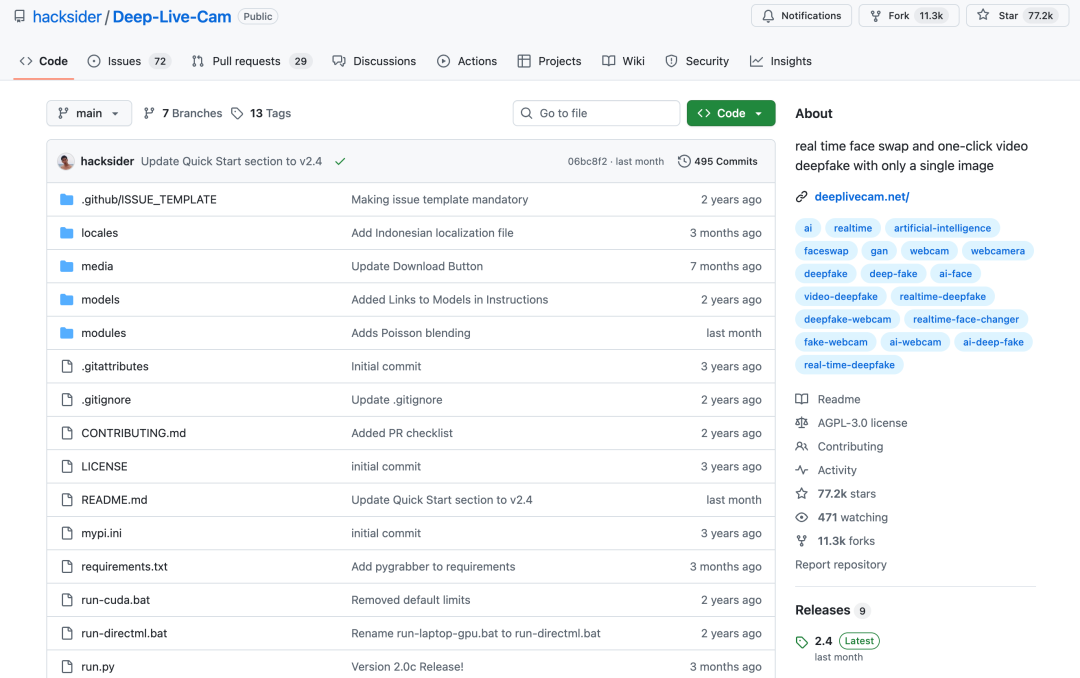

Deep-Live-Cam(2.0.1c)就是把这些环节串起来的开源项目:支持图片、视频文件和 Live 预览,整体更像一个可用工具,而不是一次性的 demo。

它能做什么(功能直观)

- 选一张 source 人脸图,再选 target(图片 / 视频 / 摄像头)

- 视频模式会走拆帧处理,再合成回去;可选 Keep audio 保留原音频

- 多人画面下可以选择 Many faces,也能用 Map faces 做“不同人对应不同 source”的映射

技术栈一眼看清(来自 README 与源码)

- InsightFace:人脸检测与 embedding(支撑多人/映射等能力)

- InSwapper(ONNX)+ ONNXRuntime:核心换脸推理;通过

--execution-provider 适配不同后端(仓库也提供 run-cuda.bat、run-directml.bat)

- GFPGAN(可选):Face Enhancer,用于画质增强(README 指向

GFPGANv1.4.pth)

- ffmpeg / ffprobe:拆帧、合成、音频恢复这条视频工程链路

- customtkinter:桌面 GUI,把 Keep fps、Keep audio、Mouth Mask、Poisson Blend、Transparency、Sharpness、Show FPS 等做成开关和滑杆

- OpenNSFW2:用于 NSFW 检测与处理忽略(README 也明确有内置检查与内容限制)

读代码时最值得关注的 3 个点

1) Map faces 的实现思路很“工程”

不是简单按位置猜人,而是从帧里拿 embedding,再做聚类与匹配,解决多人场景的“身份对应”问题。

2) 效果开关不只是锦上添花

像 Mouth Mask、Poisson Blend、透明度与锐化这些选项,本质是在给用户留出“控穿帮、控边缘、控观感”的空间。

3) 视频链路完整,才有可用性

拆帧处理之后还要合成回去、还要可选恢复音频。很多项目停在推理,这个项目把“最后一公里”也做了。

边界与合规(项目写得很清楚)

README 里明确要求合法合规使用:如果使用真实人物面孔,需要获得同意,并建议公开发布时标注 deepfake;同时声明包含对不当内容的检查,必要时可能加水印或关停。

《异或Lambda》这里不做“用途鼓吹”,只讨论技术形态:当实时换脸变得更低门槛,平台侧的溯源与验证会变得更重要。

项目地址与官方入口

- GitHub:

github.com/hacksider/Deep-Live-Cam

- 快速开始:

deeplivecam.net/index.php/quickstart

- 学 AI:

https://yunpan.plus/f/29

关注《异或Lambda》,后面我们继续用“读源码”的方式,把开源项目讲清楚:它解决什么问题,关键设计在哪里,落地时会踩哪些坑。

标签: #Deep-Live-Cam #GitHub #计算机视觉 #实时推理 #视频工程 #开源实战 |