开源Asterisk在语音通信领域已深耕多年,拥有深厚的用户基础。尽管传统语音产业的增长放缓,但AI技术的爆发为这些开源平台(如Asterisk和FreeSWITCH)注入了新的活力。其开源特性带来的灵活性、强大控制力,结合丰富的AI生态工具,使开发者能够创造出前所未有的应用场景。为了适应AI时代,开源平台也在持续自我革新,例如增加新的模块或接口,而WebSocket正是实现实时、双向通信的关键接口。

全新的WebSocket通道驱动 (chan_websocket) 旨在减轻开发者在Asterisk中处理媒体流入流出的负担。从Asterisk 23.0.0、22.6.0、21.11.0和20.16.0版本开始,将正式提供对该驱动的支持。

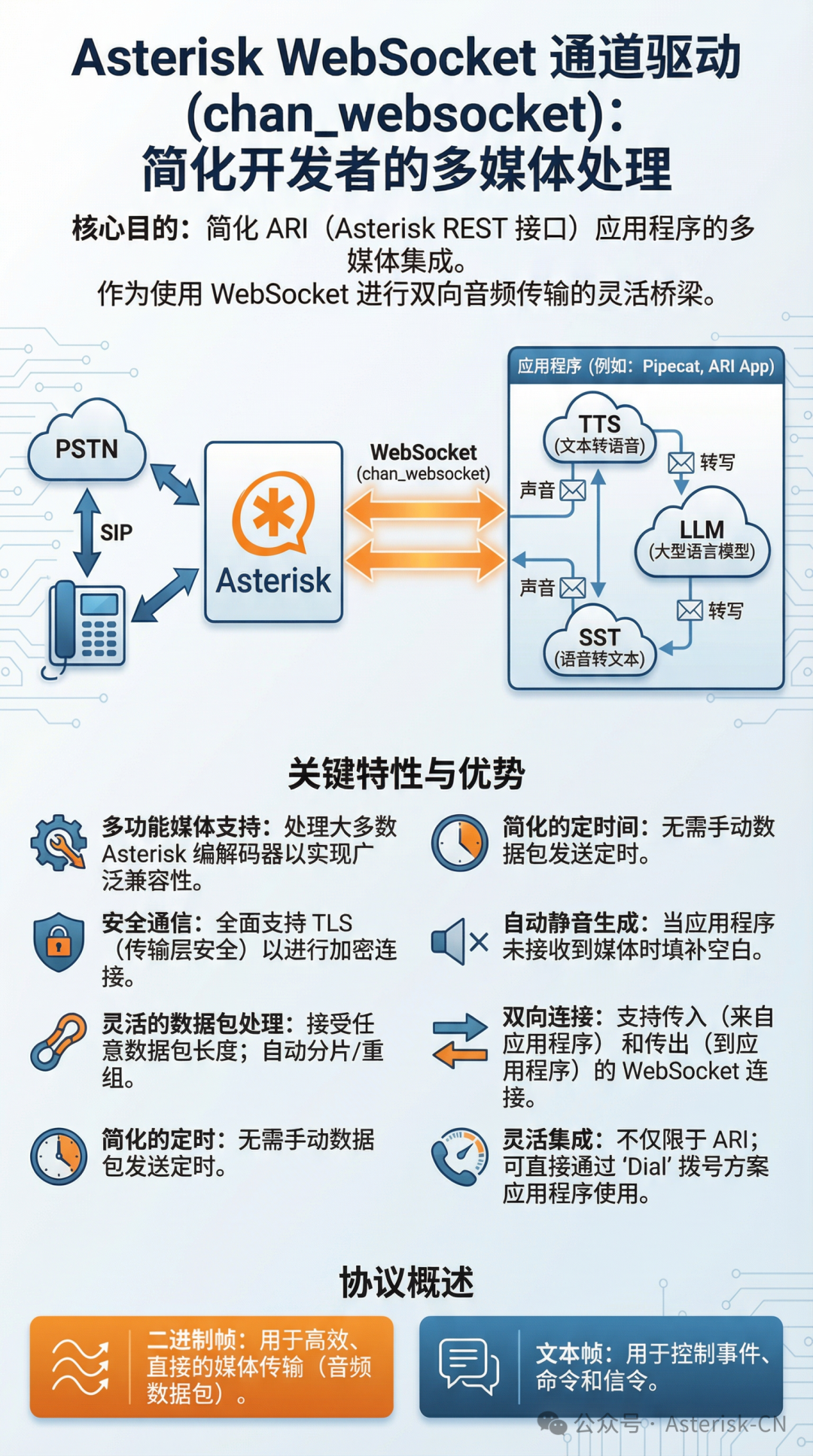

上图清晰地展示了chan_websocket如何作为Asterisk核心系统与外部AI应用(如LLM、TTS/STT模块)之间的灵活桥梁,通过WebSocket协议进行高效的双向音频数据传输与控制信令交互。

通过这个新的驱动,开发者可以更便捷地构建智能语音应用。例如,你可以轻松地将大语言模型(LLM)的对话能力、语音转文本(STT)的识别功能或文本转语音(TTS)的合成服务,与Asterisk强大的电话交换能力相结合。这为开发智能客服、语音助手、实时翻译等场景提供了坚实的技术基础,是开源实战中一个非常值得探索的方向。

这一切都依赖于WebSocket提供的全双工通信通道。与传统的HTTP轮询相比,WebSocket能实现更低的延迟和更高的效率,特别适合网络/系统中实时音视频流媒体这类对时效性要求极高的场景。

以上是基于Asterisk进行AI集成开发的简要讨论。如果你需要进行高度专业化的IPPBX或FS-AI系统定制开发,可以参考更详细的 XSwitch 与 AI 对接指南。如果你在实践过程中有任何心得或疑问,也欢迎来到 云栈社区 与更多开发者交流分享。 |