想在 Mac 上搭建一套完全本地的 AI 开发与知识管理环境吗?本文将手把手教你,如何从零开始安装 Ollama、运行 DeepSeek 模型,并配置 AnythingLLM 和 VSCode 的 Continue 插件,打造一个无需联网的私有化人工智能编程助手。

零、前提条件及准备

开始之前,请确保你的 Mac 满足基本运行要求,并准备好以下安装文件。

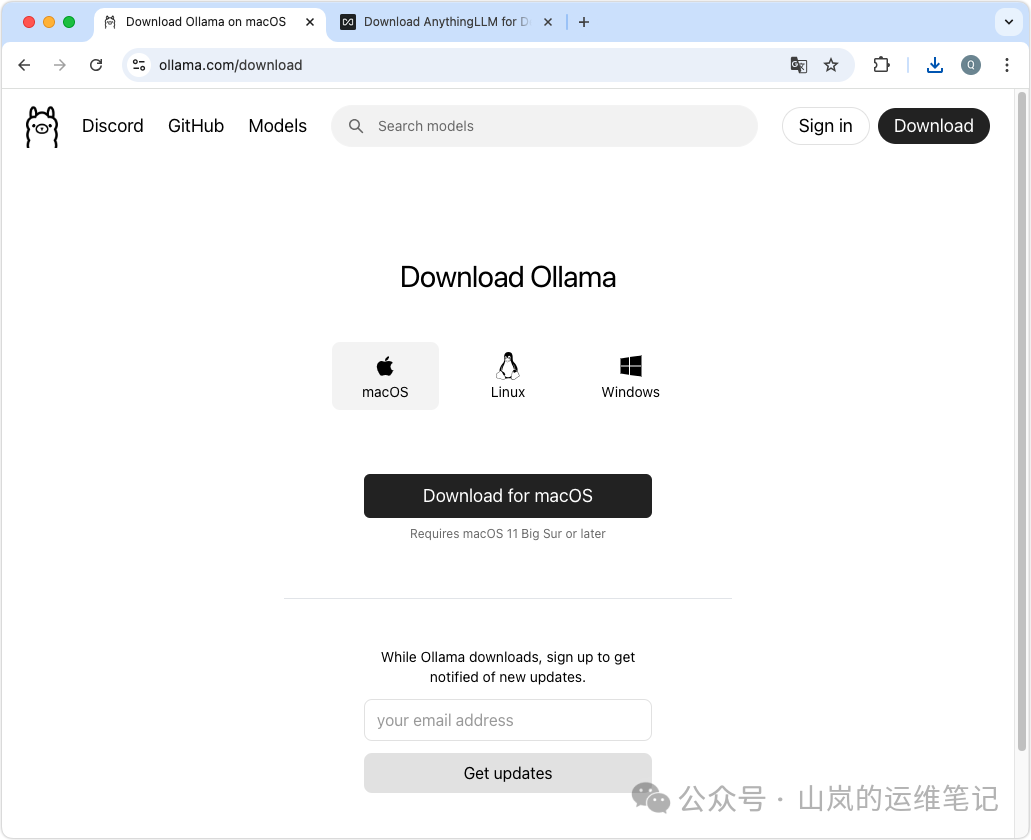

下载 Ollama

首先访问 Ollama 官网:https://ollama.com/。根据你的 Mac 系统版本,下载对应的 Ollama-darwin.zip 文件。

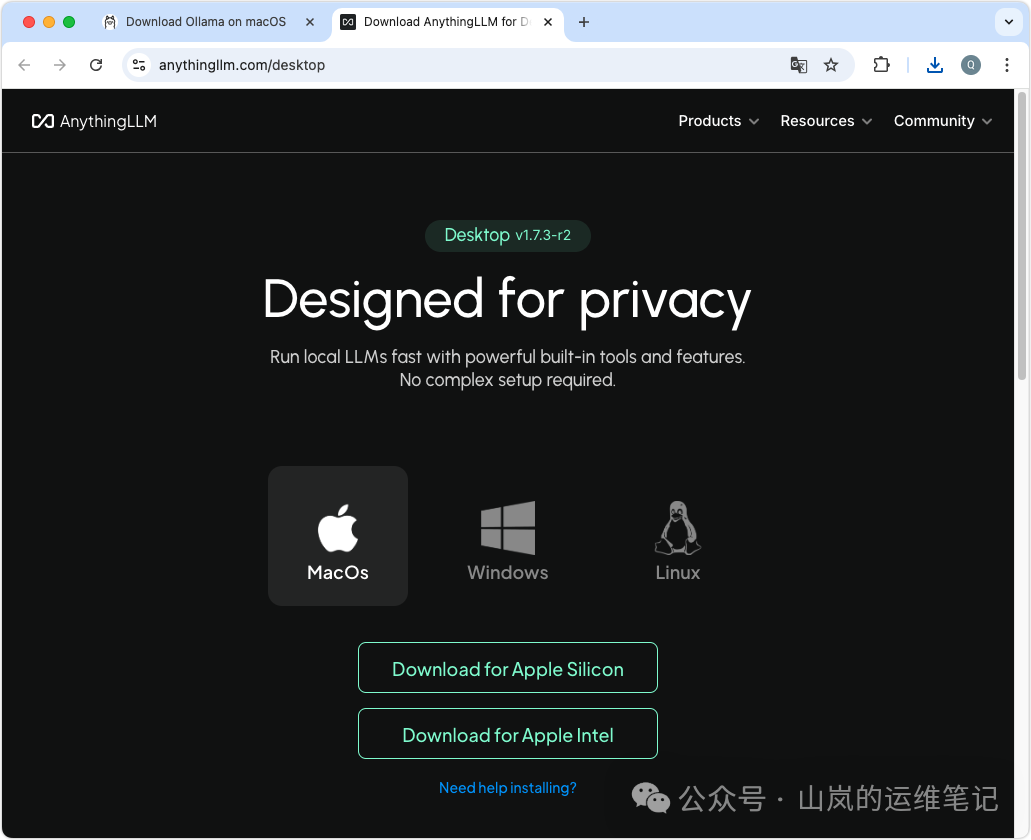

下载 AnythingLLM

接着访问 AnythingLLM 桌面版官网:https://anythingllm.com/desktop,下载适用于 Mac 的版本。

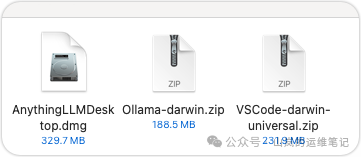

下载 VSCode

如果你尚未安装 VSCode,请访问其官网:https://code.visualstudio.com/,下载适用于 Mac 的 VSCode-darwin-universal.zip 文件。

下载完成后,你的下载文件夹里应该有以下三个文件。

一、安装 Ollama 并运行 DeepSeek 模型

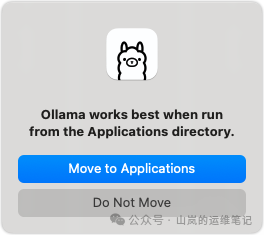

安装 Ollama

解压下载的 Ollama-darwin.zip 文件,打开其中的应用程序进行安装。安装过程中可能会提示你将 Ollama 移动到“应用程序”文件夹以获得最佳运行效果,建议点击“Move to Applications”。

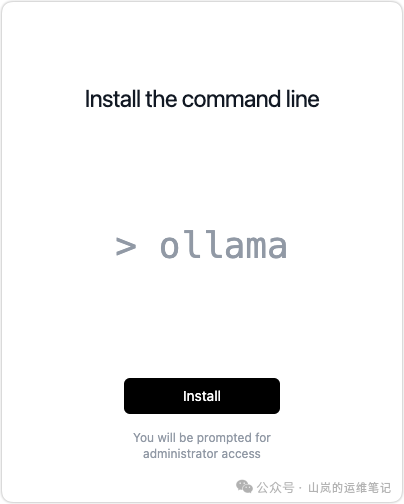

随后,会提示安装命令行工具,点击“Install”。

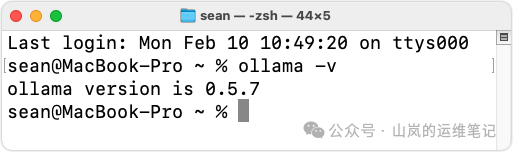

安装完成后,打开终端(Terminal),输入以下命令验证是否安装成功:

ollama -v

如果终端显示版本号(例如 ollama version is 0.5.7),则表示 Ollama 已成功安装。

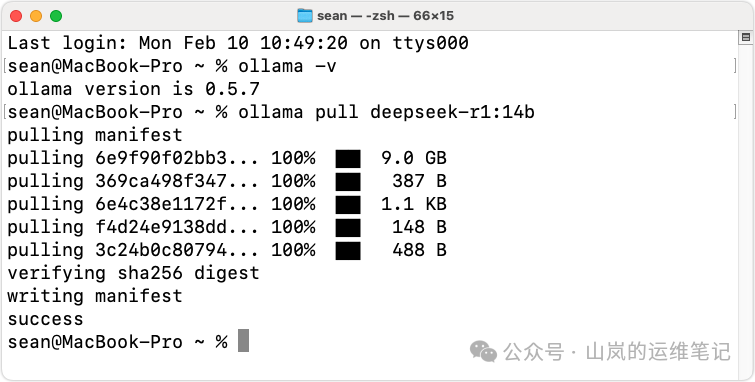

下载 DeepSeek 模型

现在,我们可以通过 Ollama 拉取模型了。在终端中输入以下命令来下载 DeepSeek 模型。模型的选择应根据你机器的性能来决定,如果内存充足(建议16GB及以上),尽量选择 14b 或以上参数规模的模型,以获得更强的推理能力;如果内存只有 8GB 或更少,则可以考虑 1.5b 或 7b 等更小的模型。

ollama pull deepseek-r1:14b

这个命令会从云端拉取模型文件到本地,根据你的网速和模型大小,下载过程可能需要一些时间。

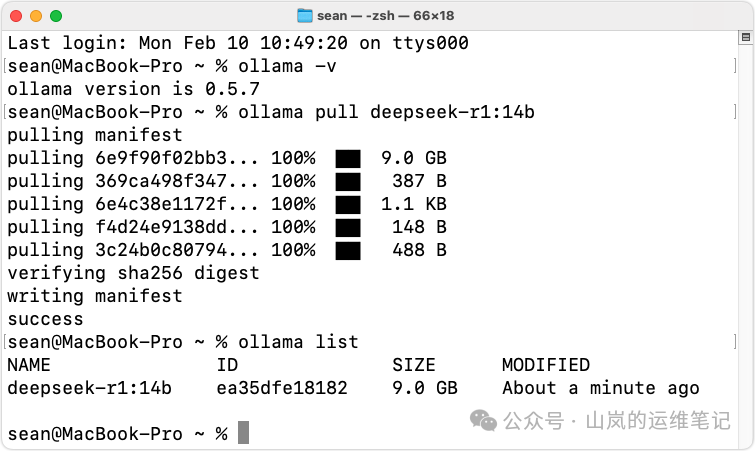

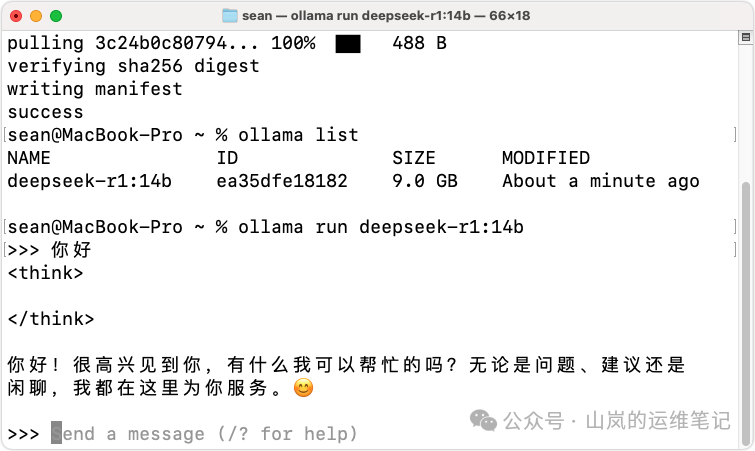

下载完成后,使用以下命令查看已下载到本地的模型列表:

ollama list

启动 DeepSeek 模型

模型下载完毕,就可以在终端中直接与它对话了。输入以下命令启动 DeepSeek 模型:

ollama run deepseek-r1:14b

执行后,终端会进入一个交互式会话界面,你可以直接输入问题,模型会给出回复。输入 /bye 或按下 Ctrl+D 可以退出会话。

二、配置 AnythingLLM

安装 AnythingLLM

双击下载的 AnythingLLMDesktop.dmg 文件,将 AnythingLLM.app 拖拽到“应用程序”文件夹中,即可完成安装。

配置 AnythingLLM

-

初次启动:打开 AnythingLLM 应用,点击 “Get started” 进入设置界面。

-

选择 LLM 提供商:在设置页面,选择 “Ollama” 作为你的模型提供商。

-

配置模型:在模型列表中,选择刚才下载的 deepseek-r1:14b 模型(如果你下载的是其他版本,请选择对应的模型)。确保 “Ollama Base URL” 为 http://127.0.0.1:11434(这是 Ollama 服务的默认本地地址)。其他参数如 Max Tokens 可保持默认,然后点击 “下一步”。

-

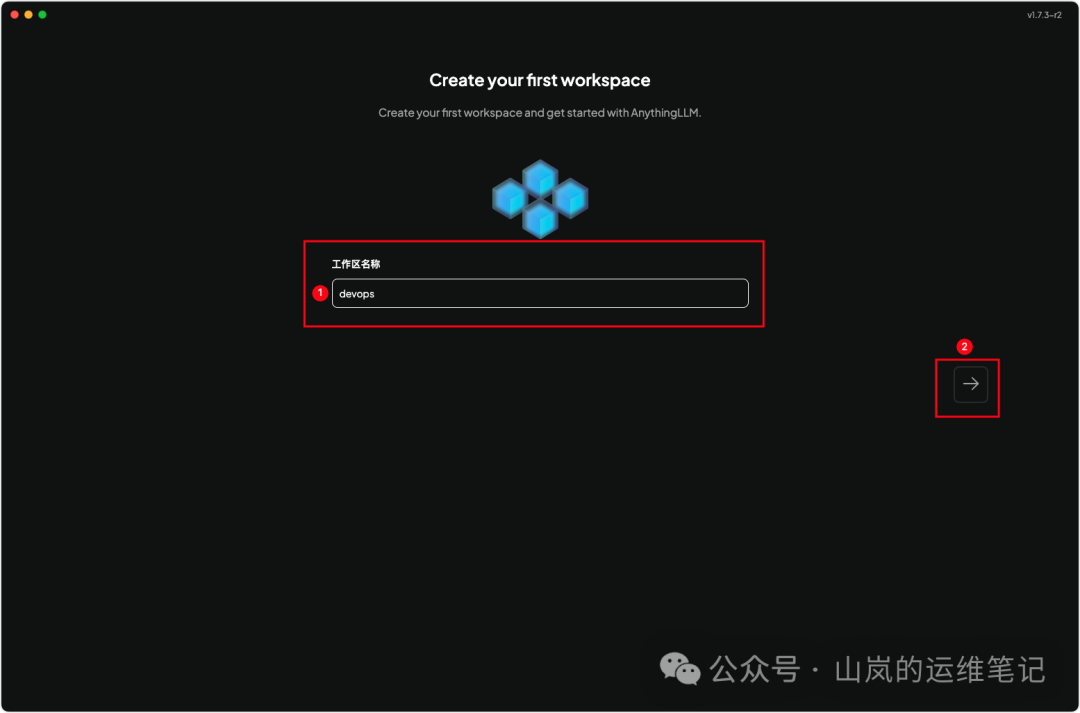

创建工作区:接下来的几步可以快速点击下一步跳过。直到出现创建工作区的页面,为你首个工作区起一个名字,例如 devops,然后点击创建。

-

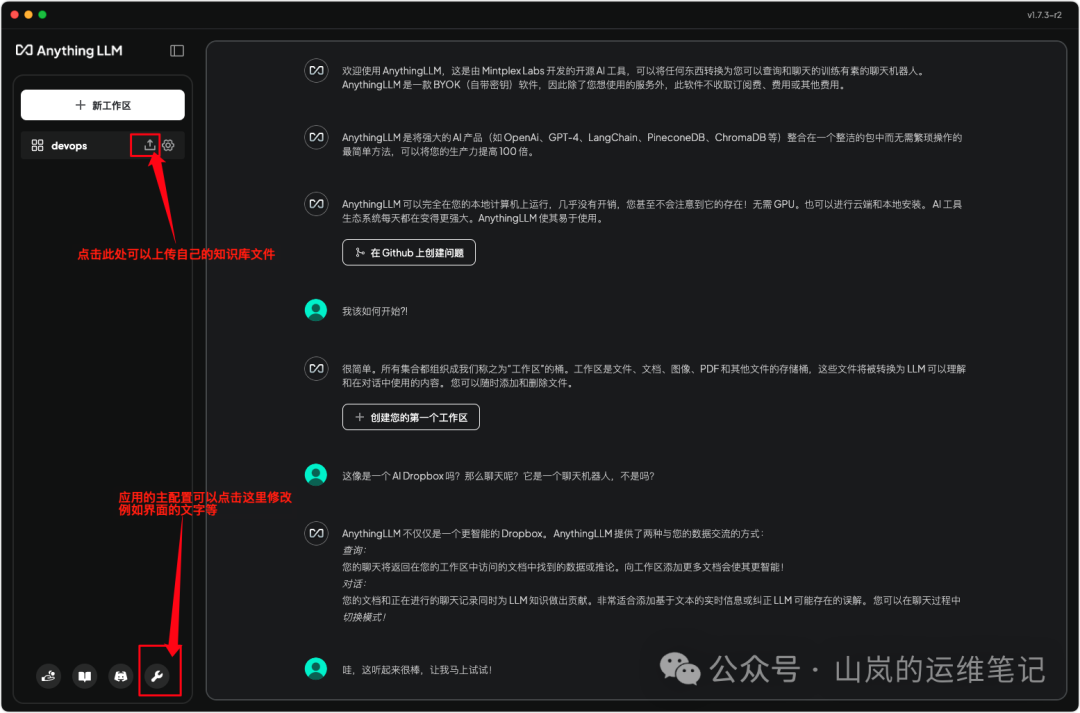

开始使用:配置完成后,你就会进入 AnythingLLM 的主界面。现在,你已经拥有了一个可以基于本地模型进行对话、并能够上传和管理自己知识库文件的强大工具了。这为你构建私有的智能 & 数据 & 云知识库打下了基础。

三、为 VSCode 添加 Continue 插件并配置本地连接

安装 VSCode

如果你还没有安装 VSCode,只需解压下载的 VSCode-darwin-universal.zip,将其中的 Visual Studio Code.app 拖拽到“应用程序”文件夹即可。

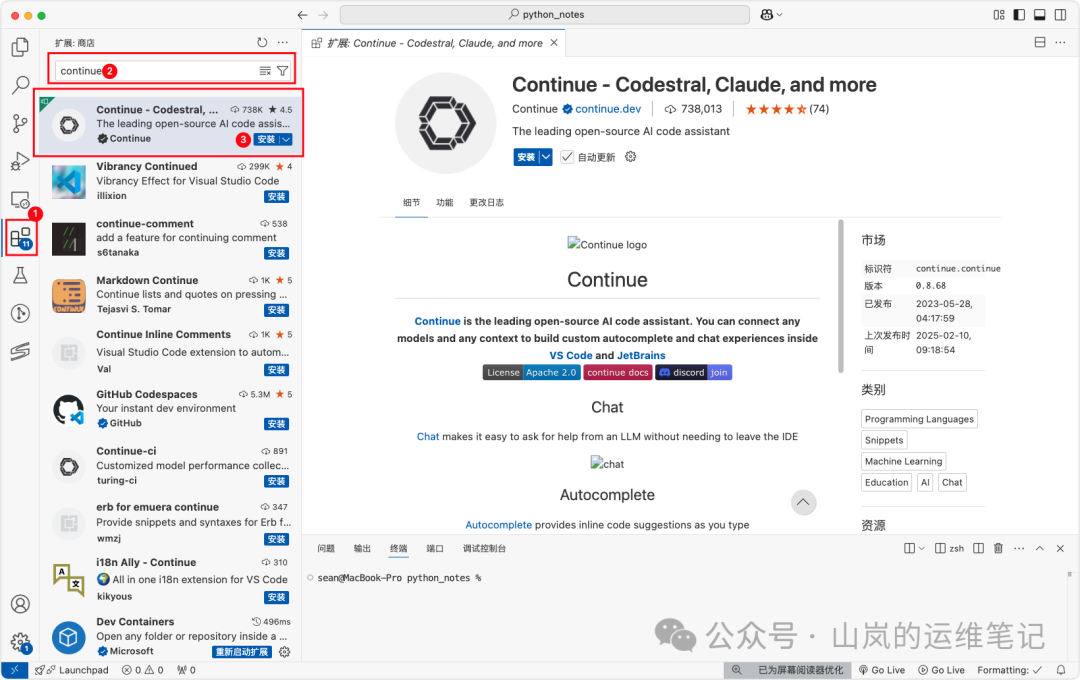

安装 Continue 插件

- 打开 VSCode。

- 点击左侧活动栏的扩展图标(或使用快捷键

Cmd+Shift+X)。

-

在扩展市场搜索框中输入 “Continue”,找到名为 “Continue - Codestral, Claude, and more” 的插件,点击 “Install” 进行安装。

配置 Continue 插件

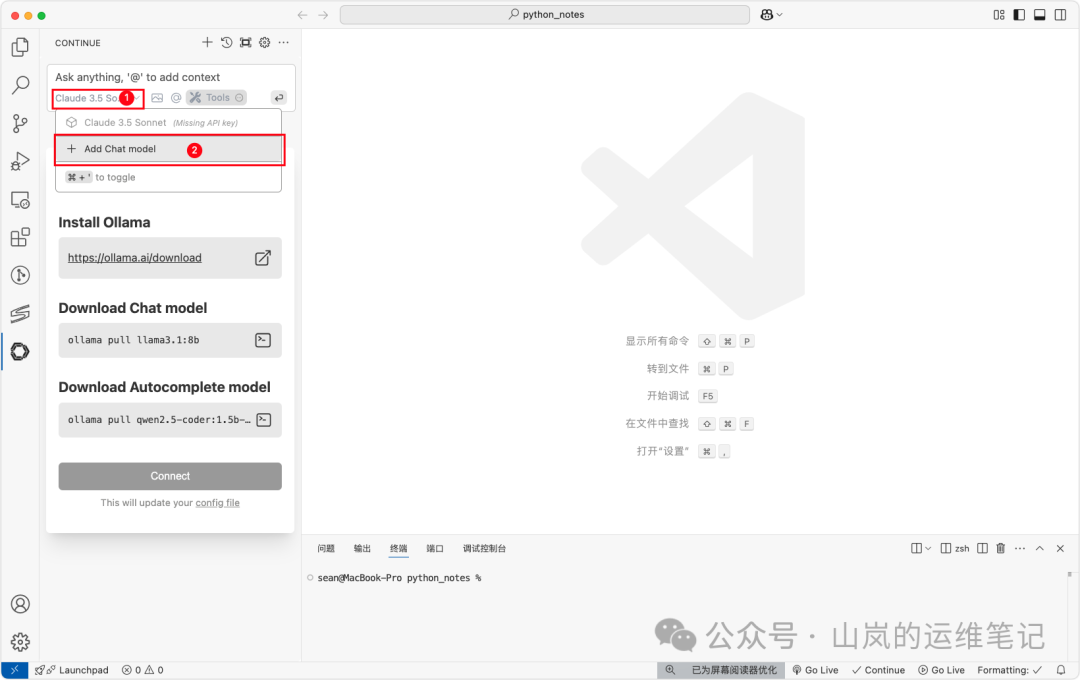

-

插件安装完成后,在 VSCode 左侧活动栏会出现 Continue 的图标(或通过命令面板 Ctrl+Shift+P 搜索 “Continue” 打开)。

-

在 Continue 侧边栏中,点击 “Add Chat model” 来添加一个聊天模型。

-

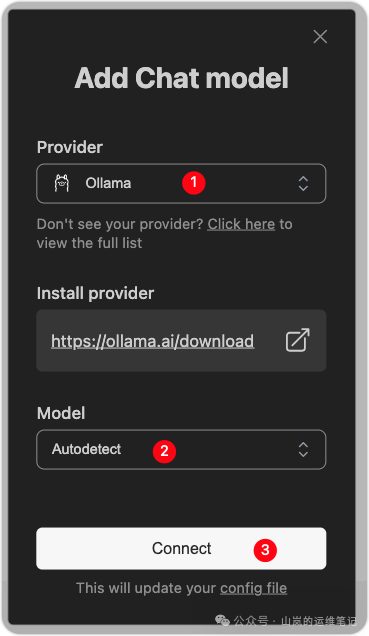

在弹出的配置窗口中:

- Provider:选择 “Ollama”。

- Model:选择 “Autodetect”,插件会自动检测并连接到你本地运行的 Ollama 服务及可用模型(我们之前启动的 DeepSeek)。

- 点击 “Connect” 完成连接。

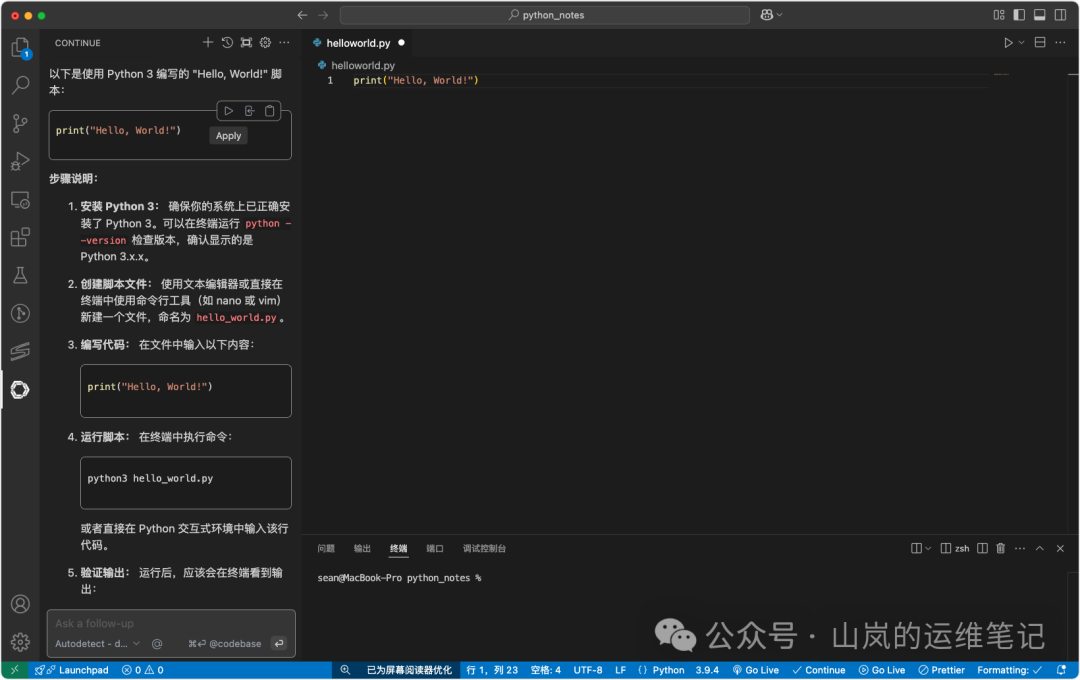

测试 Continue 插件

配置完成后,你就可以在 VSCode 中尽情使用本地 AI 助手了。

- 在代码编辑器中,你可以获得基于上下文的代码补全建议。

-

打开 Continue 的聊天面板,你可以直接向 DeepSeek 模型提问编程问题、请求解释代码或进行调试。

四、注意事项

在享受这套本地 AI 工作流的同时,有几点需要留意:

- 内存要求:运行大型语言模型,尤其是 14b 参数级别的模型,对内存消耗较大。建议 Mac 至少拥有 16GB 内存,以保证流畅运行。

- 模型更新:Ollama 支持的模型库在不断更新。你可以定期访问其官网或使用

ollama list 查看是否有新的或更优的模型版本。

- 网络配置:确保本地的 Ollama 服务(默认在 11434 端口)正常运行。如果遇到连接问题,请检查防火墙设置是否阻止了本地回环地址(127.0.0.1)的通信。

至此,你已经成功在 Mac 上搭建了一套完整的本地 AI 开发环境。从基础的模型运行、到图形化的知识库管理、再到集成开发环境中的智能辅助,这套组合拳能极大提升你的效率,同时确保数据隐私。如果在配置过程中遇到问题,查阅相关的技术文档和社区讨论通常是解决问题最快的方式。欢迎在云栈社区分享你的使用体验或遇到的挑战。