在对 OpenClaw 的强大功能和灵活架构有了深入了解后,我们不禁思考:一个能控制浏览器、操作文件、连接多方平台的超级 AI 助手,其安全性究竟如何保障?能力越大,责任越大,OpenClaw 从设计之初就将“隐私优先”刻入了基因。本文将深入剖析其安全模型,看看它是如何构建坚实壁垒,守护用户的数字资产与个人隐私的。

核心理念:本地优先 (Local-First)

OpenClaw 安全模型的基石是 本地优先(Local-First) 的设计哲学。这与绝大多数依赖云端数据处理的 AI 服务形成鲜明对比——OpenClaw 的核心组件,包括网关(Gateway)和服务(Agent),都运行在用户自己的设备上。这意味着:

- 数据不出门:您的所有个人数据、对话历史、文件内容都保留在本地,不会被发送至任何第三方服务器。

- 完全控制权:您对整个系统拥有 100% 的控制权,可以随时审查、修改或删除任何数据。

- 离线可用:即使没有网络连接,核心的 AI 对话功能依然可以在本地运行(前提是部署了本地的 LLM 模型)。

这种设计从根本上杜绝了云端数据泄露的风险,为用户创造了一个真正私密的 AI 使用环境。

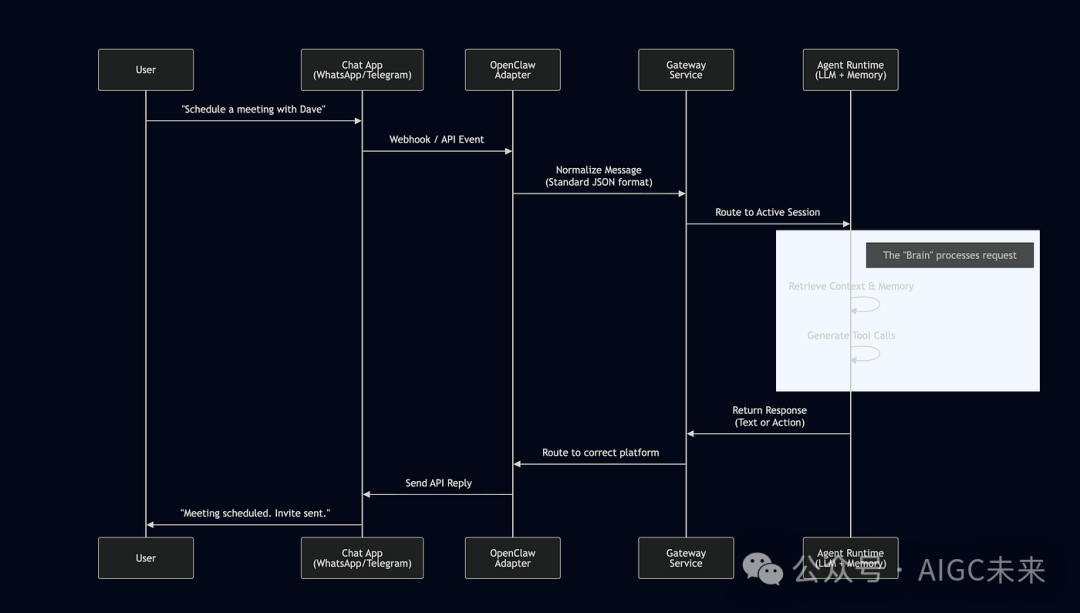

上图清晰地展示了用户请求在 OpenClaw 内部的“本地化”处理流程,数据仅在用户设备与授权的 AI 提供商之间流动,确保了核心隐私。

DM 访问控制:防止陌生人骚扰

当 OpenClaw 接入 Telegram、Discord 等公共消息平台时,如何避免任何人都能与您的 AI 助手对话,甚至发出恶意指令?OpenClaw 通过一套精巧的 私聊(DM)访问控制 机制来解决这个问题。

默认情况下,系统运行在 配对模式(Pairing Mode)。当一个陌生用户首次向您的 AI 助手发送消息时,系统不会处理该消息,而是会自动回复一个一次性的“配对码”。只有您(作为管理员)在 OpenClaw 的命令行中执行 openclaw pairing approve <配对码> 命令,确认授权后,该用户才能正式与您的 AI 助手对话。这相当于为您的数字资产设置了一道可靠的门禁,有效管理了网络访问入口。

沙箱隔离:限制 AI 的能力边界

OpenClaw 的 AI Agent 拥有执行代码、操作文件等高权限能力。试想,如果一个恶意提示诱导 AI 执行了诸如 rm -rf / 的危险操作,后果不堪设想。为了防范此类风险,OpenClaw 引入了 沙箱隔离(Sandboxing) 机制。

您可以将 OpenClaw 配置为在 Docker 沙箱 中运行来自非受信会话(例如公共群聊)的请求。在这个被隔离的环境中,AI Agent 的能力会受到严格限制:

- 文件系统隔离:Agent 只能访问沙箱内部的虚拟文件系统,无法触及您真实主机的文件。

- 工具权限限制:默认情况下,沙箱中的 Agent 只能使用一小部分被认定为安全的工具(如文本处理、会话间通信),而无法使用浏览器、系统命令等高危工具。

- 资源限制:可以为沙箱设置 CPU 和内存的使用上限,防止资源滥用。

这种机制就像为 AI Agent 戴上了“安全手套”,让它在处理来自不可信来源的请求时,既能发挥效用,又不会对宿主系统构成威胁。这种对执行环境的精细控制,是安全领域的重要实践。

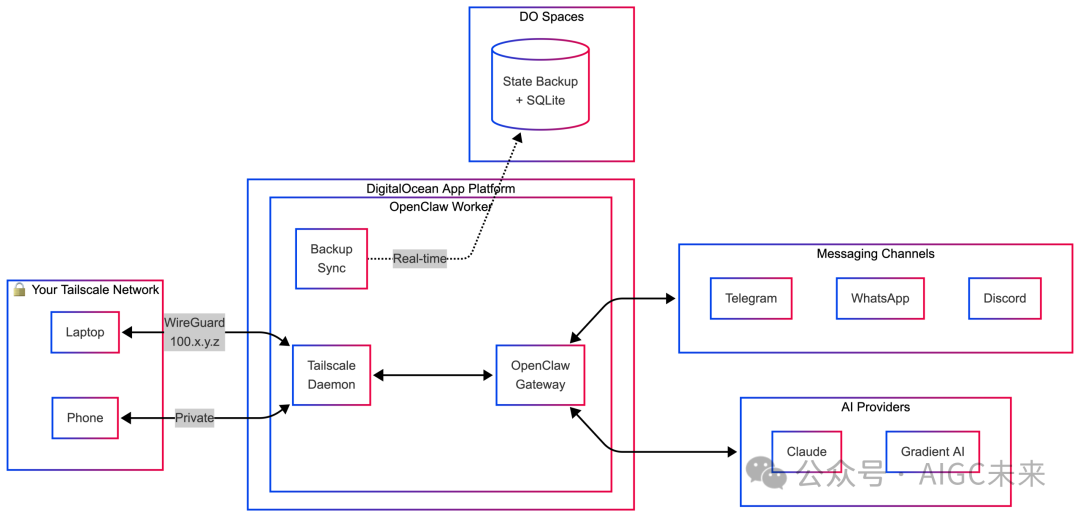

上图所示的架构中,OpenClaw 运行在受控的云环境或本地网络中,通过沙箱机制与外部消息通道和 AI 服务提供商进行安全交互。

消息加密与签名验证

在与企业微信、飞书等外部平台通信时,确保通信内容不被窃听和篡改至关重要。OpenClaw 在其各频道适配器中,严格遵循了各平台提供的安全规范,对传输的消息进行 加密处理。

同时,通过 签名验证 机制(例如,使用平台提供的 Token 或 Secret),网关(Gateway)在接收到每一个外部请求时,都会首先验证其来源的合法性,确保请求确实是由经过授权的平台服务器发出,从而有效抵御了伪造请求攻击。

结语

安全是一个环环相扣的系统工程。OpenClaw 通过本地优先的架构根基、严格的访问控制、强大的沙箱隔离以及标准的加密验证等多层纵深防御机制,构建了一个坚实可信的安全模型。它在赋予用户强大 AI 能力的同时,也最大程度地保障了隐私与数据安全,真正践行了“隐私优先”的设计承诺。

至此,关于 OpenClaw 的理论探索已接近尾声。技术的魅力在于实践,在接下来的内容中,我们将进入实战环节,一步步指导您如何从零开始部署和搭建属于自己的 OpenClaw 服务。欢迎在 云栈社区 交流部署中遇到的任何问题。 |