本文将追根溯源,从历史发展的视角梳理人工智能的诞生脉络,解析其数十年演进中的关键变革。文章将详细介绍发展过程中涌现的众多细分技术模块及其关联,帮助读者构建对AI技术体系的系统性认知(限于篇幅,不会对单一技术做垂直深入探讨)。最后,笔者将结合亲身参与的AI项目案例,探讨如何更有效地应用AI为业务创造价值,并展望其未来前景。

在信息爆炸与互联网飞速发展的当下,AI已成为全球最炙手可热的科技话题。我们每天被海量的大模型、智能体与行业应用资讯包围,仿佛被推至AI变革的风口:不主动拥抱,便可能落后。然而,AI技术体系庞杂,专业术语繁多,许多尝试者或许未曾深入思考:究竟什么是AI?如何与自身业务结合应用?AI的未来又将走向何方?

一、前世:AI出现前

1、唯一的高等智慧动物-人类

人类自人猿形态出现,历经数百万年进化,最终站上地球食物链顶端,成为唯一具备高等智慧的生物:拥有复杂的语言体系、推理与抽象思维、创造发明能力以及独特的多文明体系。

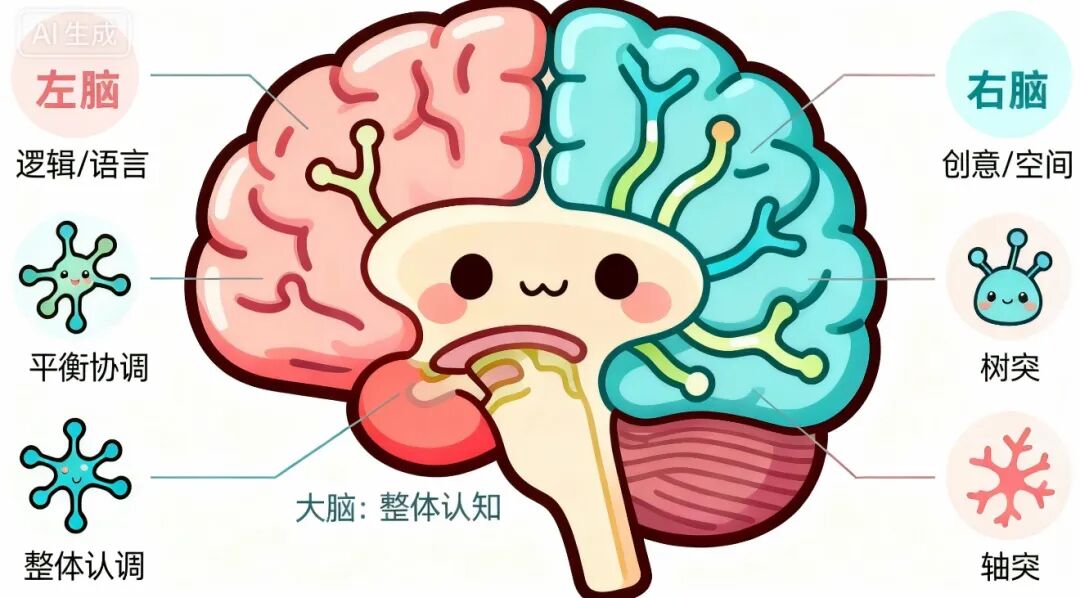

这一切的背后,是人类大脑的独特性。它支撑着抽象思维、推理、语言创造、知识学习与传承、发明创造及文明建立等多维度的“智能”能力。

(人类大脑的简要结构图-图片来源于AI生成)

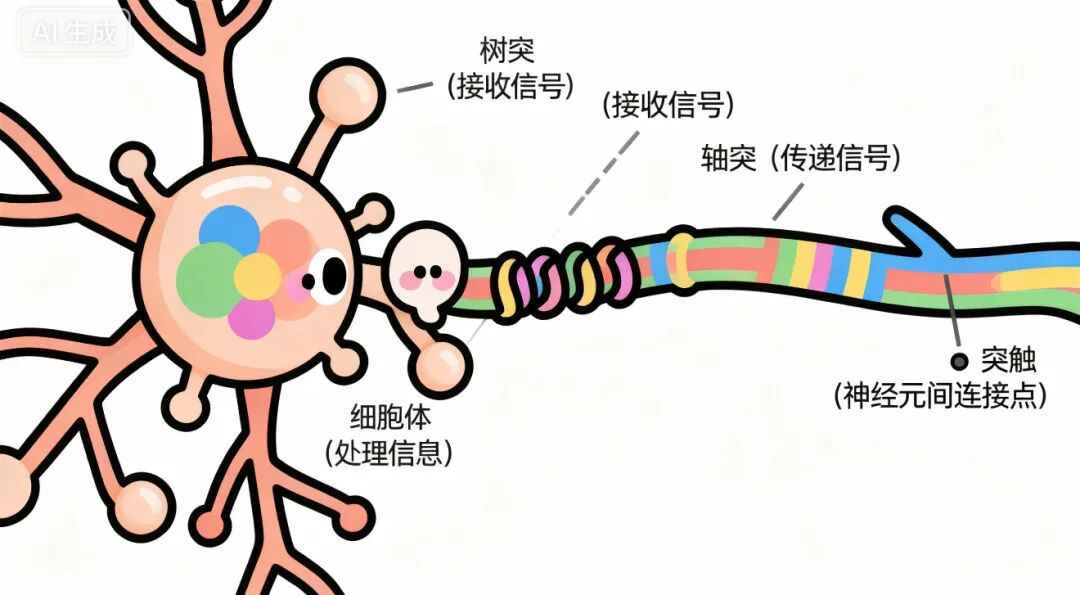

除了左右脑分区,图中还涉及树突、轴突等专业名词,它们正是大脑“神经元”的组成部分。人类大脑拥有近860亿个神经元,负责所有信息的处理与传递,所有大脑活动都依赖于它们的协同工作。正是这些神经元网络,使人类具备了感知、思维、情绪、运动控制、语言交流等多维度的智能能力。

(人类大脑“神经元”的工作原理-图片来源于AI生成)

在数百万年的发展中,人类凭借大脑的智能,创造了语言与文明。然而,人类也逐渐认识到大脑的局限:尽管强大,但其记忆与计算效率并不理想。例如,背诵大量数字或进行重复计算对人脑而言相当困难。于是,一个想法萌生:能否解放大脑,让机器替代人类完成部分工作?

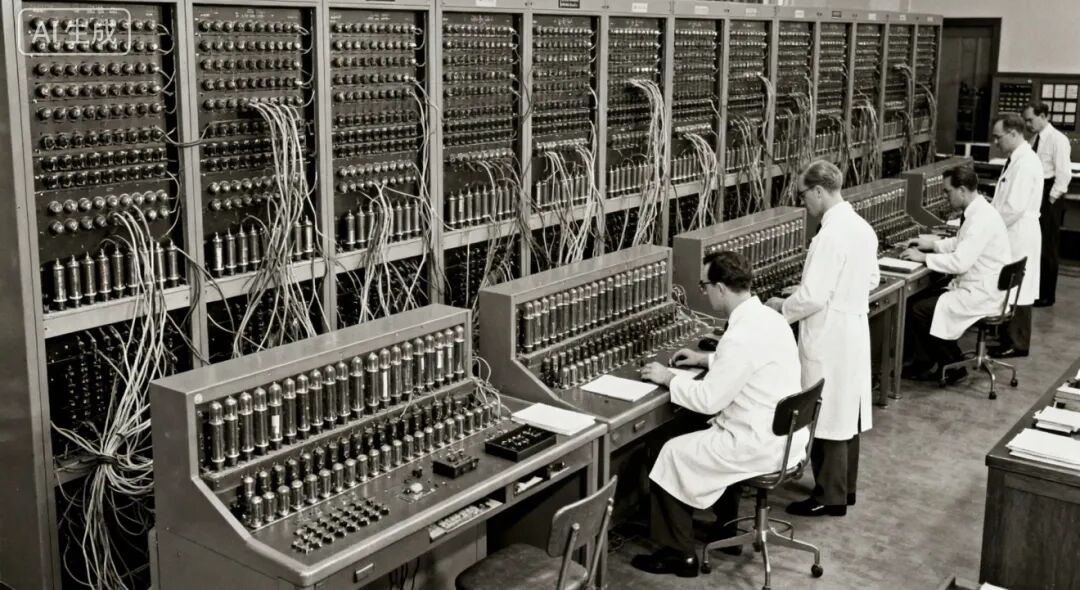

2、第一台计算机诞生

(第一台计算机诞生-图片来源于AI生成)

这催生了第一台计算机的诞生。1946年,由莫奇利和埃克特发明的计算机,革命性地解决了“快速计算、精准存储”的问题。但它存在一个关键缺陷:只会“听话”,不会“思考”。它能迅速执行一千次乘法指令,却无法思考乘法的内在规律或关联,以便未来更高效地计算。

后来,科学家们发现,人类大脑的强大之处不仅在于拥有860亿个神经元,更在于这些神经元像“亿级路由器”般互相连接,形成了极其复杂的“神经网络”。正是“神经网络”赋予大脑自我学习与提炼规律的智能能力。于是,他们设想:能否模仿神经网络,构建一个“机器神经网络”?这便构成了AI的雏形。

二、今生:AI初生期(1956-1989)

1、AI概念定义

1956年的达特茅斯会议上,约翰·麦卡锡等科学家首次提出了 “人工智能(Artificial Intelligence, 缩写为AI)” 这一专业术语,明确了 “让机器模拟人类智能” 的研究目标,标志着AI成为一门独立的学科。

那么,什么是“人工智能(AI)”?

其定义已然明确:人工智能(AI)是让机器模拟人类智能的技术总称。

随之而来的问题是:什么又是 “人类智能”?结合上一章节,我们可以简要概括为:让机器具备“感知、思考、决策、执行”的能力。

(过马路示意-图片来源于AI生成)

让我们通过“过马路”的例子,具体解释这四个环节:

- “感知”:对人类而言,我们依靠眼睛和耳朵等器官。过马路时,我们能看到红绿灯的变化,听到汽车的鸣笛声。“看”和“听”就是我们的“感知”能力,用以获取环境信息。

- “思考”:获取信息后,大脑会进行分析推理。看到红灯,我们推断出“需要等待”,这便是“思考”过程。

- “决策”:面对红灯,我们实际上有多种选择(如“闯红灯”或“等待”)。最终基于安全考量选择“等待绿灯”,这就是“决策”。

- “执行”:做出“等待”的决策后,当绿灯亮起,我们迈步走过人行道,这个身体动作过程就是“执行”。

人类的“感知、思考、决策、执行”共同构成了“智能”。但要让机器具备这些能力,首要难点是什么?最大的障碍在于机器不懂人类语言,更遑论分析、推理和思考。此时,另一个学科恰逢其时地介入:自然语言处理(Natural Language Processing, 缩写为NLP)。

2、自然语言处理(NLP)

自然语言处理(NLP) 并非AI诞生后才出现。在第一台计算机问世的1950年,图灵就提出了著名观点:“如果一台机器能通过文本对话让人类无法分辨它是人还是机器,那它就具有了智能。” 这其实正是NLP的终极目标。AI的诞生为NLP的发展提供了绝佳契机,使其成为AI早期发展最重要的辅助模块之一。

那么,究竟什么是 “自然语言处理(NLP)”?

首先,“自然语言”指的是 “人类在日常生活中自然发展和使用的语言”,如甲骨文、现代各国语言及方言等,但通常不包括编程语言。而 “自然语言处理(NLP)” 就是:让计算机能够理解、解释、操纵和生成人类的自然语言。通俗地说,就是教计算机“听懂人话、说人话、看懂文字、写出人能懂的内容”。

我们通过几个例子来简单理解:

- 人与人之间的语言沟通通常是这样的:

(图片来源于《深度学习进阶-自然语言处理》)

- 而人与动物之间,动物无法理解人类语言(这是有待突破的科学难题):

(图片来源于《深度学习进阶-自然语言处理》)

- 设想一下,借助自然语言处理(NLP),人类与机器之间可以实现沟通:

(图片来源于《深度学习进阶-自然语言处理》)

3、AI初生期案例分析

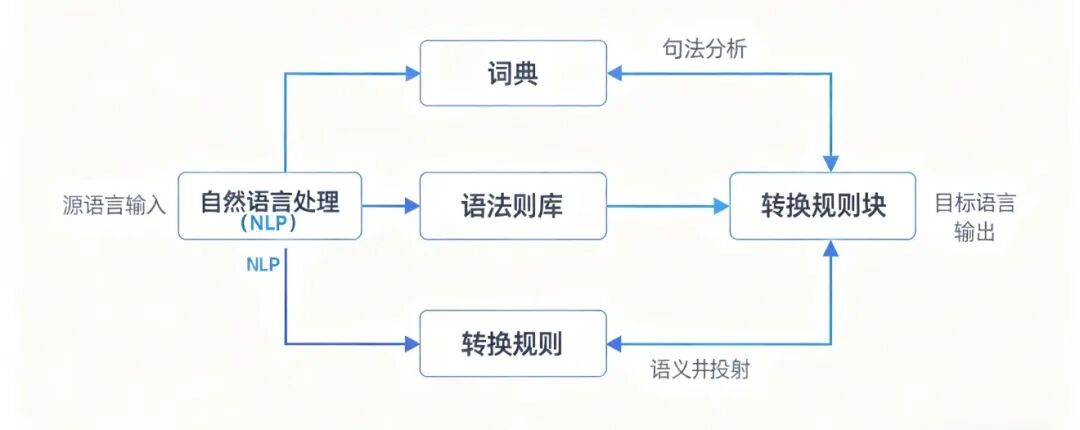

在自然语言处理(NLP) 的辅助下,AI得以在一些初步场景中应用,例如早期的机器翻译:

(早期机器翻译原理示意-图片来源于AI生成)

可以看到,早期机器翻译依赖于预先构建好的词典、语法规则库、转换规则等,这些固定的规则库决定了翻译的具体实现。

下面我们用一个具体例子来说明:

The apple is red.

这个英文句子很简单,我们看看机器翻译的原理:

第一步:查词典

计算机会将句子拆分成单词,然后在一个庞大的电子词典中查找每个词的意思。

| 英文单词 |

词典里给的主要中文意思 |

| The |

这/这个/那(通常放在最前面) |

| apple |

苹果 |

| is |

是 |

| red |

红色的 |

至此,计算机得到了一组中文词汇:【这】【苹果】【是】【红色的】。

第二步:调整顺序

计算机会应用一条简单的语法规则:英语的 [主语] + [is] + [形容词] 结构,对应中文的 [主语] + [是] + [形容词] + 的。

它发现 The apple 是主语,is 是系动词,red 是形容词,完美匹配规则。

于是,它按照规则排列这些词汇。

最终翻译结果:这苹果是红色的。

问题暴露:哪里不对劲?

这个翻译对吗?字面意思和语法似乎都对,但有一个地方不够好:

- 不地道的表达:虽然“苹果是红色的”语法正确,但在日常口语中,我们更常说“这个苹果是红的”或直接说“苹果很红”。机器无法理解这种语言习惯和微妙差异。

这个简单例子揭示了根本缺陷:

- 缺乏灵活性:机器只会死板地应用规则,无法像人一样根据语境、上下文或情感产出更贴切的翻译。

- 没有“语感”:它不知道什么样的中文听起来更地道自然,因此产出内容往往显得生硬。

4、AI初生期小结

通过这个机器翻译的例子,我们可以看到,在AI初生期(1956-1989),尽管有自然语言处理(NLP) 的加持,AI基本都是在僵硬地执行人类预设的规则,缺乏灵活性。

如果将AI比作人类,这一阶段的AI最多算是一个只会死记硬背的小学生,不懂变通。一旦遇到超出其记忆范围的内容,便一无所知。我们暂且将这一阶段的AI称为 “规则式AI”。

这也正是AI后续发展的核心驱动力。

三、今生:AI成长期(1990-2016)

在规则式AI的局限性推动下,AI进入了成长期。

1、机器学习出现

这一阶段,一个关键概念登上舞台:机器学习(Machine Learning, 缩写为ML)。

什么是机器学习?让机器从数据中自行学习规律,而不仅仅依赖人类编写的固定指令。

与之前的“规则式AI”相比,机器学习让机器不再死板。它不依赖于人类给定的规则,而是通过分析海量数据,自行寻找规律,然后加以应用。

2、AI成长期案例分析

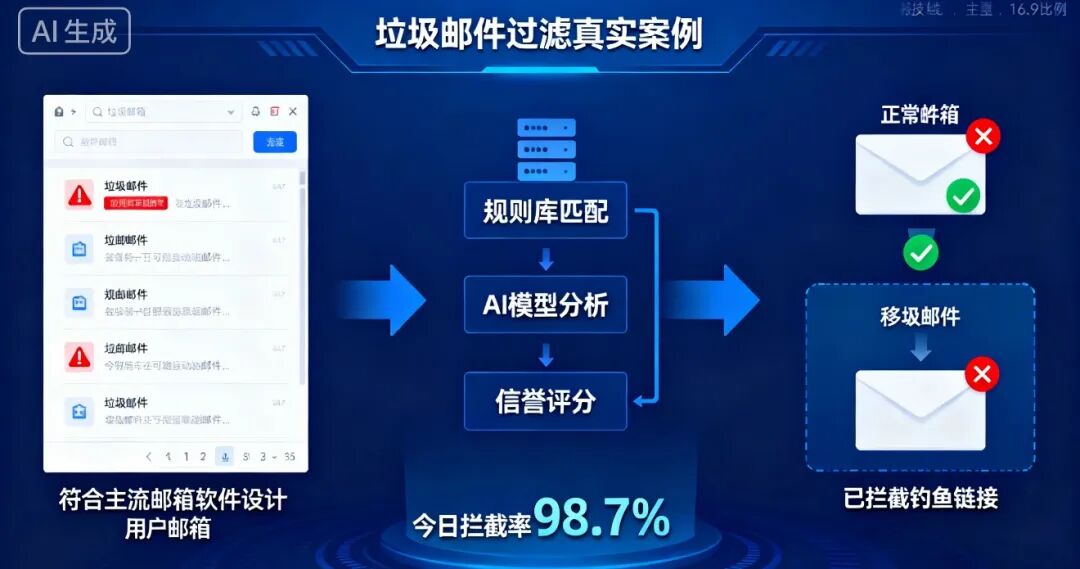

我们用一个日常工作场景中常见的例子来说明:垃圾邮件过滤系统。

(垃圾邮件示意-图片来源于AI生成)

如果在AI初生期(1956-1989),

只能按照既定规则处理,例如:

- 如果邮件标题出现“免费”,就标记为垃圾邮件。

- 如果发件人地址包含“spam”,就标记为垃圾邮件。

- 等等...

这种方法的缺点非常明显:

- 难以防范变种:例如,“免费”可能写作“免-费”或“Free”,规则即刻失效。你需要不断发现新套路,手动添加新规则。

- 可能误杀正常邮件:例如,朋友发来标题为“有个免费的讲座你想参加吗?”的邮件。

那么,在AI成长期(1990-2016),我们可以怎么做?

第一步:准备“学习资料”

你提供给机器大量已分类的邮件:

- 1000封已知的垃圾邮件(标记为“垃圾”)

- 1000封已知的正常邮件(标记为“正常”)

第二步:让机器自己“找规律”

机器开始分析这些邮件,并进行统计。

它会自动发现:

- 在“垃圾邮件”中,词语“免费”、“优惠”、“发票”出现的频率极高。

- 在“正常邮件”中,词语“会议”、“项目”、“放假”、“通知”出现的频率极高。

最终,机器形成了一套自己的判断标准。

第三步:实际运作

这时,一封新邮件到来,标题是“关于国庆放假的通知”。

机器分析邮件内容。

它发现,“放假”、“通知”这些词在其记忆里,与“正常邮件”的关联度非常高。

而“免费”、“优惠”等垃圾邮件高频词一个都没出现。

于是,机器判定:这是一封正常邮件。

(垃圾邮件技术原理-图片来源于AI生成)

通过这个案例,我们发现有了机器学习的加持,AI从“规则式”应用升级为结合“AI模型分析”,机器开始能够自己学习、自己总结规律了。

3、AI模型出现

机器通过学习总结出的规律,本质上就是 AI模型(Model)!

那么,什么是AI模型?一个通过大量数据训练出来的、能够识别特定模式或规律的数学函数或程序。 通俗地说,就是从数据中提炼出的 “规律”或“经验”本身。

AI模型的三大核心要素:

- 输入:接收新数据(如收到一封新邮件)

- 处理:运用学到的规律进行计算或判断

- 输出:产生结果(判断邮件是否为垃圾邮件)

4、机器学习方法:监督学习

我们给了机器2000封已分类(“正常”或“垃圾”)的邮件,让它根据标注好的结果去学习总结规律,这其实是机器学习的一种方法!

我们将这种方法称为 “监督学习”,即:提供给机器学习的训练数据都带有明确的“标签”(如标注好“垃圾”还是“正常”)。

当然,还存在其他机器学习方法,我们将在后续章节介绍。

5、AI成长期小结

如果继续将AI比作人类,这一阶段的AI可以看作是一个靠刷题总结规律的中学生: 例如,针对生物这门课,他刷了大量带答案的题目,能自己总结出解题方法,再遇到同类题目时便能得心应手。

通过统计大量数据总结规律,我们可以将这阶段的AI称为 “统计式AI”。

但是,一个关键问题出现了:

这位中学生刷的是某一学科的题,虽然精通此科,但可能偏科。如果遇到从未训练过的物理题,他可能依然束手无策。

回到AI成长期,虽然AI通过机器学习变得更强大——在给定数据范围内能自我学习,但一旦超出其训练数据领域,它便无能为力。这是该阶段AI发展面临的核心瓶颈,而这一瓶颈将在下一发展阶段中被打破。

四、今生:AI爆发期(2017年至今)

AI成长期的“偏科”问题亟待解决,如何让AI模型具备更广泛的知识和能力?

1、AI模型架构演进

我们仍以“垃圾邮件过滤系统”为例进行回顾和延伸分析:

如果在AI初生期(1956-1989):

按既定规则处理,如:标题含“免费”即标记为垃圾邮件。方法死板,未使用模型。

如果在AI成长期(1990-2016):

通过机器学习(监督学习) 训练出AI模型(常用“朴素贝叶斯模型架构”),让模型自行判断。看似更高效,但存在缺点:它是一个“拆词专家”,将邮件拆成零散的词,不关心词序和句义。例如,“钱转给你”和“你把钱转走”对它来说都是包含“钱”、“转”的词,无法理解前者是正常收款,后者可能是诈骗预警。

这时,RNN架构(循环神经网络)出现了:

它不再拆散邮件,而是尝试逐词阅读整个句子,并努力记住前面读过的内容。它有了初步的“上下文”概念,能理解一些简单句子结构。但关键问题在于它有“健忘症”!如果邮件很长,读到结尾时可能早已忘记开头内容,导致误判。

为了解决“健忘”问题,CNN架构(卷积神经网络)出现了:

它每次只关注相邻的几个词。例如,看到“难以置信的”和“优惠”时,能敏锐察觉这是广告短语;看到“验证您的”和“账户”,能识别可能是安全提示。这种方式效率高(可并行处理多个相邻词),擅长捕捉局部特征,变相缓解了“健忘”问题。

但存在一个关键缺陷:它无法同时关注邮件全文。 例如,一封邮件可能开头是长篇正常商务沟通,仅在结尾巧妙植入诈骗链接,它可能因前面都是正常局部信息而放过,难以理解邮件的整体逻辑和核心意图。

简单总结:以上AI模型通过架构优化,能力逐步提升,但仍存在明显缺陷:仅看关键词、处理长文效率低、缺乏全局观。

正因这些缺陷,2017年,Google研究团队发表了论文《Attention Is All You Need》,正式提出了 Transformer架构。

我们来了解Transformer架构如何工作,仍以垃圾邮件过滤为例:

假设有一封可疑邮件:“尊敬的客户,恭喜您获得10W奖金!请点击唯一链接 http://xxx.com 领取”

第一步:同时查看所有关键信息(并行处理)

以前的RNN需逐字阅读,而Transformer架构能瞬间看到所有词。

第二步:划重点并分析(自注意力机制)

它会给词与词之间建立“关联线”。例如,“奖金”与哪个词关联最强?它会发现“奖金”与“链接”、“领取”关联非常紧密。这种“中奖-链接-领取”的模式,高度符合其知识库中的“诈骗典型特征”。

第三步:全局推理,看穿意图

它理解了整封邮件的逻辑:“这是一封群发邮件,以虚假巨额奖金为诱饵,最终意图是诱导点击可疑链接。” 它理解的是整体意图,而非机械匹配关键词。

第四步:做出最终决定

它极有把握地得出结论:“这是一封钓鱼诈骗邮件!”并将其归入垃圾箱。

通过这个例子,我们看到采用Transformer架构的过滤器,通过 “自注意力机制” 做出了精准判断。所谓 “自注意力机制”,通俗理解即:模型在处理信息时,能瞬间看到所有元素,并智能判断哪些元素之间的关系更重要。

正是Transformer架构的革命性突破,成为引爆AI爆发期最关键的技术基石。

3、AI大模型出现

有了Transformer架构,AI模型得以实现革命性改进。基于此,OpenAI在2018年推出了生成式模型:GPT-1,它拥有1.17亿个参数。这里的“参数”是什么?回顾第一章,人类大脑的强大在于数百亿“神经元”构成的“神经网络”。AI模型的“参数”就类似于神经网络中的“神经元”。

此后发展迅速,OpenAI相继在2019年推出GPT-2(参数增至15亿),在2020年推出GPT-3(参数规模达到1750亿)。

随着参数规模不断扩大的AI模型出现,AI成长期模型“偏科”的问题开始得到解决,目标是让AI模型具备更通用、更强大的知识储备,以覆盖多领域。

基于此,大模型(Large Model, 缩写为LM)由此诞生!

那么,什么叫大模型?基础定义为:大规模人工智能模型。

“大规模”具体指什么?即泛指参数规模巨大的模型。通常将参数规模在10亿以上的视为入门级大模型。但发展至今(2025年),我们通常将参数规模在100亿以上的算作大模型,例如混元大模型旗下的TurboS模型参数量为5600亿。

4、大模型、中模型、小模型

既然有大模型,是否也有小模型和中模型?当然有! 下表简要比较了三者的差异:

实际上,中小模型在特定场景下也非常高效。但对于大多数读者而言,无论是工作还是生活场景,大模型的应用最为广泛,因此我们继续聚焦大模型本身。

5、大语言模型

在AI初生期,AI与“自然语言处理(NLP)”相辅相成,因为人类最初对AI的探索大多从自然语言处理切入。大模型出现后,其最初形式便是 大语言模型(Large Language Model, 缩写为LLM):

- Large(大):指参数数量巨大,同时也指训练数据量巨大。

- Language(语言):指自然语言。

- Model(模型):能识别特定模式或规律的计算模型。

2020年推出的GPT-3是名副其实的大语言模型(1750亿参数)。随后持续演进,OpenAI在2023年正式推出GPT-4(参数量更大),且更强大之处在于:GPT-3仅能处理文本,而GPT-4既能处理文本也能处理图像。类似的大语言模型还有如混元TurboS、DeepSeek等。

6、除了大语言模型还有哪些模型?

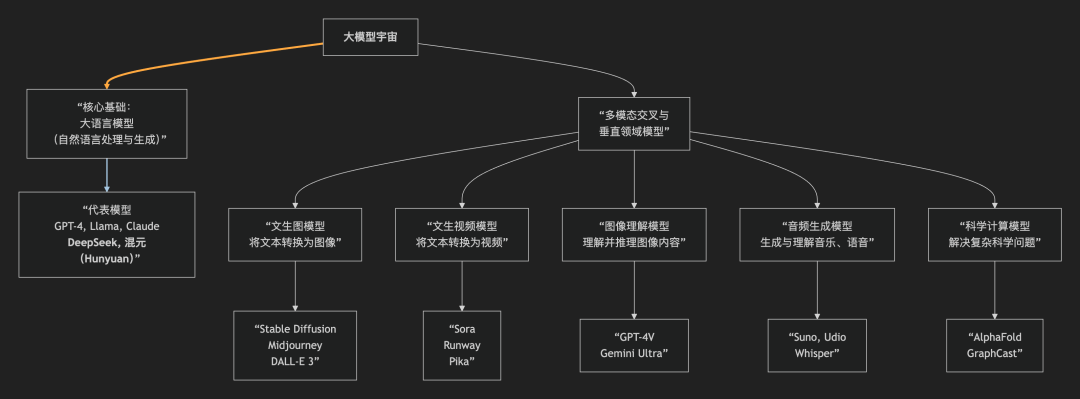

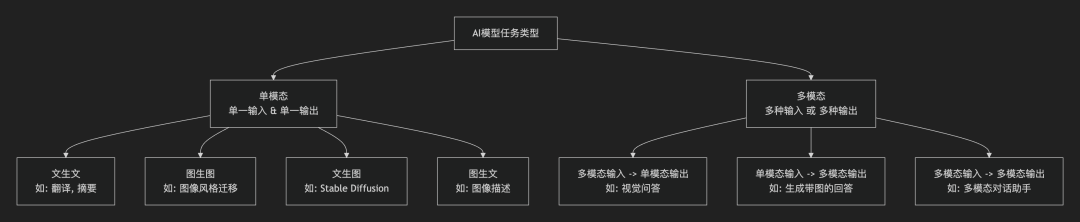

大语言模型是AI大模型早期、最核心和基础的形式。后续发展中,文生图、文生视频等模型层出不穷,类别已远超纯语言模型。下图展示了整体的大模型生态:

(大模型宇宙)

7、机器学习方法:无监督学习

回顾AI成长期,“机器学习”概念开始出现,通过机器学习(当时采用监督学习)让机器自我学习总结规律,得到AI模型。

那么,像GPT这样的大模型是如何“预训练”出来的呢?

实际上,同样运用了机器学习,但可能更“深度”。这里的“深度”主要指:在机器学习过程中包含多个层级或步骤,每一步学习不同规律,从简单到复杂,逐步深入。由于大模型参数和海量训练数据,我们不能再像以前那样仅提供少量标注数据。通用大模型需要“学习”互联网上的几乎所有知识,人工无法为每条知识标注对错,只能将海量知识“喂”给机器,让它自行总结规律,判断“正确”或“错误”(这在监督学习中本应由人工完成)。

这种机器学习方法,我们称之为 “无监督学习”。

8、深度神经网络、深度机器学习和传统机器学习

由于大模型巨大的参数量和训练量,需要更复杂的网络结构支撑。前面提到的RNN、CNN、Transformer等,都属于 “深度神经网络” 的范畴。有了深度神经网络的支撑,我们通常将大模型预训练所采用的机器学习范式称为 “深度机器学习”,也可简称为 “深度学习”。而回顾AI成长期所用的机器学习,我们可称之为 “传统机器学习”。

9、以ChatGPT、SD等案例分析

至此,大模型技术已较为成熟。不仅有GPT系列,还有Google的Gemini、百度的文心一言、阿里的通义千问以及腾讯的混元等。但对普通互联网从业者而言,这些模型似乎仍有距离,直到2023年ChatGPT正式问世!

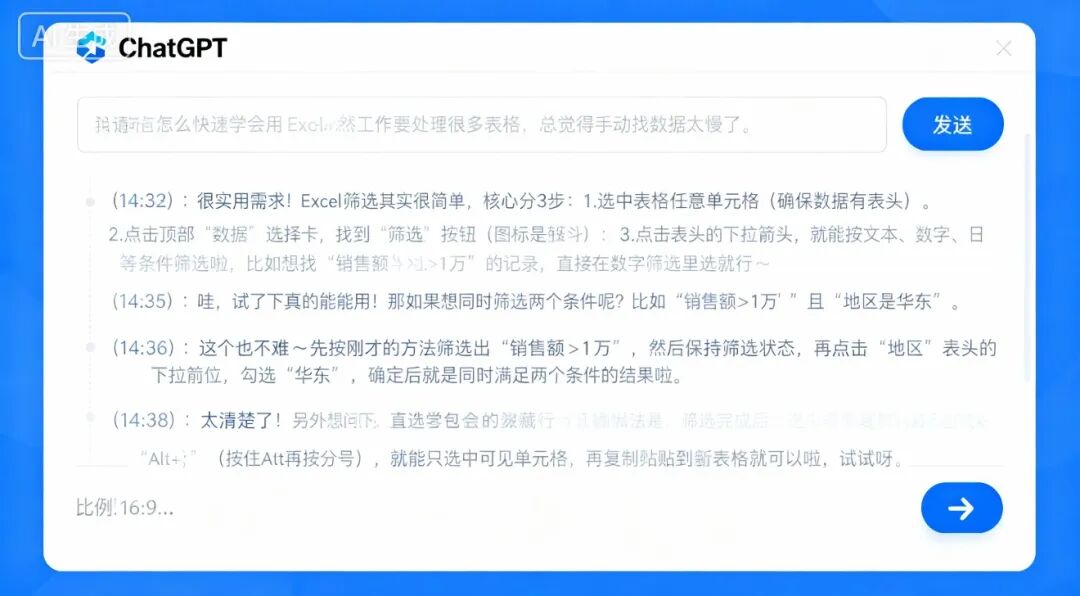

(ChatGPT聊天界面-图片来源于AI生成)

用户可以通过ChatGPT与AI对话,感受其知识的广博与强大,同时不乏趣味性。人们首次在应用层真切体会到大模型带来的帮助:可以询问任何未知领域的问题,也能让其辅助工作提效。

这奠定了近几年AI爆发的切入点:大部分基于大模型的AI应用都以对话形式呈现,如ChatGPT、豆包、元宝等,很重要的原因在于对话是最直接、最自然的交互方式。

当对话体验变得习以为常,人们或许会想:AI大模型的能力是否仅止于此?终究只是在“聊天”?

几乎与ChatGPT同期,Stable Diffusion(缩写为SD) 面世。SD是一个文生图大模型,不再是传统的文本对话,而是可以根据输入的文本生成图像(同期还有Midjourney,前者开源,后者闭源)。

(Stable Diffusion界面-图片来源于AI生成)

类似SD、Midjourney这样的文生图模型,需要输入一段文本指令来生成图像,这段文本就是 提示词(Prompt)。我们来看例子:

(Prompt:一只猫在吃饼干-图片来源于AI生成)

(Prompt:写实风格,在一个阳光明媚的早晨,一只金渐层猫在草地上,用爪子拿着一块饼干往嘴里吃-图片来源于AI生成)

10、提示词工程

提示词工程是一门与AI有效沟通的艺术。通过以上例子可以总结一个基本原则:你给AI的提示词越清晰、越具体,得到的结果就越好。掌握这项技能,能更充分地释放大模型的潜力。

通过文生图体验,我们发现基于AI大模型已不仅能生成文本,还能生成图片!

但一个关键问题随之而来:

仅通过文本输入,如何确保生成的图片完全符合预期?例如,希望生成的猫与自家宠物一模一样,仅靠文本描述很难实现...

那么,有没有解决办法?

当然有,我们直接看例子:

这是笔者家的猫(一只美短,名叫“小白”):

将“小白”的照片提供给AI大模型,同时配上一段提示词,生成相关图片:

(Prompt:写实风格,在一个阳光明媚的早晨,“小白”在草地上,用爪子拿着一块饼干往嘴里吃-图片来源于AI生成)

可以看出,生成的图片更符合预期。但请注意,我们向AI同时输入了文本和图片(小白的照片),而AI输出了一张新图片。这与之前的纯文本ChatGPT体验完全不同!(注:最新的ChatGPT已支持多模态输入,基于GPT-4o等模型)。

我们甚至可以同时输入图片和文字,让AI生成视频。

11、多模态、单模态

这种能同时处理文本和图片输入的方式,正是AI大模型的 多模态(Multimodal) 能力!

那么,什么是多模态?我们先回顾AI模型的三要素:

- 输入:接收数据

- 处理:运用规律进行思考、推理

- 输出:产生结果

我们关注输入和输出环节。可以将多模态定义为:在输入或输出端,能同时处理、理解和关联多种不同类型信息(如文本、图像、音频、视频)。上例中,大模型在输入端同时接收了文本和图像信息,经理解推理后,在输出端生成了新的图片或视频。

对应地,还有 单模态(Unimodal),即:在输入和输出端分别专注于一种类型的信息处理。例如之前提到的GPT-3、GPT-4及早期的混元TurboS等,都是单模态大模型,因为其输入输出仅限于文本。下图简要说明了“单模态”与“多模态”的区别:

(“单模态”和“多模态”对比)

12、开源、闭源

大模型除了按模态区分,另一个重要维度是“开源”与“闭源”。例如同期文生图模型既有开源的SD,也有闭源的Midjourney。那么,开源和闭源有何区别?

“开源”与“闭源”并无绝对优劣,它们共同推动了AI领域的飞速发展。开源是创新的源泉,闭源是商业化应用的标杆。对于个人尝试而言,最重要的是根据自身需求、技术能力和资源,做出最合适的选择。

13、智能体的出现

了解大模型后,我们发现无论是使用单模态的ChatGPT对话,还是用多模态的ChatGPT“文+图”生图,都已是在应用层使用AI大模型。

那么,我们能否用ChatGPT策划一次旅行并做好预算?

你: “帮我策划一次三亚旅行”

ChatGPT: “好的,为您规划一个三亚5日游的行程框架供参考...”

它可能会输出一个非常笼统的模板式行程,如:

- Day 1: 抵达三亚,入住酒店,附近海滩漫步。

- Day 2:...

你发现的问题: 这太泛泛而谈,完全没有考虑你的预算、偏好,而且信息是静态的,没有实时价格。

你: “这个行程太简单了。我需要一个更详细的计划,包括具体的航班时间、酒店名称和价格参考。我的预算人均是8000元。”

ChatGPT: “好的,基于人均8000元的预算,这是一个更详细的计划示例...”

- “航班:可选择北京-三亚的XX航空,参考价格1500元往返。”

- “酒店:可入住XX酒店海景房,参考价格600元/晚。”

你发现的问题: 价格可能是过时的,它无法联网获取实时价格;需要你自己验证信息;决策点又抛回给你。

你会发现,所有规划(先查什么、后查什么、如何取舍)都需要你来思考和发出指令。

那么,是否存在一种AI,你只需告诉它一个目标,它就能自主规划、执行,直到呈现结果?

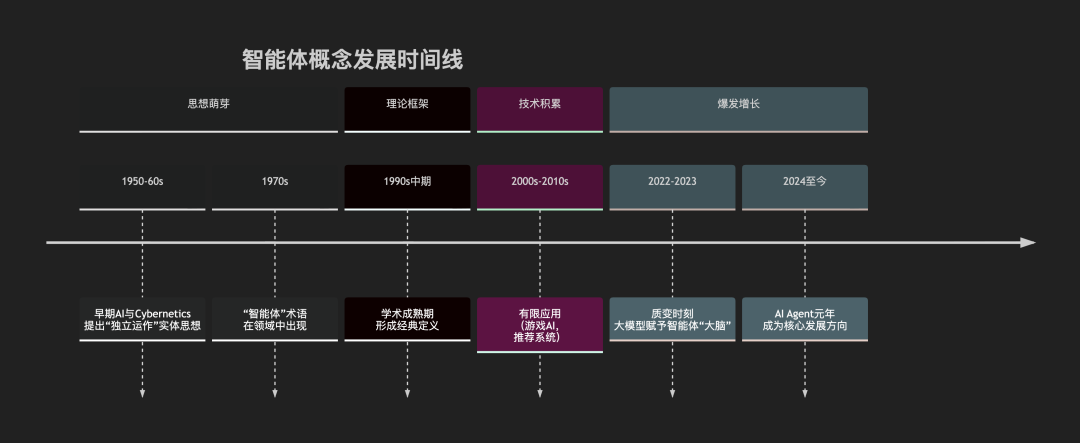

当然有,这就引出了 “智能体(Agent)” 的概念!实际上,“智能体”概念并非近年才出现,早在AI成长期之前已有基础定义(学者伍尔德里奇和詹宁斯):智能体是一个位于特定环境中的计算机系统,它能够自主行动,以实现其设计目标。

(“智能体”演进)

另一个更易理解的定义是:能够感知环境、进行决策,并自主采取行动以实现某种目标的系统或程序。

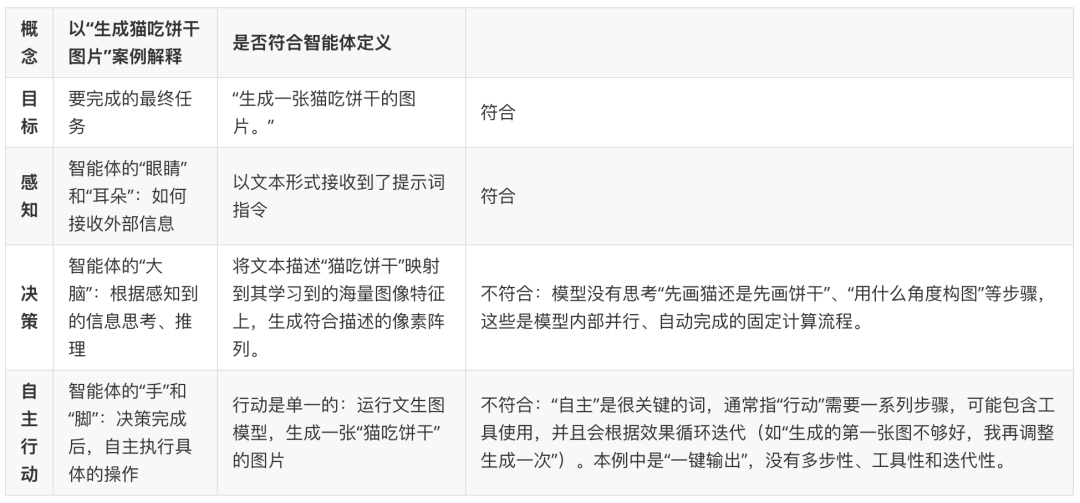

我们发现 “智能体” 的几个关键因素是:“感知”、“决策”、“目标”、“自主行动”。那么,之前我们用ChatGPT输入提示词生成一张图,这时的ChatGPT是智能体吗?我们来简单分析:

显而易见,仅通过“文生图”的ChatGPT并不算一个完整的“智能体”,最多算是“智能体雏形”,或可称为一个“应用”或“工具”。

“智能体”的“自主行动”通常较难理解,我们再通过一个生活化例子说明:

场景一:指挥一个“听话的助手”(非自主)

你对他发出系列精确指令:“小C,打开冰箱。”,“拿出西红柿和鸡蛋。”,“打开燃气灶。”... 这个助手能干,但没有自己的主意,完全依赖你的指挥。这就是“自动化”,缺乏自主行动。

场景二:交给一个“靠谱的私人助理”(有“自主行动”的智能体)

你对他说:“小王,我有点饿了,帮我做顿饭吃吧。然后你就可以去忙别的事了。”

这个“小王”(智能体)会展现出真正的“自主行动”:

- 他内心盘算:“老板饿了。我得先看看冰箱里有什么,然后决定做什么,再动手。”(感知与规划)

- 他自己决定打开冰箱查看食材。(感知)

- 他发现有意面、西红柿和牛肉,自己决定做番茄肉酱意面。(决策)

- 他自己决定步骤顺序,并能应对变化(如发现盐用完,用酱油代替;意面煮多,留作次日午餐)。(动态调整与灵活处理)

- 最终交付结果,并汇报处理情况。

我们可以简要总结, “自主行动” 即:“扔给它一个目标,它自己能制定计划、执行过程、应对变化,最终交付结果”的能力。

设想一下,如果ChatGPT在收到“生成一张猫吃饼干的图片”指令后,能主动思考:“什么猫?什么饼干?什么场景更合适?”,然后通过调用工具或方法生成多张备选图片供你选择,并可基于你的反馈持续优化。这样的方式,是“智能体”吗?

答案是:当然是! 它完美满足了“目标”、“感知”、“决策”、“自主行动”等关键维度定义。(可参考最新豆包等产品的文生图体验,它们已具备智能体特性)

聊了这么多智能体的基础定义,是为了让大家清晰理解什么是智能体。

那么,“大模型”和“智能体”究竟有何关系?

通俗地讲, 大模型 就像一个 无所不知、超级博学的大脑,而 智能体 则是拥有这个大脑后,还 拥有了手和脚(行动能力),能通过感官获取信息,经思考决策后主动完成复杂任务的 “全能机器人”。

简要总结:

- 大模型是智能体的“能力基础”:没有大模型,智能体就不会理解和思考,只能机械执行固定指令。

- 智能体是大模型的“落地延伸”:仅有大模型只能“纸上谈兵”,智能体通过搭配工具、设定目标,让大模型的能力从“说”变成“做”。

- 两者是“分工协作”:大模型负责“想清楚”,智能体负责“做到位”。

14、如何开发一个智能体应用?

如果我们想自己开发一个智能体应用,该怎么做?过程中会遇到哪些问题?

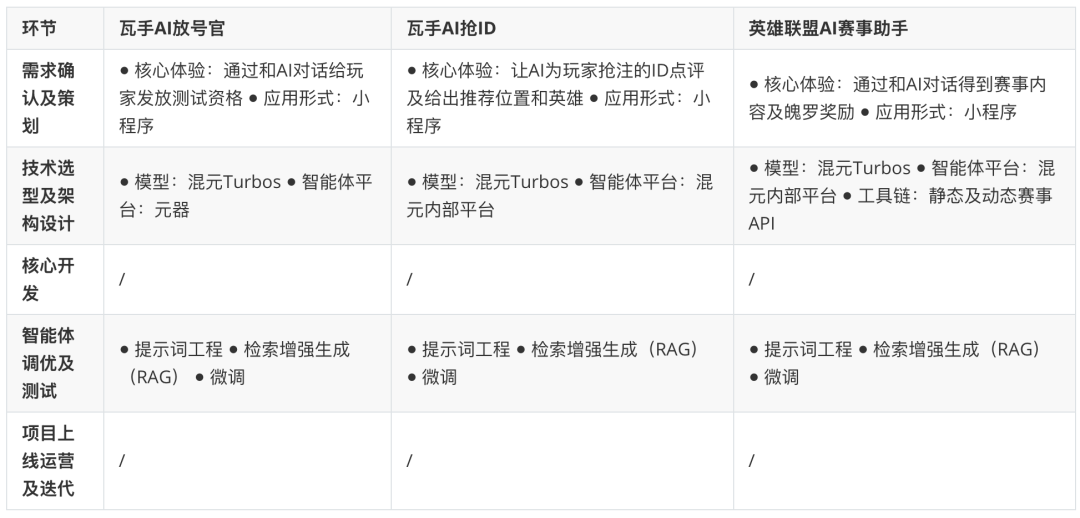

下面笔者以今年参与的三个AI项目为例简要分享,分别是:瓦手AI放号官、瓦手AI抢ID、英雄联盟AI赛事助手。

今天主要分享之前未提及的内容。以笔者负责的三个项目为例,开发一个智能体应用大致流程如下:

- 需求确认及策划:明确项目目标,想通过AI解决什么问题或提升什么体验。

- 技术选型及架构设计:选择大模型(智能体的大脑)、智能体平台/框架、工具链。

- 核心开发:具体开发过程。

- 智能体调优及测试:采用何种方法调优智能体?

- 项目上线运营与迭代:持续运营及优化迭代。

将三个案例按此流程简要分析:

大家会发现,开发智能体项目最关键环节在于需求确认及策划、技术选型及智能体调优。而智能体调优又是重中之重。

为什么“智能体调优”最重要?因为AI智能体应用的效果是否符合预期,极大程度上取决于调优是否到位。上述三个项目的调优方法基本一致,说明对于大部分智能体应用,调优方法具备一定通用性。提示词工程前文已提及,我们重点关注两个新出现的专业术语:“RAG”和“微调”。

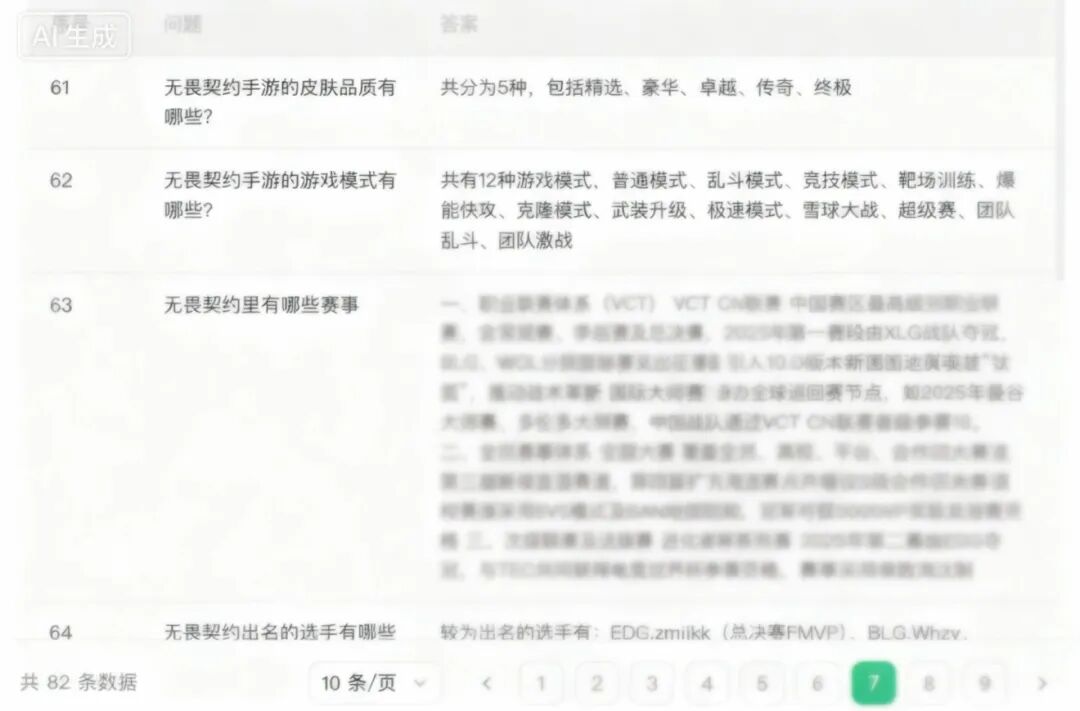

15、检索增强生成(RAG)

检索增强生成(Retrieval-Augmented Generation, 缩写为RAG),拆分解释如下:

- 检索:从外部知识库中查找与问题相关的信息。

- 增强:用检索到的信息来“增强”或“补充”大模型的知识。

- 生成:大模型基于这些补充信息,生成更准确、可靠的答案。

通俗易懂的解释是:智能体的大脑(大模型)在输出内容前,先让它主动去一个庞大的知识库(如文档、数据库、互联网)中“查阅资料”,然后根据查到的资料来组织和生成答案。

如果一个智能体没有RAG,就像一个闭卷考试的学生,只能依靠记忆(预训练知识)答题。一旦问题超纲,就可能答错或“胡编乱造”。

如果给智能体加上RAG,就像一个开卷考试的学生,遇到问题时可以先翻阅教科书和笔记(检索外部知识库),然后结合自身理解(模型推理能力),写出有据可查、内容准确的答案。

(瓦手AI项目建立的知识库-小部分示意)

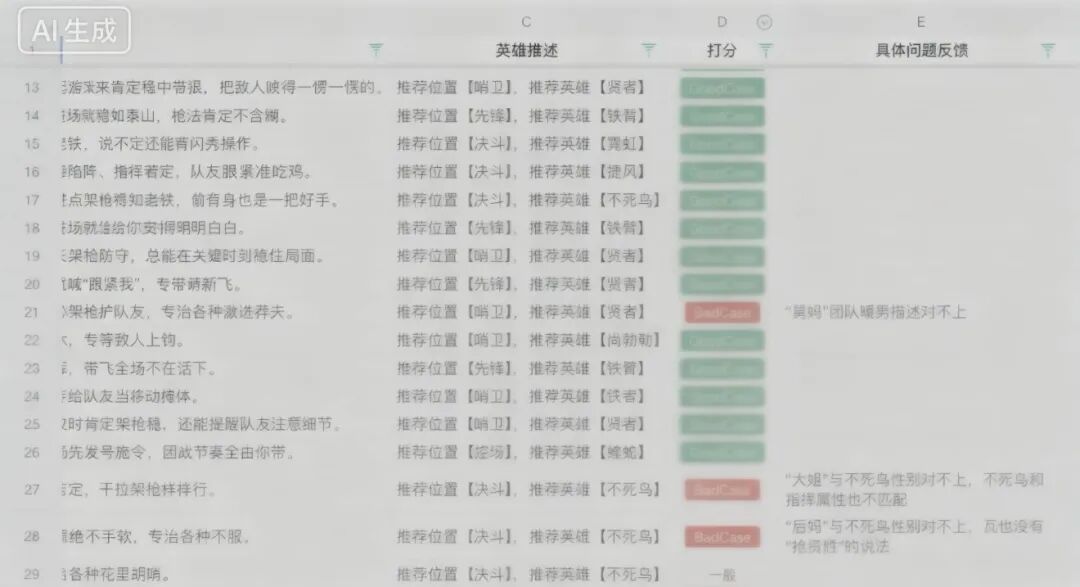

16、微调:基于监督学习和强化学习

在智能体调优中,提示词工程、RAG等方法主要改变的是模型的输入阶段。要更好地优化输出,还需用到:微调。提示词、RAG改变了输入环节,而微调则本质上是改变AI模型本身(对于开源模型是调整模型副本参数,对于闭源模型则可能是调整其“适配层”)。

(瓦手AI项目基于人工反馈的监督学习)

而强化学习则是让智能体通过试错,自己学会一整套“决策链”或“策略”,以最大化长期奖励。

我们以训练狗狗的例子说明强化学习:

- 小狗听到指令“坐下”。

- 它尝试趴下(动作)。

- 驯兽师没有给零食(无奖励)。

- 小狗又尝试坐下(新动作)。

- 驯兽师立刻给予零食(奖励)。

通过无数次尝试,小狗学会了策略:听到“坐下”指令时,执行“坐下”动作能最大化获得零食的长期收益。

监督学习是给模型标准答案(标注好坏案例)。但当数据量极大时,人工标注不现实。基于人工反馈的强化学习(RLHF) 则是更高效的方法:训练一个评分奖励模型,让AI学习这个评分标准,通过不断学习生成高分结果,从而达到预期效果。

以上智能体调优方法,目的都是让AI应用更符合预期,例如回答更准确、更富趣味性。

17、大模型的幻觉问题

然而,项目过程中仍会发现AI回答并非100%正确,这就是大模型的 “幻觉”问题:大模型生成看似合理但事实上错误、荒谬或虚构信息的行为,简单说就是AI在一本正经地胡说八道。

上述智能体调优方法,一定程度上正是为了缓解“幻觉”问题。幻觉产生的主因是,当期待AI输出的内容超出其认知边界时,它可能开始编造或出错。

除了RAG、提示词工程、微调等方法,我们还可以采取其他策略来提升准确性:

- 答案溯源:要求模型在生成答案时,注明引用的源文,便于二次校验。

- 自我批判:让模型对自己生成的答案进行一次自我审查。

- 高准确性信息采用固定信源:例如,让AI赛事助手查询固定的赛事接口数据,而非进行开放式联网搜索。

简要总结:幻觉是当前大模型的通用问题。我们所有的调优手段(RAG、提示词工程、监督微调、RLHF等),其重要目标之一就是最大限度地管理和减少幻觉,但尚无法完全根除。因此,除了优化AI输入,对AI的输出也应保持审慎态度,这是每位AI从业者应有的重要意识。

18、AI爆发期小结

AI爆发期,从2017年至今短短数年,经历了飞速发展。大模型百花齐放,智能体应用层出不穷。这一阶段(也是我们正在经历的)的AI,可以看作是一个读遍天下书的大学生,拥有丰富的知识积累和一定的实践经验。下一阶段,它将走向社会,成为职场专业人员,将知识与经验更好地应用于实际场景。我们可以将这阶段的AI称为 “深度学习/大模型AI”。

五、未来

不知大家是否关注了2025英伟达GTC大会,其中揭示了AI未来更具想象空间的模块,如AGI(通用人工智能)、具身智能、量子计算、6G、人机协同等,感兴趣的同学可以深入了解。

笔者也分享个人的AI观:从历史时间线看,AI发展已数十年,但真正爆发仅近几年。其背后是数据、算力、算法三大要素的逐渐成熟:

- “数据”:几十年来,生活、工作方式全面数字化,积累了海量数据。

- “算力”:云计算、GPU等持续迭代革新,为AI提供了坚实基础支撑。

- “算法”:以 Transformer架构 为代表的深度学习技术为大模型提供了无限可能。

在这三大要素加持下,AI从最初的自然语言处理,扩展到对多维物理世界(图像、视频、音频等)的处理。应用形态也从最初的内容生成(AIGC),扩展到辅助办公(编码、美术、产研提效等),再到各垂直行业(医疗、教育等)的初步探索。

在整个发展历程中,

AI从最初的 “规则式AI” 演进为 “统计式AI”,再发展到今天的 “深度学习/大模型AI”。

若将AI想象成人类,它也从小学生成长为了大学生。

而大部分互联网从业者可能还停留在AI的应用层面,或看到AI出现便急于尝试。但更多时候,我们需要思考的是:为什么要用AI?AI现在能做什么以及未来能做什么?用了AI能改变什么?如果不用AI又会怎样?

在未来,AI将不再仅仅是一个工具,更是我们重要的“伙伴”。技术的演进永无止境,更多前沿的探索与实践,可以在 云栈社区 这样的技术交流平台中找到灵感与答案。