Linux I/O 是操作系统与外部设备(如磁盘、网卡)进行数据交互的核心机制,其性能直接决定了系统的整体吞吐量与响应速度。理解其工作原理对于开发高性能应用至关重要。

一、传统 System Call I/O

传统 System Call I/O 是 Linux 最基础、最通用的 I/O 模式,适用于绝大多数简单 I/O 场景。其核心特征是通过系统调用触发内核态与用户态的交互来完成数据传输。

1. 核心调用

通过 read() / write() 系统调用完成核心数据交互。此外,open()(打开文件描述符)、close()(关闭文件描述符)、lseek()(调整读写偏移)等系统调用辅助完成 I/O 操作,构成了完整的 I/O 调用链路。

2. 总开销

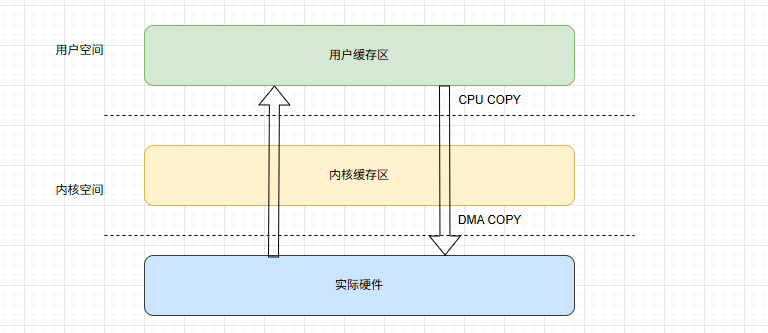

传统 System Call I/O 的性能瓶颈主要源于较高的传输开销,其总开销可以概括为:4次数据拷贝(2次CPU拷贝+2次DMA拷贝)+ 4次上下文切换。这一开销直接决定了它在高并发、大数据量场景下的性能局限性。

3. 关键概念

- CPU拷贝:由 CPU 直接负责数据的读取与写入。数据从一个内存区域(如内核缓冲区)直接传输至另一个内存区域(如用户缓冲区),此过程会占用 CPU 计算资源,影响系统并发处理能力。

- DMA拷贝:即 Direct Memory Access(直接内存访问)拷贝。CPU 仅需向 DMA 控制器发送数据传输指令,后续的数据传输(如磁盘→内核缓冲区)则由 DMA 控制器独立完成,无需 CPU 参与,可显著降低 CPU 负载。

- 上下文切换:指系统调用触发的用户态 ↔ 内核态切换。每次

read() 或 write() 调用,都会从用户态切换至内核态(内核执行数据读取/写入逻辑),完成后再切换回用户态,单次系统调用触发 2 次上下文切换。

二、传统I/O 读/写操作流程与开销

传统 I/O 的读、写操作流程遵循固定链路,不同场景(磁盘、网络)的流程核心一致,仅数据的起始/终点不同。

1. 读操作(以磁盘读为例)

- 流程拆解:用户程序在用户态调用

read() 系统调用 → 触发上下文切换(用户态→内核态)→ 内核发起磁盘读请求,由 DMA 控制器将磁盘数据读取至内核 Read Buffer → CPU 将内核 Read Buffer 中的数据拷贝至用户态 Buffer → 触发上下文切换(内核态→用户态),用户程序获取数据并继续执行。

- 核心开销:2 次上下文切换、1 次 DMA 拷贝(磁盘→内核Read Buffer)、1 次 CPU 拷贝(内核Read Buffer→用户态Buffer)。

- 补充逻辑:数据读取时会优先检查页缓存(PageCache),若数据已命中,则直接读取;若未命中,则先将数据从磁盘加载至内核缓存,再通过 CPU 拷贝至用户态 Buffer。

2. 写操作(以网络写为例)

- 流程拆解:用户程序在用户态调用

write() 系统调用 → 触发上下文切换(用户态→内核态)→ CPU 将用户态 Buffer 中的数据拷贝至内核 Socket Buffer → DMA 控制器将内核 Socket Buffer 中的数据拷贝至网卡 NIC,由网卡发送至网络 → 触发上下文切换(内核态→用户态),用户程序完成写操作。

- 核心开销:2 次上下文切换、1 次 CPU 拷贝(用户态Buffer→内核Socket Buffer)、1 次 DMA 拷贝(内核Socket Buffer→网卡NIC)。

3. 网络I/O与磁盘I/O的共性与差异

两者均基于传统 read()/write() 系统调用流程,核心链路与开销计算完全一致。唯一差异在于数据的最终终点不同:

- 网络I/O:数据最终传输至网卡,用于网络通信。

- 磁盘I/O:数据最终传输至磁盘(写操作)或从磁盘读取(读操作),用于文件存储。

三、高性能I/O优化技术

传统 I/O 的高开销限制了系统在高并发、大数据量场景下的性能,因此 Linux 提供了多种高性能 I/O 优化技术,核心目标是减少不必要的开销。

1. 零拷贝(Zero-Copy)

核心目标是减少数据的 CPU 拷贝次数。通过内核优化,让数据直接从内核缓冲区传输至目标设备(如网卡),跳过用户态与内核态之间的 CPU 拷贝。常见实现方式包括 sendfile()、mmap()(间接实现零拷贝)等,适用于文件服务器、视频流传输等大数据量传输场景。

2. 多路复用(I/O Multiplexing)

核心目标是用单线程(或少量线程)处理多个 I/O 连接,避免为每个连接创建独立线程,从而减少线程切换开销。通过内核提供的复用机制(如 select()、poll()、epoll()),监听多个 I/O 文件描述符,当某个描述符就绪时再触发对应的 I/O 操作。其中 epoll() 是 Linux 主流复用机制,适用于高并发网络场景,如 Web 服务器。关于网络编程的更多底层知识,可以在 云栈社区 的网络/系统板块找到深入的讨论。

3. 页缓存(PageCache)

页缓存是 Linux 内核提供的文件缓存机制,核心作用是减少磁盘 I/O 次数,提升数据读取效率。

- 定位:属于操作系统层面的文件缓存,以页(Page)为单位(Linux 默认页大小为 4KB),缓存磁盘文件的内容,存储在内核空间。

- 读策略:数据读取时,优先查询 PageCache。若数据命中,则直接从 PageCache 读取,无需访问磁盘;若未命中,则从磁盘读取数据,并预读后续若干页的数据存入 PageCache。

- 写策略:数据写入时,并非直接写入磁盘,而是先写入 PageCache,并将对应的页标记为脏页,再由内核的

flusher 线程异步将脏页数据回写至磁盘。

- 脏页回写触发条件:系统空闲内存不足、脏页存在时间超时、用户主动调用

sync() 或 fsync() 时。

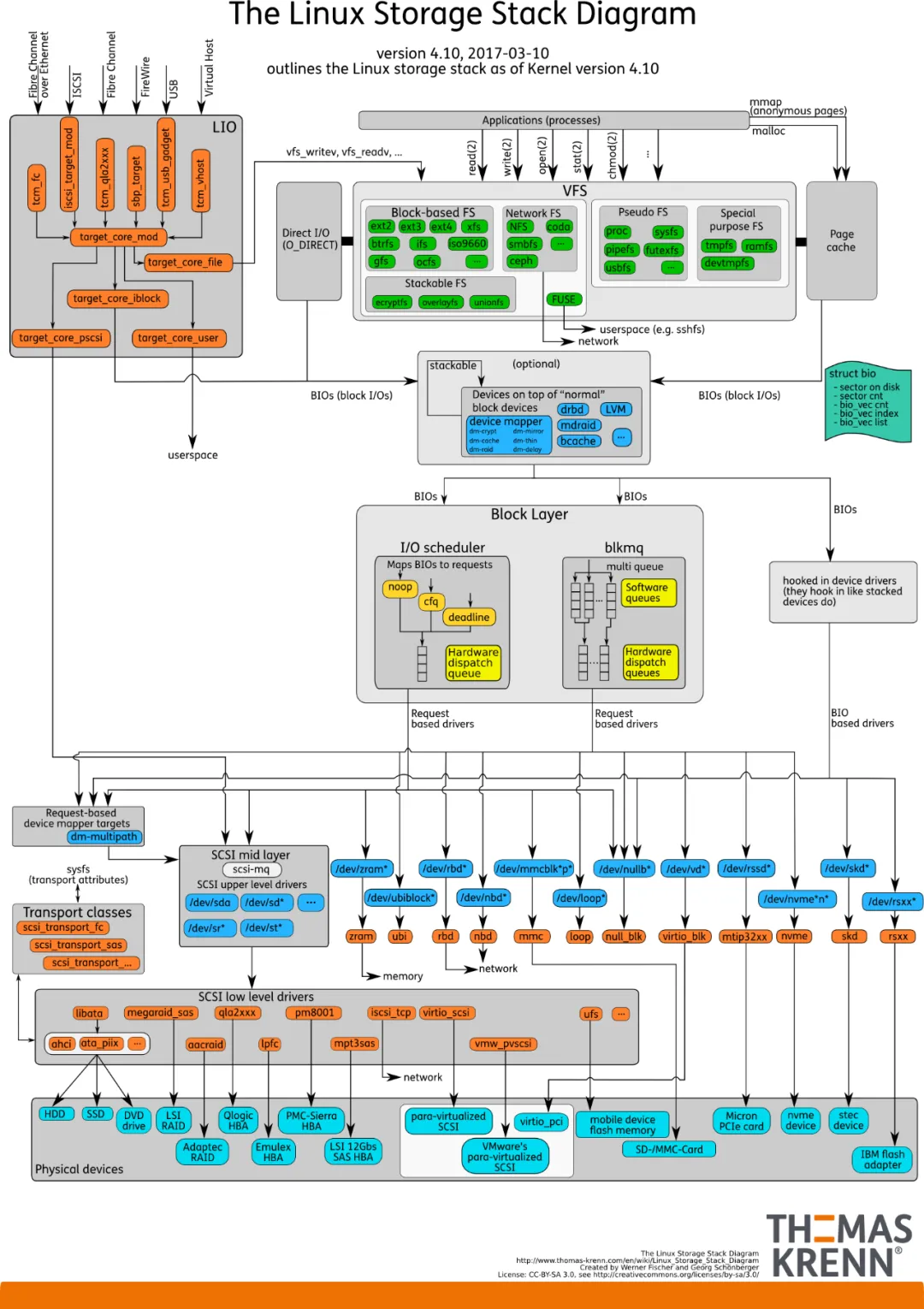

四、Linux 存储设备I/O栈(三层结构)

Linux 存储设备的 I/O 传输通过分层架构(I/O 栈)实现,确保操作的标准化与可扩展性,整体分为三层。

1. 文件系统层(FileSystem Layer)

I/O 栈的最上层,对接应用程序,负责文件的组织与管理。应用程序的 I/O 请求首先到达该层,该层将数据拷贝至自身的文件系统 Cache(与 PageCache 关联),再将处理后的请求向下传递。

2. 块层(Block Layer)

I/O 栈的中间层,是连接文件系统层与设备层的核心。该层以“块”为单位处理 I/O 请求,核心功能包括:管理 I/O 请求队列、对多个请求进行合并与排序(I/O 调度),最终将优化后的请求传递至设备层。

3. 设备层(Device Layer)

I/O 栈的最下层,对接存储硬件设备。该层通过设备驱动程序与硬件设备通信,接收块层传递的 I/O 请求,通过 DMA 控制器完成设备与内存之间的数据传输。

五、核心I/O机制对比

Linux 提供了多种 I/O 机制,适用于不同的业务场景,核心差异在于数据传输路径与拷贝次数。

1. 传统Buffered IO(缓冲I/O)

- 核心流程:磁盘数据 → DMA拷贝至 PageCache → CPU拷贝至用户态 Buffer → 应用程序读取。

- 核心特点:读写操作灵活,支持任意偏移量和长度;存在 2 次数据拷贝(1次DMA+1次CPU),开销中等。

- 适用场景:普通文件读写、小数据量 I/O、对性能要求不高的场景。

2. mmap(内存映射I/O)

- 核心原理:通过

mmap() 系统调用,将内核态的 PageCache 直接映射到用户态的地址空间,使应用程序可直接访问 PageCache 中的数据,无需 CPU 拷贝。

- 核心优势:省略了 PageCache → 用户态 Buffer 的 CPU 拷贝,仅保留 1 次 DMA 拷贝,提升大数据量传输性能。

- 核心限制:数据传输需按页对齐;映射区域大小受限于可用内存。

- 适用场景:大数据量文件读写、进程间共享内存、数据库索引读取。

3. Direct IO(直接I/O)

- 核心原理:跳过内核态的 PageCache,应用程序直接对接块 I/O 层,通过 DMA 控制器将数据在用户态 Buffer 与磁盘间直接传输。

- 核心优势:无需写入 PageCache,减少内核缓存占用,避免缓存同步开销。

- 核心限制:数据传输需按存储块大小/页对齐;应用程序需自行管理缓存,开发复杂度高。

- 适用场景:数据库、大数据处理等具备自研缓存机制的应用。

六、I/O Buffering(双层缓冲机制)

Linux I/O 存在双层缓冲机制(用户态缓冲+内核态缓冲),核心目的是减少系统调用次数、降低 I/O 开销。

1. 用户态缓冲(stdio buffer)

由 C 标准库(stdio)实现,属于应用程序层面的缓冲,核心作用是聚合小粒度的读写操作,减少系统调用次数。

- 缓冲策略:默认情况下,stdio 缓冲会缓存一定量的数据,当缓冲满、触发

fflush() 函数或关闭文件时,才会将缓冲中的数据一次性写入内核态缓冲。

- 配置方式:支持通过

fflush() 主动刷新缓冲,通过 setbuf() 函数配置缓冲大小或关闭缓冲。

2. 内核态缓冲

由 Linux 内核实现,分为两种类型:

- PageCache(页缓存):缓存文件内容,与文件系统强相关,是内核态缓冲的核心,用于优化文件读写性能。

- BufferCache(块缓存):缓存磁盘设备块数据,包括文件系统的元数据等,与文件系统无关,主要用于优化磁盘块的读写效率,减少磁盘寻道次数。

掌握以上 Linux I/O 的核心知识,能够帮助我们更好地理解系统如何与外部设备高效交互,并为后续的高性能应用开发与系统优化打下坚实的基础。