作为优秀的个人智能体平台,OpenClaw 的强项在于其灵活的 Skills 生态和高效的大模型决策能力。它易于在个人电脑上部署,并能接入飞书等常用工具,提供便捷的智能体验。然而,其内置的默认记忆插件基于文件记录,会无差别地保存所有操作细节。这不仅导致 Token 消耗过大、增加成本,还存在记忆不筛选、缺乏重点等问题,某种程度上成了 OpenClaw 的一个“性能短板”。

与其在原生的记忆系统里反复调试,不如考虑重构其记忆体系。openclaw-mem0-plugin 插件应运而生,它将记忆接入专门的 Mem0 服务,实现了记忆的精确检索与自动捕捉,有效减少了 Token 消耗,并支持跨会话、跨 Agent 的统一管理。插件安装配置简单快捷,本文将带你了解 OpenClaw 原生记忆的原理,并手把手教你安装和体验这款插件,为你的智能体提供一个更强大、更企业级的内存选择。

一、OpenClaw 原生记忆系统实现原理

1.1 为什么需要“记忆层”

传统的基于 LLM 的 Agent,每个请求都是“无状态”的:上下文只存在于当前 prompt 中,一旦会话结束或上下文被压缩,之前的细节便无法找回。OpenClaw 的目标是支持长期运行的智能体,因此必须提供一个跨会话、可编辑、可回溯的记忆层,而不是把所有信息都塞进临时的对话窗口里。

OpenClaw 的设计哲学是:把记忆当成工作区里的普通文件。所有持久化记忆都写入 Markdown 文件,再通过本地索引和检索,将关键片段重新提供给 LLM,而非强依赖外部云服务或复杂的向量数据库集群。

1.2 文件优先与本地优先的记忆架构

OpenClaw 的记忆系统分为“文件层”和“索引层”:文件层用 Markdown 组织知识,索引层则用 SQLite + FTS5 + 向量扩展进行检索,构成典型的 file‑first、本地优先 架构。

- 文件是真实来源(source of truth):在编辑器里能看到的 Markdown 内容,就是模型可能“记住”的东西;模型不会将信息悄悄存入某个不可见的数据库。

- 本地优先:默认只依赖本地文件系统和 SQLite,向量检索通过

sqlite-vec 这类库嵌入 SQLite 完成。这降低了部署门槛,也便于将整个工作区纳入 Git 进行版本管理和备份。

1.3 记忆文件的层次:长期、短期与会话

在文件层,OpenClaw 主要有三类与记忆相关的内容:

- 长期精选记忆

MEMORY.md

用于存放相对稳定的事实,如:你的姓名、技术偏好、常驻项目、重要决策等。通常由 Agent 或用户手动维护,内容量不大,但对质量要求高。

- 每日日志

memory/YYYY-MM-DD.md

每天自动或半自动追加的工作日志,记录当天的操作、临时决策、踩坑过程、TODO 等,更接近“工作记忆”。新会话启动时会优先读取最近一两天的日志,为当日工作提供上下文。

- *会话日志 `sessions/.jsonl`**

以 JSONL 格式记录完整的对话树(用户消息、工具调用、压缩摘要等),供索引层选择性纳入检索。相当于“原始事件流”,可被二次加工为更结构化的记忆。

通过配置,可以选择是否将 sessions 日志也加入记忆索引,从而在“稳定的长期记忆”和“带噪声的完整对话历史”之间进行权衡。

1.4 索引与混合检索:SQLite + 向量搜索

在索引层,OpenClaw 内置了一个 Memory Search 子系统,默认使用 SQLite 作为存储后端:

- Markdown 分块与嵌入

- 按行将 Markdown 切成大小约 400 tokens、重叠约 80 tokens 的块,尽量保证语义完整。

- 为每个块计算哈希并缓存嵌入向量,避免重复计算。

- 嵌入可以来自本地 GGUF 模型(通过

node-llama-cpp)、OpenAI text-embedding-3-small 或 Gemini 等,支持批处理和失败重试。

- 文本检索(BM25)

借助 SQLite 的 FTS5 虚拟表,对 chunk 文本进行全文索引,适合搜索错误码、变量名、路径等“硬 token”。

- 向量检索

若环境安装了 sqlite-vec,会在 SQLite 内建一个向量虚拟表,按向量相似度找出与查询最接近的若干块,用于语义级别的“相似记忆”查找。

- 混合排序

默认启用混合检索:向量分数和 BM25 分数按可配置权重混合,既能找出语义类似的片段,又不丢失对精确关键词的敏感度。

整体来看,它是一个“单机版 RAG 引擎”,专门针对 Markdown 工作区做了工程优化,非常适合个人或单机 Agent 的长期记忆场景。

1.5 与 Agent / 工具链的集成

在 Agent 侧,OpenClaw 将记忆能力暴露为工具,最典型的是:

memory_search:给定自然语言查询,在 MEMORY.md、memory/*.md(以及可选的 sessions)中检索相关片段,并将结果作为结构化对象返回。系统提示会明确告诉模型:凡是涉及历史决策、长期偏好或之前提过的信息,回答前应先调用此工具。memory_get:按路径和行号精确读取某段 Markdown 内容,帮助模型“按需展开”,避免一次性将整篇长文塞入上下文。

此外,OpenClaw 还引入了类似“预压缩记忆冲刷”的机制:当会话上下文接近模型的 context 上限时,会静默触发一个内部交互,请模型把当前对话中真正重要、值得长期保留的事实写入当天的 memory/YYYY-MM-DD.md,以降低后续上下文被裁剪时的信息损失。

1.6 记忆后端插件化与 LanceDB 插件

虽然内置的文件 + SQLite 方案已足够好用,但 OpenClaw 仍然为记忆后端预留了插件接口。默认情况下,memory_search 工具由核心插件 memory-core 提供,也可以通过配置切换到其他后端。

近期官方示例重点介绍了一个 LanceDB 驱动的第三方插件 memory-lancedb:它将记忆存储在 LanceDB 中,提供更丰富的多模态和向量检索能力,并在工具层暴露 memory_recall、memory_store、memory_forget 等接口,用以演示“把记忆完全外置”的可能性。

openclaw-mem0-plugin 正是沿着同一条思路,将底层记忆后端替换为 Mem0,而不改变上层 Agent 的工作方式。

二、openclaw-mem0-plugin 插件:为 OpenClaw 引入 Mem0 长期记忆

2.1 Mem0 简介与集成思路

Mem0 是一个专注于“LLM 长期记忆”的开源/云端服务,它在 LLM 之上增加了一个专门的记忆层:负责从对话中抽取结构化事实、进行去重与合并、存入向量库,并在每轮对话前根据当前 query 自动召回相关记忆。

openclaw-mem0-plugin 的目标,正是将 Mem0 变为 OpenClaw 的一个记忆后端:

- 对上:以 OpenClaw 插件形式接入 Agent 生命周期,在每轮对话前后执行自动召回(auto-recall)和自动记录(auto-capture)。

- 对下:将所有持久化记忆存储在 Mem0 后端(云端或自托管),不再依赖本地 SQLite;对于 OpenClaw 而言,记忆就像一个独立的、可跨会话、跨进程甚至跨机器共享的服务。

2.2 安装方式

openclaw-mem0-plugin 以 OpenClaw 插件形式发布,安装流程与其他插件类似:

-

确保 OpenClaw 已安装

本地至少需要能正常运行 Gateway 和一个 Agent,可通过 openclaw status 命令确认环境正常。

-

安装插件包

openclaw plugins install @xray2016/openclaw-mem0-plugin

该命令会从 npm registry 安装插件,并在本地插件目录(通常位于 ~/.openclaw/plugins)下注册。

注意:当前插件仓库为临时仓库,后续安装请参考火山引擎官方文档。

-

准备 Mem0 侧配置

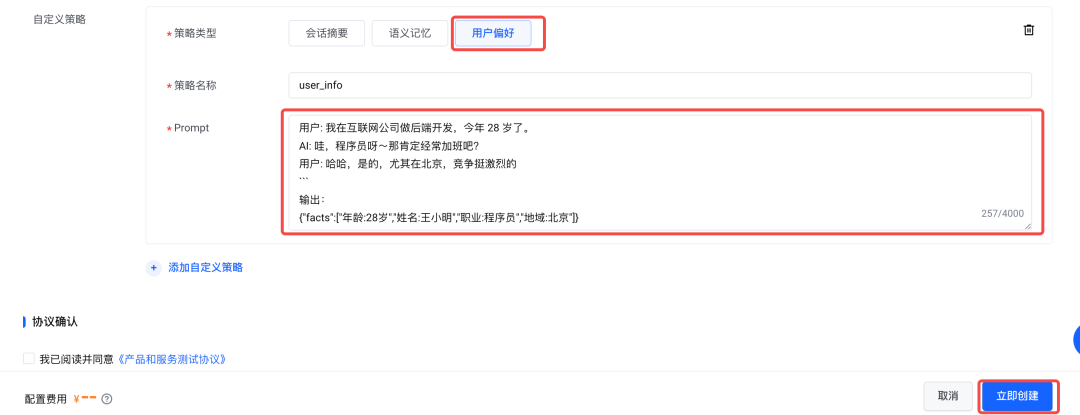

如果使用 Mem0 Cloud,需要在控制台创建项目,获取 API Key 并记录服务地址。详细步骤可参考官方文档。创建项目时,推荐填入如下 Prompt 来引导 Mem0 提取用户姓名、职业等基本信息,也可根据实际场景自定义:

你是一个用户基础信息的提取专家,要求从一段对话中提取用户的基本信息(包括姓名、年龄、性别、地域等),并按照指定格式返回

比如:

AI: 你好呀~最近过得怎么样?

用户: 还行吧,我叫王小明,最近工作有点忙。

AI: 你好,小明!😊 你是做什么工作的呀?

用户: 我在互联网公司做后端开发,今年 28 岁了。

AI: 哇,程序员呀~那肯定经常加班吧?

用户: 哈哈,是的,尤其在北京,竞争挺激烈的

输出:

{"facts":["年龄:28岁","姓名:王小明","职业:程序员","地域:北京"]}

-

修改 OpenClaw 配置启用插件

在 ~/.openclaw/openclaw.json 或对应 Agent 的配置文件中,为插件增加配置条目。

2.3 插件配置示例

平台模式是最简单的接入方式——将所有记忆存储和检索工作交给 Mem0 云端服务:

// ~/.openclaw/openclaw.json 片段

{

"plugins": {

"entries": {

"openclaw-mem0-plugin": {

"enabled": true,

"config": {

"mode": "platform", // 使用 Mem0 Cloud

"apiKey": "your_api_key", // 从 Mem0 控制台获取

"userId": "openclaw-user", // 用于区分不同终端用户

"host": "mem0_platform_addr" // mem0 服务地址

}

}

}

}

}

常见的配置建议:

userId 由用户自定义,用于保证不同使用者之间的记忆隔离。host 和 api_key 可从 Mem0 控制台获取。

配置完成后,重启 Gateway 即可让 Agent 拥有跨会话的 Mem0 长期记忆能力。

openclaw gateway restart

2.5 记忆插件验证

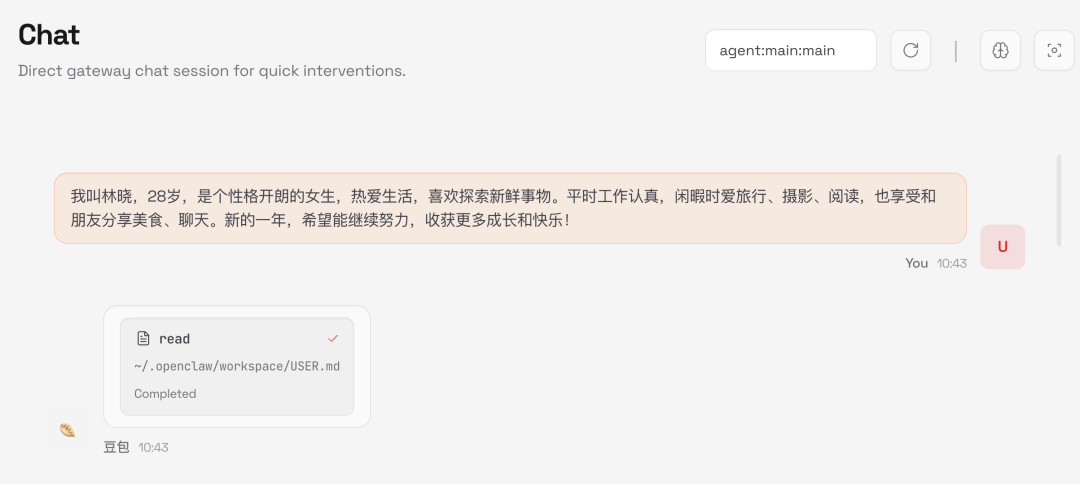

新开一个会话,模拟输入包含强用户信息的对话,验证 OpenClaw 是否触发记忆存储。

我叫林晓,28岁,是个性格开朗的女生,热爱生活,喜欢探索新鲜事物。平时工作认真,闲暇时爱旅行、摄影、阅读,也享受和朋友分享美食、聊天。新的一年,希望能继续努力,收获更多成长和快乐!

稍等片刻,如果看到 “memory store completed” 或类似提示,则表示 OpenClaw 触发添加记忆成功。

打开火山引擎 Mem0 的控制台,通过“长期记忆检索”功能即可看到已生成的记忆条目。如需提取其他类型的记忆,修改记忆项目中的策略 Prompt 即可。

2.6 Agent 内的 API 与命令行体验

openclaw-mem0-plugin 向 Agent 暴露了一组用于“显式管理记忆”的工具,同时也扩展了 CLI 以便开发者调试。

-

工具层接口(面向 Agent)

典型的工具包括:

memory_search:按自然语言查询相关记忆,支持指定 scope(如 "session"、"long-term" 或 "all")。memory_list:列出当前用户的所有记忆,常用于调试或审查。memory_store:显式写入一条记忆,通常在用户强调“牢记这件事”时由模型调用,可选择写入长期记忆或仅限当前会话。memory_get:按 id 精确读取某条记忆,用于进一步展开上下文。memory_forget:删除某条记忆,用于满足用户“不要再记住某件事”的需求。

这些工具会出现在 Agent 的工具列表中,模型可以像使用原生 memory_search 那样,在需要时主动调用它们。

-

命令行体验(面向开发者)

为了方便验证 Mem0 是否正常工作,插件还提供了一些 CLI 命令:

# 搜索所有 scope 下的记忆

openclaw mem0 search "what languages does the user know"

# 只查长期记忆

openclaw mem0 search "what languages does the user know" --scope long-term

# 只查当前会话记忆

openclaw mem0 search "what languages does the user know" --scope session

# 查看当前用户记忆统计

openclaw mem0 stats

这些命令非常适合在本地调试阶段验证“记忆是否真正被写入和召回”,避免将问题归咎于模型。

2.7 与 OpenClaw 原生记忆的优势对比

从工程实践角度看,openclaw-mem0-plugin 相比 OpenClaw 原生记忆主要有以下几方面优势:

-

更强的跨会话、跨 Agent 记忆能力

OpenClaw 原生记忆以工作区为中心,每个 Agent 拥有独立的 MEMORY.md 与 SQLite 索引,不同 Agent 之间不会共享记忆。这在隔离上很安全,但也限制了“同一个人使用多个 Agent 协作”的场景。

Mem0 以 userId 和 runId 组织记忆:同一个用户在不同 Agent、不同任务中的记忆可以统一存放在同一个 Mem0 store 中,再通过逻辑进行隔离,为实现 服务化 的记忆共享提供了可能。

-

更“工程化”的记忆管理方式

OpenClaw 原生记忆的特点是“所有东西都是文件”,这适合工程师用 Git 管理,但也意味着需要手动或通过 Prompt 让模型把重要信息写入特定文件,删除或修改记忆往往需手工编辑 Markdown。

Mem0 则提供了更产品化的接口:抽取层自动从对话中形成结构化事实,避免记忆充满冗长原话;通过 memory_list / memory_forget 等接口可以进行精细的审计与删除。这对于需要长期运营、合规审计的生产级 Agent 来说是一个重要加分项。

-

更好的可扩展性与运维空间

在单机场景下,OpenClaw 原生记忆足够可靠、简单;但进入多用户、多 Agent、长时间运行的生产场景后,往往需要更细粒度的监控(延迟、召回率等)和更复杂的访问控制与多租户隔离。这些能力用 SQLite 单机难以优雅实现,而 Mem0 通过云端托管,让你可以用成熟的数据库和监控体系来管理“记忆”这一关键基础设施。

三、火山引擎 Mem0:企业级长期记忆基础设施

如果你希望在生产环境中使用托管版 Mem0,将长期记忆作为一项稳定可靠的云端基础设施来运营,可以直接选用 火山引擎 Mem0。它在官方 Mem0 能力之上,提供企业级的资源隔离、监控告警和权限管理,更适合多团队、多业务线的大规模 AI 应用落地。

产品链接:https://www.volcengine.com/product/mem0

通过 openclaw-mem0-plugin 的集成,OpenClaw 开发者可以轻松获得一个强大、可扩展且易于运维的记忆后端,从而构建出更智能、更连贯的 AI Agent。如果你对 AI 应用开发、开源项目集成有更多兴趣,欢迎到 云栈社区 交流探讨。