2026年春节,面对亿级日活跃用户的流量洪峰,社交业务成功上线了「语音拜年」与「表情烟花」两大活动。本文旨在阐述如何通过融合自适应调度引擎、实时ASR语音识别及高性能粒子渲染,在保障高可用的前提下,实现跨端一致的沉浸式音画体验,为大规模即时通讯场景下的复杂交互树立新的技术标杆。

2026年春节是小红书社交业务的重要营销节点。平台用户的聊天核心画像是关系亲密的闺蜜或情侣,他们有着强烈的情感表达与关系培养需求。然而,传统的文字消息与静态表情,往往难以承载用户想要传递的温度与仪式感。基于这一洞察,我们规划了两大核心动效场景:

| 场景 |

产品形态 |

用户价值 |

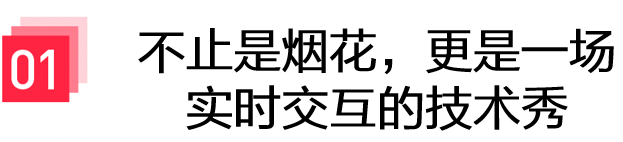

| 表情烟花 |

用户发送特定春节表情时,触发全屏烟花绽放效果 |

增强节日氛围,提升表情发送意愿 |

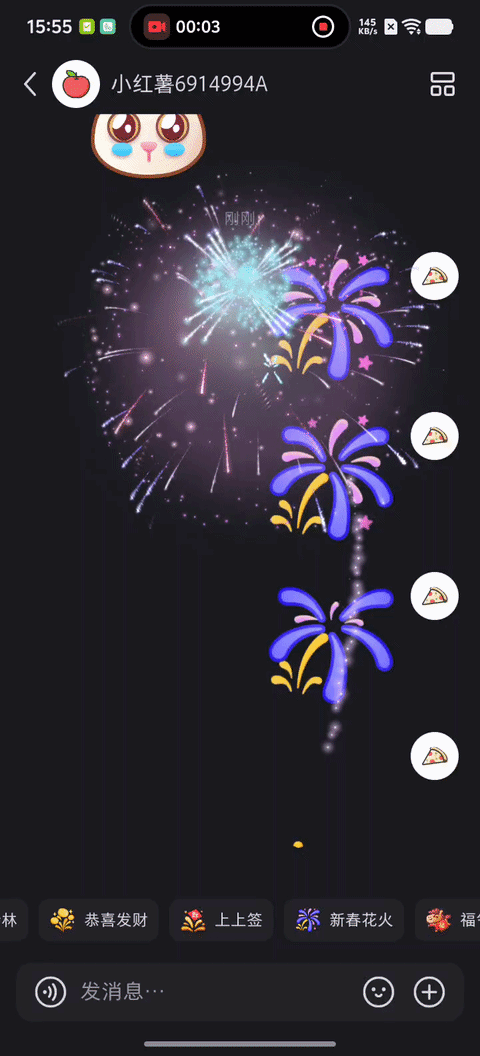

| 语音烟花 |

语音消息播放时,配合文字跳动与背景烟花的沉浸式动效 |

创新语音消息体验,提升语音使用率 |

我们希望用户在发送语音祝福时,能感受到烟花与话语同时绽放的浪漫;不论使用何种机型,都能获得同样流畅、同样绚烂的节日氛围。

「语音拜年」与「表情烟花」的产品愿景虽然美好,但将其落地为亿级DAU的真实体验,技术侧面临着前所未有的挑战:

| 体验愿景 |

技术挑战 |

| 语音播放时,祝福字幕逐字浮现,与声音精准咬合 |

实时ASR语音识别 + 音画同步调度,偏差需控制在毫秒级 |

| 点击发送的瞬间,满屏烟花绽放,沉浸感拉满 |

高性能粒子动画渲染,需支持数百粒子同屏 |

| 多种烟花风格、节日背景随心切换 |

多模态动效资源的统一管理与按需加载 |

| 人人都能感受到烟花节日的浪漫氛围 |

异构设备的自适应渲染与智能降级 |

这些挑战相互交织、彼此制约:追求极致特效会拖垮低端机性能,而过度照顾低端机又会牺牲高端机的视觉上限。传统的「单点解决方案」已无法应对如此复杂的场景。因此,我们的目标不再是“选一个引擎”,而是构建一套兼容并蓄、按需调度的「实时动态交互系统」。

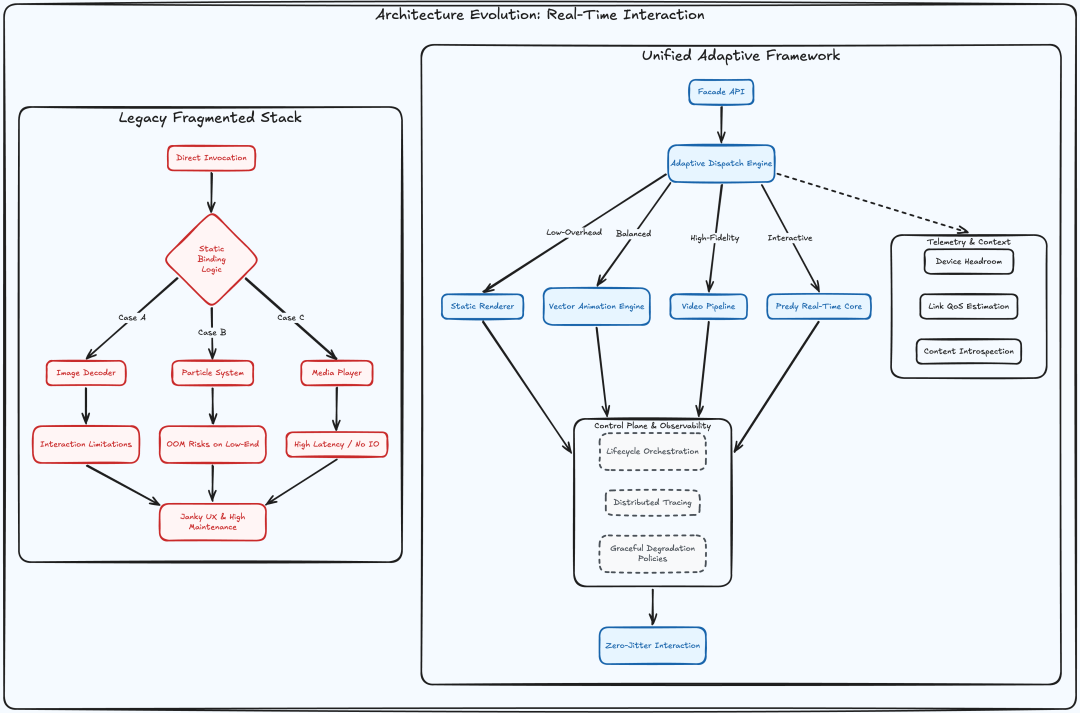

整体思路是:底层融合图片/GIF、Lottie/PAG、视频、Predy等多模态渲染能力,上层通过智能路由实现按需调度与无感降级,让不同场景、不同设备都能获得最优的渲染体验。

系统建设是持续演进的过程。回顾过往实践,我们仍需突破几个瓶颈:

- 体验受损:部分低端机因性能压力无法完整呈现复杂彩蛋。

- 兼容不足:单一引擎导致部分机型只能降级处理。

- 研发低效:下载链路分散、引擎标准不一,视觉与研发成本居高不下。

为此,我们从三个维度展开系统性治理:在架构层面解决能力分散问题;在调度层面实现特效与设备状态的动态平衡;在体验层面寻找极致特效与流畅运行的最优解。

架构重塑:从「原子组装」到「分层治理」的范式转移

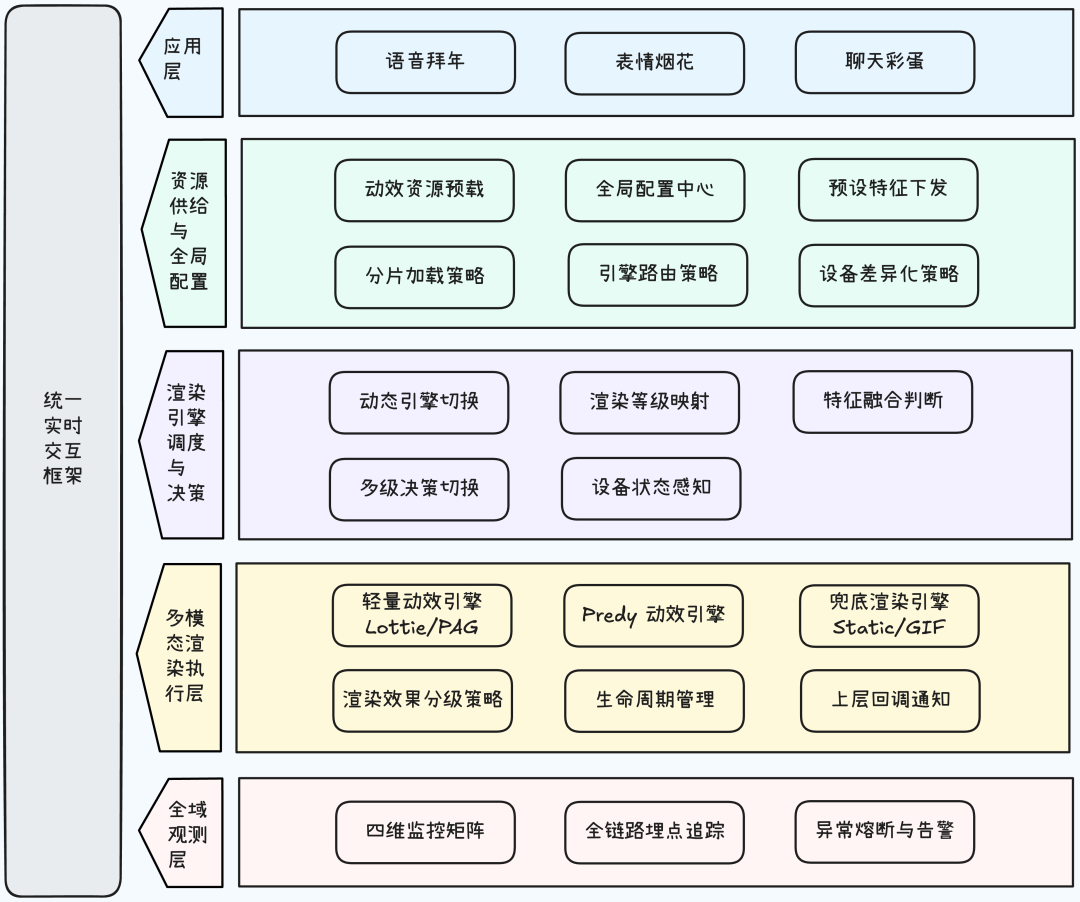

早期互动渲染功能采用「功能闭环+独立实现」模式,导致能力重复、业务耦合严重、体验不一。新的实时动态交互系统通过五层解耦设计,实现 「能力复用、策略集中、执行隔离、观测闭环」。

-

应用层

- 职责:定义用户可见的交互形态(如语音拜年、表情烟花),仅调用下层提供的标准接口。

- 关键变化:不再关心资源如何加载、引擎如何选择、设备如何适配。

-

资源供给与全局配置层

- 职责:统一预载动效资源提高渲染速度、集中下发全局配置与路由规则、按设备/网络动态获取策略。

- 价值:实现「一次配置,全域生效,动态变更」。

-

渲染引擎调度与决策层

- 职责:映射业务渲染参数,融合多维运行时特征,动态决策并切换最优引擎。

- 价值:实现渲染算力的按需分配,最大化系统在高负载下的稳定性。

-

多模态渲染执行层

- 职责:封装 Predy/Lottie/PAG/Static/GIF 等多种渲染能力,提供标准化生命周期管理与特性回调接口。

- 价值:接管渲染底层差异,统一渲染特性,在有限的设备资源下提供最优的渲染效果。

-

全域观测层

- 职责:建立四维监控与全链路追踪体系,实时洞察设备状态,并实现异常实时告警能力。

- 价值:实现可观测、可干预、可进化,支撑持续优化与止损切换。

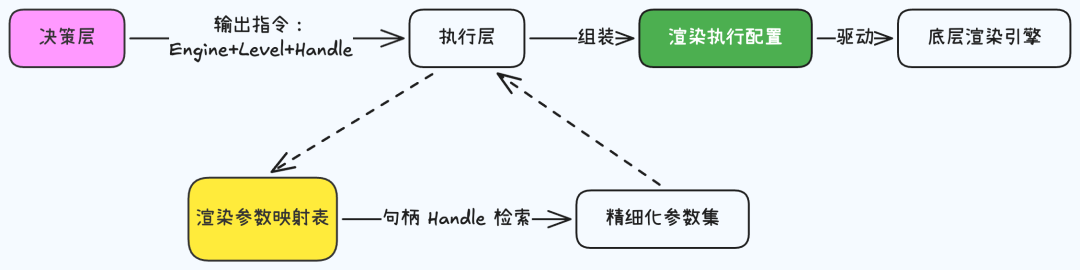

智能调度:基于设备状态的自适应渲染机制

作为整个系统的「智能中枢」,调度层基于多维特征融合计算,综合评估业务场景诉求、设备实时资源水位、机型兼容性名单、动效资源准备度,构建决策输入矩阵,最终输出包含引擎选型、渲染等级与参数索引的结构化指令。

| 维度 |

关键特征指标 |

决策权重 |

作用 |

| 业务场景 |

场景特效诉求、用户互动频率等 |

High |

定义体验目标与优先级 |

| 设备能力 |

机型白名单 (SoC/GPU)、系统版本、架构等 |

High |

划定安全边界与能力天花板 |

| 运行状态 |

实时内存水位、负载、温度等 |

Medium |

执行动态降级与实时切换 |

| 资源状态 |

资源下载进度、完整性、本地缓存命中率等 |

Low |

控制触发时机与兜底路径 |

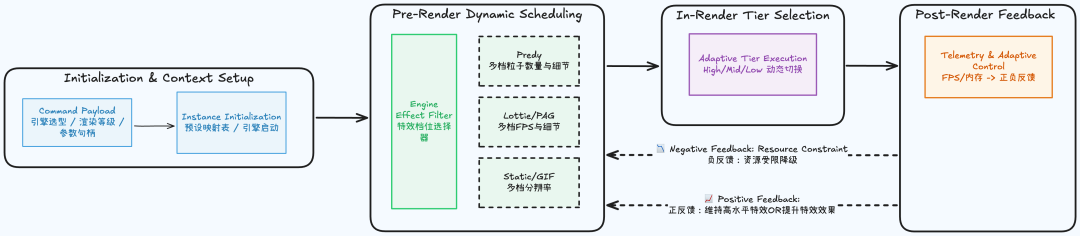

然而,「启动时的一次性决策」不足以保障全程流畅。面对移动端复杂多变的运行时环境,我们引入了「二次动态调度机制」,构建「预设配置基线,实时状态修正」的混合调度体系,落地高、中、低三档渲染分级策略。

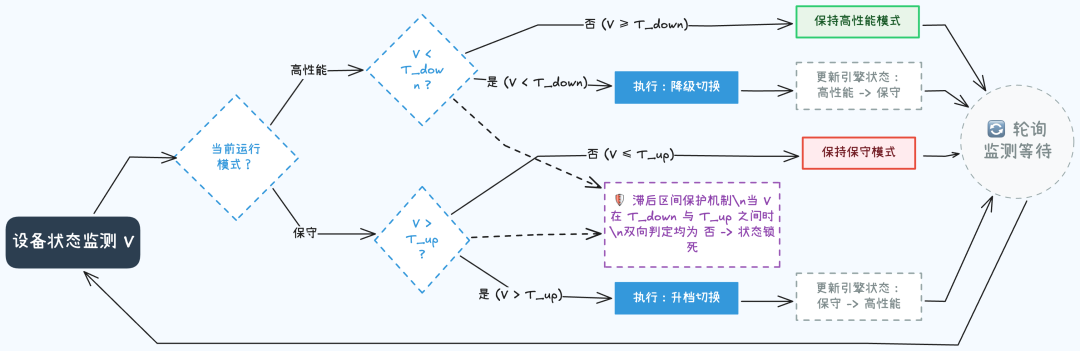

除此以外,为防止在阈值临界点频繁震荡切换,我们引入了双阈值模型设计:

- 降级阈值 (T_down):触发线。 当可用资源(如内存)跌破此值,框架判定为高风险,准备进入保守模式。

- 恢复阈值 (T_up):复位线。 当资源回升并突破此值(T_up > T_down),框架判定为安全,允许恢复高性能模式。

- 滞后区间 (H = T_up − T_down):稳定区。 只要当前资源值落在 [T_down, T_up] 区间内,无论波动如何系统强制保持当前状态不变。

携手 Predy:充满挑战的极致体验之路

在针对「实时交互渲染」与「复杂粒子特效」的技术选型调研中,Predy 走进了我们的视野。Predy 是小红书自研的互动渲染引擎,采用 「JS 逻辑控制 + GPU 原生渲染」 的混合架构,在自由度、性能与跨端一致性上展现出独特优势:

| 方案 |

优势 |

劣势 |

| Lottie/PAG |

成熟稳定 |

复杂粒子效果性能瓶颈,实时交互受限 |

| 原生渲染 |

自由度高,极致流畅 |

跨端复用性差,维护成本高 |

| Flutter/Unity |

自由度高,粒子特效和物理引擎强大 |

整体资源负载较重,包体积大 |

| H5(WebView) |

自由度高,跨端一致性高 |

启动耗时长,播放成功率较低 |

| Predy 引擎 |

JS 逻辑 + Native 渲染,跨端一致高,支持分级渲染 |

新引擎,缺乏大规模验证 |

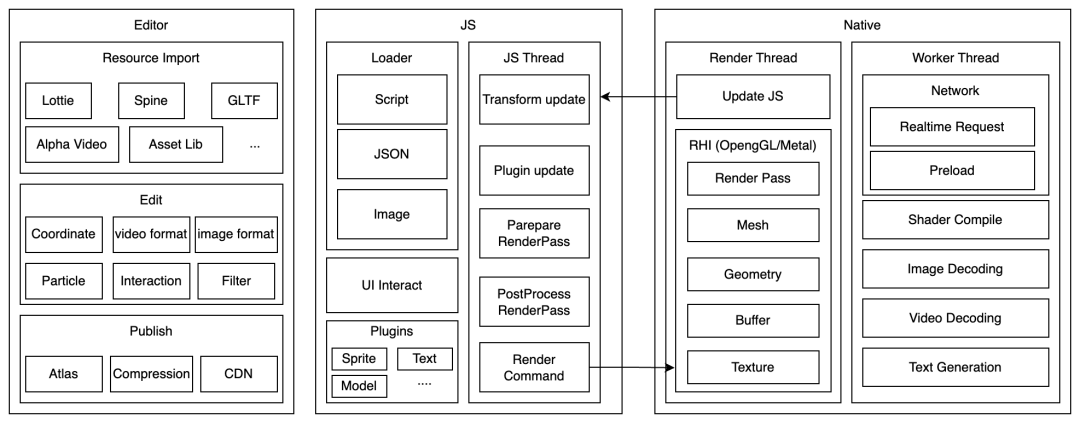

Predy 的核心设计理念是 「逻辑与渲染分离」 ,通过三层架构实现了动态性与高性能的兼得:

这套架构带来了三个关键收益:

- 动态化能力:素材和互动玩法通过 JSON + JS 下发,无需客户端发版即可更新。

- 跨端一致性:一套 JS 代码同时支持 iOS / Android / 鸿蒙,渲染效果高度统一。

- 极致性能:C++ 直接调用 Metal / OpenGL 进行 GPU 渲染,JS 层只负责数据准备,渲染主路径损耗低。

然而,Predy 在此次春节活动前从未经历过亿级 DAU 的真实流量洗礼。因此我们将其深度融入实时动态交互系统:统一调度实现按需启用与无感降级;分层预载实现资源/引擎/视图模块化组装;专项监控覆盖全域生命周期。

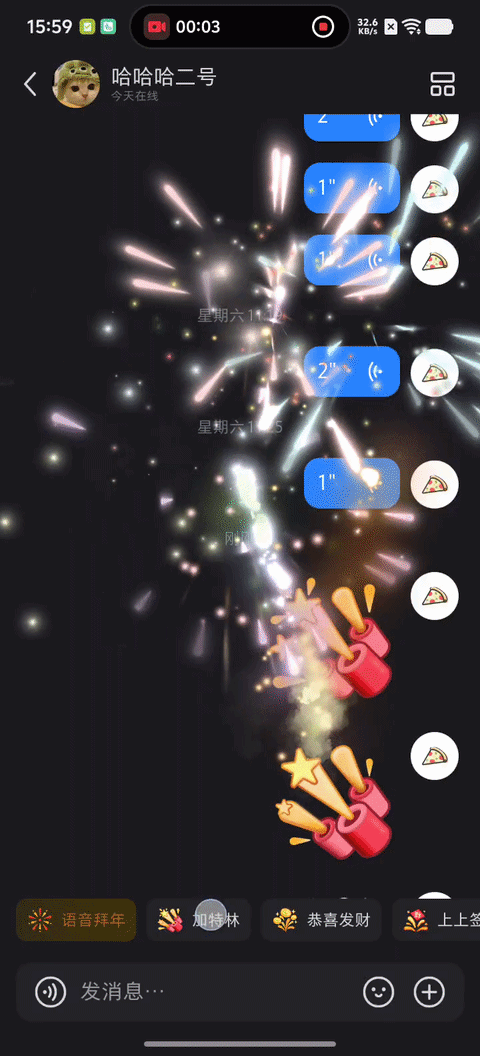

语音拜年:音画结合打造极致视听感受

语音拜年的核心体验是:用户说出祝福的瞬间,字幕逐字浮现、烟花同步绽放。这背后是一条贯穿「语音识别 → 字幕渲染 → 动效编排」的完整技术链路,其中最大的挑战是复杂场景下的语音理解:

| 挑战维度 |

具体表现 |

| 方言与口音 |

用户分布广,覆盖 20+ 地域方言 |

| 表达习惯 |

耳语、中英夹杂、语气词频繁、语速忽快忽慢 |

| 环境干扰 |

春节场景复杂——鞭炮声、电视背景音、家庭聚会嘈杂 |

| 设备差异 |

从旗舰机到入门机型,麦克风采样质量参差不齐 |

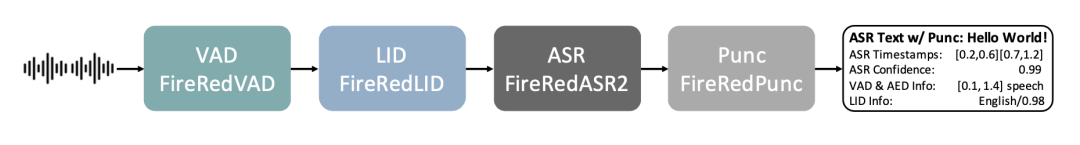

我们基于小红书 Super Intelligence-AudioLab 团队自研的 FireRedASR2 构建语音识别能力。这是一套集成静音检测、语种检测、语音识别、标点恢复等模块的工业级 ASR 系统,支持多语种及 20+ 中文方言识别。

该模型在中文语音识别领域取得优秀效果:24个测试集平均字错率 9.67%,语种检测准确率 97.18%,静音检测 F1 分数 97.57%,为音画精准同步奠定了坚实基础。

可观测性治理:从技术标尺到数据驱动闭环

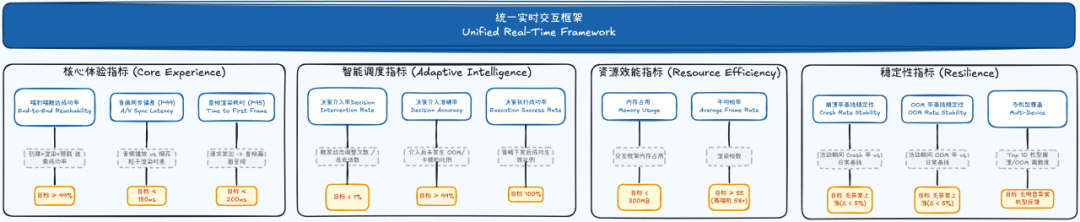

「可观测性是治理的前提」。我们构建了涵盖 「核心体验」、「智能调度」、「资源能效」 与 「稳定兼容」 的四维核心指标体系,让系统运行状态透明可控。

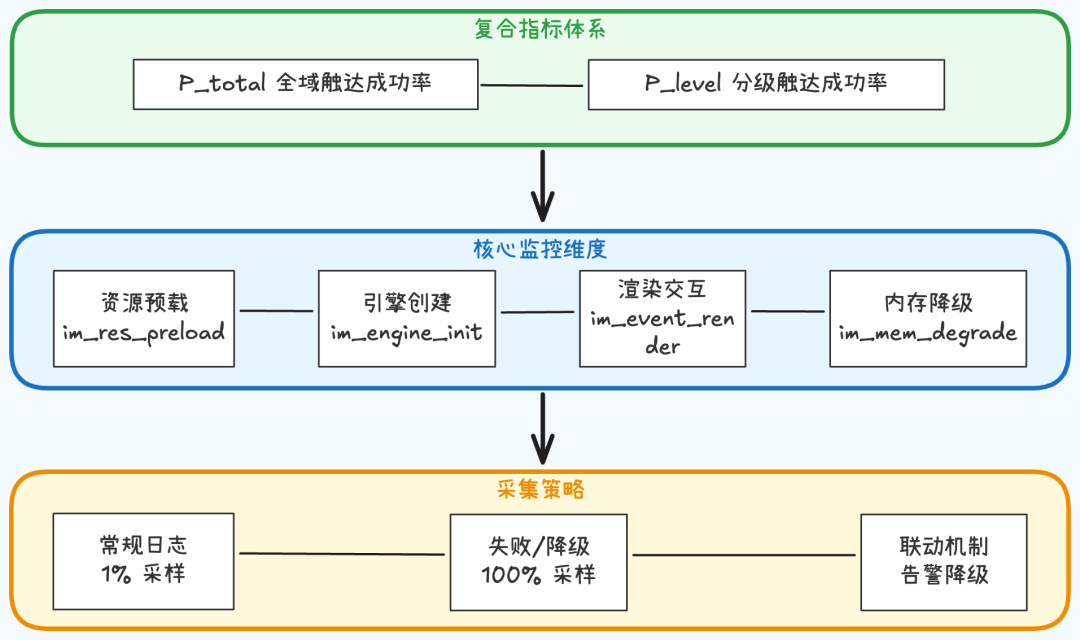

整个监控体系又划分为资源预载、引擎创建、渲染交互、内存降级四个核心维度:

除各维度的基础成功率与耗时指标外,我们还构建了两层复合口径,以量化端到端的用户体验:

最终,这套系统经受住了春节活动的考验,在亿级流量下展现了出色的稳定性和体验。

业务表现数据:

- 语音拜年功能用户参与度、累计发送量均超出预期。

- 实时交互系统的触达成功率可达 99.9%;其中高粒子特效的Predy动效引擎加载成功率 99.8%,动画播放成功率 99.6%。

- 实时交互系统加载量级覆盖 破亿;活动期间未发生任何稳定性问题和线上客诉。

- 系统响应速度优异:首帧渲染耗时(P95)小于 220ms;音画同步偏差(P95)小于 50ms。

- 智能渲染调度合理:81% 的设备成功运行在 High 等级,18% 的设备平滑降级至中低等级。

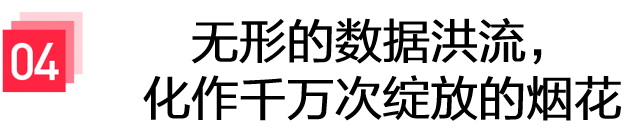

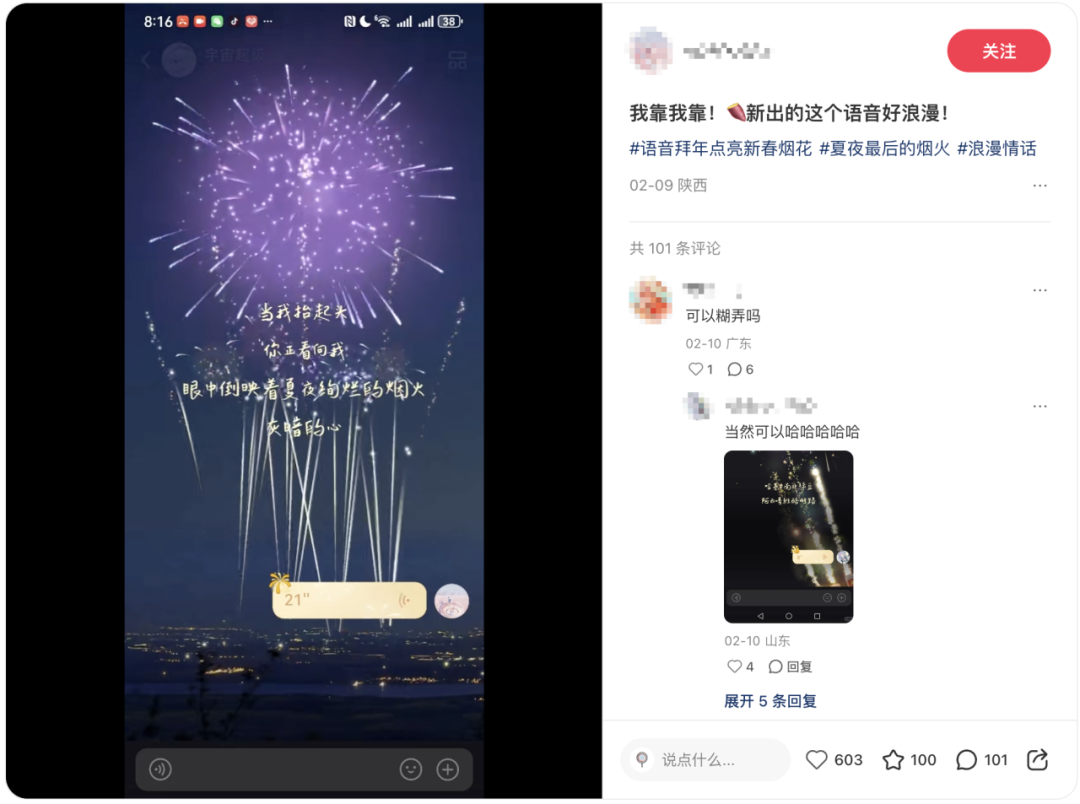

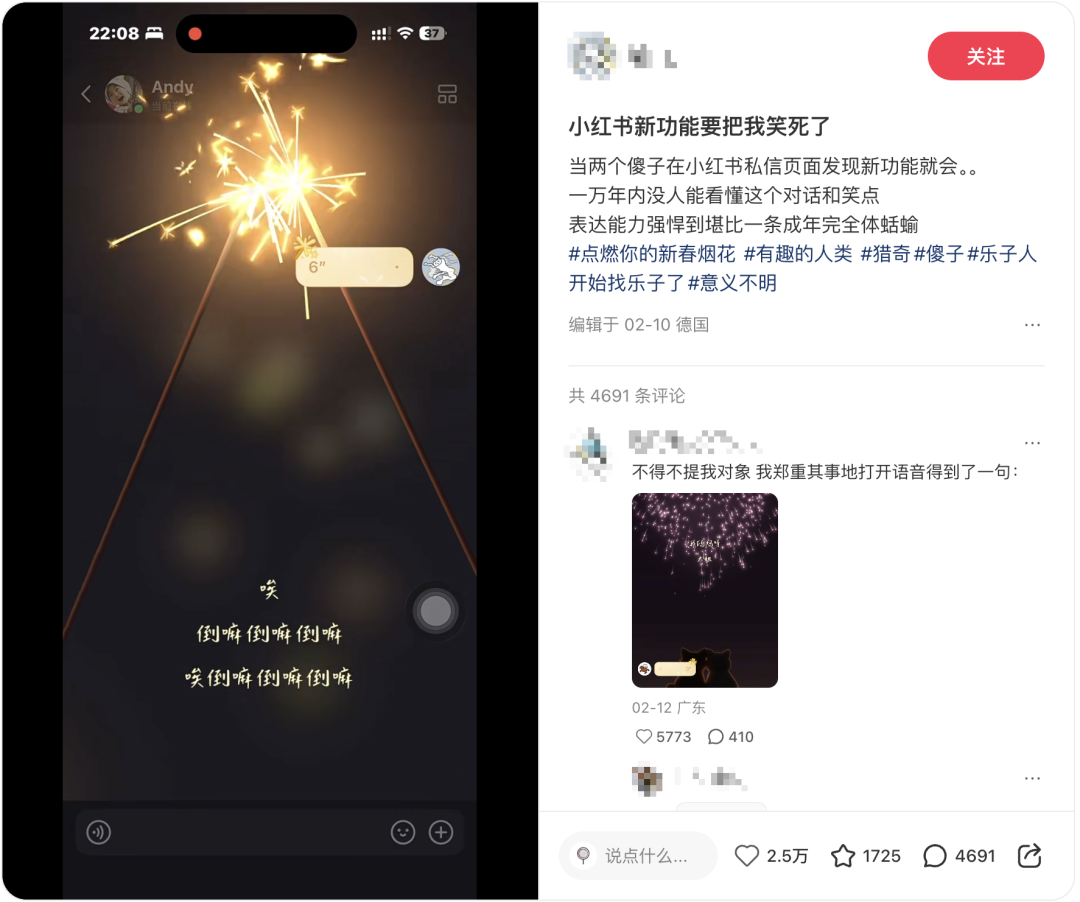

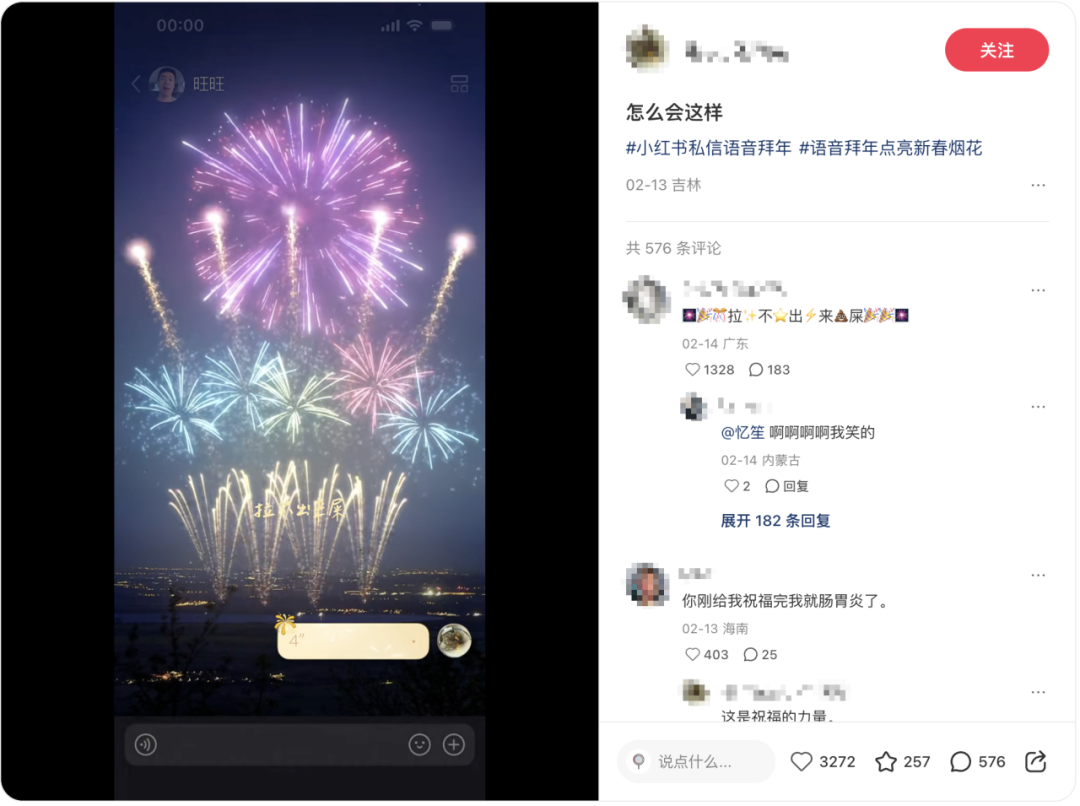

在监控后台,我们看到的是千万级的调用成功率;但在用户手中,这些技术化作了温暖或有趣的瞬间:

浪漫温暖的祝福语音

抽象搞怪的日常语音

2026年春节活动是实时动态交互系统的首次大规模实战。亿级流量下 99.9% 的触达成功率,验证了架构的可行性。展望未来,我们计划引入更智能的决策能力:

- 多维特征融合:将 CPU/GPU 负载、内存趋势、温度变化、历史表现等整合为结构化特征向量。

- 轻量端侧推理:部署轻量级决策模型,实现毫秒级本地推理,输出最优渲染策略。

- 云端协同进化:端侧决策日志上报云端,持续训练优化模型,通过配置下发实现热更新。

这不仅仅是关于烟花或拜年,更是一次对复杂实时交互系统工程化能力的深度探索。每一次流畅的动画、每一句精准的字幕,都是对架构设计、调度算法与可观测性实践的集中检验。如果你对构建支撑亿级用户的高性能互动体验感兴趣,欢迎在技术社区继续交流探讨。