天下苦“视频模型按秒计费”久矣。你写完脚本、出完分镜,点一次生成,账单先来。

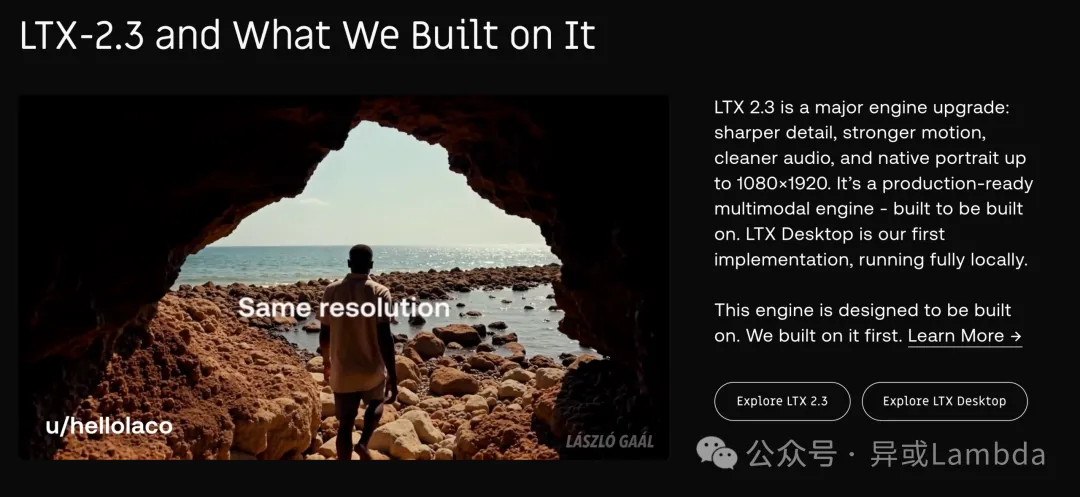

这次 Lightricks 放出的 LTX-2.3 大模型,算是把桌子掀了一半:开源权重、支持本地部署、视频和音频终于能一锅端了。

但说句实在话,另一半现实是:它确实猛,但显存要求极其残暴。如果你正到处搜索 Ollama教程 或 ComfyUI工作流,试图用 GGUF量化 版本在丐版显卡上强行跑起来,建议先停一停——社区老哥们已经替咱们踩了一圈坑。咱们直接看疗效,拆解它的真实战力与部署陷阱。

一、降维解析:双流 DiT 架构的大模型到底牛在哪?

别听官方吹得天花乱坠,先说人话版结论:LTX-2.3 不是“先做视频再配音”,而是一次性生成画面与声音。

这事儿为什么重要?因为真实世界里,声音和画面是同一个物理事件的两面:人开口说话,口型和音节得对齐;跑车轰鸣掠过,画面位移和声场变化得同步。环境音、脚步声要是全靠后期硬贴,那叫广播剧,不叫电影。

- 22B 级参数量:脑容量够大,能同时管镜头运动、角色动作、对白和环境声。

- 双流 DiT 架构:一条“粗壮大脑”(14B 负责视频)管画面,一条“精细大脑”(5B 负责音频)管声音,中间通过交叉注意力机制实时“对暗号”。

- 最长约 20 秒连续生成:你能做完整的短段落,而不是只出 3 秒的“抽搐式炫技片段”。

一句话:它在开源阵营里,已经从“勉强能看”进化到了“真能干活”。

二、算力门槛:如何在 RTX 4090 上满血运行 LTX-2.3?

别一听“开源”就自动脑补成“轻量”。

- 官方舒适线:32GB VRAM 起步。这意味着,即使是高贵的 RTX 4090(24GB 显存),跑满血版也会捉襟见肘,系统内存和硬盘空间(模型+资产+缓存)也必须跟上。

- 本地到底怎么跑? 目前主流是走 ComfyUI工作流 路线,LTX 节点生态已经初步拉扯起来了。如果你追求“先跑起来再说”,优先尝试:

- 蒸馏 / 加速 Pipeline(步数更少,出图更快)。

- FP8 版本(大幅榨干显存水分)。

- 降分辨率、降帧数、缩时长,先做参数探索。

如果你需要现成的节点配置,可以去云栈社区的 人工智能板块 找找大佬们分享的低显存保姆级适配方案。先用“小样本参数网格”找甜点位,能省下大把的电费和试错成本。

三、避坑指南:GGUF量化与中文字幕的社区血泪史

下面这些坑,全是社区炼丹师们拿头发换来的实测教训。

1. 显存与性能刺客

“全量 22B 模型在 16GB 卡上直接 OOM 炸裂。换成 GGUF 版勉强降到 20-30s/it,但输出质量直线崩盘,满屏雪花,像在看上世纪的闭路电视。”

结论:先接受现实,再做工程优化,别硬刚默认参数。量化确实能救显存,但也可能顺手把你的画面稳定性带走。

2. 格式与生态兼容坑

官方的 Diffusers 支持迟迟没弄利索。在官方 Comfy 工作流里,替换某些第三方 FP8 权重后,直接吐出五颜六色的随机噪点。生态目前还是半残状态,无缝接入还得让子弹飞一会儿。

3. 能力幻觉:中文与强制字幕

“提示词里压根没让加字,结果视频自带乱码中文字幕,非英语语言下口型同步直接崩坏,这简直是短视频创作者的噩梦。”

建议:提示词里必须死死咬住 no subtitles, no text,并准备好后处理去字方案上个双保险。

4. LoRA 兼容性并不丝滑

官方宣称微调友好,但旧版 LoRA(比如 Depth / Pose 控制类)在 LTX-2.3 上经常直接装死,跑不出报错,但也跑不出效果,大概率需要从头重训。在投入算力炼丹前,建议先翻翻云栈社区的 开源实战区,看看其他老哥的复用成功率,千万别把旧经验直接写死进生产计划。

四、终局推演:谁在裸泳,谁在拿到杠杆?

说到底,这模型适合谁?适合想做“画面+声音一体化”短片的创作者,适合需要本地可控、可微调的极客团队,适合能忍受工程调参、并愿意手搓模板流的“超级个体”。

暂不适合谁?只想一键出片、零调参的纯小白,以及显存常年飘红的轻薄本玩家。

今天的科幻,明天的日常。

LTX-2.3 的意义,绝不仅是 GitHub 上多了一个几万 Star 的仓库,而在于它撕开了一条口子:把有声视频的工业级生产线,从云端巨头的黑箱里,硬生生拽到了个人和小团队的桌面上。

这会带来什么?

那些只会机械拼接素材、做流水线粗剪的后期岗位,会以肉眼可见的速度变得岌岌可危;而那些懂得利用开源模型、自己搭系统、写提示词、调工作流的“超级个体”,将获得前所未有的杠杆效应。一个人,就是一支自带音效和摄影的数字制片厂。

它还不完美,甚至有点硬核难用。但正是这种“可改、可训、可本地部署”的粗粝感,才是生产力革命真正发轫的样子。当工具从“只能按月续费”变成“可以自己掌控”,被解放的从来不是 GPU,而是你的创作主权。

HuggingFace主页:Lightricks/LTX-2.3

大模型教程:https://yunpan.plus/f/29

代码基础补习:https://yunpan.plus/f/14

我是《异或Lambda》主理人,我们继续站在未来门口,做那个先下场、再说话的人。

最后问个扎心的问题:

当 22B 级别的多模态模型都能塞进你的机箱里时,限制你创造力的,到底是那块买不起的 RTX 4090,还是你那颗早就习惯了被投喂的大脑?

来评论区报一下你的显卡配置,咱们看看多少人在“赛博焦虑”。

关注公众号 《异或Lambda》,获取更多硬核 AI 拆解与极客生产力指南。先下场,再说话。

🏷️ 标签:#HuggingFace #开源AI #本地部署 #云栈社区 #异或Lambda #大模型 #ComfyUI工作流 #GGUF量化