230B大模型本地跑,只需128GB Mac内存——Unsloth这次真把门槛拉低了

现在,凭借Unsloth的动态4比特(4-bit)量化技术,拥有2300亿参数的MiniMax M2.7 MoE大模型,已经能够顺畅运行在一台仅配备128GB统一内存的Mac电脑上,推理速度还能达到每秒15个词元以上。这意味着普通开发者也能在自己的机器上部署SOTA级别的编码智能体,既不用担心API调用记录被第三方留存,也省去了按次付费的成本。

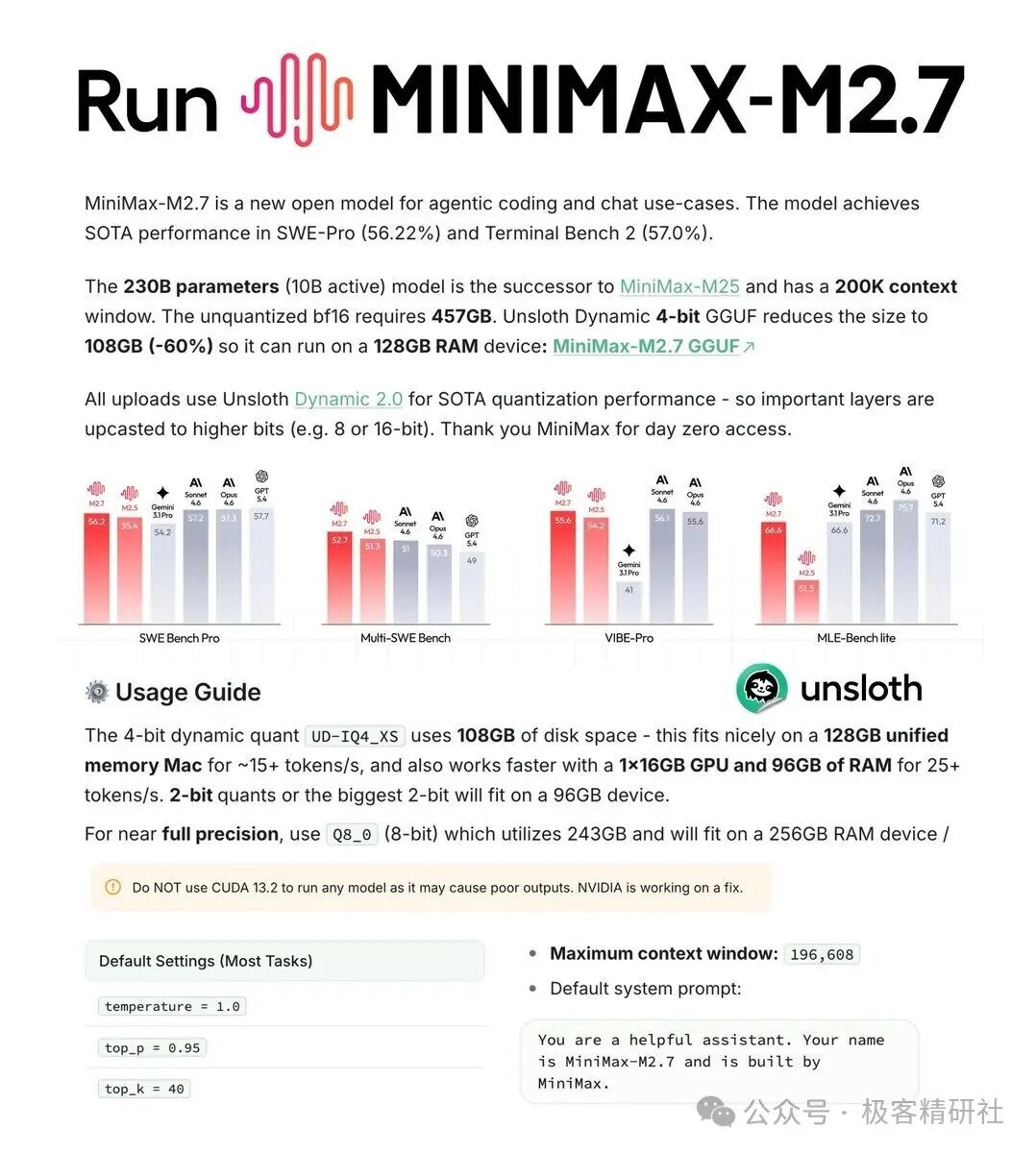

核心结论先行:Unsloth将原始需要457GB内存的bf16模型压缩至108GB,通过动态量化技术保住了关键层的精度,使得模型在SWE-Pro基准上56.22%和在Terminal Bench 2基准上57.0%的优秀成绩得以最大程度保留。这标志着本地运行用于编码任务的智能体不再是实验室里的玩具,而是可以真正用来编写小游戏或调试终端脚本的实用工具。

以前总觉得230B这个量级的模型只能依托云端算力,但Unsloth的Dynamic 2.0技术巧妙地在MoE架构的稀疏激活特性与量化精度之间找到了平衡点,效果比预想的更可靠。对于业内人士而言,这无异于将本地部署大模型的内存门槛,从云端服务器级别直接拉低到了消费级Mac Studio的水平。试想一下,如果你经常需要在移动环境中编码,现在下车后就能无缝衔接本地模型继续工作,完全不受网络波动影响。

MiniMax M2.7凭什么能SOTA?MoE架构和基准测试解析

首先要明确一点,这个模型并非单纯靠堆砌参数取胜。MiniMax M2.7是一个总参数量达230B(其中活跃参数仅10B)的混合专家(Mixture of Experts)模型,专为智能体编码和聊天场景设计。通俗地讲,它的工作原理类似一个高效的外卖派单系统:不同的“专家”模块只处理自己最擅长的任务,整体计算开销远低于所有参数全激活的稠密模型,却能胜任复杂的编程工作。这就是MoE的精妙之处——大部分参数平时处于“待机”状态,需要时才唤醒少数专家参与运算。

它的成绩为何重要?因为其在SWE-Pro上56.22%和Terminal Bench 2上57.0%的得分,实实在在地将开源模型在软件工程和终端任务上的性能天花板又推高了一截。此前许多人认为本地模型只能进行简单对话,但现在这个模型能帮你生成完整功能代码、调试命令行,还拥有20万token(最大196608)的上下文窗口。理论上,这对注重隐私的开发者是福音——代码数据无需上传云端,全部在本地处理。

从技术细节看,Unsloth官方文档指出,未量化的bf16版本需要457GB内存。MoE架构本身通过稀疏计算节省了激活内存,但量化后如何保持精度才是关键。Unsloth采用的Dynamic 2.0技术,其核心是“关键层精度上浮”——模型会自动判断哪些专家层对输出影响更大,并将它们提升至8比特或16比特精度,其他层则保持4比特。这不是简单的全局压缩,而是针对MoE结构的动态自适应调整。基准测试显示,其UD-Q4_K_XL量化版本相比原模型性能下降很小,错误率仅小幅增加,显著优于其他同等级量化方案。这说明这套动态机制在处理复杂的Deep Learning任务时确实有效。

当然,这些成绩来源于官方测试。但从实际的GGUF格式测试来看,Unsloth的量化版本在相同模型大小下,确实比其他方案的量化误差更小。对于高并发场景,MoE的稀疏性还能进一步降低实际算力需求。在128GB Mac上达到15+ tokens/s的速度,如果换成1张16GB GPU搭配96GB RAM,速度更能提升至25+ tokens/s。把这个速度放到实际体验中:15 tokens/s大致相当于流畅刷新的弹幕速度,对于代码生成来说已经足够顺滑,不会有卡顿感。

Dynamic 4-bit量化如何省内存?从457GB到108GB的技术揭秘

内存需求爆炸一直是阻碍大模型本地化的主要障碍。想象一下手机App因内存不足而卡死的场景,把这个场景放大到230B模型上,未量化时所需的457GB内存足以让任何普通电脑瘫痪。Unsloth的动态4比特GGUF量化格式(UD-IQ4_XS)将磁盘占用大幅压缩至108GB,使得配备128GB统一内存的Mac也能运行。

关键在于,这不仅仅是节省了空间,更重要的是保住了模型精度。Dynamic 2.0技术的核心“关键层上浮”机制,让模型能自动识别并保护对输出质量影响显著的重要层。最终结果是模型体积减小了60%,但SWE-Pro等硬核基准测试成绩并未崩盘。理论上,这种动态量化方式对MoE模型尤其友好,因为专家本就是稀疏激活的,量化时更容易精准定位和保护关键部分。

展开技术细节,Unsloth文档明确指出:UD-IQ4_XS版本占用108GB,推荐给128GB内存的设备。而Q8_0(8比特)版本需要243GB,适合256GB内存的机器,速度也能达到15+ tokens/s。甚至还有2比特量化版本可以塞进96GB内存的设备。所有这些GGUF文件都基于Unsloth Dynamic 2.0技术生成,官方对比数据显示,在同等大小下,其版本的准确率高于其他Q4量化方案。模型最大支持196608 token的上下文,实际使用时需要根据可用内存来设置,全放在GPU层速度最快,否则启用SSD卸载(offload)会导致速度下降。

对于普通用户来说,108GB听起来仍然很大,但对比之前457GB的门槛,这已经进入了高端消费级设备可以触及的范围。配备M系列芯片和128GB统一内存的Mac Studio现在成了一个新的标准配置。此外,Unsloth还支持通过Unsloth Studio一键下载模型,搜索名称即可拉取GGUF文件,省去了手动使用huggingface-cli下载的麻烦,这个小细节确实提升了体验。

实战指南:在128GB Mac上部署运行与避坑

真正动手部署时,步骤必须清晰。首先建议备份重要数据,虽然量化模型本身不会删除文件,但大文件下载过程中可能出现意外中断。Unsloth提供了两种主要途径:使用Unsloth Studio图形界面,或者使用llama.cpp命令行工具。普通用户直接用Studio最省心,追求极致性能的开发者则可以选择llama.cpp。

使用Unsloth Studio安装(最简单)

在macOS/Linux/WSL系统下,执行以下一键安装命令:

# 一键安装脚本,自动处理依赖

curl -fsSL https://unsloth.ai/install.sh | sh

安装完成后,启动Studio服务:

# 后台启动,通过浏览器访问localhost

unsloth studio -H 0.0.0.0 -p 8888

打开浏览器,访问 http://localhost:8888,搜索“MiniMax-M2.7”,选择“UD-IQ4_XS”动态4比特版本进行下载。请确保你的机器有108GB以上的空闲内存。下载完成后,可以直接在界面中与模型聊天或运行智能体任务。默认的系统提示词(system prompt)是:“You are a helpful assistant. Your name is MiniMax-M2.7 and is built by MiniMax.” 运行后,生成速度通常会稳定在15 tokens/s左右。

使用llama.cpp命令行部署

如果你想通过llama.cpp获得可能更好的性能,请先编译最新版本(注意在Mac上需关闭CUDA支持):

# 安装依赖,然后git clone并编译

apt-get update

apt-get install pciutils build-essential cmake curl libcurl4-openssl-dev -y

git clone https://github.com/ggml-org/llama.cpp

cmake llama.cpp -B llama.cpp/build -DBUILD_SHARED_LIBS=OFF -DGGML_CUDA=OFF

cmake --build llama.cpp/build --config Release -j --clean-first --target llama-cli llama-mtmd-cli llama-server llama-gguf-split

cp llama.cpp/build/bin/llama-* llama.cpp

⚠️ 重要提示:不要使用CUDA 13.2运行任何模型,否则可能导致输出异常。NVIDIA正在修复此问题。

接下来,使用huggingface-hub下载模型,可以利用hf_transfer加速:

# 使用hf_transfer加速下载

pip install huggingface_hub hf_transfer

hf download unsloth/MiniMax-M2.7-GGUF --local-dir unsloth/MiniMax-M2.7-GGUF --include "*UD-IQ4_XS*"

最后,运行模型进行推理:

# 设置模型缓存路径,并直接引用huggingface仓库路径运行

export LLAMA_CACHE="unsloth/MiniMax-M2.7-GGUF"

./llama.cpp/llama-cli -hf unsloth/MiniMax-M2.7-GGUF:UD-IQ4_XS --temp 1.0 --top-p 0.95 --top-k 40

你也可以直接指定本地模型文件路径。常见的出错点是内存分配,在128GB Mac上运行前,建议先关闭Chrome等消耗大量内存的进程,以避免内存不足(OOM)。运行后,终端将直接输出模型回复,速度从15 tokens/s起步。若想部署为API服务,可以使用llama-server命令并指定端口(如--port 8001),然后使用兼容OpenAI的客户端进行调用。

完成以上步骤,整个部署过程通常不超过半小时。本地运行模型后,最直观的感受是隐私和延迟问题得到根本解决。相比云端API动辄数秒的往返延迟,本地推理响应通常在1-2秒内,代码生成完全在本地完成,数据不出设备。

曾经认为大模型全面本地化还需等待数年,但Unsloth通过动态量化技术将230B模型成功部署到128GB Mac上,标志着门槛已降至可日常使用的水平。对于开发者而言,现在可以直接获取UD-IQ4_XS版本,在自己的编码工作流中进行测试。记住要合理设置上下文大小(ctx-size),不要超过196k,否则容易导致程序崩溃。如果你对这类开源实战和应用有更多想法,欢迎在云栈社区交流探讨,这里聚集了许多关注前沿技术文档和实战的开发者。