当业务反馈Elasticsearch写入“变慢”时,你是不是也感到无从下手?这种“慢”背后可能有很多层原因,是客户端等得久,还是数据可见得慢?是某个节点堵了,还是整个集群压力过大?今天,我们就用一个从宏观到微观的排查顺序,帮你把“五板斧”砍到实处,快速定位写入瓶颈。

第一板斧:先看「写完了没有」——索引延迟与 refresh

写入请求的“完成”在Elasticsearch里有两个阶段:一是数据写入内存和translog后返回成功,二是数据经过refresh变为可搜索状态。第一步要做的,就是区分问题出在哪个阶段。

看什么:

你的写入是进了内存/translog就返回了,但业务侧却感觉“数据很久才查到”?那问题可能出在refresh环节。先得搞清楚,到底是“客户端等很久”还是“数据可见慢”。

如何排查:

-

检查索引压力:通过以下命令观察索引队列和失败情况。

GET _cat/indices?v&h=index,pri,rep,docs.count,store.size,search.throttled

GET /_nodes/stats?pretty&filter_path=**.indexing

重点关注各节点的 indexing.index_current(当前索引操作数)、indexing.index_failed(失败的索引操作)。如果 index_current 长期居高不下或者 index_failed 在增长,说明写入操作已经在排队或开始失败了。

-

验证refresh影响:如果在写入期间,临时将索引的 refresh_interval 调大(例如设为 30s 或 -1 关闭),观察写入的QPS(每秒查询率)和延迟是否有显著改善。

- 若调大后写入性能明显好转,说明频繁的refresh是瓶颈之一,这在批量小但QPS高的写入场景中尤为常见。

结论:

如果在第一步就发现索引队列长期堆积或失败数增加,那么瓶颈很可能在“写入路径”本身。如果客户端响应很快但数据可见慢,那瓶颈就指向了 refresh 或后续的段合并(merge)过程。

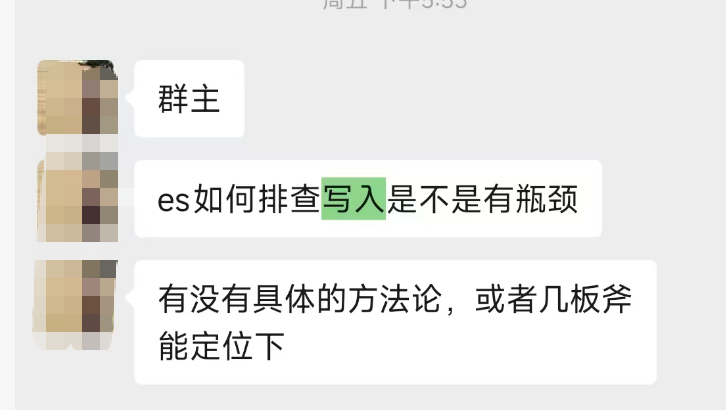

第二板斧:看「卡在谁那儿」——线程池与 reject

Elasticsearch的写入操作主要消耗两类线程池资源:write(负责写translog和段文件)和 index(负责索引文档)。任何一个线程池满了,都会触发reject,客户端通常会收到429状态码或es_rejected_execution_exception异常。

如何排查:

运行以下命令,检查线程池状况:

GET _cat/thread_pool/write?v&h=node_name,name,active,queue,rejected,completed

GET _cat/thread_pool/index?v&h=node_name,name,active,queue,rejected,completed

GET _nodes/stats/thread_pool?pretty

重点看:

rejected 数量是否在持续增长(看历史累计值或观察一段时间内的增量)。queue 队列长度是否经常很大(意味着处理速度跟不上提交速度)。

怎么办?

如果发现 write 或 index 线程池有 reject:

- 短期治标:可以适当调大

thread_pool.write.queue_size 和 thread_pool.index.queue_size。

- 长期治本:考虑增加节点以分散写入压力,或者优化写入方式(见下文第四板斧)。单纯调大队列只是暂缓,根本还是要提升处理能力或降低单节点负载。

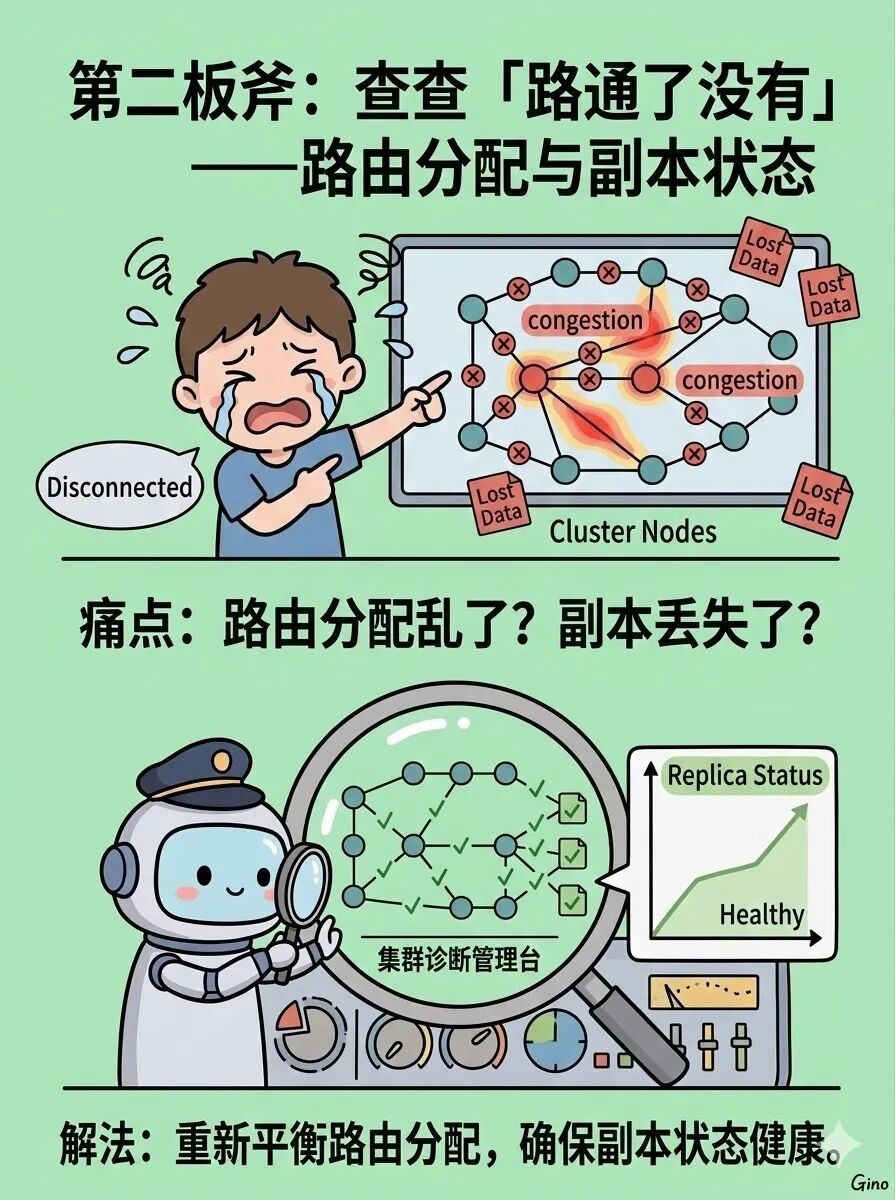

第三板斧:看「磁盘与段合并」——merge 与 I/O

写入会产生大量小的索引段(segment),后台的merge任务负责将它们合并成大段以提高查询效率。merge操作非常消耗I/O和CPU。如果merge速度跟不上写入速度,段数量会急剧膨胀,反过来拖累后续的写入和查询性能。

如何排查:

- 查看段数量:

GET _cat/segments/?v

检查单个索引的段数是否过多(例如,单个索引有几百上千个段就算偏多了)。

- 检查合并状态与磁盘:

GET _nodes/stats/fs,indices/indexing?pretty

GET _nodes/stats/indices/merges?pretty

关注 merges.current(正在进行的合并数)、merges.total(合并总数)、merges.total_time_in_millis(合并总耗时)。如果长期有大量合并在进行,同时磁盘利用率(util)和iowait很高,那么瓶颈很可能在I/O或当前的merge策略上。

可以做什么:

- 在写入高峰期,可以适当调大

index.translog.flush_threshold_size,减少flush频率(这会略微增加故障恢复时间,需权衡)。

- 对于非实时性的历史数据写入,可以在写入完成后,再对索引执行

_forcemerge(并控制max_num_segments),务必避免在写入高峰期间进行。

- 监控系统级磁盘

util和iowait,如果持续过高,考虑升级为更快的存储设备(如SSD),或者增加节点分散I/O负载。

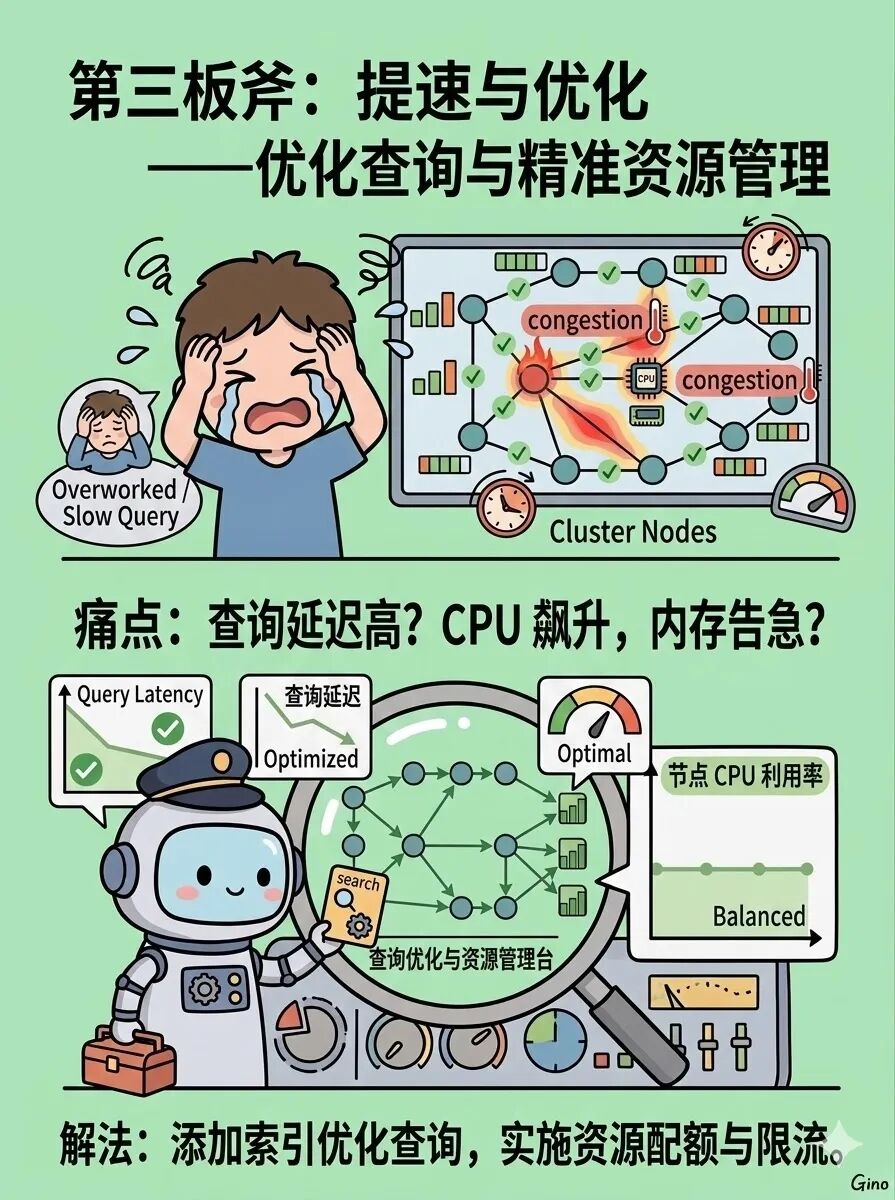

第四板斧:看「写入方式」——bulk 与 refresh

写入方式不当是导致性能问题的常见原因。无论是单条写入、过小的bulk,还是过大的bulk,都会导致吞吐量低下或容易触发reject。

优化要点:

- 单次Bulk大小:建议单次

bulk请求的body大小控制在 5~15MB 左右。

- 太小:请求次数增多,协调节点和网络开销比例变大。

- 太大:容易导致单个请求超时,长时间占用线程,更容易引发

reject。

- 条数经验:如果单条文档约1-2KB,单次

2000~5000条是常见范围;如果单条文档大于10KB,应相应减少条数,确保单次body总量在建议范围内。

- 活用Refresh:在进行大批量数据导入(如初始化、数据迁移)时,可以先将目标索引的

refresh_interval 设置为 -1(关闭自动refresh)。导入全部完成后,再将其改回正常值,并手动执行一次 _refresh。这能显著降低写入期间的I/O和CPU峰值压力。

行动建议:

在客户端应用程序中记录日志,包括每批bulk的条数、body大小,以及是否频繁收到429或rejected。如果发现reject往往伴随着“单批太大”或“并发太高”,应优先尝试减小bulk size或适当降低写入并发度。

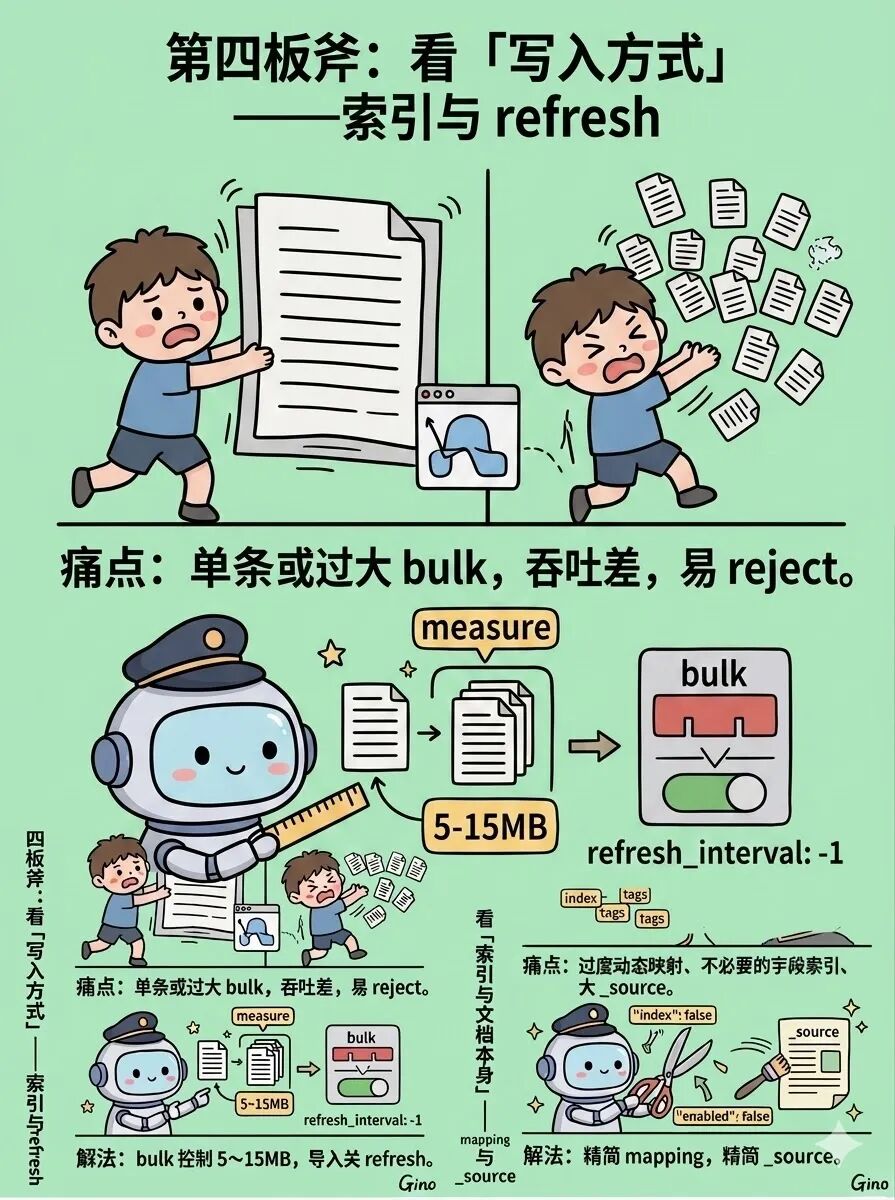

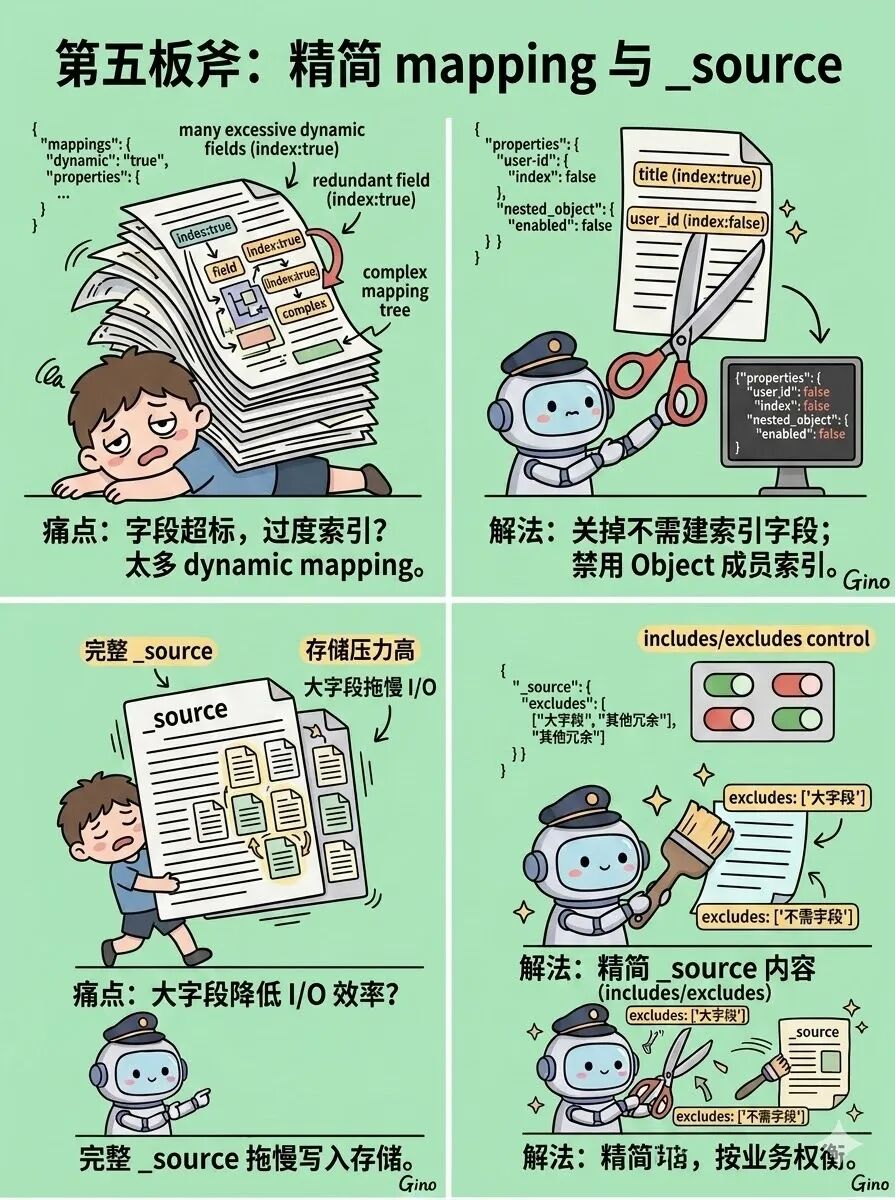

第五板斧:看「索引与文档本身」——mapping 与 _source

最后,写入性能也与你索引和文档的“身材”息息相关。臃肿的mapping和冗余的_source字段会直接增加CPU和I/O开销。

优化方向:

- 精简 Mapping:

- 检查是否开启了过多的

dynamic mapping,或者存在大量复杂的嵌套(nested)字段。

- 对于确定不会用于检索(search)的字段,建议在mapping中显式设置

"index": false。对于仅用于存储的大文本或复杂对象,可以考虑将其设为 "enabled": false。

- 按需保留 _source:

_source字段存储了文档的原始JSON。如果业务上不需要完整的_source(例如,不需要update或reindex),可以考虑禁用或按需包含字段:

{

"_source": {

"enabled": false

}

}

或者使用includes/excludes进行过滤:

{

"_source": {

"excludes": ["large_field", "other_redundant_data"],

"includes": ["necessary_field1", "necessary_field2"]

}

}

- 注意:禁用或裁剪

_source会牺牲文档的更新(update)和重新索引(reindex)能力,需要根据业务场景仔细权衡。

- 临时调整副本:在密集型写入期间,如果允许短暂的数据冗余风险,可以先将索引的

number_of_replicas 设置为 0(即无副本),待写入完成后再改回原值。这可以减少近一倍的写入放大效应。

排查清单与总结

为了便于实践,这里将“五板斧”总结成一个按顺序操作的检查清单:

| 顺序 |

排查方向 |

关键检查点与操作 |

| 1 |

索引延迟与 refresh |

_cat/indices、_nodes/stats 查看indexing指标;调大 refresh_interval 进行对比测试。 |

| 2 |

线程池与 reject |

_cat/thread_pool 查看write/index的queue、rejected;有reject则优化并发/bulk或考虑扩容。 |

| 3 |

段与 merge、I/O |

_cat/segments看段数、_nodes/stats/merges看合并状态、系统磁盘util;必要时调整flush策略、错峰forcemerge。 |

| 4 |

bulk 与 refresh 用法 |

确保bulk大小在5~15MB/批;大批量导入时关闭refresh。 |

| 5 |

mapping 与 _source |

关闭不必要索引的字段;根据业务需求,权衡并精简_source内容。 |

在日常排查中,通常先进行第1步(看延迟/队列)和第2步(看reject),就能快速判断问题是出在“写入路径堵了”还是“refresh/merge拖了后腿”,然后再根据具体情况,沿着这个顺序向下深挖即可。希望这份指南能帮助你在下次面对Elasticsearch写入性能问题时,更加胸有成竹。如果你想和更多同行交流这类实战经验,欢迎来云栈社区一起探讨。