AI领域长期追寻的通用人工智能(AGI),其发展路径可能需要重新思考。图灵奖得主Yann LeCun在最新发表的论文中提出了一个不同的愿景——超人类适应性智能(Superhuman Adaptable Intelligence, SAI)。

这一框架的核心在于三个关键转变:

- 不再以人类能力作为终极参照系。

- 拥抱专业化,追求在特定领域实现超越人类的表现。

- 衡量智能的核心指标,从“掌握技能的广度”转向“学习新技能的速度”。

简而言之,SAI的目标不再是变得“像人一样聪明”,而是专注于一个更根本的命题:系统适应未知任务的速度能有多快。

论文还提出了一个有趣的观点:人类智能本身也并非真正“通用”。我们引以为傲的通用能力,很大程度上是生物进化塑造出的、一套用于“适者生存”的工具包。

什么是超人类适应性智能 (SAI)?

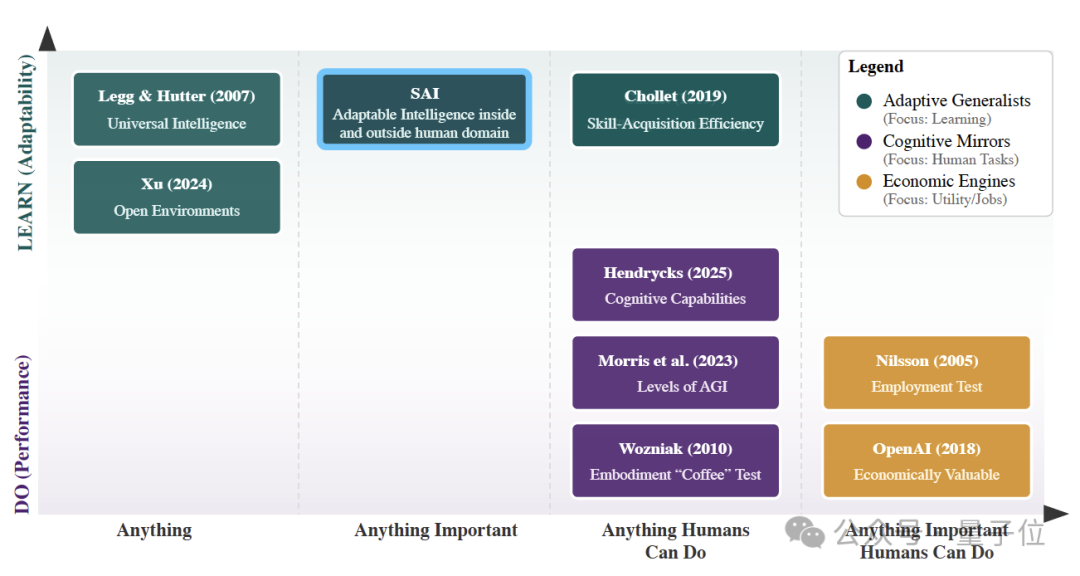

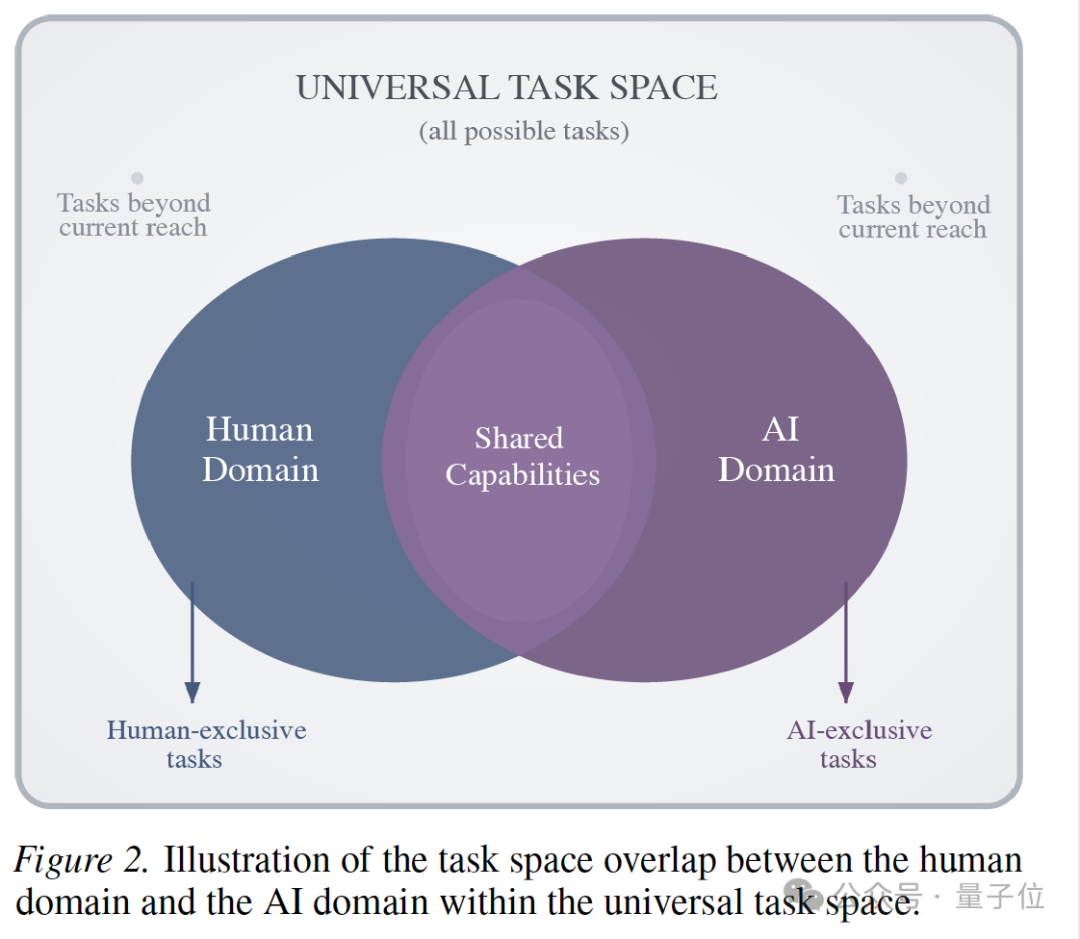

根据论文定义,超人类适应性智能 (SAI) 是一种能够通过快速适应,在人类擅长的任务上超越人类,同时也能解决大量人类从未涉足或无法完成的任务的系统。

过去,AI的发展逻辑常常将人类设为智能的标尺,例如图灵测试,其隐含的目标是达到“人类水平”。但LeCun团队认为,这种思路本身可能存在问题。论文中明确指出:

将智能锚定在人类基准线上,与通往超人类能力的路径是正交的。

换句话说,如果目标仅仅是“模仿并达到人类水平”,反而可能限制AI发展的上限。从这个角度看,真正应该被优化的不是模型在某个固定测试集上的分数,而是系统快速适应并解决新问题的能力。

一旦将“模仿人类”设定为目标,AI的任务空间就被人为地限制在了人类能力的范围内。然而,人类的能力集合只是进化史上的一个特解,远非智能可能性的全部。更合理的路径是让AI围绕明确的目标进行优化,并通过自我博弈、进化搜索和大规模仿真来持续提升。

这一观点也与Richard S. Sutton在《痛苦的教训》中的核心思想相呼应:推动AI取得实质性进步的,往往不是对人类认知的模仿,而是规模化计算与通用的学习方法。

在这种框架下,AI无需模仿人类,便可在诸多任务上直接实现超人类表现。反之,过度关注“人类水平”不仅可能误导研究方向,还会将AI的发展禁锢在以人类为中心的任务子集中。

为何“模仿人类”可能是一条歧路?

要迈向超人类智能,一个重要的前提是认识到:人类的“通用性”本身可能是一种认知盲区。

人脑并非为解数学方程、编写程序或进行科学研究而设计,它最初的进化压力只有一个:在原始自然环境中生存下来。因此,人类智能本质上是进化优化出的一套生存工具。

自然选择让我们擅长视觉感知、运动控制和社会协作,这些能力之所以看起来“通用”,仅仅因为它们对生存至关重要。一旦脱离这个进化塑造的舒适区,人类在许多认知任务上的表现并不出色,例如复杂概率计算、高维优化或大规模逻辑推理——在这些方面,计算机早已远超人类。

国际象棋就是一个经典例证:顶尖人类棋手曾被视为智慧的象征,但在强大的象棋引擎面前已无胜算。这揭示了一个事实:所谓“通用智能”可能是一种错觉,我们难以察觉自身由生物学设定的局限性。

这就是所谓的莫拉维克悖论:对人类而言轻而易举的任务(如行走、抓取),对机器却极端困难;而人类觉得困难的任务(如下棋、计算),对机器反而相对简单。原因在于,那些“简单”的能力凝聚了人类数百万年进化的精华,其底层复杂性被我们的主观体验所掩盖。

因此,论文得出的结论直接而有力:如果未来的AI仅仅致力于复刻人类这种为生存而优化的“智能工具箱”,那很可能是一条错误的技术路线。

专业化:智能进化的必然趋势

既然人类的“通用性”存在盲区,那么正确的方向是什么?LeCun援引生物学和机器学习领域的观察,给出的答案是:专业化才是智能进化的常态。

从生物学角度看,在资源有限、环境复杂的约束下,进化总是推动生物朝向更适应特定生态位的专业化方向发展。AI系统同样面临类似的压力:如果一个领域对成本、精度或可靠性有苛刻要求,任何不够专业的通用模型都会被更专注、更高效的专用系统所取代。

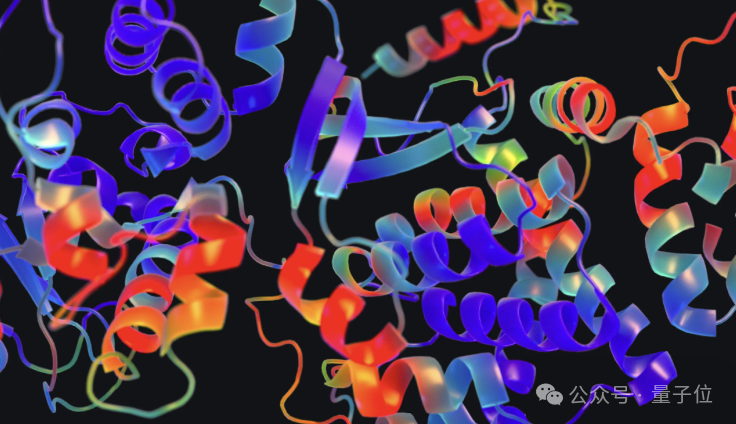

现实世界中已有许多例证,最典型的莫过于AlphaFold。

这个系统专为蛋白质结构预测而设计,通过任务特定的架构、数据和训练策略取得了革命性突破,彻底改变了结构生物学领域。这印证了机器学习中的一个基本原理:算法的成功,往往源于其设计与问题内在结构的深度匹配。

如果一个模型被迫同时学习叠衣服、驾驶汽车、编写代码和预测蛋白质结构,它很可能在每个任务上都只能达到平庸的水平。正如LeCun在论文中所言:

帮我们折叠蛋白质的AI,不应该是帮我们折叠衣服的那个AI!

这背后是机器学习中经典的负迁移现象:当多个差异性较大的任务竞争同一套模型参数时,它们的梯度更新方向可能相互冲突,从而导致整体性能下降。因此,从工程和理论角度看,强行追求“一个模型解决所有问题”的通用性,往往是一条低效的路径。

技术路径:自监督学习与世界模型

如果不追求传统的AGI,那么如何实现SAI?LeCun团队提出的技术路线围绕三个核心要素:自监督学习 + 世界模型 + 模块化系统。

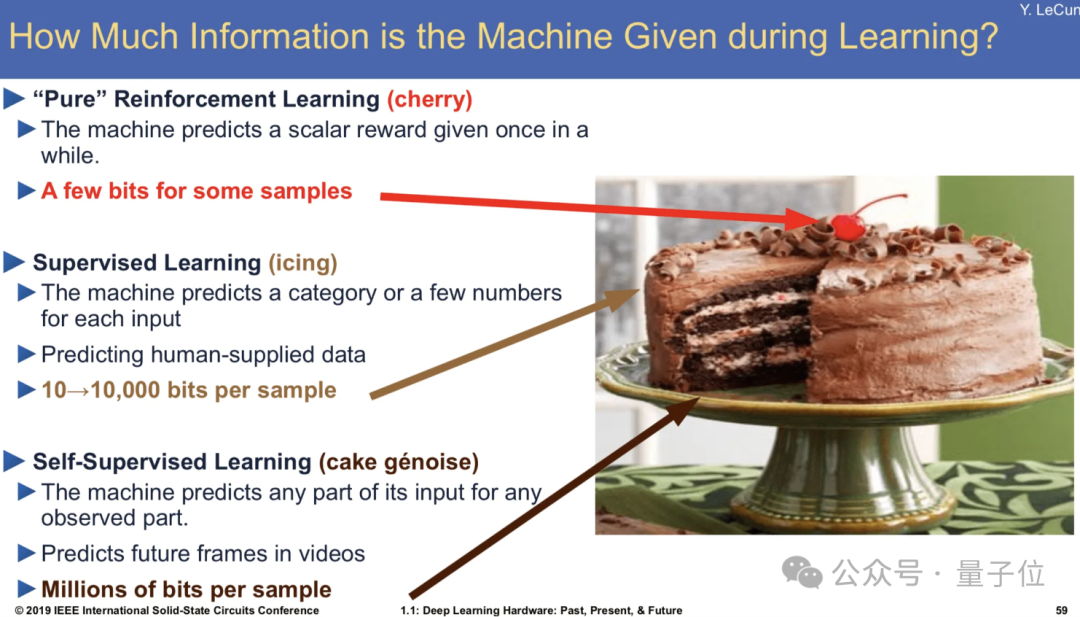

首先是自监督学习。这种方法不依赖昂贵且有限的人工标注数据,而是让模型从海量的真实世界数据(如视频、文本)中直接学习其底层结构和规律。这被认为是让机器获得大量“背景知识”的关键。

其次是世界模型。即让AI在内部构建一个关于世界如何运作的“模拟器”,使其能够像人类一样进行预测、规划和推理——在心中模拟行动的结果,从而在没有针对新任务进行明确训练的情况下,也能快速找到解决方案。

最后是模块化架构。论文明确反对存在一种“统治一切”的单一模型架构(例如当前主流的大语言模型所依赖的自回归下一个词预测范式)。未来的AI更可能是一个由多个专门化、可互操作的模块组成的协作系统,而非一个万能的黑箱模型。这种基于世界模型的模块化思路,为构建具备更强适应性和可解释性的智能系统提供了新蓝图。

作者团队

这篇题为《AI Must Embrace Specialization via Superhuman Adaptable Intelligence》的论文已发布在arXiv上。

论文的第一作者是哥伦比亚大学的博士生Judah Goldfeder,师从Hod Lipson教授。

其他作者包括同样来自哥伦比亚大学的Philippe Wyder,以及图灵奖得主、Meta首席AI科学家Yann LeCun。

此外,作者还包括纽约大学数据科学中心的助理教授Ravid Shwartz-Ziv。

参考链接:

对AI未来发展路径的讨论总是充满启发性,如果你想了解更多关于机器学习前沿方向或与其他开发者交流观点,欢迎来到云栈社区的相关板块参与探讨。