为什么你的RAG系统效果总是不尽如人意?如何才能通过组合策略彻底解决这个问题?

我第一次构建RAG系统时,也觉得一切都很简单:把文档切块、创建向量、检索相似内容,然后交给大模型处理。结果却让人失望,准确率只有60%左右。用户经常得到完全不相关的答案,系统甚至会“自信满满”地返回毫无关联的信息,有时连文档间显而易见的联系都错过了。

我花了数周时间排查,才发现自己使用的正是研究人员口中的“朴素RAG”——这种最基础的实现方案,在生产环境中几乎难以奏效。

本文将带你深入了解11个经过实战检验的RAG进阶策略,正是这些策略将我的系统准确率从60%提升到了94%。我会详细解释如何组合这些策略,以实现最佳效果。

朴素RAG的根本问题

我们先来看看,为什么基础的RAG流程经常失败。

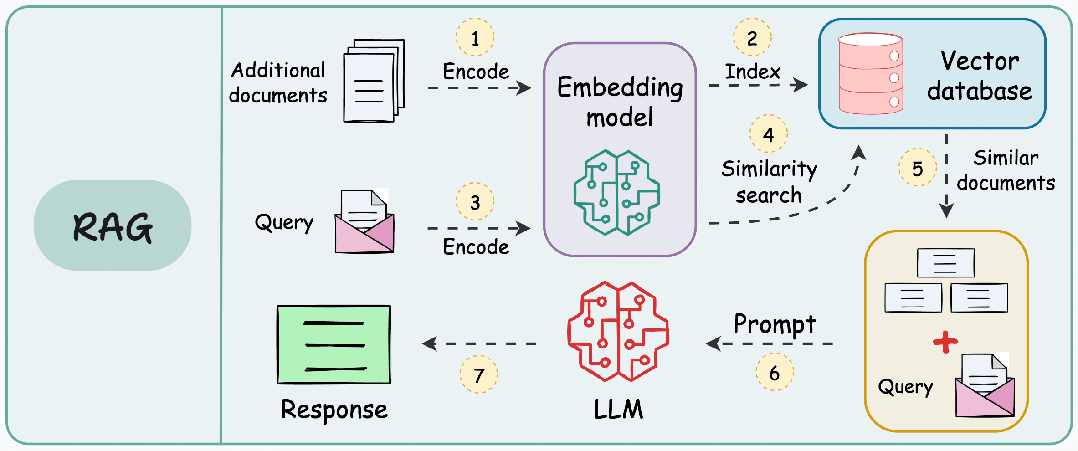

传统的朴素RAG遵循一个看似合理的简单流程:

# 朴素RAG方法

def naive_rag(query: str) -> str:

# 1. 对查询进行向量化

query_embedding = embed(query)

# 2. 查找相似片段

chunks = vector_db.search(query_embedding, top_k=5)

# 3. 生成答案

context = "\n".join(chunks)

answer = llm.generate(f"Context: {context}\n\nQuestion: {query}")

return answer

看起来没问题,对吧?但问题究竟出在哪里?

- 固定大小的分块:会在思路中间切断句子,导致上下文丢失。

- 单一查询视角:会错过那些表述方式不同但内容相关的文档。

- 没有相关性过滤:你得到的是向量空间上“最接近”的匹配,而不一定是最“相关”的。

- 有限的上下文:孤立的小片段缺乏理解问题所需的完整画面。

结果就是,你的RAG系统可能变成一个高级猜谜游戏。下面,我们来逐一解决这些问题。

真正有效的11个策略

我将这些策略分为三类:摄取策略(如何准备文档)、查询策略(如何搜索)和混合方法(组合策略以放大效果)。

策略1:上下文感知分块

作用:不是在固定字符数处生硬地分割文档,而是分析语义边界和文档结构(如标题、段落)。

解决的问题:当你把“CEO宣布……[分块断开]……收入增长40%”这样的句子切断时,上下文就彻底丢失了。上下文感知分块能够将语义相关的内容保持在一起。

代码示例:

from docling.chunking import HybridChunker

from transformers import AutoTokenizer

class SmartChunker:

def __init__(self, max_tokens=512):

# 使用实际的分词器,而不是字符计数

self.tokenizer = AutoTokenizer.from_pretrained(

"sentence-transformers/all-MiniLM-L6-v2"

)

self.chunker = HybridChunker(

tokenizer=self.tokenizer,

max_tokens=max_tokens,

merge_peers=True # 合并相邻的小分块

)

def chunk_document(self, document):

# 分析文档结构(标题、段落、表格)

chunks = list(self.chunker.chunk(dl_doc=document))

# 每个分块包含标题上下文

contextualized_chunks = []

for chunk in chunks:

# 添加分层标题信息

contextualized_text = self.chunker.contextualize(chunk=chunk)

contextualized_chunks.append(contextualized_text)

return contextualized_chunks

优点:

- 免费且快速

- 自然地保持文档结构

- 适用于任何嵌入模型

缺点:

使用时机:这应该是你的默认策略。始终优先选择语义分块而不是固定大小的机械分割。

策略2:上下文检索

作用:在嵌入和索引每个分块之前,使用LLM为其添加文档级上下文。LLM会生成1-2句话,解释该分块与整个文档的关系。

解决的问题:像“收入增长40%”这样的分块,如果没有上下文(哪个公司、哪个季度、出自哪个文档)就毫无意义。

代码示例:

async def enrich_chunk(chunk: str, document: str, title: str) -> str:

"""使用LLM添加上下文前缀"""

prompt = f"""

标题:{title}

{document[:4000]}

{chunk}

提供简要上下文(1-2句话)解释此分块与完整文档的关系。格式:"此分块来自[标题],讨论[解释]。"

"""

response = await client.chat.completions.create(

model="gpt-4o-mini",

messages=[{"role": "user", "content": prompt}],

temperature=0,

max_tokens=150

)

context = response.choices[0].message.content.strip()

# 嵌入带上下文的版本

return f"{context}\n\n{chunk}"

前后对比:

之前:

"收入增长40%至3.14亿美元,利润率提高。"

之后:

"此分块来自ACME公司2024年第二季度SEC文件,讨论季度财务表现与2024年第一季度的比较。

收入增长40%至3.14亿美元,利润率提高。"

优点:

- 可减少35-49%的检索失败(根据Anthropic研究)

- 分块变得自包含,信息更完整

- 适用于向量搜索和关键词搜索

缺点:

- 昂贵(摄取时每个分块需要1次LLM调用)

- 摄取速度更慢

- 索引体积更大

使用时机:用于那些准确性远比成本重要的关键文档(如法律、医疗、财务文档)。

策略3:重排序

作用:采用两阶段检索。先用快速的向量搜索找到20-50个候选文档,然后使用专门的交叉编码器模型对它们重新评分和排序,以提升最终结果的精度。

解决的问题:向量相似度并不总是等于语义相关性。文档可能在嵌入空间中“接近”,但实际上并没有回答用户的问题。

代码示例:

from sentence_transformers import CrossEncoder

# 初始化一次

reranker = CrossEncoder('cross-encoder/ms-marco-MiniLM-L-6-v2')

async def search_with_reranking(query: str, limit: int = 5) -> list:

# 阶段1:快速向量检索(获取比最终需求更多的候选)

candidate_limit = min(limit * 4, 20)

query_embedding = await embedder.embed_query(query)

candidates = await db.query(

"SELECT content, metadata FROM chunks ORDER BY embedding <=> $1 LIMIT $2",

query_embedding, candidate_limit

)

# 阶段2:使用交叉编码器重新排序

pairs = [[query, row['content']] for row in candidates]

scores = reranker.predict(pairs)

# 按重排序分数排序并返回前N个

reranked = sorted(

zip(candidates, scores),

key=lambda x: x[1],

reverse=True

)[:limit]

return [doc for doc, score in reranked]

性能比较:

查询:"第二季度收入增长因素是什么?"

纯向量搜索(相似度分数):

1. "第二季度收入为3.14亿美元" (0.82)

2. "增长因素包括..." (0.78)

3. "第一季度,收入为..." (0.76)

重排序后(相关性分数):

1. "增长因素包括..." (0.94)

2. "第二季度收入为3.14亿美元" (0.89)

3. "第二季度表现的关键驱动因素..." (0.85)

优点:

- 显著提高结果精度

- 可以考虑更多候选文档,而不会让LLM上下文过载

- 可以修正向量搜索的排序错误

缺点:

使用时机:当结果精度比响应速度更重要时。非常适合那些错误答案成本高昂的问答系统。

策略4:查询扩展

作用:使用LLM将用户简短的、可能模糊的查询,扩展成更详细、更全面的版本。

解决的问题:用户查询通常很简短模糊。比如“什么是RAG?”,它没有说明用户想要的是架构细节、使用案例还是实施指南。

代码示例:

async def expand_query(query: str) -> str:

"""将简短查询扩展为详细版本"""

system_prompt = """

你是查询扩展助手。

接受简短的用户查询并将其扩展为更详细的版本:

1. 添加相关上下文和澄清

2. 包含相关术语和概念

3. 指定应涵盖的方面

4. 保持原始意图

5. 保持为单个连贯问题

将查询扩展为详细2-3倍,同时保持专注。

"""

response = await client.chat.completions.create(

model="gpt-4o-mini",

messages=[

{"role": "system", "content": system_prompt},

{"role": "user", "content": f"扩展此查询:{query}"}

],

temperature=0.3

)

return response.choices[0].message.content.strip()

转换示例:

输入:"什么是RAG?"

输出:"什么是检索增强生成(RAG),它如何将信息检索与语言生成相结合,其关键组件和架构是什么,以及它为问答系统提供了哪些优势?"

优点:

- 显著提高检索精度

- 更好地处理模糊、简短的查询

- 只需一次LLM调用进行增强,相对快速

缺点:

- 额外的LLM调用增加了延迟

- 可能对原本就清晰的简单查询“过度加工”

- 成本稍高

使用时机:当用户通常输入简短、模糊的问题时。非常适合聊天机器人和搜索界面。

策略5:多查询RAG

作用:针对同一个问题,生成3-4种不同的表述方式,并行搜索所有这些表述,最后对结果进行合并和去重。

解决的问题:一种特定的查询表述,可能会错过那些使用不同术语或句式表述的相关文档。

代码示例:

async def search_with_multi_query(query: str, limit: int = 5) -> list:

# 生成查询变体

variations_prompt = f"""生成此查询的3种不同表述:

"{query}"

仅返回3个查询,每行一个。"""

response = await client.chat.completions.create(

model="gpt-4o-mini",

messages=[{"role": "user", "content": variations_prompt}],

temperature=0.7

)

queries = [query] + response.choices[0].message.content.strip().split('\n')

# 并行执行所有搜索

search_tasks = []

for q in queries:

query_embedding = await embedder.embed_query(q)

task = db.fetch(

"SELECT * FROM match_chunks($1::vector, $2)",

query_embedding, limit

)

search_tasks.append(task)

results_lists = await asyncio.gather(*search_tasks)

# 按分块ID去重,保留最高相似度

seen = {}

for results in results_lists:

for row in results:

chunk_id = row['chunk_id']

if chunk_id not in seen or row['similarity'] > seen[chunk_id]['similarity']:

seen[chunk_id] = row

# 返回前N个唯一结果

return sorted(

seen.values(),

key=lambda x: x['similarity'],

reverse=True

)[:limit]

变体示例:

原始:"如何部署ML模型?"

变体1:"将机器学习模型部署到生产环境的步骤是什么?"

变体2:"ML模型部署基础设施的最佳实践"

变体3:"训练模型的生产部署选项"

优点:

- 对模糊查询有更好的召回率

- 能捕捉问题的不同侧面和表述

- 并行执行可以保持较快的整体速度

缺点:

- 需要进行多次(如4倍)数据库查询

- 更高的API调用成本

- 可能检索到一些冗余内容

使用时机:当用户的查询可能有多种有效解释或表述时。非常适合广泛的、探索性的问题。

策略6:智能体RAG

作用:为AI智能体配备多个不同的检索工具(如语义搜索、全文检索、数据库查询),让它根据对用户查询的分析,自主决定使用哪个或哪些工具。

解决的问题:并非所有问题都需要相同的检索策略。有些需要语义搜索,有些需要调取完整文档,有些则需要查询结构化数据。

代码示例:

from pydantic_ai import Agent

agent = Agent(

'openai:gpt-4o',

system_prompt='你是具有多个检索工具的RAG助手。为每个查询选择合适的工具。'

)

@agent.tool

async def search_knowledge_base(query: str, limit: int = 5) -> str:

"""文档分块的语义搜索"""

query_embedding = await embedder.embed_query(query)

results = await db.match_chunks(query_embedding, limit)

return format_results(results)

@agent.tool

async def retrieve_full_document(document_title: str) -> str:

"""当分块缺乏上下文时检索完整文档"""

result = await db.query(

"SELECT title, content FROM documents WHERE title ILIKE %s",

f"%{document_title}%"

)

return f"**{result['title']}**\n\n{result['content']}"

@agent.tool

async def sql_query(question: str) -> str:

"""查询结构化数据库获取特定数据"""

# 智能体可以为结构化数据编写SQL查询

# (在生产环境中,使用具有安全检查的适当SQL生成)

return execute_safe_sql(question)

示例流程:

用户:"完整的退款政策是什么?"

智能体推理:

1. 调用search_knowledge_base("退款政策")

→ 找到提及"refund_policy.pdf"的分块

2. 意识到分块没有完整政策

3. 调用retrieve_full_document("退款政策")

→ 返回完整文档

4. 从完整文档生成全面答案

优点:

- 高度灵活和自适应

- 能处理多样化的异构数据源

- 可以动态组合多种检索策略

缺点:

- 实现更复杂

- 智能体的行为路径不太可预测

- 由于多步推理,延迟通常更高

使用时机:当你拥有文档、数据库、API等多种异构数据源,且用户查询的复杂度差异很大时。

策略7:自反思RAG

作用:系统在检索到文档后,会先评估这些文档的相关性。如果认为结果不理想,它会自动优化查询,然后重新搜索,如此迭代,直到对结果满意或达到最大尝试次数。

解决的问题:初始搜索经常返回质量不佳的结果,但传统的RAG只能“将错就错”地使用它们。自反思RAG给了系统一个自我纠正的机会。

代码示例:

async def search_with_self_reflection(query: str, limit: int = 5, max_iterations: int = 2) -> dict:

"""自校正搜索循环"""

for iteration in range(max_iterations):

# 执行搜索

results = await vector_search(query, limit)

# 使用LLM评估结果的相关性

grade_prompt = f"""

查询:{query}

检索到的文档:

{format_docs_for_grading(results)}

按1-5分评估这些文档与查询的相关性。

仅用数字回答。"""

grade_response = await client.chat.completions.create(

model="gpt-4o-mini",

messages=[{"role": "user", "content": grade_prompt}],

temperature=0

)

grade = int(grade_response.choices[0].message.content.strip().split()[0])

# 如果结果足够好,返回它们

if grade >= 3:

return {

"results": results,

"iterations": iteration + 1,

"final_query": query

}

# 如果结果差且不是最后一次迭代,优化查询

if iteration < max_iterations - 1:

refine_prompt = f"""

查询"{query}"返回了低相关性结果。

建议一个可能找到更好文档的改进查询。

仅用改进后的查询回答。"""

refined_response = await client.chat.completions.create(

model="gpt-4o-mini",

messages=[{"role": "user", "content": refine_prompt}],

temperature=0.5

)

query = refined_response.choices[0].message.content.strip()

# 返回最佳尝试

return {

"results": results,

"iterations": max_iterations,

"final_query": query

}

迭代示例:

迭代1:

查询:"部署"

评分:2/5(太模糊)

迭代2:

优化查询:"机器学习模型部署到生产环境"

评分:4/5(良好结果)

优点:

- 具备自校正能力

- 能够在多次尝试中持续改进

- 可以从糟糕的初始搜索结果中恢复过来

缺点:

- 延迟最高(通常需要2-3次LLM调用)

- 最昂贵的策略之一

- 对于某些真正困难的查询可能仍然失败

使用时机:当答案的准确性至关重要,且可以接受一定的延迟时。非常适合研究型应用和复杂的专业查询。

策略8:知识图谱

作用:将向量搜索与图数据库(如Neo4j)的能力相结合,构建知识图谱。不仅检索文本,还能捕捉并利用实体(如人、公司、地点)之间的显式关系(如“CEO of”、“located in”)。

解决的问题:纯向量搜索能找到语义相似的文本,但会错过明确的、结构化的关系信息。

使用Graphiti的概念示例:

from graphiti_core import Graphiti

from graphiti_core.nodes import EpisodeType

# 初始化Graphiti(连接到Neo4j)

graphiti = Graphiti("neo4j://localhost:7687", "neo4j", "password")

async def ingest_document(text: str, source: str):

"""摄取到知识图谱"""

# Graphiti自动提取实体和关系

await graphiti.add_episode(

name=source,

episode_body=text,

source=EpisodeType.text,

source_description=f"文档:{source}"

)

async def search_knowledge_graph(query: str) -> str:

"""混合搜索:语义 + 关键词 + 图"""

# Graphiti结合了多种搜索方式:

# - 语义相似性(嵌入)

# - BM25关键词搜索

# - 图结构遍历

# - 时间上下文

results = await graphiti.search(query=query, num_results=5)

# 格式化图结果

formatted = []

for result in results:

formatted.append(

f"实体:{result.node.name}\n"

f"类型:{result.node.type}\n"

f"关系:{result.relationships}"

)

return "\n---\n".join(formatted)

查询流程示例:

查询:"谁运营ACME公司,第二季度发生了什么变化?"

纯向量搜索:

- "ACME公司CEO信息..."

- "第二季度变化包括..."

知识图谱搜索:

ACME公司(公司)

├─ HAS_CEO → Jane Smith(人物)

├─ REPORTED_REVENUE → $314M(财务)

│ └─ PERIOD → Q2 2024

└─ LOCATED_IN → California(地点)

结果:可以回答 “Jane Smith运营ACME公司,收入在第二季度增加到3.14亿美元”

优点:

- 能捕捉向量搜索容易错过的实体关系

- 可显著减少大模型的“幻觉”

- 非常适合互连的、富含关系的数据

缺点:

- 需要维护Neo4j等图数据库基础设施

- 设置和持续维护比较复杂

- 通常比纯向量搜索更慢、更昂贵

- 需要实体提取流程

使用时机:当实体之间的关系信息对于回答问题至关重要时(如医疗知识网络、财务系统、研究数据库)。

策略9:分层RAG

作用:为文档创建父-子分块结构。搜索时,在小子分块(如500字符)中进行,以获得高精度的匹配;返回结果时,则提供其所属的大父分块(如2000字符),以提供充足的上下文。

解决的问题:小子分块能精确匹配查询,但缺乏理解问题所需的完整上下文;大分块有丰富上下文,但可能在语义匹配上不够精准。

代码示例:

def ingest_hierarchical(document: str, title: str):

"""创建父-子结构"""

# 父级:大块(2000字符)

parent_chunks = [document[i:i+2000] for i in range(0, len(document), 2000)]

for parent_id, parent in enumerate(parent_chunks):

# 存储父级

metadata = {"heading": f"{title} - 部分 {parent_id}"}

db.execute(

"INSERT INTO parent_chunks (id, content, metadata) VALUES (%s, %s, %s)",

(parent_id, parent, json.dumps(metadata))

)

# 子级:小子分块(500字符)

child_chunks = [parent[j:j+500] for j in range(0, len(parent), 500)]

for child in child_chunks:

embedding = get_embedding(child)

db.execute(

"INSERT INTO child_chunks (content, embedding, parent_id) VALUES (%s, %s, %s)",

(child, embedding, parent_id)

)

async def hierarchical_search(query: str) -> str:

"""搜索子级,返回父级"""

query_emb = get_embedding(query)

# 搜索小子级以提高匹配精度

results = await db.query(

"""SELECT p.content, p.metadata

FROM child_chunks c

JOIN parent_chunks p ON c.parent_id = p.id

ORDER BY c.embedding <=> %s LIMIT 3""",

query_emb

)

# 返回大父级以获取完整上下文

formatted = []

for content, metadata in results:

meta = json.loads(metadata)

formatted.append(f"[{meta['heading']}]\n{content}")

return "\n\n".join(formatted)

优点:

- 巧妙平衡了检索精度与答案的上下文丰富度

- 减少了搜索过程中的噪音

- 对于本身就具有层次结构的文档非常自然

缺点:

- 需要设计并维护父-子数据模式

- 索引过程更复杂

- 需要根据文档特点仔细设计层次大小

使用时机:当处理的文档具有清晰的层次结构时(如技术手册、法律文件、研究论文)。

策略10:延迟分块

作用:与传统方法(先分块再嵌入)相反,延迟分块先使用具有长上下文能力的Transformer模型处理整个文档,获得每个标记(token)的嵌入,然后再定义分块边界并池化相应标记的嵌入。

解决的问题:传统的先分块再嵌入的方法,每个分块的嵌入完全丢失了该分块之外的长距离文档上下文。

概念示例:

def late_chunk(text: str, chunk_size=512) -> list:

"""先嵌入完整文档,再进行分块"""

# 步骤1:嵌入整个文档(假设模型支持长上下文,如8192个标记)

full_doc_token_embeddings = transformer_embed(text) # 得到标记级别的嵌入

# 步骤2:定义分块边界

tokens = tokenize(text)

chunk_boundaries = range(0, len(tokens), chunk_size)

# 步骤3:为每个分块池化对应标记的嵌入

chunks_with_embeddings = []

for start in chunk_boundaries:

end = start + chunk_size

chunk_text = detokenize(tokens[start:end])

# 平均池化对应标记的嵌入(这些嵌入包含了完整文档的上下文信息!)

chunk_embedding = mean_pool(full_doc_token_embeddings[start:end])

chunks_with_embeddings.append((chunk_text, chunk_embedding))

return chunks_with_embeddings

优点:

- 每个分块的嵌入都隐式包含了完整文档的上下文信息

- 能更有效地利用现代长上下文语言模型

- 分块间的语义连贯性更好

缺点:

- 需要能够处理长上下文的嵌入模型

- 实现比传统分块更复杂

- 受所选嵌入模型的最大标记长度限制

使用时机:当文档的整体上下文对于理解任何一个局部片段都至关重要时(如密集的技术文档、法律合同)。

策略11:微调嵌入

作用:在你自己特定领域的查询-文档配对数据上,对通用的嵌入模型(如 all-MiniLM-L6-v2)进行额外的训练(Fine-tuning),使其更“懂”你的专业领域。

解决的问题:通用的预训练嵌入模型可能无法充分理解特定领域的专业术语、行话或缩写(例如医学术语、法律条文、金融指标)。

代码示例:

from sentence_transformers import SentenceTransformer, losses

from torch.utils.data import DataLoader

def prepare_training_data():

"""准备领域特定的查询-文档配对数据"""

return [

("什么是EBITDA?", "EBITDA(利息、税项、折旧及摊销前利润..."),

("解释资本支出", "资本支出(CapEx)指的是..."),

# ... 准备数千对这样的数据

]

def fine_tune_model():

"""在领域数据上微调嵌入模型"""

# 加载基础模型

model = SentenceTransformer('all-MiniLM-L6-v2')

# 准备训练数据

train_examples = prepare_training_data()

train_dataloader = DataLoader(train_examples, shuffle=True, batch_size=16)

# 定义损失函数(如多重负例排序损失)

train_loss = losses.MultipleNegativesRankingLoss(model)

# 执行训练

model.fit(

train_objectives=[(train_dataloader, train_loss)],

epochs=3,

warmup_steps=100

)

model.save('./fine_tuned_financial_model')

return model

# 使用微调后的模型

embedding_model = SentenceTransformer('./fine_tuned_financial_model')

性能比较:

查询:"什么是营运资金?"

通用嵌入结果:

1. "营运资金包括..." (0.72)

2. "资本市场提供..." (0.68) ← 错误!概念漂移

3. "工作条件在..." (0.65) ← 完全错误!

微调后的嵌入结果:

1. "营运资金包括..." (0.89)

2. "营运资金比率计算..." (0.84)

3. "有效管理营运资金..." (0.81)

优点:

- 通常能将领域特定查询的准确率提升5-10%

- 模型能更好地理解领域内的专有术语和概念

- 较小的、经过领域微调的模型,性能可能超过更大的通用模型

缺点:

- 需要收集和准备高质量的领域训练数据

- 需要额外的训练时间和计算资源

- 随着领域知识更新,可能需要定期重新训练

使用时机:用于那些通用嵌入模型表现不佳的高度专业化领域(如医疗、法律、金融、特定技术栈)。

组合策略的力量:实现94%准确率的关键

以下是本文最核心的洞察:单个策略是好的,但精心组合多个策略才能带来变革性的提升。

在测试了数十种组合后,我发现了三种对不同应用场景特别有效的强力组合。

组合1:生产就绪堆栈(最佳整体平衡)

策略:上下文感知分块 + 重排序 + 查询扩展 + 智能体RAG

为什么有效:这个组合像一个高效的团队,每个成员解决不同的问题:

- 上下文感知分块 确保输入LLM的文本块本身是语义连贯的。

- 查询扩展 主动处理用户输入的模糊性和不完整性。

- 重排序 作为质量守门员,纠正向量搜索的排序偏差。

- 智能体RAG 提供最终的灵活性和适应性,应对复杂场景。

性能:约92%准确率,平均延迟1.2秒

成本:约 $0.003 每次查询

最适合:通用生产系统、客户支持聊天机器人、内部知识库

组合2:高准确率堆栈(关键任务应用)

策略:上下文检索 + 多查询RAG + 重排序 + 自反思RAG

为什么有效:这个组合追求极致的准确性和可靠性,通过冗余和自校正来实现:

- 上下文检索 确保每个检索单元信息完备。

- 多查询RAG 从多个角度“撒网”,最大化召回率。

- 重排序 精细过滤,确保Top结果高度相关。

- 自反思RAG 提供最终检查,不理想则重试。

性能:约96%准确率,平均延迟2.5秒

成本:约 $0.008 每次查询

最适合:医疗诊断辅助、法律文件分析、金融决策支持等错误成本极高的场景。

组合3:领域专家堆栈(深度垂直领域)

策略:微调嵌入 + 上下文检索 + 知识图谱 + 重排序

为什么有效:这个组合在理解的深度和精度上层层加码:

- 微调嵌入 让模型从底层“懂行话”。

- 上下文检索 在分块层面补充领域背景。

- 知识图谱 显式地建模和利用领域内复杂的实体关系。

- 重排序 用领域知识进行最终的相关性评判。

性能:领域内查询约94%准确率,平均延迟1.8秒

成本:约 $0.005 每次查询(不考虑初始训练成本)

最适合:具有复杂术语和关系的专业领域,如医疗知识库、法律判例系统、金融研报分析。

实施路线图:从简单开始,智能扩展

不要试图一次性实施所有策略。以下是一个经过验证的、循序渐进的实用路线图:

阶段1:奠定基础(第1周)

- 实施上下文感知分块,立即替换掉简陋的固定大小分割。

- 搭建具有合适嵌入模型的基本向量搜索流程。

- 建立评估基准,用一批测试查询测量当前的准确率、召回率和延迟。

阶段2:获取快速胜利(第2-3周)

- 添加重排序器。这通常是提升准确率性价比最高的单一策略。

- 实现查询扩展,显著改善对模糊查询的处理能力。

- 再次测量性能,量化改进效果。

阶段3:引入高级能力(第4-6周)

- 根据你的查询模式,选择添加多查询RAG(如果查询多样)或智能体RAG(如果数据源和查询类型复杂)。

- 为最关键或最常出错的查询类型,实现自反思RAG作为兜底策略。

- 进行系统性的微调和性能优化。

阶段4:深度专业化(第2个月及以上)

- 为核心、高价值的文档添加上下文检索,进一步提升其回答质量。

- 如果你的数据中实体关系非常重要,开始规划和试点知识图谱集成。

- 当有足够高质量的领域数据后,启动嵌入模型微调项目,追求极致的领域性能。

实际应用结果

以下是我将这些策略组合应用于真实生产系统后观察到的变化:

案例1:电商客户支持聊天机器人

- 之前:仅58%的答案准确,35%的对话需要转人工。

- 之后(采用组合1):91%答案准确,转人工率降至12%。

- 核心策略:上下文感知分块 + 重排序 + 查询扩展 + 智能体RAG

- 业务影响:客服工单数量减少70%,估算每年节省成本约 $180K。

案例2:医疗文档检索与问答系统

- 之前:62%准确率,因风险过高无法投入临床使用。

- 之后(采用组合2):96%准确率,通过评审并用于辅助临床工作。

- 核心策略:上下文检索 + 多查询 + 重排序 + 自反思

- 业务影响:临床医生平均每天节省约4小时的文档查找与核对时间。

案例3:律师事务所合同条款分析

- 之前:65%准确率,仍需大量律师人工复核,价值有限。

- 之后(采用组合3):对合同关键条款的识别准确率达到94%。

- 核心策略:微调嵌入 + 上下文检索 + 知识图谱

- 业务影响:合同审查整体速度提升60%,显著降低了遗漏关键条款的风险。

常见错误与避坑指南

在协助多个团队实施这些策略后,我总结出以下最常见的误区:

错误1:试图一次性应用所有策略

- 问题:系统变得异常复杂、难以调试、成本高昂,且收益不明确。

- 解决方案:严格遵守上述路线图,从简单的组合1开始,建立基线,然后根据明确的性能瓶颈和数据特点,逐步增加复杂度。

错误2:没有建立可量化的评估基准

- 问题:无法证明任何改进的有效性,也不知道优化方向是否正确。

- 解决方案:在项目启动初期,就创建一个包含各种查询类型的测试数据集,并定义清晰的评估指标(准确率、召回率@K、延迟)。每次策略变更前后都必须测量。

错误3:坚守过时的固定分块方法

- 问题:这是许多RAG系统表现不佳的根源,破坏了文本的语义流。

- 解决方案:将“上下文感知分块”或类似的智能分块方法视为新的基础,永远不要再使用基于字符数的简单分割。

错误4:忽视重排序器

- 问题:盲目相信向量相似度等于答案相关性,导致系统性能陷入瓶颈。

- 解决方案:将重排序视为优先级最高的“快速获胜”策略。它的投入产出比通常非常高。

错误5:不对用户查询进行任何预处理

- 问题:直接使用原始、模糊、有错别字的查询进行搜索,失败率很高。

- 解决方案:至少实现“查询扩展”,这是处理模糊查询性价比极高的方法。更进一步可以考虑拼写纠正、查询规范化等。

错误6:坚持单一的、固定的检索策略

- 问题:不同的查询需要不同的检索方式(有时要精度,有时要广度,有时要查关系)。

- 解决方案:采用“智能体RAG”模式,赋予系统根据查询意图自主选择最佳工具的能力。

RAG的未来趋势

这个领域仍在飞速发展,以下是一些值得关注的方向:

- 更小、更快的专用模型:新兴的嵌入和重排序模型,旨在以十分之一的计算成本实现90%以上的SOTA性能。

- 多模态RAG:检索对象不再局限于文本,而是扩展到图像、表格、图表,为LLM提供更丰富的上下文。

- 学习的稀疏检索:像SPLADE这样的模型,尝试结合神经网络的表示学习能力和传统稀疏检索(如BM25)的效率与可解释性。

写在最后

构建一个真正生产就绪的RAG系统,其核心不在于追逐最花哨的新技术,而在于深刻理解“朴素RAG”为何会失败,并系统性地、有步骤地应用策略去填补这些缺陷。

从坚实的基础开始(智能分块+重排序),仅在明确需要时才增加复杂性,并且始终坚持用数据来衡量每一次改进。

本文分享的策略组合将我的系统准确率从60%提升到了94%。当然,根据你的具体业务领域、数据特性和应用场景,最适合你的“配方”可能会有所不同。

关键是要简单启动、测量一切、基于真实的性能数据持续迭代。