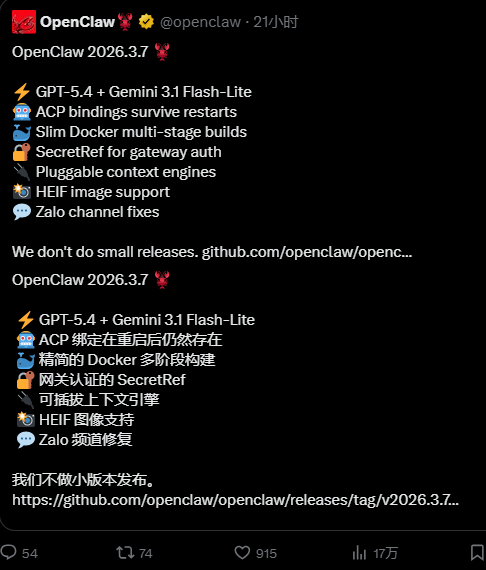

近期,围绕本地AI Agent框架 OpenClaw(因其图标被昵称为“龙虾”)的讨论热度不减。就在昨天,该项目发布了代号为 v2026.3.7 的重要版本更新。开发者社区普遍认为,此次更新解决了阻碍 AI Agent 迈向“生产级”应用的两个核心痛点:上下文记忆管理和服务连接稳定性。

官方在社交平台上直言:“我们不做小版本发布!”,足见此次更新的分量。

三大核心进化:迈向企业级可靠性的关键一步

1. 可插拔上下文引擎 (Pluggable Context Engines):像换“大脑”一样自定义记忆

这是本次更新中最具技术深度的部分。OpenClaw 引入了全新的 ContextEngine 插件接口,并开放了完整的生命周期钩子(从 bootstrap 到 afterTurn)。

简单来说,这相当于为 AI 提供了可插拔的“记忆管理系统”。在此之前,Agent 处理上下文(记忆)的逻辑,如压缩、清理和存储策略,通常是硬编码在框架核心中的。开发者很难根据特定业务需求去深度定制 Agent 的记忆行为。

现在,一切都改变了。通过可插拔的上下文引擎,你可以:

- 构建专属记忆策略:如果你想让 Agent 的记忆存进知识图谱或带自定义评分的向量数据库,写一个对应的引擎插件即可实现。

- 实现“永不遗忘”或“智能淡忘”:为需要长期跟踪状态的任务开发无损记忆策略,或模拟人类记忆随时间的衰减过程。

- 解耦核心依赖:例如,你可以通过

lossless-claw 这类社区插件来实现无损上下文管理,而完全无需修改 OpenClaw 的核心代码。

一位早期用户反馈道:“旧的记忆压缩机制有时会导致我的 Agent 忘记任务目标或已学会的技能,这很令人沮丧。现在,我可以用第三方服务(如 supermemory.ai)作为云端备份,定期同步对话,同时保持本地记忆文件的精简。这彻底解决了‘记忆断片’的问题。”

对于致力于构建长期、稳定运行的 AI 应用开发者而言,这项功能提供了前所未有的灵活性,也是迈向企业级AI应用的关键一环。

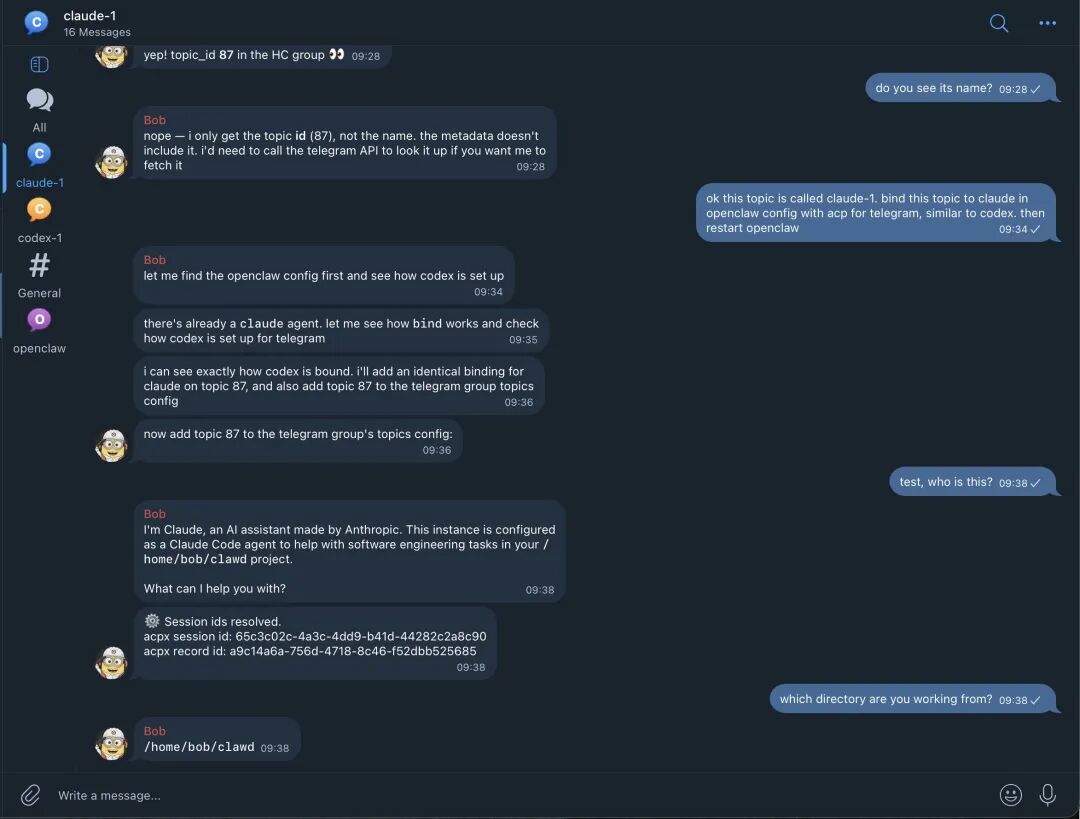

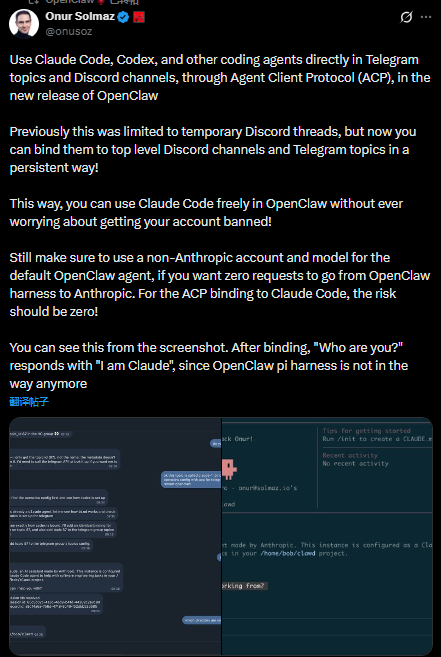

2. ACP持久化绑定与精准路由:重启不断联,对话秒恢复

对于在 Telegram、Discord 等平台上部署 AI 助手的用户,连接稳定性一直是个老大难问题。OpenClaw v2026.3.7 对此进行了重要改进:

- ACP 绑定持久化:ACP (Agent Client Protocol) 的绑定关系现在可以持久化存储。这意味着即使服务器或宿主机重启,之前的对话连接和路由配置依然有效,Agent 能“秒接”之前的对话上下文,不会出现断联后需要手动重建的尴尬。

- Topic 级别路由:在 Telegram 的论坛模式中,现在支持按不同的 Topic(主题)绑定不同的

agentId。这使得在一个群组内可以部署多个各司其职的 AI 专家(例如,一个负责代码审核,一个负责内容创作),且它们的会话是完全隔离的。

项目维护者 Onur Solmaz 表示,新版本允许用户通过 ACP,直接在 Telegram 主题和 Discord 频道中持久化地使用 Claude Code、Codex 等编码代理。“这样,你可以更自由地使用这些强大的编码助手,而无需过度担心平台方的使用限制。”

许多用户反馈,“ACP重启持久化”是最大的体验提升点。过去,重启服务器后需要手动重新配置机器人连接,现在这个问题被完美解决,极大地增强了服务的可靠性。

3. Docker镜像“瘦身”与性能优化

新版本对部署体验进行了优化,重构了 Dockerfile,采用多阶段构建技术:

- Slim 变体镜像:通过设置环境变量

OPENCLAW_VARIANT=slim,可以构建一个不含额外构建工具和 Bun 开发环境的极简运行时镜像。

- 预烘焙依赖:支持通过

OPENCLAW_EXTENSIONS 环境变量在构建镜像时预装指定的插件依赖,这能显著缩短容器首次启动时的冷启动时间。

这意味着部署所需的镜像体积可能从数GB大幅缩减至几百MB,使得云端部署速度更快、存储成本更低,尤其适合资源受限或追求高效运维的场景。

其他重要更新

- 模型支持更新:已接入 Google 最新发布的 Gemini 3.1 Flash-Lite 模型。用户可以通过配置,让复杂的逻辑思考由 GPT-5.4 处理,而让数据抓取、内容审计等任务由快速、低成本的 Gemini Flash-Lite 执行,据称可降低高达 90% 的 Token 成本。

- 安全性增强:引入了网关认证的 Secret Ref(密钥引用) 系统。现在,API密钥等敏感信息可以加密存储,并与配置文件分离。Agent 在调用外部服务时通过引用获取密钥,避免了密钥明文暴露在日志或配置文件中的风险。

- 功能完善:增加了对 iPhone 照片 HEIF 格式 的支持,并强化了 Cron 任务存储的权限管理(强制执行 0600 权限),进一步提升了系统安全性。

社区反响:本地AI的生产力转折点

v2026.3.7 版本虽然版本号看似常规,但其带来的稳定性和可扩展性提升,让社区看到了本地AI Agent迈向生产级别的曙光。

有用户评价道:“我们正处于本地 AI 的转折点。如果你每月还在为云端 AI API 支付高额费用,或许该重新评估了。本地 AI 不仅长期成本更低,而且在隐私、可靠性和可控性上优势明显。这次更新证明,你完全可以在消费级硬件(比如一台几百美元的 Mac Mini)上,运行起可靠的企业级 AI 业务流程。”

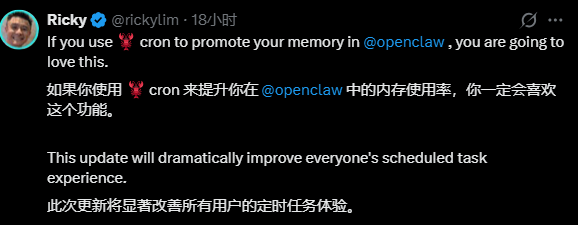

特别是“可插拔上下文引擎”备受开发者期待。用户 @Ricky 指出,这显著改善了定时任务(cron)的体验:“以前,早上运行的新闻摘要可能无法包含几小时前保存的内容。现在,每次计划任务都能读取到最新的记忆状态,不再有隐形的信息过时问题。”

给新手的部署与配置建议

OpenClaw 的流行让更多人开始尝试部署自己的“私人数字员工”。对于新手,选择合适的部署环境和正确配置至关重要。

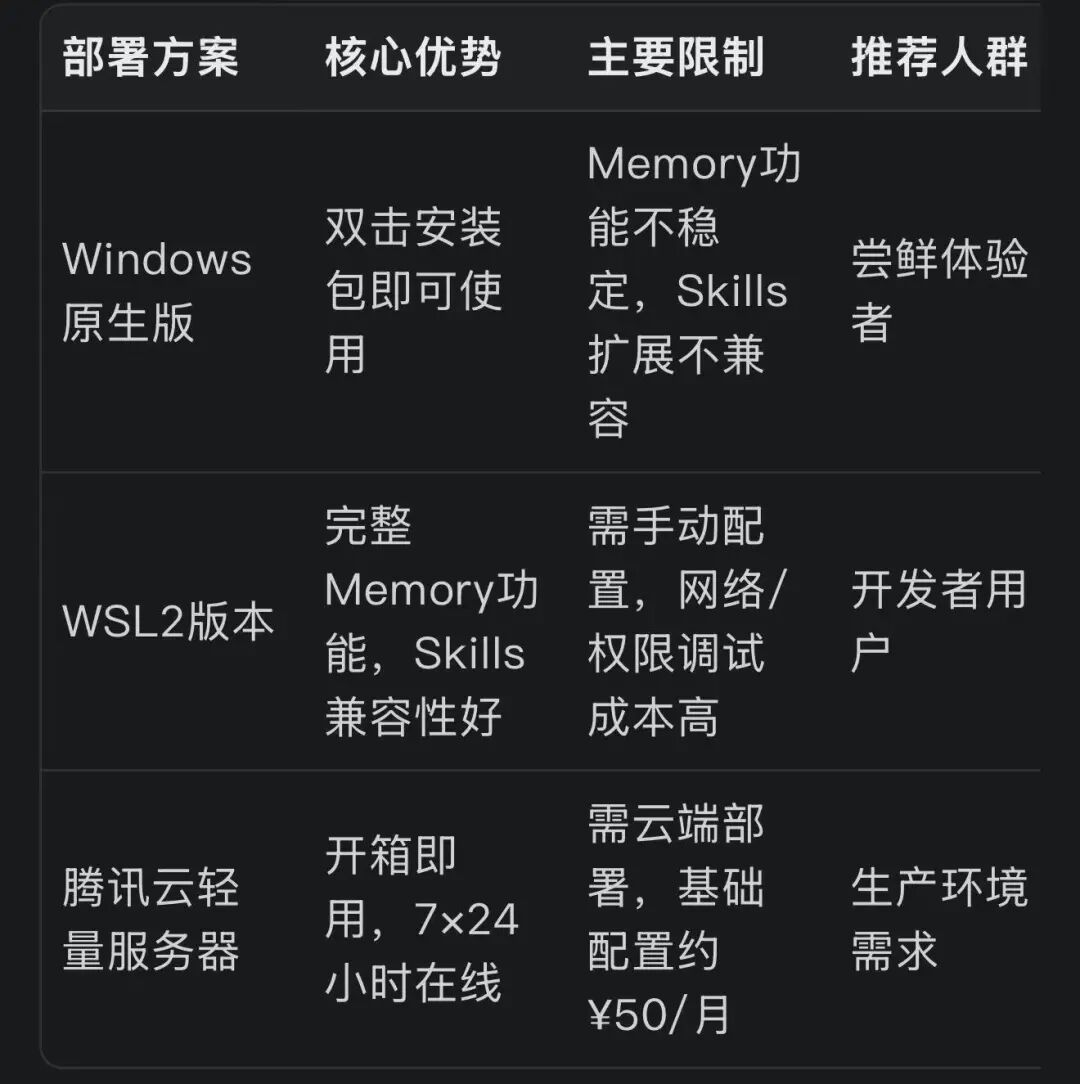

1. 部署方案选择

不同的部署方式各有优劣,建议根据自身需求选择:

| 部署方案 |

核心优势 |

主要限制 |

推荐人群 |

| Windows 原生版 |

双击安装包即可使用 |

Memory功能可能不稳定,Skills扩展兼容性一般 |

尝鲜体验者 |

| WSL2 版本 |

完整的Memory功能,Skills兼容性好 |

需手动配置,网络/权限调试有一定成本 |

开发者用户 |

| 云端服务器(如腾讯云轻量) |

开箱即用,7×24小时在线 |

需付费,基础配置约¥50/月 |

有生产环境需求的用户 |

2. 关键配置避坑

错误的配置可能导致Agent“失忆”或性能低下:

- 调整上下文长度:如果使用 Ollama 等本地模型,注意其默认上下文长度(如4096)。处理长文档或多轮对话时,建议在模型启动参数中调整至 16384 或更高。

- 模型规格匹配硬件:根据服务器内存选择模型。7B参数模型约需8GB内存,适合日常问答;13B模型约需16GB内存,逻辑推理能力更强。

- 监控资源使用:部署后定期检查CPU、内存占用。若内存使用率长期高于85%,应考虑升级服务器配置或换用量化版本(如4-bit)的模型。

结语

OpenClaw v2026.3.7 的发布,标志着这个热门的开源项目正在从“极客玩具”快速向“生产工具”演进。通过解决记忆管理、连接稳定性和部署效率这些底层但关键的问题,它让在消费级硬件上运行一个可靠、强大且私有的 AI Agent 变得更加可行。随着Agent技术的普及,未来或许每个人都能拥有一个7x24小时在线的“数字同事”,而像 OpenClaw 这样的框架,正是搭建这一切的基石。其 GitHub 星标数已迅速增长至 28.3k,也印证了社区对其方向的认可。