多数大模型能生成 “看起来像” 研究的文本,但极少数能真正做研究 —— 提出假设、收集证据、执行可复现的推导、迭代验证直至结论成立。

此前发布了 BabyVision 评测基准的 UniPat AI 在其最新的 Blog《UniScientist: Advancing Universal Scientific Research Intelligence》中,给出了一个清晰而系统的答案。它们开源的 UniScientist 模型旨在闭合“自主科研”这一能力环路。令人瞩目的是,这个仅有 30B 参数的模型,在 FrontierScience-Research 和 ResearchRubrics 等专注于科学研究的榜单上,其表现匹敌甚至超越了参数量大一个数量级的顶尖闭源模型。

“会写报告”不等于“会做研究”:实现流程闭环才是真能力

当下许多模型处理“研究任务”时,往往停留在表面:引经据典、逻辑清晰、格式规范,看起来像模像样。但核心问题在于,它们常常陷入“叙事推理”的陷阱,或从预设“结论”出发进行解释——说得头头是道,但缺乏扎实验证,推导过程脆弱,可复现性弱。

UniScientist 直指这一核心缺口。它让一个仅 30B 参数的模型,具备了“自主科学研究”的潜力——能够在开放问题中持续地提出假设、证伪、修正,直到证据状态趋于稳定,并将全过程沉淀为结构化的研究成果。这背后的潜台词很明确:真正的科研智能,不仅是把报告写漂亮,更是要把“假设-证据-验证”的完整循环跑通。

破解数据瓶颈:融合模型生成与专家验证

UniScientist 首先攻克的是高质量科研训练数据的构建难题。现有方案大多处于两个极端:纯人工标注真实精准但成本高昂、速度慢;纯合成数据规模大但往往缺乏学科深度和可验证的精度。

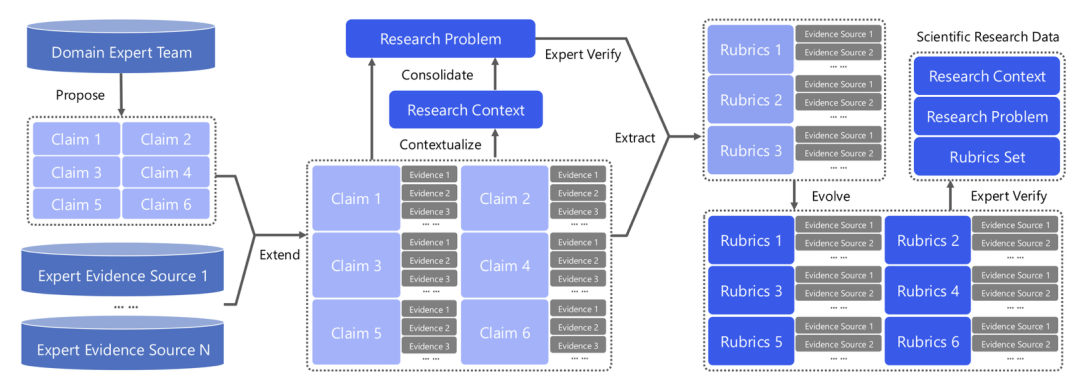

团队的关键洞察在于利用了一种不对称性:大语言模型擅长跨学科、大规模地生成候选研究问题和解决方案草案;而人类专家则更擅长对研究的真伪与质量进行鉴别,其成本和难度远低于从零创造,并能提供高精度的学科把关。

基于此,UniScientist 设计了一套高效的分工协作数据引擎:让模型负责规模与多样性的初稿生成,让人类专家负责质量与可验证性的最终裁决。这种方法产出的训练实例,既具备了广泛的专业覆盖面,又拥有严格的验证保障。

形式化科学研究:证据状态与溯因假设的动态系统

与仅仅优化工具调用或检索精度不同,UniScientist 在更本质的层面进行了形式化建模。它将开放式科研过程建模为一个基于两个核心操作的动态系统:主动证据整合 与 模型溯因。

系统的核心是一个持续演化的“证据状态”,证据被明确分为两类:

- Evidence-Grounded:来自外部权威来源,或内部产出但经过明确检查验证的证据。

- Formally-Derivable:通过符号推导、数值计算、仿真实验等可复现程序得到的证据。

系统循环执行三个动作:1. 产生假说;2. 获取外部权威信息证据、进行计算和推导;3. 进行溯因更新,使假说更好地解释当前证据状态。这个过程持续迭代,直至证据足够完整和稳定,最终将整个研究过程转化为严谨的科学成果。这一形式化将“科研智能”从一个远大理想,变成了可训练、可评估、可迭代的具体对象。

将开放问题转化为“可验证的单元测试”

UniScientist 提出了“进化式多学科合成”数据引擎,它承担两项关键功能:

- 从经过专家验证的科学主张出发,将其扩展为复杂的研究级问题。

- 同步合成评测这些问题的“量规”(Rubrics)。这些 Rubrics 不评估文风或格式,而是评估具体的科学发现是否已被达成。

其最具辨识度的设计在于:一份开放式科研成果被分解为 N 个封闭的、可独立验证的 Rubric 检查项。每个 Rubric 项都力求原子化、客观、可证据落地或可形式化推导,并强调一致性、区分度和原子性。

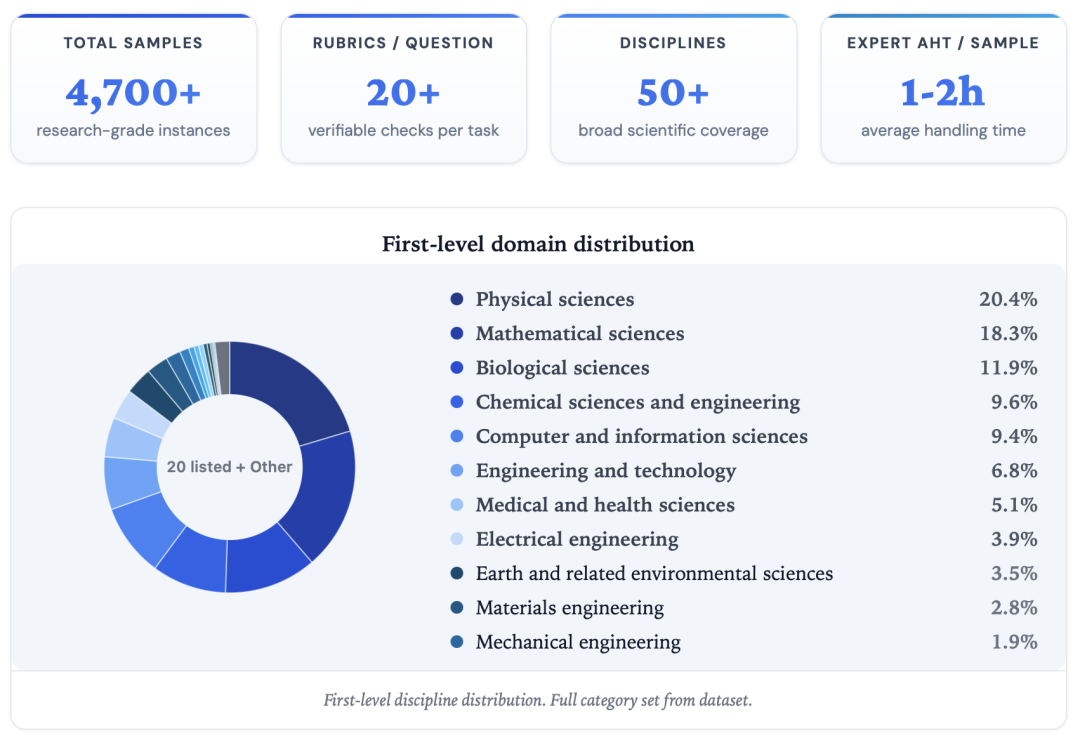

当前数据集已包含超过 4,700 个研究级实例,每个实例附有 20+ 条 Rubric 项,覆盖 50+ 学科和 400+ 研究方向,专家标注平均每条样本投入 1-2 小时。

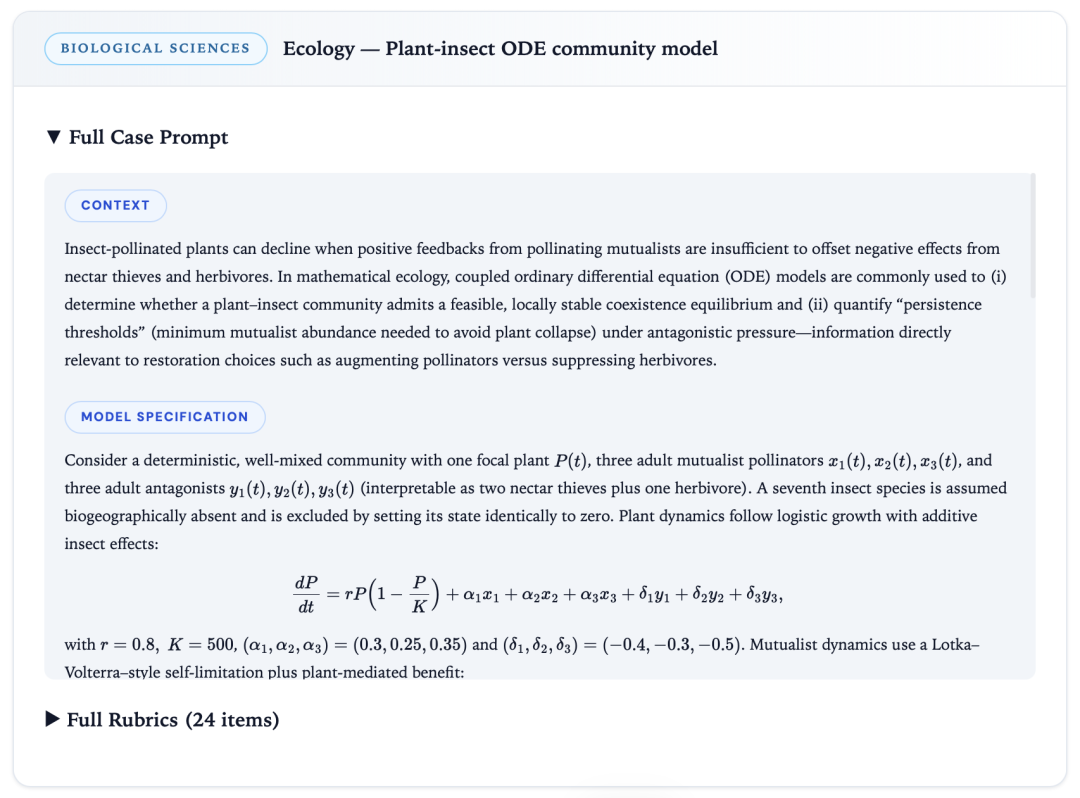

这些数据集中包含的问题都具有真实的科研质感,没有任何一道可以通过简单匹配记忆中的答案来解决。每一道都要求完整的科研链条——文献调研、假设形成、实验或推导设计、分析验证以及最终成果的收敛。下图展示的是一道生态学方向的示例。

从单点生成到群体智慧

UniScientist 引入了一个额外的训练目标——成果聚合目标。给定同一问题的 N 份候选科研成果,模型需要学会融合各家优点,产出一份更完整、更稳健的最终成果。通过基于 Rubric 得分的拒绝采样来筛选高质量参考答案,模型的聚合能力与科研生成能力被一同训练。

这实际上将 “集体科研智能” 的理念写入了训练过程:模型不仅学会了产出研究,还学会了比较、取舍、整合与自我进化。

30B 小模型比肩顶级闭源系统

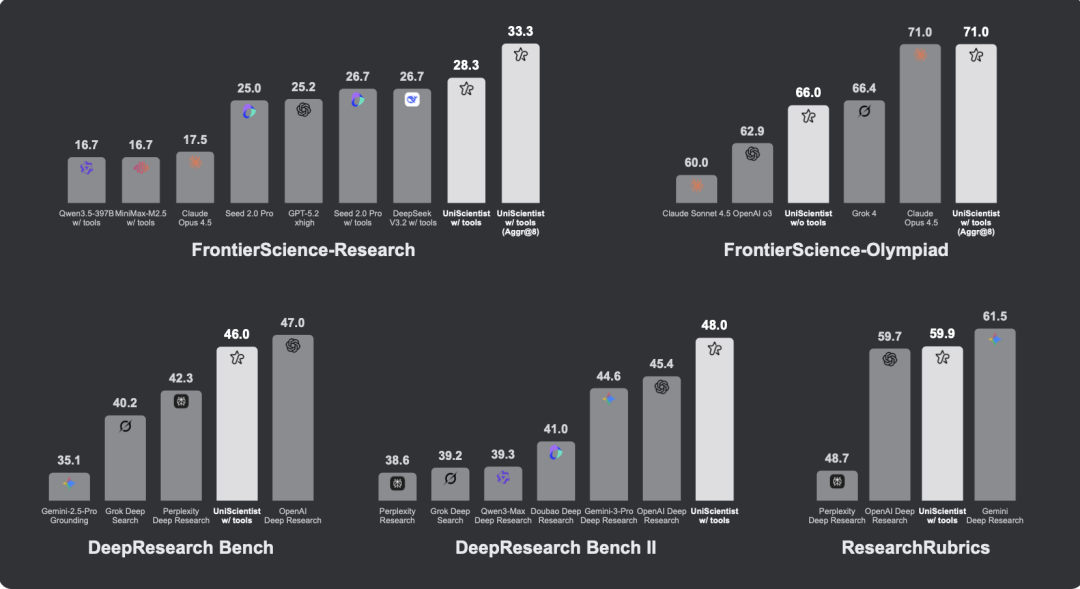

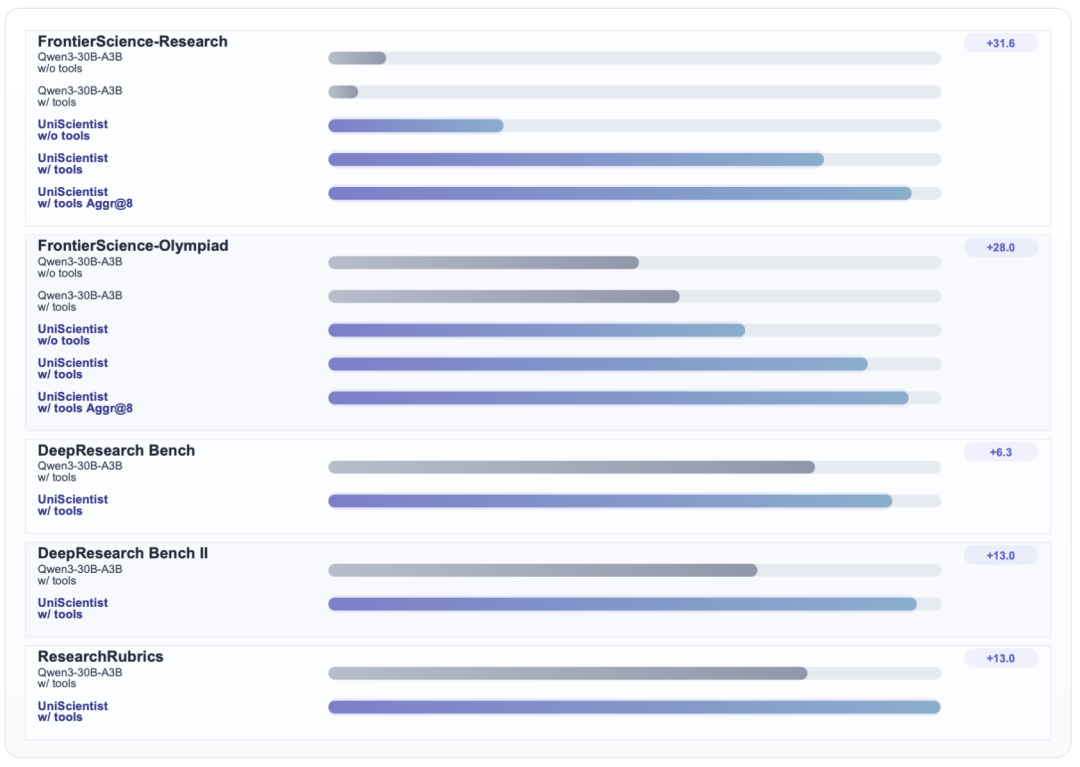

评测结果引人注目。UniScientist-30B-A3B(一个仅激活 3B 参数的小模型)在 FrontierScience-Research 上达到 28.3 分,超越了包括 Claude Opus 4.5、Gemini 3 Pro、GPT-5.2 以及工具调用模式下的 DeepSeek V3.2 和 Seed 2.0 Pro 在内的多个强大模型。在成果聚合模式下,得分进一步提升至 33.3。

在 FrontierScience-Olympiad 上,启用工具的 UniScientist 得分 71.0,与 Claude Opus 4.5 持平。在 DeepResearch Bench 系列等分布外基准上,其表现也与一系列顶级闭源系统相当。

一个重要发现是:即使在无工具的评测条件下,模型性能仍有显著提升。这表明性能增益并非单纯源于更频繁的工具使用,模型自身的研究推理能力确实通过训练得到了根本性增强。

下一步:从可复现推理迈向真实世界实验

科学研究不止于形成合理的叙事,许多结论依赖于可执行、可复现的计算与仿真。UniScientist 集成了代码解释器,将研究流程从叙事式推理升级为 “测试-修正” 循环:假设被实例化为计算实验,其结果直接用于确认、推翻或细化假设。

目前,系统的能力主要集中在可复现推理与仿真计算范围内。对真实世界研究资源的编排——例如可靠地调度大规模 GPU 任务、协调湿实验流程——尚未实现。团队明确将下一步方向定为:将框架扩展到对真实实验与计算基础设施的受控编排与执行,以期进一步加速科学发现。

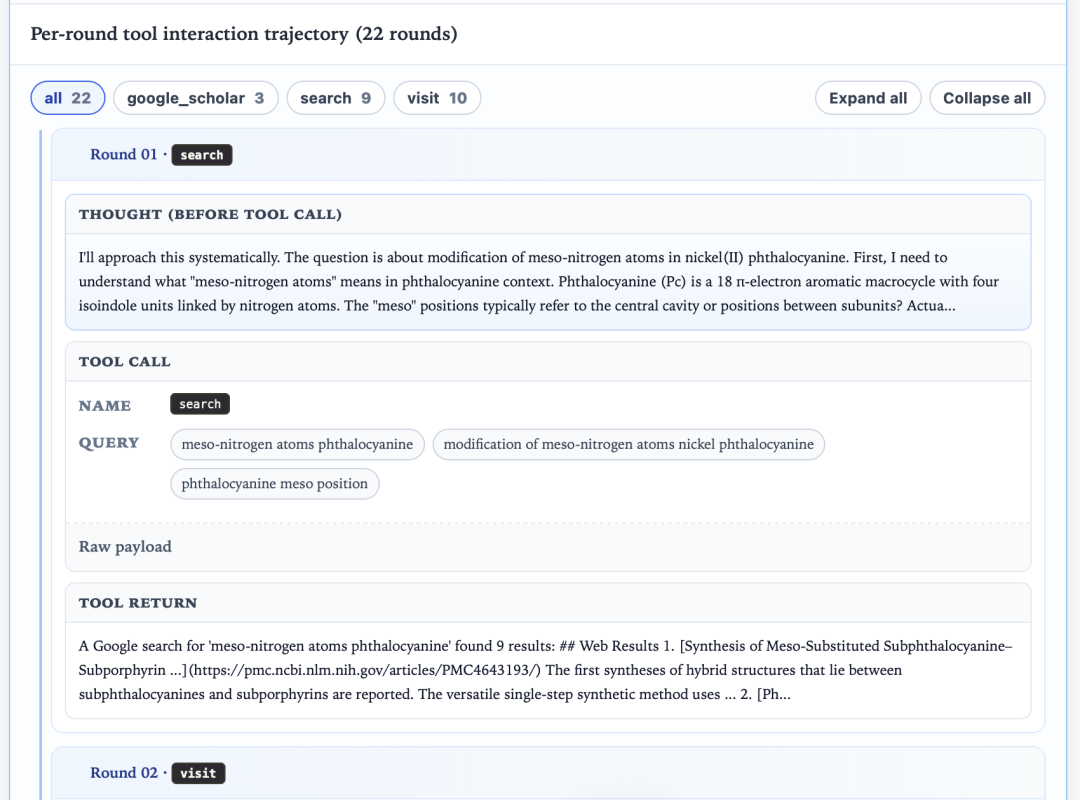

下图展示了 UniScientist 进行完整科研推理链条中的一个环节。

UniPat AI 此前发布的多模态评测基准 BabyVision 已被部分近期模型纳入评测体系。此次发布的 UniScientist,则将焦点转向了解决端到端的科研任务,提出了将全链条科研能力内化到模型中的方案,为迈向通用人工智能辅助科研探索了一条切实可行的路径。对于关注前沿AI研究与数据科学应用的开发者,此类深度技术解析在专业的技术社区中往往能引发更多有价值的讨论。