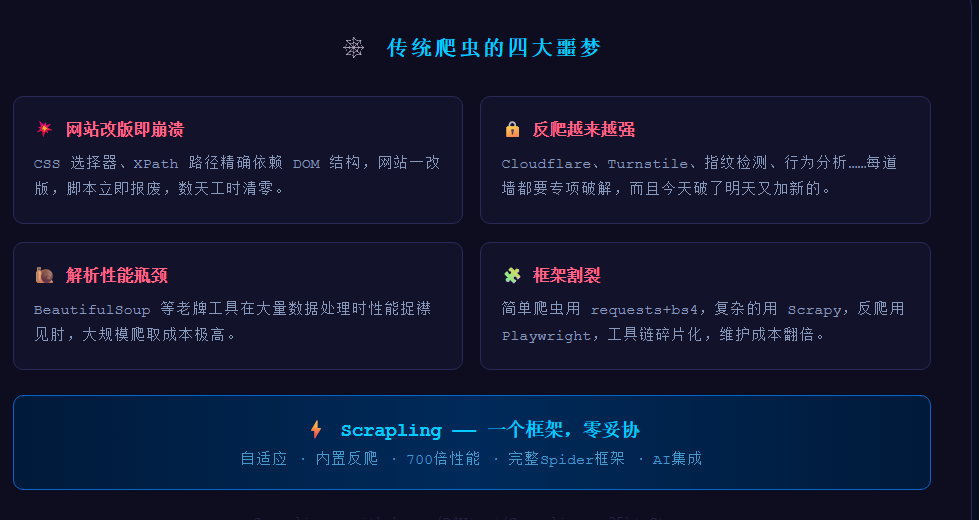

你一定经历过这种场景:花了两天时间写好的爬虫脚本,稳定运行了三个月。某天早上醒来,产品跑来说:「数据全部 None 了!」

你打开代码,发现目标网站悄悄改版了。原来的 CSS 选择器 .product-price 变成了 .item-cost,整整 500 行代码,需要重新排查。

这不是个例,这是每一个爬虫工程师的日常噩梦。 更别提现在反爬越来越强——Cloudflare、人机验证、指纹检测、IP 封禁……每道墙都要花时间突破,而且今天突破了,明天可能又加了新的。

直到 Scrapling 出现。

Scrapling 是什么?

一句话: 一个自适应、高性能、内置强力反爬的 Python 全功能爬虫框架。

- GitHub:

github.com/D4Vinci/Scrapling

- Star 数: 25,000+(周涨 7173 Star,曾登 GitHub Trending 周榜榜首)

- 测试覆盖率: 92%

- Python 版本: 3.10+

- 开源协议: MIT

项目作者的定位很直白:不是在修补传统爬虫的缺陷,而是重新定义爬虫应该是什么样子。

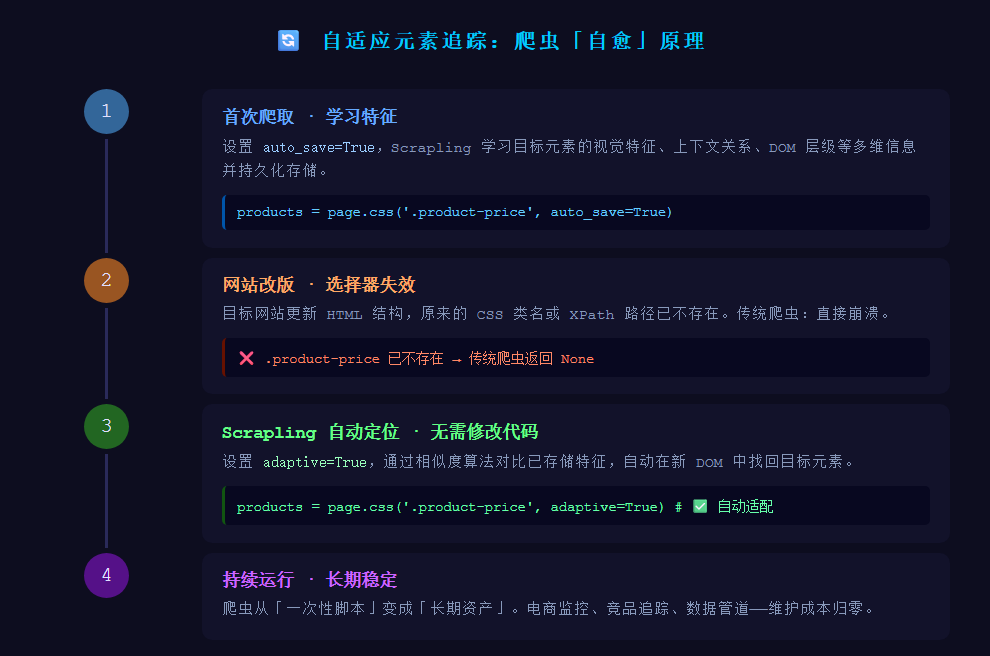

核心能力一:会「自愈」的自适应元素追踪

这是 Scrapling 最具颠覆性的功能,也是它爆火的根本原因。

传统爬虫依赖精确的 CSS 路径或 XPath,只要网站改一行 HTML,整个爬虫就崩。Scrapling 的做法完全不同:它不记路径,它记「特征」。

第一次爬取时,设置 auto_save=True,Scrapling 会学习目标元素的视觉特征、上下文关系、DOM 层级等多维信息存储下来。当网站改版后,只需 adaptive=True,系统通过相似度算法自动重新定位目标元素——完全不需要修改代码。

from scrapling.fetchers import StealthyFetcher

# 第一次爬取:保存元素特征

page = StealthyFetcher.fetch('https://example.com', headless=True)

products = page.css('.product-price', auto_save=True)

# 网站改版后:自动适配,无需改代码

products = page.css('.product-price', adaptive=True) # ✅ 自动适配

适用场景:

- 电商价格长期监控(网站随时会改版)

- 竞品数据持续追踪

- 新闻聚合(多个源,格式不统一)

这个功能的意义在于:爬虫从「一次性脚本」变成了「长期资产」。 如果你想深入学习更多 Python 自动化与网络采集的技巧,可以关注云栈社区的相关讨论。

核心能力二:开箱即破 Cloudflare 的四种 Fetcher

Scrapling 提供四种 Fetcher,覆盖从简单到极端复杂的所有反爬场景:

四种 Fetcher 选型指南:

Fetcher ── 快速 HTTP 请求

支持 TLS 指纹伪装,可模拟 Chrome/Firefox

适合:无反爬或简单反爬的目标站

AsyncFetcher ── 异步版本

性能更强,适合高并发批量爬取

适合:大规模数据采集任务

StealthyFetcher ── 核心反爬利器 ⭐

自动绕过 Cloudflare 全类型验证

包括 Turnstile / 人机验证 / 指纹检测

适合:有强反爬保护的目标站

DynamicFetcher ── 基于 Playwright

支持动态页面渲染 + 完整浏览器自动化

适合:重度 JS 渲染页面、需要交互操作

绕过 Cloudflare 只需两行核心代码:

from scrapling.fetchers import StealthySession

with StealthySession(headless=True, solve_cloudflare=True) as session:

page = session.fetch('https://目标网站.com')

data = page.css('#content a').getall()

同时内置 ProxyRotator,支持循环代理轮换,每个请求可单独覆盖代理配置,进一步降低封禁风险。

核心能力三:性能炸裂——比 BeautifulSoup 快 700 倍

这个数字乍看有点夸张,但这是在 5000 个嵌套元素 的真实测试场景下跑出来的:

文本提取速度对比(5000个嵌套元素):

BeautifulSoup ████████████████████████ 基准

lxml ████████████░░░░░░░░░░░░ 约快 2x

Scrapling ░░░░░░░░░░░░░░░░░░░░░░░░ 快 700x+

JSON 序列化:

Python 标准库 ████████████████████████ 基准

Scrapling ░░░░░░░░░░░░░░░░░░░░░░░░ 快 10x

背后是两个关键设计:优化数据结构 + 懒加载。只有真正访问某个属性时才会解析,内存占用极低,支撑大规模爬取毫无压力。

核心能力四:完整 Spider 框架,Scrapy 功能 + 更低学习成本

Scrapling 内置完整的 Spider 框架,和 Scrapy 功能对标,但上手难度骤降:

from scrapling.spiders import Spider, Response

class QuotesSpider(Spider):

name = "quotes"

start_urls = ["https://quotes.toscrape.com/"]

concurrent_requests = 10 # 并发控制

async def parse(self, response: Response):

for quote in response.css('.quote'):

yield {

"text": quote.css('.text::text').get(),

"author": quote.css('.author::text').get(),

}

# 自动翻页

next_page = response.css('.next a')

if next_page:

yield response.follow(next_page[0].attrib['href'])

# 一行运行 + 一行导出

result = QuotesSpider().start()

result.items.to_json("quotes.json")

完整 Spider 支持的高级特性:

- 并发爬取 — 可配置并发上限、按域名限速、下载延迟

- 多会话 — 同一爬虫中混用 HTTP、隐身浏览器等多种会话

- 断点续爬 — Ctrl+C 优雅暂停,重启从断点继续,不丢数据

- 流式输出 —

async for item in spider.stream() 实时获取结果

- 内置导出 — JSON/JSONL 格式开箱即用,支持自定义管道

核心能力五:内置 MCP Server,原生 AI 集成

这是 Scrapling 在 AI 时代的杀手锏。Scrapling 内置 MCP Server,可以直接接入 Claude、Cursor 等 AI 工具。更重要的是,它能在将数据传给 AI 之前先完成目标内容提取——大幅减少 Token 消耗,降低成本。

# 安装 AI 集成功能

pip install "scrapling[ai]"

与 OpenClaw 组合使用时,可打造完整的本地 AI 数据管道:

爬取(Scrapling)→ 提取(智能解析)→ 分析(AI)→ 输出(结构化数据)

全程自动化,零人工干预

命令行工具:0 代码完成数据提取

Scrapling 还提供命令行工具,不需要写一行代码就能提取网页内容:

# 提取页面内容到 Markdown 文件

scrapling extract get 'https://example.com' content.md --css-selector '#target'

# 绕过 Cloudflare 并提取内容

scrapling extract stealthy-fetch 'https://protected-site.com' result.html --solve-cloudflare

# 启动交互式爬虫 Shell(支持 curl 请求转换、浏览器预览)

scrapling shell

安装上手:3 步搞定

# 基础安装

pip install scrapling

# 按需安装(推荐完整版)

pip install "scrapling[all]"

# 安装浏览器及系统依赖

scrapling install

Python 版本要求: 3.10+

Scrapling vs 传统方案全面对比

| 维度 |

BeautifulSoup |

Scrapy |

Scrapling |

| 网站改版适配 |

手动重写 |

手动重写 |

自动自愈 ✅ |

| 反爬绕过 |

无 |

需插件 |

内置全套 ✅ |

| Cloudflare 破解 |

无 |

无 |

开箱即用 ✅ |

| 解析速度 |

基准 |

快2-3x |

快700x ✅ |

| 完整 Spider 框架 |

无 |

有 |

有+更简单 ✅ |

| MCP/AI 集成 |

无 |

无 |

内置 ✅ |

| 断点续爬 |

无 |

有 |

有 ✅ |

| 学习曲线 |

低 |

高 |

低 ✅ |

适用场景

- 电商价格监控 — 自适应追踪,网站改版无感切换

- 竞品数据采集 — 并发爬取,多站点大规模数据

- AI 训练数据 — 快速获取海量高质量网页数据

- SEO 监控 — 定期追踪搜索排名与竞品策略

- 个人知识库 — 自动采集整理感兴趣内容

- 安全研究 — 隐身模式、代理轮换,隐匿性强

总结

爬虫领域长期存在一个隐形天花板:你写的每一个爬虫,都有一个隐性过期日期。 网站改版、反爬升级、IP 封禁……这些不是「如果会发生」,而是「什么时候发生」的问题。传统爬虫框架的范式,让开发者始终在被动应对。

Scrapling 的出现,让爬虫从 「一次性消耗品」变成了「可持续资产」。 它的自适应能力让它具备了“自愈”的可能,内置的强大反爬模块则是坚实的护盾,而极致的性能与前沿的 AI 集成能力,让它成为了当前 开源实战 领域一个值得关注的项目。

项目地址: https://github.com/D4Vinci/Scrapling