今年4月,Max Tegmark 团队发布了一种崭新的深度学习网络结构 Kolmogorov-Arnold Network(简称KAN)后迅速引起轰动。随后8月,团队再次发布拓展工作 KAN 2.0,这不仅仅是一个优化升级的网络架构,更被看作是一种 AI+Science 研究的新范式。这一范式旨在使AI驱动的科学研究更具交互性和可解释性,甚至有望支持“好奇心驱动的科学”发展。知名科普杂志 Quanta Magazine 近日撰文回顾并梳理了KAN系列工作的研究历程,以下是该文章的核心内容翻译与解析。

从“黑箱”到透明:KAN的诞生契机

“神经网络是目前人工智能中最强大的工具。当它们应用于更大的数据集时,没有什么可与之抗衡。”前沿理论物理研究所的研究员 Sebastian Wetzel 如此评价。

然而,神经网络的“阿喀琉斯之踵”也广为人知:其基础构建块——多层感知器(Multilayer Perceptron, MLP),作为许多成功网络的基石,其内部决策过程对人类而言却是一个“黑箱”。我们难以理解基于MLP的网络是如何得出特定结果的,也缺乏解释这些结果的潜在原理。AI研究人员长期在思考,是否存在另一种网络设计,能在保持性能的同时提供更高的透明度?

2024年4月,一项研究给出了肯定的答案。该研究提出了一种名为 Kolmogorov-Arnold 网络(KAN) 的替代设计。它基于20世纪中叶的一个数学概念,经过重新发现和配置,以适用于深度学习时代。KAN不仅在透明度上更胜一筹,而且在某些问题类别中,其能力几乎可以与常规神经网络媲美。

论文题目:KAN: Kolmogorov-Arnold Networks

论文地址:https://arxiv.org/abs/2404.19756

核心差异:用“函数”替代“权重”

一个典型的神经网络通过多层人工神经元(节点)和连接它们的边(突触)工作。信息逐层处理,边的权重在训练中被不断调整以逼近正确答案。网络的常见目标是找到能最佳拟合数据点的数学函数。

KAN在函数拟合方式上与MLP有根本区别。KAN不依赖具有固定数值权重的边,而是使用可学习的、非线性的“边缘函数”。 这些函数可以表示更复杂的曲线,并能进行比MLP的简单数值权重更灵敏的调整,这使得KAN在理论上能够完美地表示某些目标函数。

这一设计的数学基础源于1957年数学家 Andrey Kolmogorov 和 Vladimir Arnold 分别证明的定理:一个多变量数学函数可以被转换为多个单变量函数的组合。然而,过去35年里,受限于该定理生成的函数可能“不平滑”以及当时的计算能力,KAN一直被认为不切实际。

Andrey Kolmogorov(左)和 Vladimir Arnold 在1957年证明了可以将一个复杂的数学函数重写为简单函数的组合。

转机出现在2024年初。麻省理工学院的物理学研究生刘子鸣决定重新审视这个被“冷落”的定理。在与导师 Max Tegmark 研究如何让神经网络更可解释却进展不顺时,他抱着“试试看”的心态转向了 Kolmogorov-Arnold 定理。

尽管Tegmark起初基于前人的研究认为这会走进死胡同,但刘子鸣的初步尝试很快改变了他们的想法。他们意识到,即使原始定理生成的函数不平滑,网络也可以用平滑函数去逼近它们。更重要的是,科学中的大多数函数本质上是平滑的,这使得完美表示成为可能。借助现代远超1989年的软硬件计算能力,KAN的潜力被重新点燃。

刘子鸣利用Kolmogorov-Arnold定理构建了一种新的神经网络。

关键突破:从“两层”到“深层”堆叠

刘子鸣最初的原型聚焦于两层KAN,这是该定理最直接的蓝图。然而,这些原型在科学相关任务上表现不佳。此时,Tegmark提出了一个跳出框架的建议:为什么不尝试构建两层以上的KAN?

这个想法成为了关键突破。团队发现,三层KAN是可行的,并且能精确表示两层KAN无法处理的函数。他们并未止步,后续实验甚至堆叠了多达六层,网络处理复杂函数的能力随之增强。“我们发现可以基本上随意堆叠层数。”论文合著者之一 Yixuan Wang 说道。

实验验证:从数学纽结到物理相变

为了证明KAN的实用价值,研究团队将其应用于两个现实世界的复杂问题。

-

数学中的纽结理论:2021年,DeepMind的团队用MLP预测了纽结的某个拓扑属性。KAN成功复现了这一壮举,并更进一步——它能够展示该属性如何与所有其他属性相关联。刘子鸣指出,这种关系的揭示是“MLP完全无法做到的”。

-

凝聚态物理中的安德森局域化:该实验的目标是预测特定相变的边界,并推导出描述该过程的数学公式。没有任何MLP能够完成这项任务,而KAN做到了。

刘子鸣的导师 Max Tegmark 提出了使Kolmogorov-Arnold网络成功运行的关键建议。

这两个案例凸显了KAN相比于传统网络的最大优势:可解释性。“什么叫可解释性?”Tegmark解释道,“如果你给我一些数据,我会给你一个可以写在T恤上的公式。”KAN不仅给出答案,还提供人类可以理解的、简洁的数学解释。

当然,KAN的能力也有其边界。它可能最适合物理学等变量较少的科学问题。“几乎所有著名的科学公式——比如 E=mc²——都可以用一两个变量的函数来表示。”Tegmark说,“KAN 利用了这一事实,并寻找这种形式的解决方案。”

KAN 2.0:从工具到“好奇心驱动”的范式

初代KAN论文在短时间内获得了大量关注和引用,也激发了社区的研究热情。其他团队迅速跟进,例如清华大学团队提出的 Kolmogorov-Arnold Informed Neural Network(KINN),在求解偏微分方程(PDEs)方面表现显著优于MLP。

论文题目:Kolmogorov Arnold Informed neural network: A physics-informed deep learning framework for solving forward and inverse problems based on Kolmogorov Arnold Networks

论文地址:https://arxiv.org/abs/2406.11045

同时,也有研究对KAN和MLP进行了更全面的比较。新加坡国立大学的一篇论文指出,KAN在与可解释性相关的任务中表现优于MLP,但MLP在计算机视觉和音频处理上更胜一筹,两者在自然语言处理等其他任务上则旗鼓相当。这与KAN团队专注于“科学相关任务”的初衷是吻合的。

论文题目:KAN or MLP: A Fairer Comparison

论文地址:https://arxiv.org/abs/2407.16674

与此同时,刘子鸣和合作者正致力于让KAN变得更实用。2024年8月发布的“KAN 2.0”被他们描述为“更像是一本用户手册”。这一版本提升了易用性,并增加了诸如乘法工具等原版缺乏的功能。

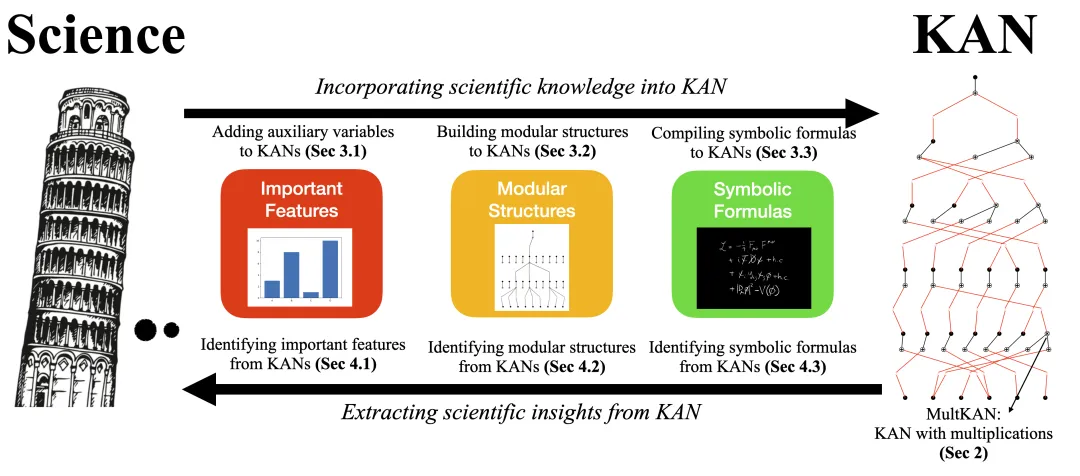

KAN 2.0的核心思想:在科学知识与神经网络之间建立双向通道。

论文题目:KAN 2.0: Kolmogorov-Arnold Networks Meet Science

论文地址:https://arxiv.org/abs/2408.10205

KAN 2.0的发布,标志着理念的进一步升华。团队认为,KAN不仅仅是一个解决问题的工具,它更促进了一种“好奇心驱动的科学”,与当前主流的“应用驱动科学”形成互补。例如,在研究天体运动时,应用驱动的方法聚焦于预测未来轨迹,而好奇心驱动的方法则旨在揭示背后的物理定律。刘子鸣希望,KAN能帮助研究人员从深度学习模型中获得更多——不仅仅是计算结果,更是对世界本质的理解。

结语

KAN的兴起,为可解释人工智能(XAI)和AI for Science领域注入了新的活力。它通过将古老的数学定理与现代深度学习框架相结合,成功打开了神经网络“黑箱”的一角。尽管它在通用任务上未必全面超越传统MLP,但其在科学发现场景中展现出的透明度和公式提取能力,无疑为研究人员提供了一把强有力的新钥匙。从KAN 1.0到2.0的演进,反映了从“构建一个新网络”到“定义一种新研究范式”的深刻转变,这或许将引领AI+Science走向一个更加交互式、可解释、并由人类好奇心驱动的新阶段。

对于希望深入探讨AI与科学交叉前沿的开发者与研究者,可以关注相关领域的最新进展与社区讨论。

本文翻译自 Quanta Magazine,原文链接:https://www.quantamagazine.org/novel-architecture-makes-neural-networks-more-understandable-20240911/