前段时间和一位在大厂做技术面试官的朋友聊天,说起最近的面试情况,他讲了一句话让我印象很深:

“现在十个候选人里,有八个简历上都写了 RAG 项目。但大多数一看就是简单包装的——就写一句‘负责 RAG 知识问答系统的开发与维护’,然后就没下文了。我问检索用的什么方案,他说向量检索;我问用的什么 Embedding 模型,他说 BGE;我问效果怎么评估的,他说……还不错。”

他笑了笑,补充道:“这种简历我基本 30 秒就翻过去了。不是说他一定没做过,而是他写的东西完全看不出深度。”

我接着问他:“那什么样的 RAG 项目经历,会让你愿意多看两眼?”

他的回答很直接:“我想看到你做了哪些具体的技术决策。比如,你用了混合检索——那为什么不只用向量检索?你做了 Embedding 微调——训练数据是怎么来的、用了什么损失函数?你加了 Rerank——是对前多少条结果做精排、最终效果提升了多少?能看到这些细节,我才觉得这个人真的踩过坑、解决过问题,面试才值得深入聊下去。”

这恰恰是很多同学在人工智能项目经历描述上最大的短板:只说了“做什么”,没说“怎么做”和“结果如何”。今天,我们就来具体聊聊,怎么把 RAG 项目的技术细节落到简历上,让面试官一眼就觉得“这个人值得聊”。

一、先看看最常见的错误写法

很多人在简历上会这样描述自己的 RAG 项目:

★ 负责公司 RAG 知识问答系统的开发与维护。

这句话的“信息量”几乎为零。面试官看到这一行,内心会立刻产生疑问:“所以你到底做了什么?文档解析?在线检索?答案生成?是全程参与还是打打下手?”

简历的核心原则,是让面试官快速理解你做了什么、用了什么技术、最终达到了什么效果。RAG 系统包含众多模块,你不可能面面俱到。关键在于,挑选你最深入参与的 2-3 个模块,为每一条职责写清楚、写透彻。

下面,我将按模块分解,给出具体的写法示例,并附上面试官可能追问的方向,帮你提前做好准备。

二、离线文档解析模块怎么写?

简历写法(一条 bullet point)

★ 文档解析流水线:设计并实现多格式文档(PDF/Word/HTML)解析流水线,结合 OCR 与版面分析技术识别表格、图片及多栏布局,采用规则与语义相结合的三层分块策略,为 RAG 系统提供高保真文本语料。

这一条的信息密度已经很高了:

- “多格式文档”说明你处理过复杂的现实场景。

- “OCR + 版面分析”表明你不仅会使用

PyPDF2 提取文本,还处理过扫描件和复杂排版。

- “保留层级布局”说明你理解文档结构对后续检索的重要性。

- “规则+语义分块”说明你的分块策略并非简单的固定长度切割,而是经过了思考。

面试官会怎么追问?

“你处理过哪些文档格式?遇到最难处理的情况是什么?”

答:主要处理过 PDF(包括多栏排版和扫描版)、PPT、Word 和纯文本。最具挑战性的是多栏排版的 PDF 文件,传统的按行解析方式会把左右两栏的内容错误地拼接在一起,导致语义完全混乱。我们引入了基于深度学习的版面分析技术,先识别物理区块和逻辑阅读顺序,再进行内容提取。

“你说的‘三层分块策略’具体是怎么做的?”

答:第一层是基于文档固有结构(如章节标题、段落边界)进行规则切分,确保表格、代码块等特殊内容被完整保留,不被截断。第二层会检查相邻文本块的语义连贯性,将过短的块进行合并,对跨页但语义连续的块进行拼接。第三层是整体的长度平衡,配合设置 chunk overlap 来保持上下文的连续性。

“你们最终确定的 chunk 大小和 overlap 是多少?依据是什么?”

答:这不是拍脑袋决定的,需要配合我们选用的 LLM 的上下文窗口长度来权衡。块太大,LLM 一次能放入的参考片段就少;块太小,则语义可能不完整。我们通过一系列实验,最终将块大小定在 300-500 个 token 之间,并设置了 50 个 token 的重叠区域,这个配置在召回率和语义完整性上取得了较好的平衡。

三、在线检索与召回模块怎么写?

简历写法(可以拆分成 2-3 条)

★ 混合检索方案:针对金融保险领域约 2 万条文本片段,同时构建 BM25 关键词索引与向量索引进行并行检索,采用 RRF 融合策略,使系统整体召回率提升约 10%,短查询和专有名词查询的命中率显著提高。

★ Embedding 模型微调:基于约 1000 条领域问答对,对 BGE-large-zh 预训练模型进行有监督微调(采用 MultipleNegativesRankingLoss),使领域专业术语相关查询的 Top-10 召回率提升约 13%。

★ 重排序优化:对初步检索返回的前 100 条候选结果,引入 Cross-Encoder 模型进行精排,关键信息点的 Top-3 命中率较未重排前提升约 15%。

请注意,每一条都包含了具体的数字——2 万条、1000 条、提升 10%/13%/15%。面试官非常看重这些量化指标。数字不需要精确到小数点后几位,但必须要有,它们是你工作成效最直接的证明。

面试官会怎么追问?

“BM25 和向量检索的结果,你们具体是怎么融合的?”

答:我们采用了 RRF(倒数排序融合)算法。它的优点是不直接使用原始的 BM25 分和向量相似度分,而是基于各自排序的位次进行加权融合,公式是 score = 1/(k + rank),这里的 k 我们设置为 60。相比为两种分数分配固定权重的加权求和法,RRF 避免了不同检索算法分数量纲不统一的问题,调参成本也更低。

“用于 Embedding 微调的 1000 条问答对数据是怎么构建的?”

答:主要有两个来源。一是从历史客服日志和产品文档中,人工筛选出高质量的问题及其对应的标准答案段落。二是请业务专家针对知识库中的核心文档段落,模拟用户可能的不同提问方式,撰写 3-5 个相关问题。这样总共积累了约 1000 条数据,基本覆盖了核心业务术语和多样化的 query 表述。

“为什么选择 MultipleNegativesRankingLoss 而不是更常见的 Triplet Loss?”

答:主要因为我们的训练数据是“问题-正例段落”对,没有现成的、手工构造的困难负例。MultipleNegativesRankingLoss 会在一个 batch 内,自动将其他样本的问题作为当前样本的负例,极大减少了构造负例的工作量。我们在训练时将 batch_size 设为 16,通常训练 2-3 个 epoch 效果就趋于稳定,关键是要通过验证集监控,防止过拟合。

“Rerank 阶段为什么只对前 100 条结果做精排?用的什么模型?”

答:我们使用的是 BGE-reranker-base 模型。因为 Cross-Encoder 需要将 query 和每一个候选文档进行拼接后输入模型做完整推理,计算开销远大于双塔式的向量检索。对前 100 条进行精排,是在效果和延迟之间找到的一个平衡点。再多的话,响应延迟就会超过可接受范围。此外,我们在工程上还做了优化,比如采用分页策略,只对最靠前的 1-2 页结果进行重排,后面的则直接采用初始排序结果。

四、量化数据从哪来?——一个现实问题

看到这里,很多同学可能会想:“我的项目没有做过严格的线上 A/B 测试,这些 10%、15% 的提升数据从哪来呢?”

这是个非常现实的问题。事实上,大多数内部或学校的项目确实没有条件进行完备的对照实验。但简历上的数字不等于学术论文的数据,它更需要的是一个合理的、可信的量级估算。

你可以通过以下几种方式来获得这个估算:

方法一:设计小规模人工评测。

准备 50 条有代表性的测试 query,分别用优化前和优化后的系统(或模块)跑一遍。人工判断每条 query 的 Top-3 或 Top-5 结果,哪个版本更准确、更相关。统计一下“变好”的 query 数量,除以总数,就能得到一个近似的提升比例。这个过程不需要复杂的自动化框架,一个下午就能完成。

方法二:基于离线评估指标推算。

如果你在项目迭代过程中,按照技术文档中的方法计算过 MRR、NDCG、Precision@K 等指标,那么直接使用这些指标的前后变化即可。例如,MRR 从 0.58 提升到 0.82,相对提升约 41%,这就是一个非常扎实、可以写在简历上的数字。

方法三:关联业务效果指标。

如果项目已经上线,可以关注业务侧的反馈。例如,上线后客服需要人工介入回答的比例下降了百分之多少?用户满意度调查的评分上升了多少?这些业务指标有时比纯技术指标更具说服力。

核心原则是:数字要有,但要合理,切忌浮夸。 写“召回率提升约 10%”远比写“性能提升 200%”要可信得多。面试官经验丰富,一眼就能看出数字是否合理,并很可能就此追问细节。如果届时无法自圆其说,反而会弄巧成拙。

五、撰写 RAG 简历的几个实用技巧

1. 确保关键词覆盖。

现在很多公司的初筛会通过系统扫描关键词。确保你的简历中自然出现以下高频词:RAG、向量检索、Embedding、BM25、Rerank、Cross-Encoder、Milvus/FAISS、OCR、语义分块、混合检索。注意是自然地融入描述,而非生硬堆砌。

2. 深挖两三点,切忌贪多求全。

宁愿把“混合检索”和“Rerank 重排”两个模块写得很深、很细(包含技术选型原因和量化结果),也不要把“文档解析、召回、Prompt 工程、多轮对话”全都列上,但每项都只有一句笼统的话。简历不是功能清单,它的作用是展示你的技术深度和思考过程。

3. 学会“埋钩子”,引导面试方向。

好的简历描述会让面试官产生追问的欲望。例如,你写了“采用规则与语义相结合的分块策略”,面试官大概率会问“具体怎么结合的?”;你写了“MRR 提升 41%”,他一定会问“这个指标是怎么评估的?”。提前准备好这些“钩子”问题的答案,面试就能引导至你熟悉的领域,变被动为主动。

六、一份完整的 RAG 项目简历示例

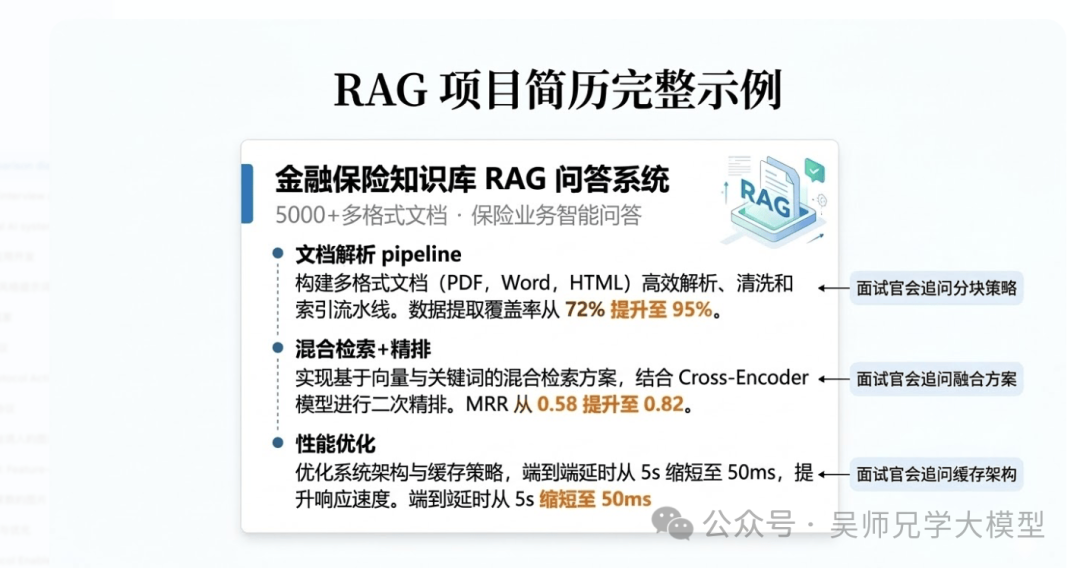

最后,我们将前面讲的所有要点融合起来,看一个完整的项目描述示例:

项目名称:金融保险知识库智能问答系统 (RAG)

项目背景:面向保险业务场景的智能问答系统,知识库包含 5000+ 份多格式业务文档(PDF/Word/扫描件),服务于内部员工的制度查询、产品咨询与理赔流程指引。

我的职责:

- 文档解析流水线:设计多格式文档解析流程,集成版面分析与 OCR 技术处理多栏 PDF 及扫描件;采用规则与语义结合的三层分块策略,并保留章节层级等元数据,使非结构化文本的解析与结构化覆盖率从 72% 提升至 95%。

- 混合检索与精排优化:构建 BM25 与向量索引并行检索架构,使用 RRF 进行结果融合;针对业务领域对 BGE 模型进行有监督微调(使用 1000 条问答对与 MultipleNegativesRankingLoss);引入 Cross-Encoder 对 Top 100 候选结果进行重排序,使平均检索相关度(MRR)从 0.58 提升至 0.82, Precision@3 从 0.47 提升至 0.71。

- 系统性能优化:设计并实现三级缓存架构(Embedding 缓存、检索结果缓存、生成答案缓存),配合全链路异步化与 HNSW 索引参数调优,将高频查询的端到端首字响应时间从 5 秒优化至 50 毫秒以内。

这份描述包含了三条职责,分别覆盖了离线处理、在线检索与排序、系统性能三个核心模块。每一条都明确指出了“做了什么”、“用了什么技术”以及“取得了什么可量化的效果”。面试官看到其中任何一条,都可以基于其中的技术点展开深入追问 10-15 分钟,而你,早已准备好了答案。

写在最后

掌握再多的理论知识,最终都需要通过简历和面试来呈现。这篇文章的核心观点可以归结为一句话:简历不是技术文档的摘要,而是你为面试绘制的“导航地图”。

你写下的每一个技术点、每一个数据,都是在向面试官发出邀请:“关于这个问题,我有很多可以聊的。” 因此,策略不在于罗列所有你接触过的技术,而在于精心选择你最有心得、最能体现深度的 2-3 个方向,把它们写透、写活,让面试官忍不住沿着你设定的路径追问下去。

希望这份针对 RAG 项目经历的简历优化指南对你有帮助。如果你在准备技术面试或优化项目经历时有其他困惑,欢迎到我们云栈社区的相关板块交流讨论,那里有更多开发者分享的一线实战经验。