在3月24日于旧金山举办的Arm Everywhere大会上,ARM公司揭晓了一项重大战略转向。公司不仅详解了其技术交付策略的升级路径,更重磅发布了首款以成品芯片形态直接销售的处理器产品——Arm AGI CPU。这一举措旨在应对数据中心需求的快速演变,特别是为了适应AI工作负载日益呈现的智能体化(Agentic AI)趋势。

Arm 技术交付模式的持续演进

ARM公司拥有庞大的IP部署规模,迄今为止,基于Arm架构的芯片出货量已超过3500亿颗。伴随着其架构一同成长的,还有一个庞大的开发者生态,覆盖了从边缘终端、云基础设施到各类人工智能平台的全场景布局。

自上世纪90年代初,ARM便确立了低功耗设计的核心定位。“为电池应用而生”的基因,使其从早期的移动设备一路普及至现代智能手机。如今,随着AI算力需求的激增,数据中心的功耗限制日益凸显,ARM一贯坚持的能效优先理念,在当下的数据中心领域同样展现出了关键价值。

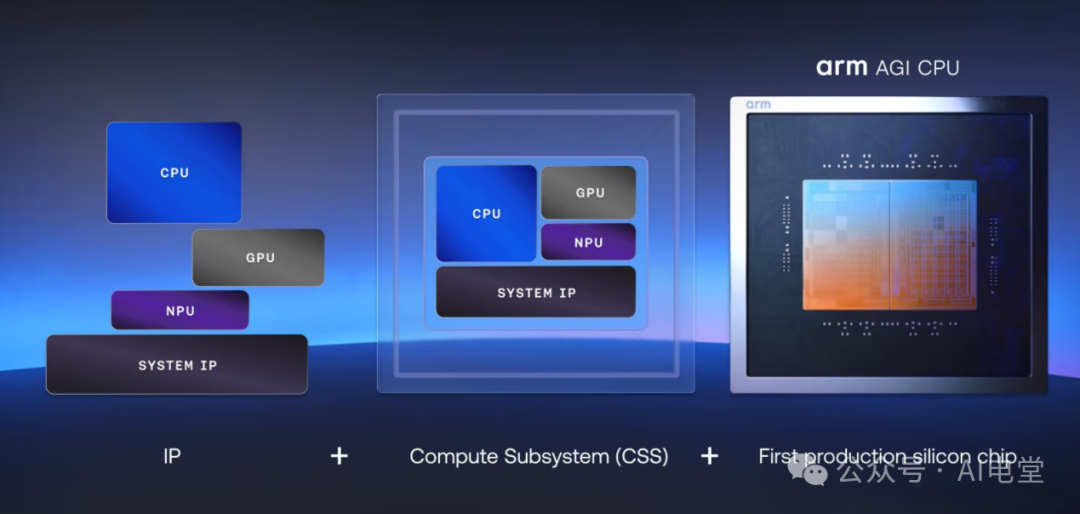

面对先进工艺节点下芯片复杂度攀升、研发周期拉长的行业现状,ARM的技术交付模式也在持续演进。传统的模式是提供CPU、GPU、系统IP等独立IP核。而在三四年前,公司推出了计算子系统(Compute Subsystems,CSS),旨在帮助客户更快速地集成经过预验证的IP模块。据称,CSS方案可将芯片的量产周期缩短最多一年,部分场景下甚至可达18个月。这种交付方式的转变也体现在了公司的营收结构上:CSS已经贡献了近20%的版税收入,并且占比仍在持续提升。

ARM的高管指出,在AI基础设施中,加速器主要负责生成Token,而CPU仍然承担着核心的任务编排与工作流执行角色。当前行业正从传统的AI推理,转向能够持续运行多步复杂工作流的智能体(Agent)模式。这一转变预计将使人均Token消耗提升约15倍甚至更高。

据ARM估算,传统的AI数据中心配置每吉瓦(GW)功率大约需要3000万个CPU内核;而智能体工作负载可能将这一数字提升至约1.2亿个CPU内核每吉瓦,增长高达四倍,同时这一切仍需在严格的功耗限制范围内实现。

Arm 发布首款 AGI CPU 新品

ARM首席执行官Rene Haas在大会上宣布,公司正通过直接提供CPU芯片迈入一个全新的业务领域。他正式推出了 Arm AGI CPU,这是ARM首款面向客户直接销售以实现营收的硅芯片成品。此举主要源于合作伙伴的实际需求,同时也是为了给智能体AI数据中心提供一个高能效的CPU解决方案。

ARM执行副总裁Mohammed Awad介绍,Arm AGI CPU围绕性能、规模化、能效三大核心原则进行设计。该产品以Neoverse V3计算子系统(CSS)为基础打造,具体的芯片规格如下:

- 内核:包含136个基于Neoverse V3的核心,每个核心配备2MB专用L2缓存,支持最高3.7 GHz运行频率。

- I/O与互联:提供96路PCIe 6.0通道,并支持CXL 3.0。

- 内存:搭载DDR5内存,每个内核的持续内存带宽最高可达6 GB/s。采用双芯粒(Dual Chiplet)设计,目标是将内存延迟控制在100纳秒以下。

- 功耗与工艺:热设计功耗(TDP)为300瓦,芯片采用台积电(TSMC)的3纳米工艺制程制造。

Mohammed Awad还表示,ARM已经在开放计算项目(OCP)的标准机架中实现了高密度的核心部署方案,涵盖了风冷36千瓦和液冷200千瓦两种配置。他同时宣布,Arm AGI CPU现已上市,并已交付给客户进行评测,预计将在今年年底实现量产。

ARM在数据中心软件生态领域已深耕超过15年,目前已有超过12.5亿颗Arm Neoverse内核部署于数据中心场景。

在总结发言中,ARM CEO Rene Haas强调,公司将继续推进其IP与计算子系统(CSS)的产品路线图,并承诺迭代下一代芯片产品——即后续的Arm AGI CPU 2与Arm AGI CPU 3。根据ARM的市场规模测算,当前其AI数据中心业务对应的版税总潜在市场(TAM)约为30亿美元。而依托Arm AGI CPU战略,未来的市场机遇有望扩大至1000亿美元的TAM。ARM有信心在本世纪20年代末,覆盖超过1万亿美元的总潜在市场,其业务将贯穿从边缘终端到云端部署的全域场景。

此次ARM的战略发布,标志着其在计算机基础架构领域的一次重要进击,也为正处于变革中的AI数据中心市场提供了新的硬件选项与思考方向。更多深度技术解读与行业资讯,欢迎关注云栈社区。 |