我尝试了那个可以直接在屏幕上画圈、让Claude来修改UI的工具。

最大的感受是,再也不用纠结“向左偏移3个像素”这种描述到底够不够精确了。事情是这样的,前几天我在做一个响应式登录页面,用Claude Code生成初版界面后,总觉得按钮和表单之间的间距不对劲。从屏幕上直观地看,按钮明明应该再往左靠一点,但我用文字描述“把登录按钮向左偏移10px,同时保持垂直居中”发给AI后,它改完的位置依然偏右;再描述一次,它又把其他元素给带歪了。来回折腾了快半小时,我盯着代码和预览窗口,感觉自己像是在跟一个看不见屏幕的助手玩猜谜游戏。那个瞬间我突然意识到,用纯文字描述空间关系的效率,真的低到离谱。

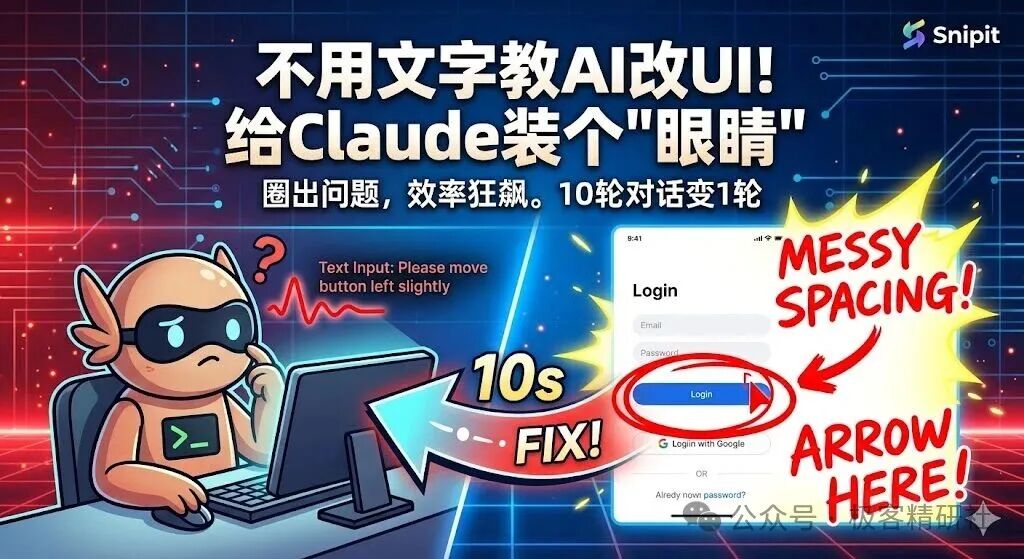

就在我快要放弃的时候,在某个技术社区刷到一条帖子。里面提到有人受够了这种来回拉锯,干脆做了一个工具,让你能直接在屏幕上画圈、画箭头、写文字备注。Claude渲染的界面有问题?你就圈出问题区域,加个箭头指向具体位置,再敲几行说明,AI就能“看到”你的标注,修复速度比纯文字沟通快好几倍。帖子还特别强调,这工具免费且开源。我点开附带的演示视频,看完立刻动手去试。上手之后我才明白,这不只是个小技巧,而是把我们与AI沟通的方式,从“讲故事”变成了“指着屏幕说这里”。

我理解,这个工具真正抓住的痛点是当前AI编码助手普遍缺乏的“视觉通道”。我们人类一眼就能看出元素没对齐、颜色不协调,但文字只能勉强翻译成坐标和样式描述,中间损耗的信息太多了。这个工具把损耗补了回来。我在一个多卡片布局的项目里测试了一下,用它反馈一次,AI就直接对齐了所有间距,省下的时间够我多写两个功能模块。如果你也在用AI做前端开发,理论上任何需要精确空间调整的场景,这个思路都能帮上忙。

为什么用文字跟AI描述UI问题总是事倍功半?

我自己前后对比过好几次,每次用纯文字反馈UI,效率都卡在同一个地方。像Claude Code这类AI工具,本质是基于文本提示生成代码,它看不到你眼前的浏览器窗口,也无法直接感知像素级的位置关系。你说“按钮再左一点”,它可能理解为修改margin或padding,但具体是哪个按钮、左移多少像素、如何与其他元素对齐,这些细节全靠你用语言一层层拆解。拆解过程中,歧义很容易出现:AI以为是左侧间距,你指的是整体居中;你说“颜色再淡一点”,它改了背景色,你想要的却是文字颜色。结果就是一轮又一轮的“不是这个,再试试”。

很多人忽略了一个细节:UI问题本质上是二维空间问题,而文字是一维的线性描述。把二维信息压缩成一维,信息密度天然就低。以前我遇到对齐问题,最多写成“把 .card 类的 margin-left 设为 20px,同时确保 .flex 容器的 justify-content 为 center”,发过去后AI还是可能把其他卡片也跟着移位。后来我干脆截图自己标箭头再发,但AI仍然只能看到图片像素,无法提取你标注的具体含义。来回几次,开发节奏完全被打断了。

上手这个工具后,我发现它直接跳过了这个“翻译”环节。你在屏幕上画的圈和箭头,会被转换成结构化的坐标和描述,AI能精准知道“你指的就是这里”。这让我想起以前跟设计师同事沟通时,他们从来不会只发文字,总是一边指着屏幕一边说“这里再往上提5px”。现在AI也能以同样的方式接收反馈了。理论上,如果所有AI编码工具都支持这种视觉输入,开发效率的提升将非常可观,尤其是做复杂仪表盘、移动端适配这类视觉敏感的项目。

我还注意到一个被低估的副作用:纯文字反馈容易让人心累。你得反复斟酌措辞,生怕AI误解,结果注意力全花在“怎么说”而不是“想做什么”上。用了标注方式后,我发现自己的思路更专注在产品逻辑本身,而不是语言游戏。社区里也有开发者反馈,用这种方式后,原本需要10轮对话的UI迭代,现在3轮就能收尾。假设你在做一个需要频繁微调的商业后台,理论上每天省下的时间,足够你多完成一个完整模块。

一张带箭头的截图,胜过一段冗长的解释文字。

这个结论我现在深有体会。它不是夸张,而是把沟通成本从“描述+猜”降低到了“指+看”。

Snipit这个工具到底怎么把视觉反馈变成AI可读输入?

我按照帖子里的描述找到了这个工具,它叫 Snipit。本质上,它在你和AI之间搭建了一条视觉通道。核心流程很简单:你先用快捷键捕捉屏幕区域,然后直接在上面画圈、画箭头、敲文字备注,完成后复制到剪贴板,再粘贴进Claude的聊天框就行了。AI收到的是带标注的图像,同时还能解析出你标注的具体坐标和文字,所以它知道你指的到底是哪个元素、问题是什么。

上手后我发现,它不止支持单向反馈,还能双向互动。AI那边如果需要展示图表或临时预览,可以通过命令让Snipit打开一个审查模式,你在里面继续标注反馈,意见又能原路返回给AI。整个过程在本地处理,可选的本地视觉模型还能自动整理截图、提取文字、做语义搜索,这些功能都不强迫你开启,完全按需使用。我特别喜欢它对浏览器扩展的支持:在Chrome里直接捕捉网页元素,标注后以JSON坐标的形式发给AI,避免了把标注“烤”进图片导致AI看不清原始像素。

说实话,这个设计把以前零散的“截图+画图软件+手动复制描述”流程,浓缩成了一键操作。以前我用其他截图工具标完还得手动描述“箭头指向的按钮”,现在AI能直接读取坐标,知道精确位置。社区里有人提到,它还支持MCP协议,让一些不能跑命令行的AI工具也能用上同样的视觉输入。假设你在用Claude Desktop做项目,理论上也能通过这个通道实现同样高效的反馈。

我测试了几个小场景:一个是调整导航栏间距,我只画了一个圈加箭头,AI就精准修改了flex gap属性;另一个是修复移动端折叠菜单的重叠问题,我写了三行备注,AI不但改了样式,还顺便优化了动画过渡。整个过程我几乎没敲什么复杂的文字提示,注意力全放在“哪里不对”上,而不是“怎么说不对”。这个工具还自带扩展系统,你可以自己添加新的标注工具到文件夹里,完全沙盒运行,权限透明。

Snipit就是你和AI之间的视觉I/O通道。

它把我们最自然的沟通方式——指着屏幕说话——变成了AI能理解的结构化输入。这一点,在我看来,是当前AI编码体验里最缺的一环。

它和传统截图工具相比,真正提升了哪些开发体验?

很多人第一反应是“截图画圈不就是老操作吗?”,但我用下来后发现,Snipit的核心差异在于“AI可理解性”。传统截图工具画完后,你还是得额外打字解释“箭头指的这个div要左移”,AI只能猜。而Snipit把标注坐标和文字直接结构化传过去,AI拿到的是精确的“位置-问题-建议”三元组,几乎零歧义。

我对比了修复同一个UI Bug的耗时:纯文字描述用了7轮对话,耗时约18分钟;传统截图+文字描述用了4轮,约12分钟;而用Snipit只用了2轮,不到4分钟。差距主要来自反馈的精准度和AI的理解速度。假设你一天要迭代20次UI细节,理论上能省下接近两个小时,这时间用来写核心业务逻辑或者休息都好。

另一个容易被忽略的点是,它支持AI主动发起视觉交互。AI可以调用命令打开审查模式,你直接在上面批注“这里颜色不对”、“这个按钮太大了”,意见会自动结构化回传。这让整个开发变成了一种“人机共同编辑”的状态,而不是单方面的指令下达。说实话,这种双向的视觉对话,让我用AI编程时的感觉更像在跟一个能“看”到屏幕的搭档合作,而不是对着黑盒子喊话。

具体操作流程

我按照官方流程走了一遍,整个上手过程不到5分钟。以macOS为例,先通过Homebrew安装应用,安装完后打开设置,安装CLI,再为你正在使用的AI工具(如Claude Desktop)点击“Configure”,它就会自动完成命令对接。

实际操作分四步:

- 在浏览器或预览窗口中,按

Cmd+Shift+2 选中要反馈的区域或整个窗口。

- 进入标注界面,用内置工具圈出问题元素、画箭头指向具体位置、敲入文字说明(比如“这个按钮间距再大5px”)。

- 按

Esc 键,标注后的图像会自动复制到你的剪贴板。

- 切换到Claude聊天框,直接

Ctrl+V(或 Cmd+V)粘贴,AI就能看到带坐标的视觉反馈并开始修复。

我拿一个真实的UI设计案例试了试:做一个电商商品卡片页面,卡片标题和价格的垂直对齐总是不准。我用步骤1-3只花了8秒完成标注,粘贴后AI直接返回了修正后的CSS,预览一看就对得整整齐齐。整个过程没有一句多余的文字描述。

如果AI需要我确认某个图表细节,它会调用命令打开审查模式,我直接在打开的窗口里继续画箭头、写“这里加个图例”,反馈又原路返回。整个循环闭合得非常顺畅。

整个操作核心就四个字:截 - 标 - 拷 - 粘。

我建议大家先从调整一个简单的按钮开始练手,熟悉了快捷键后再应用到复杂布局上,效果会更明显。

我现在每天做UI迭代时,已经把Snipit当成必备工具了。它真正让我从“该如何描述”这个思维泥潭里跳出来,把精力放回真正该思考的产品细节上。如果你也在用Claude或其他AI编码助手进行前端开发,强烈建议试试这种画圈反馈的方式。或许你下一次的UI调整,也能从半小时缩短到几分钟。大家在云栈社区分享过类似因为描述不清导致的AI沟通循环吗?欢迎聊聊你的经历。