当AI能够流畅地谈论“自我感受”,甚至某些模型被赋予了“对话退出权”时,我们是否可以说它拥有了意识?2026年初,一篇发表在ArXiv上的论文对此给出了明确的否定答案。这篇由神经科学家 Erik Hoel撰写的《大语言模型意识证伪:持续学习对意识存在的必要性》指出,由于缺乏持续学习能力,现有的大语言模型从原理上无法拥有意识。

论文题目:A Disproof of Large Language Model Consciousness: The Necessity of Continual Learning for Consciousness

论文链接:https://arxiv.org/abs/2512.12802

发表时间:2026年1月19日

论文来源:ArXiv

双重映射与两难困境

1980年塞尔提出的“中文屋”思想实验,首次系统地质疑了功能主义,指出意识无法仅由输入/输出功能定义。外部观察也无法直接通达内部意识状态。但塞尔的中文屋只是一个“直觉泵”,它诉诸哲学直觉,缺乏可实操的科学检验标准。如果一个理论声称“足够复杂的规则手册即有意识”,中文屋无法反驳,也无法回答一个根本问题:何种内部结构才足以支撑意识?

2019年,Doerig等人提出的“展开论证”将中文屋的直觉转化为了数学可构造的替代链。假设某意识理论(例如整合信息理论IIT)基于“循环结构”预测一个RNN或Transformer架构的神经网络具有意识。我们可以将这个RNN按时间展开为一个单层前馈网络(FNN),两者输入/输出完全等价。但RNN具有“循环连接”,而FNN是纯前馈结构。这两个模型的推断(从外部行为判断)不变,但一个被认为有意识,一个被认为无意识。这个矛盾揭示:如果一个意识理论依赖内部结构来预测意识,而这个结构存在一个输入/输出等价、但内部结构不同的替代品,那么该理论的预测就可以被证伪。

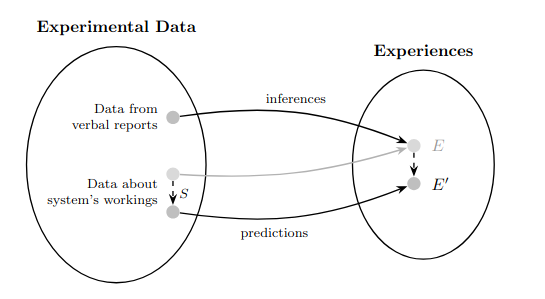

图1 意识理论中的替代论述

在这个基础上,Kleiner 与 Hoel 在《Falsification and Consciousness》一文中提出了“Kleiner-Hoel困境”。这一困境以双重映射为核心分析框架,直指意识理论的核心矛盾:任何想要成为科学理论的意识学说,都面临一个两难选择。如果理论依据系统的内部结构(如整合信息、循环连接)来预测意识存在,但此时又存在一个输入/输出完全等价、内部结构截然不同的替代系统,那么这一理论的预测就会被直接证伪。

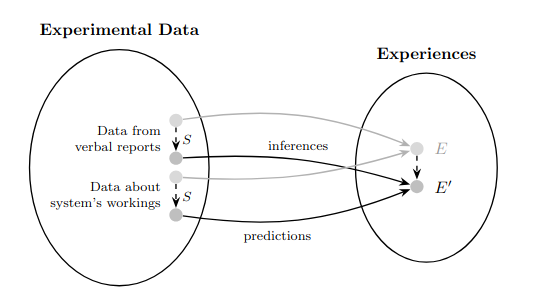

图2 严格依赖(Strict dependency),意识理论仅基于输入/输出判断

而若是理论仅仅基于输入/输出做预测(图2),声称“表现得活着=活着”,无法区分真人与高仿真机器人,那该理论就沦为了不可证伪的平庸理论。 这好比在中文屋中声称规则书“懂”中文,是一种行为主义下的无效理论,不具备科学指导意义。

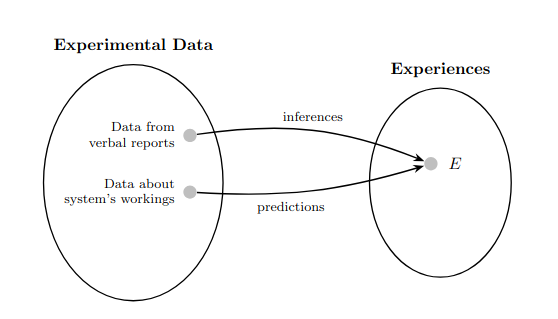

图3 意识理论的结构性悖论

一个理想的意识理论,必须能通过双重映射框架的检验:从系统内部运作推导意识体验的“预测”映射,与从外部行为反推意识状态的“推断”映射,二者必须在经验空间中收敛,理论才有效。这个框架将意识是否存在的判别,从哲学思辨转化为了可实验验证的科学标准。

输入输出等价的替代链约束

在双重映射框架下,大模型的意识问题变得从原理上不可行。考虑一个部署状态下、版本固定的大语言模型。根据神经网络的万能近似定理,其输入/输出函数可以被一个FNN以任意精度近似。这意味着,无论大模型的功能看起来多么强大,其输入/输出行为均等价于一个单隐藏层前馈神经网络(FNN)。而单隐藏层FNN,又可以等价于一个巨大的有限查找表。

查找表是什么?它是一个庞大的IF-THEN规则集合。它没有动态性、没有记忆、没有信息流、没有内部复杂性。任何声称一个查找表拥有“非平庸意识”的理论,只能基于其输入输出来做预测,最终导致理论的“预测”与“推断”完全依赖于同一套数据,完全不满足双重映射的检验要求。

Hoel在论文中定义了 “替代距离”,即两个系统间差异属性的集合。在上述案例中,大模型与单层FNN的替代距离是层数、注意力机制等属性;单层FNN与查找表的替代距离是数据的压缩程度。这两个属性都不足以支撑“具有该属性即具有意识”的宣称。换句话说,由于大模型和FNN及查找表之间的替代距离太近,导致意识理论无法基于这些微小的差异,来预测意识是否依赖于对应的内部结构。

试想,如果某个意识理论声称大模型的意识源于“网络层数”,那么就可以用一个不同深度但输入/输出等价的网络替代原模型。此时,理论的“预测”发生了改变,而基于行为的“推断”保持不变,理论将被直接证伪。同理,如果意识理论将“数据压缩程度”作为意识判断依据,也可以用不同宽度、但输入/输出等价的网络替代,同样会导致理论被证伪。

由此,任何声称当代静态大模型拥有意识、并且自身是非平庸且可证伪的意识理论,都必然会因为这一替代链的存在而被证伪。 而若仅基于输入/输出声称大模型有意识,理论则会退化为行为主义,成为无法被证伪的平庸理论。这一结论得到了Kolmogorov 替代定理的支撑。

持续学习是通往意识的“窄门”

上述论证并非否定未来AI具备意识的可能性,而是为“有意识的AI”划定了核心必要条件:具有意识的系统,必须与其无意识替代品保持足够大的替代距离。

Hoel提出,人类大脑恰恰满足此条件,而其中的关键在于持续学习。

大语言模型看起来是概率模型,同一个输入多次的输出可能不同,但对于相同内容的输入,在不同时刻输出的概率分布是恒定不变的。查找表、单层FNN、部署态大模型都属于静态系统。而人类及多数动物是持续学习系统,核心特征是每次经验都会微调内部神经表征,系统结构会随着体验发生实质性、不可逆的改变。比如昨天被火烫伤,今天看到火苗会更快地缩手。这一过程无需将“被烫伤的历史”作为外部输入,而是系统内部的自主更新与学习。

当代大模型,常常因为其长上下文能力而被误认为具备持续学习能力。然而,上下文学习本质上是将历史对话作为输入的一部分,是静态系统处理更长输入,并非真正的持续学习。大模型的学习仅在训练期发生,部署后模型参数就被冻结,这与人类“每时每刻都在学习”有着本质区别。

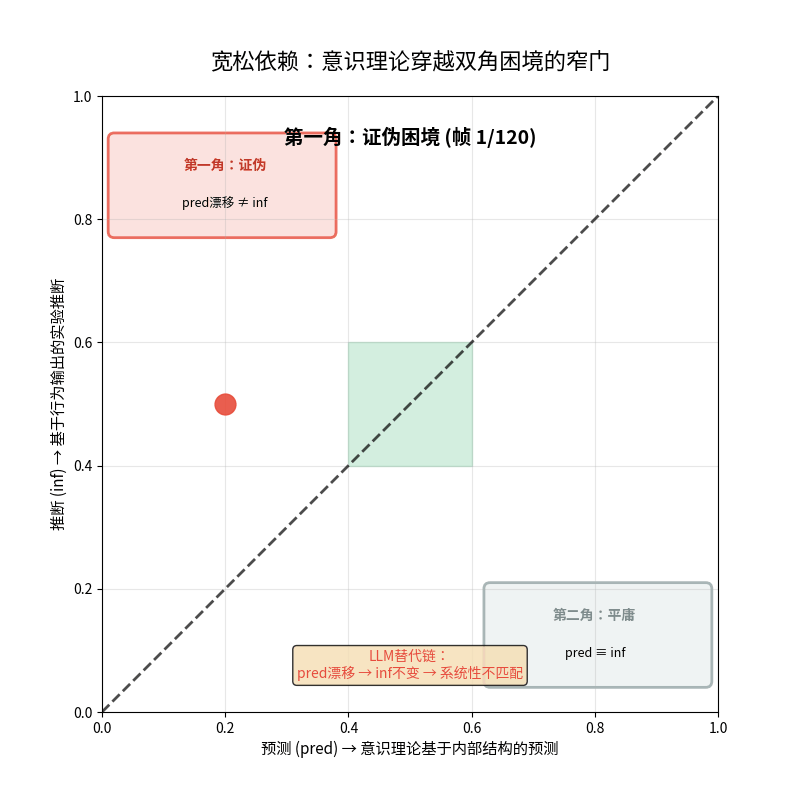

人类对话时无需重新输入全部历史,因为大脑已经将上下文内化;而大模型每次生成新回复,都需要将之前的对话内容塞进提示词,这恰恰暴露了其静态本质。由此,Hoel提出了 “持续宽松依赖” ,指出一个意识理论 T 满足宽松依赖,当且仅当:

(1)其“预测”与“推断”不构成严格依赖,即“预测”不完全由行为输出数据决定。

(2)不存在因可定义的普遍替代(例如用查找表替代大模型)导致的、基于内部结构的“预测”与基于行为的“推断”结果不匹配。

持续宽松依赖介于预测映射与推断映射之间,能让二者可分离但不产生根本性漂移,从而使意识理论既具备可证伪性,又非无科学解释力的平庸理论。

图4 意识理论穿越“双角困境”的过程示意图(由Qwen 3 max生成)

上述定义的关键点在于,支撑意识的属性(如可塑性)必须在意识存在的每一刻都活跃。如果某个理论声称“过去的学习赋予了意识”,那么在学习停止的瞬间,系统就可以被一个静态的替代品所替换,从而导致理论被证伪。因此,意识必须与当下正在进行的学习过程绑定。

在人与人的对话中,每句话都伴随着实时的神经表征重塑,对应海马体位置细胞可在单次经历中就形成新表征,可塑性在秒级尺度持续存在。因此,“当下进行的学习”作为意识存在需满足的属性时刻在线,满足了持续宽松依赖。而对于大模型,在每次与用户的对话前后,系统内部的表征没有任何改变,不满足持续学习的要求,“宽松依赖”在此断裂。

然而,持续学习仅仅是意识存在的必要条件。一个扫地机器人即使能持续学习(例如适应不同地面),也未必会产生意识。意识的存在,或许还需要学习聚焦于特定类型(如反事实推理、强大的泛化能力等)。

大模型无意识的现实意义与类人 AI 发展方向

Hoel的研究从原理上证伪了当代静态大语言模型具备意识的可能性,并明确了持续学习是意识存在的核心必要条件。这为未来类人AI的架构革新划定了清晰的理论边界。

未来的真正类人AI,需要搭建能够支持持续学习的架构,实现内部表征的实时、不可逆、具有泛化性的改变。这项研究也推动意识科学从对静态系统的分析,转向对动态学习过程的研究,为构建真正科学的意识理论提供了一个坚实的框架。

这种关于意识和智能本质的探讨,往往能激发跨领域的思想碰撞,这也是技术社区持续活力的来源。