告别盲调!Anthropic和Karpathy推崇的自动化进化工作流,正在重塑AI时代的工程实践法则。

你是否也曾陷入这样的循环:修改一个参数,运行一次实验,结果不理想;再换一个参数,继续运行……如此机械地重复数十次,耗费大量精力,最终效果却只提升了微小的0.1%?

在大模型开发的早期阶段,我们就像凭感觉酿酒的老师傅,依赖经验反复调整Prompt、微调参数、筛选数据,试图找到那个完美的“配方”。但这种依赖人力“盲调”的模式,正被一种全新的自动演进范式所终结。

Autoresearch(Karpathy那个几天内收获5万Star的630行代码项目)与Anthropic工程博客中提出的“Harness”架构,都指向同一个目标:构建能够从反馈中自我迭代、实现自动进化的AI系统。本文将深入探讨这一跨越代码优化、内容生成乃至跨语言微调的自动演进机制,拆解其背后的核心逻辑。

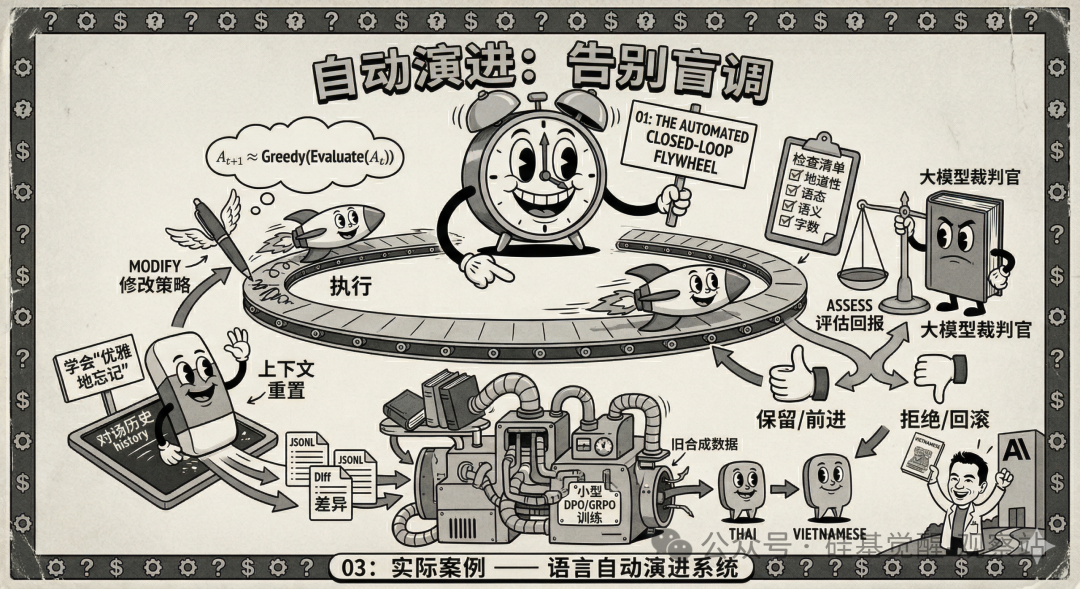

01:核心机制 —— 自动化的闭环飞轮

自动演进的核心,是一个简洁而强大的机制——一个基于贪心搜索的自动化闭环工作流。你可以把它理解为工程领域的“物竞天择”:

修改策略 → 执行 → 评估收益 → 优胜劣汰(保留/回滚) → 继续修改

Karpathy正是用这个循环来优化机器学习训练代码。系统每次对参数或结构做一点微小修改,训练短短几分钟,然后观察验证损失是否下降。如果下降了,就保留这次修改;如果没下降,就回滚到之前的状态,接着进行下一轮尝试。这样一个晚上可以自动进行上百次实验,完全无需人工干预。

这并非多么高深的技术,其本质是将重复性的体力劳动交还给机器,让人能够专注于更具创造性的思考。

这个通用循环可以平移到无数场景:

- 应用于内容生成:修改一句Prompt,用大模型作为裁判评估生成文章的质量,保留高分结果,淘汰低分结果。

- 应用于数据合成:针对模型在泰语、越南语等特定语种翻译上的错误,自动合成一批修复数据,重新进行监督微调,然后评估校验分数,保留有效的改进。

任何能量化评估的事物,都可以套用这个循环进行自动化优化。

02:关键使能器 —— “法官”与“失忆人”

如此简单的循环为何过去难以实现,如今却成为Anthropic等前沿公司的秘密武器?除了大模型本身推理能力的提升,还有两个关键的工程洞见起到了决定性作用。

关键一:LLM-as-a-Judge,将主观“感觉”客观化

自动化闭环能够稳定运行的前提,是必须有一个可靠且一致的“裁判”。

如果让模型凭主观感受为一篇文章打分(例如1-10分),由于固有的随机性,评分会产生严重漂移。同一篇文章今天可能得8分,明天却只得6分,这种不稳定性会导致系统迭代失效。

解决方案是:将模糊的主观评价维度,拆解为一系列客观的是非题检查清单。

例如,在评估泰语翻译质量时,我们不再问“翻译得好不好”,而是将其分解为:

- 语义是否存在漏翻或错翻?(是/否)

- 是否存在死板的模板化句式?(是/否)

- 专业术语的使用是否前后一致?(是/否)

- 译文字数是否控制在$N$-$M$之间?(是/否)

评判标准越客观,自动化迭代就越稳定。 我们不再是依赖感觉的酿酒师,而是建立起了一套自动化的“化学检验”标准。

关键二:上下文重置,学会“优雅地忘记”

许多全自动智能体系统在长时间自治运行后容易崩溃,Anthropic将其归因于“上下文焦虑”。随着对话上下文窗口被漫长的试错历史填满,模型的注意力会变得分散甚至“失焦”,从而导致任务提前异常终止。

破局之道在于:让系统学会“优雅地忘记”,强制进行“上下文重置”。

不要让智能体背负着几十轮“试错对话”的包袱开启下一次迭代。相反,应该果断清空其对话历史,仅通过结构化的产物来传递状态信息。例如,更新后的JSONL训练集文件、Git的差异记录,或是代码仓库的当前快照。这样,每次智能体被唤醒时,都面对一个拥有最新事实的“干净大脑”,而不会被之前的错误尝试所干扰。这种思路在处理复杂的 Agent工作流 时尤为重要。

03:实战案例 —— 语种自动进化系统

我们将上述理念付诸实践,构建了一个东南亚语种自动进化项目,专注于提升泰语、越南语等语言的模型能力。

传统做法是:人工收集数百万条高质量语料 → 监督微调 → 验证效果 → 循环往复。这一过程不仅耗时,且成本极高。

我们的自动进化路径则截然不同:

- 定义客观标准:设计一套针对目标语种(如泰语)的地道性、语态一致性、语义忠实度等多维度的检查清单,作为

LLM-as-a-Judge的评判依据。

- 定向数据合成:调用模型针对现有错误样本进行针对性修复,合成新的偏好数据。

- 强制状态重置:将合成数据直接追加到结构化的JSONL文件中。随后,彻底清空数据合成智能体的对话历史。

- 自动训练循环:触发自动化脚本,执行DPO或GRPO训练,获得新的小语种微调模型。

- 循环评估与进化:让新模型接受“法官”的评估。只有当其在特定维度(如“地道性”)的评分超过既定基准时,才将本轮合成的数据批次永久纳入训练集,从而推动模型进入下一轮进化。

这是一个完全自治的循环。系统自行发现问题、合成数据、微调模型、自我审计,最终实现持续进化。 这个案例充分展示了 Data Science 与自动化结合带来的效能提升。

04:结语 —— 框架思维才是终极壁垒

自动演进不仅是一个技术框架,更代表了一种适应AI时代的新思维范式。

它揭示了一个关键点:限制我们能力的往往不是工具本身,而在于能否将手头的问题抽象成一个可复用的自动化流程。

具备框架思维的人看到 autoresearch 项目,不会觉得“这只是个ML工具,与我无关”,而是能立刻联想到十个可以套用此模式的自动化场景。

工具会迭代过时,但优秀的框架思维永不过时。 Karpathy贡献了630行代码,Anthropic分享了Harness架构,但他们真正传递的,是一套任何人都可以借鉴并应用的自动化迭代方法论。

把重复的体力活交还给机器,让AI在设定好的赛道上自我竞争与优化。我们唯一需要做的,就是构建一个清晰、客观的起点,然后推动进化的飞轮持续转动。 这种从实践中提炼方法论的能力,正是技术从业者在 云栈社区 这样的平台上持续交流与成长的价值所在。