近日,谷歌研究院发表的 TurboQuant 论文因其宣称能大幅压缩大模型 KV缓存 而备受瞩目,甚至一度影响了资本市场的存储股表现。然而,这项研究很快陷入了一场关于学术规范的争议漩涡。RaBitQ量化算法的原作者、苏黎世联邦理工学院的华人博士后高健扬公开发声,指控TurboQuant论文存在三大问题,且团队在知情后并未积极修正。

KV缓存压缩至1/6,TurboQuant宣称了何种技术?

在了解争议细节前,我们先来看看处于风暴中心的TurboQuant技术本身。

向量量化是AI模型压缩的主流技术之一,旨在缩小高维向量以节省内存并提升效率。谷歌提出的TurboQuant声称是一种“无损极限压缩算法”,主要通过两个关键步骤实现目标:

第一步是使用PolarQuant方法进行高质量压缩。该方法首先对数据向量进行随机旋转,以简化其几何结构,从而便于后续使用标准量化器。这一步骤旨在将大部分比特用于捕捉向量的核心特征。

第二步是应用QJL算法来消除隐藏误差。该步骤仅使用少量剩余比特(如1比特),对第一阶段残留的微小误差进行校正。QJL算法基于Johnson-Lindenstrauss变换,能在缩小高维数据的同时保持数据点间的基本关系。

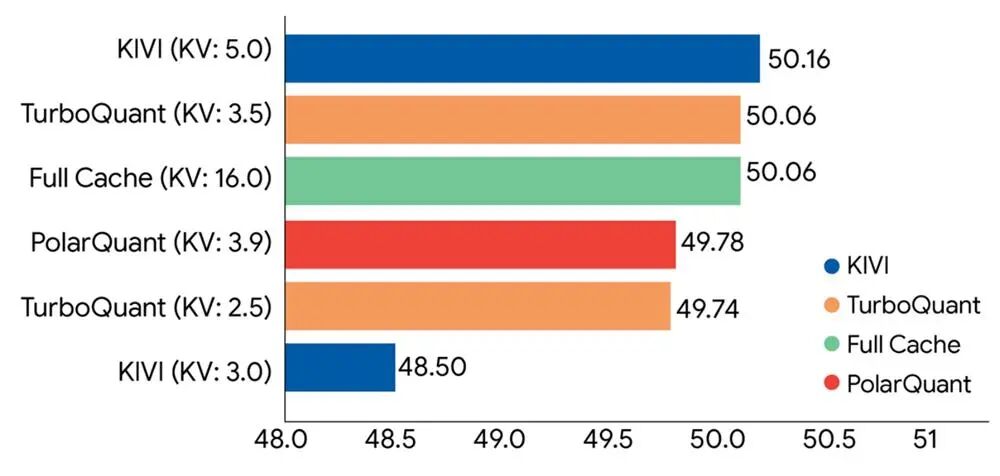

根据谷歌公布的实验数据,TurboQuant在所有基准测试中均达到了“完美的下游任务表现”,同时将大模型推理时的KV缓存内存占用削减至原来的1/6。

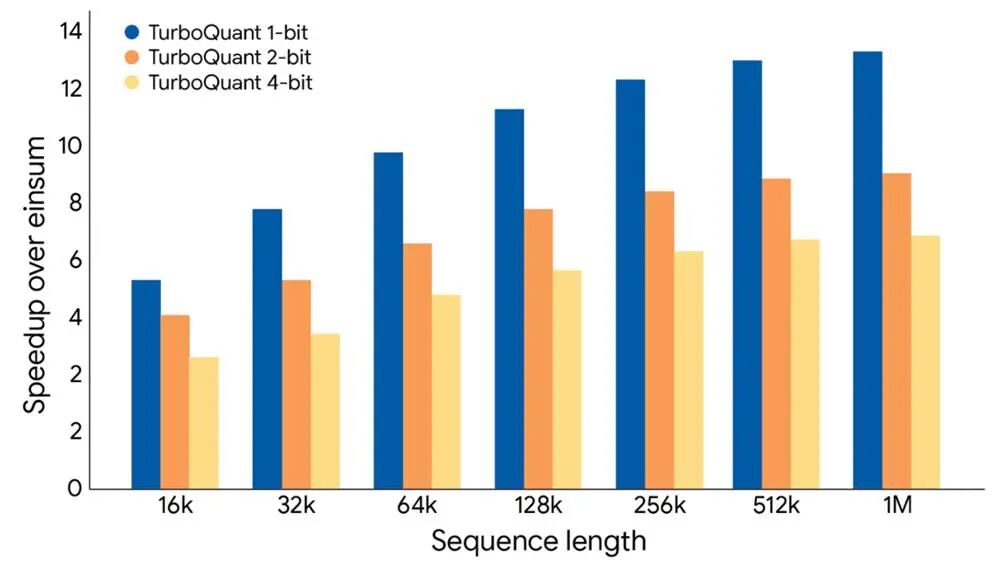

在性能方面,谷歌称在H100 GPU上,使用4比特的TurboQuant计算注意力逻辑值,相比32比特未量化的键值,能实现高达8倍的性能提升。

RaBitQ作者完整复盘:三大核心指控与漫长的沟通无果

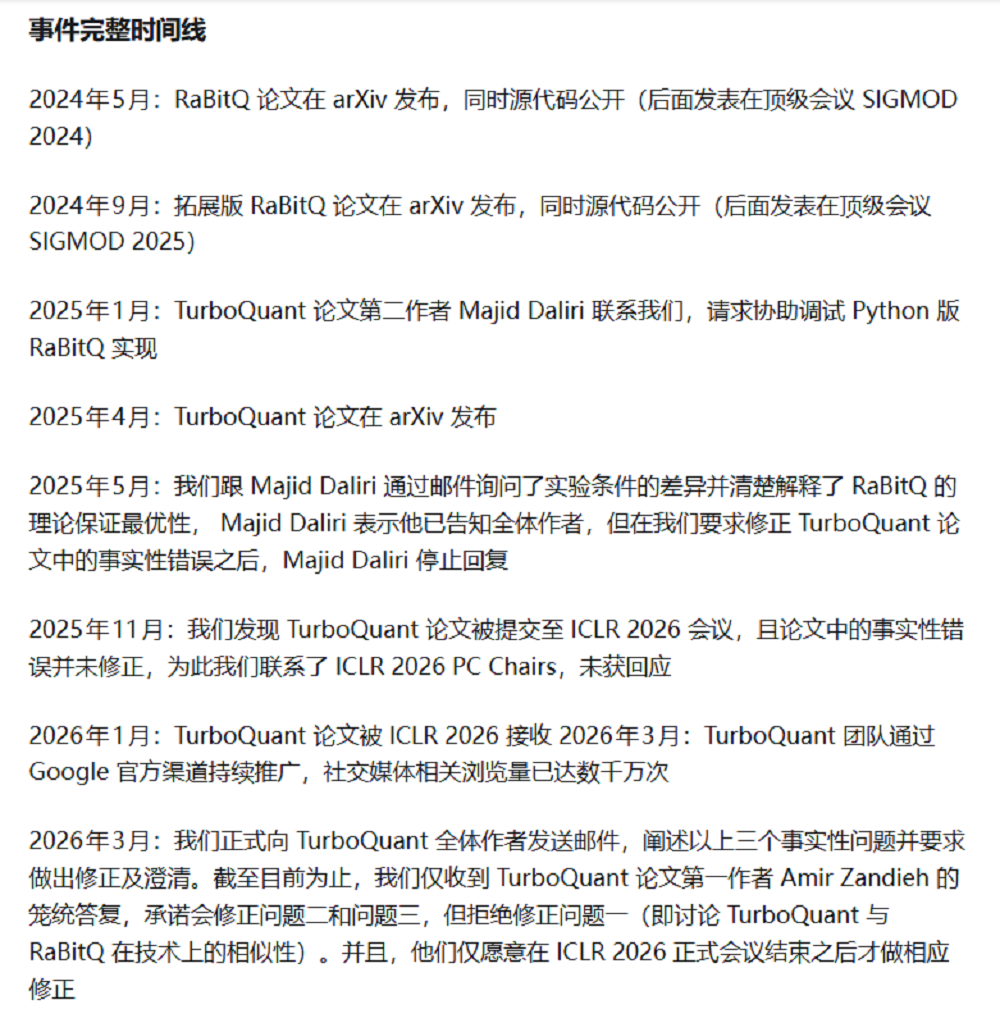

争议的另一方是RaBitQ算法的作者高健扬。RaBitQ论文于2024年5月在arXiv上发布,其核心思想同样涉及利用随机旋转(Johnson-Lindenstrauss变换)进行向量量化。高健扬在社交平台详细列出了事件的时间线,并指出了TurboQuant论文存在的三个主要问题。

指控一:系统性回避与已有工作的相似性

高健扬指出,TurboQuant和RaBitQ在方法核心上高度相似,两者都采用了在量化前对输入向量施加随机旋转(Johnson-Lindenstrauss变换)的设计。他认为,作为在相同问题设定下率先将随机旋转与向量量化结合并建立理论保证的先行工作,RaBitQ理应在论文中得到准确描述和充分讨论。然而,TurboQuant论文对此几乎只字未提。

指控二:错误描述RaBitQ的理论结果

高健扬称,TurboQuant论文在没有任何依据的情况下,将RaBitQ的理论保证定性为“次优”,并将其归因于“较粗糙的分析”。而实际上,RaBitQ的误差界已被证明达到了相关理论领域的渐近最优水平。

指控三:刻意创造不公平的实验环境

据高健扬披露,TurboQuant团队在对比实验中使用了双重标准:使用单核CPU且关闭多线程的配置来测试RaBitQ,却使用英伟达A100 GPU来测试TurboQuant。此外,他们使用了自行翻译的、效果更差的Python代码来测试RaBitQ,而非原作者开源的高效C++实现。这些关键的实验条件差异并未在论文中充分披露。

更令RaBitQ团队不满的是沟通过程。高健扬表示,早在2025年5月(即TurboQuant论文投稿至ICLR 2026会议前),他们就已经通过邮件向TurboQuant作者指出了上述问题,对方承认知情但选择不予修复。论文被接收并广泛传播后,双方再次沟通,TurboQuant第一作者仅承诺修正问题二和问题三,但仍拒绝在文中讨论与RaBitQ的技术相似性,且表示修正要等到ICLR 2026会议结束后。

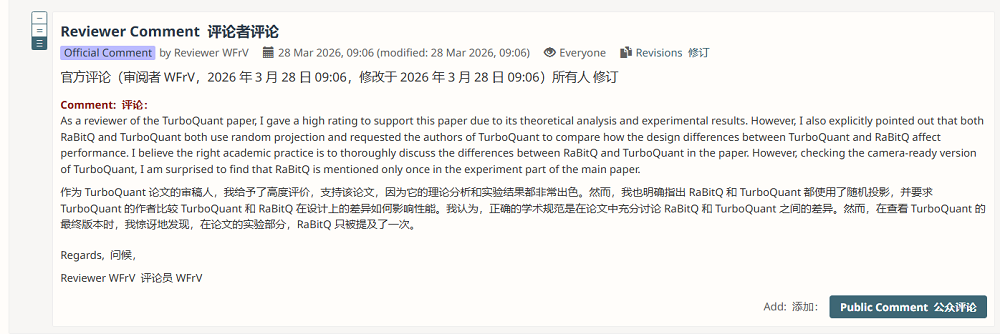

评审与社区的质疑:顶会论文也需经受审视

高健扬的指控获得了一些学术界同行和技术社区网友的声援。TurboQuant论文的一位评审在OpenReview平台公开评论称,他在评审时就明确要求作者比较其与RaBitQ的设计差异,但最终在论文定稿中发现,RaBitQ仅在实验部分被提及了一次,对此他表示震惊。

在技术社区中,也有开发者表达了类似的疑虑。有知乎网友评论称,去年读TurboQuant论文时就感觉其核心公式像是RaBitQ的另一种表达,并在GPU上重新实现了一遍,创新性不足。

更有动手实践的网友声称,自己复现了TurboQuant,发现在向量检索任务中,其召回率实际上低于RaBitQ。

在X等国际平台上,有评论指出,投稿前已知问题却选择忽略,是最糟糕的情况。ICLR这样的顶级会议接收论文,并不自动等同于其所有技术主张都坚不可摧,同行和社区的持续审视至关重要。

结语:当技术叙事影响市场,学术严谨性更显珍贵

目前,这场围绕向量量化算法优先性与学术规范的争议仍在持续,尚无官方最终定论。RaBitQ团队已向ICLR会议提交正式投诉,并考虑发布更详细的技术报告。

这一事件再次凸显了一个关键问题:当一篇附着“顶尖会议”和“科技巨头”标签的论文,其影响力能穿透学术圈、波及产业与资本市场时,研究者对学术规范的恪守就变得尤为重要。对前人工作的尊重与准确引用,对实验条件的完整透明披露,以及对合理质疑的及时、诚恳回应,不再是锦上添花的“软要求”,而是维护整个AI研究生态可信度的基石。无论这场争议结果如何,它都为所有研究者敲响了警钟:顶会与大厂的光环,不应成为学术叙事“带病传播”的护身符。技术的进步固然令人兴奋,但确保进步每一步的扎实与诚实,才是长远发展的根本。对于这类涉及前沿算法与学术伦理的深度讨论,像云栈社区这样的开发者平台,往往是观点交锋、促进思考的重要场所。