这两天我刷 GitHub Trending 时,注意到一个很有意思的现象。

冲上热榜的,不只是新模型、新框架,而是两类看起来没那么“性感”的项目:

claude-howtoclaude-code-best-practice

它们都和 Claude Code 相关,但都不是底层模型,也不是某个全新的 AI IDE。更准确地说,它们提供的是另一种东西:

关于怎么把 AI 编程真正用起来的方法论。

这件事很值得写,不是因为“又有两个项目火了”,而是因为它背后反映出一个越来越清晰的趋势:

AI 编程的竞争点,正在从“你有没有用上模型”,转向“你有没有把模型组织成稳定可复用的工作流”。

这可能才是最近这波 Claude Code 生态热起来最值得注意的地方。

一、先看现象:最近冲上热榜的,不只是工具,而是“怎么用工具”

从 GitHub Trending 当天页面可以确认,下面两个 Claude Code 相关项目都进入了热榜:

1) luongnv89 / claude-howto

GitHub 页面给出的公开描述是:

A visual, example-driven guide to Claude Code — from basic concepts to advanced agents, with copy-paste templates that bring immediate value.

直译过来,大概是:

一个面向 Claude Code 的可视化、案例驱动指南,从基础概念到高级 Agent,都提供可以直接复制使用的模板。

也就是说,这个项目卖点不是“发明了一个新工具”,而是把 Claude Code 的使用经验做成了一套更容易理解、更容易上手、也更容易复用的内容结构。

来源:

2) shanraisshan / claude-code-best-practice

这个项目的仓库标题就已经很直接:

Claude Code Best Practice

GitHub 页面给出的公开描述相对简短:

practice made claude perfect

虽然这句描述本身比较口语化,但项目名字已经很明确了:它关注的不是 Claude Code 是什么,而是 Claude Code 应该怎么用才更好。

来源:

从 GitHub Trending 页面当天可见信息来看,这两个项目都拿到了明显的 star 增长。这至少说明一件事:

最近被大量开发者主动点进去看的,不只是“模型能力”,而是“如何把 Claude Code 用对”。

这和前一阶段 AI 工具流行的方式,已经不太一样了。

二、为什么这件事值得重视?

因为这波热度的重点,不在 Claude Code 本身,而在 生态里开始长出“方法论文档层”。

过去一段时间,AI 编程类产品的主叙事通常是:

- 模型更强了

- 代码补全更准了

- Agent 能做多步操作了

- 工具能自动读项目、改文件、跑命令了

这些当然重要。但当越来越多开发者真的开始把 AI 编程工具放进日常工作后,一个新问题自然会出现:

工具有了,接下来怎么稳定地用?

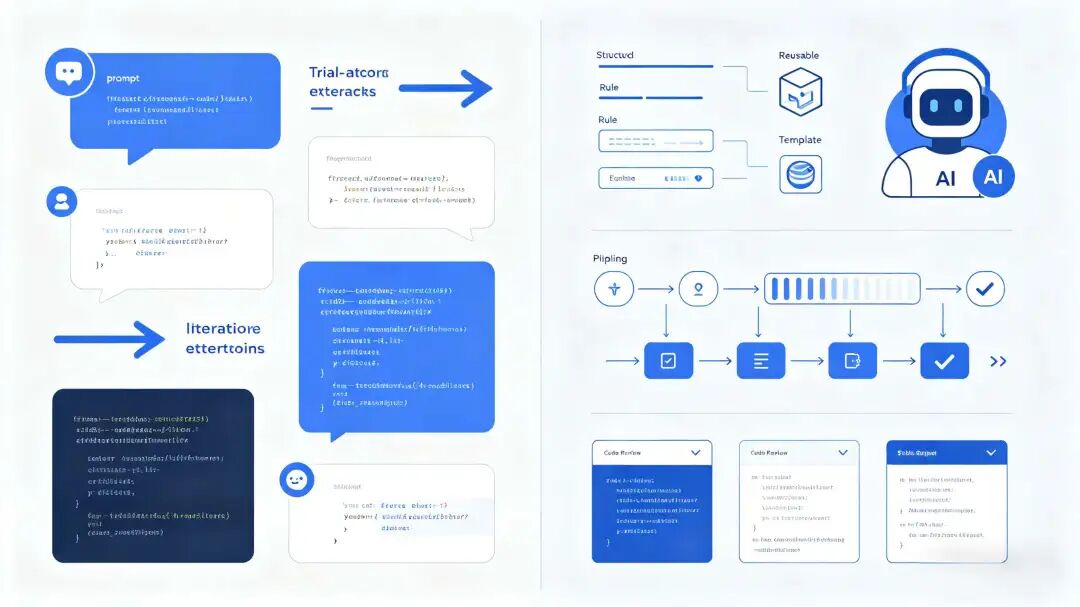

这时候,真正有价值的就不再只是“再来一个模型”,而是下面这些东西:

- 什么任务适合交给 AI

- 什么任务必须人来兜底

- 规则文件应该怎么写

- 上下文应该怎么组织

- Prompt 模板怎么沉淀

- 多步任务怎么拆

- 报错后怎么让 Agent 自动修正

- 团队内部怎么把这些经验复用起来

换句话说,大家开始缺的不是“能力”,而是“使用结构”。

而像 claude-howto、claude-code-best-practice 这类项目,补的恰恰就是这部分东西。

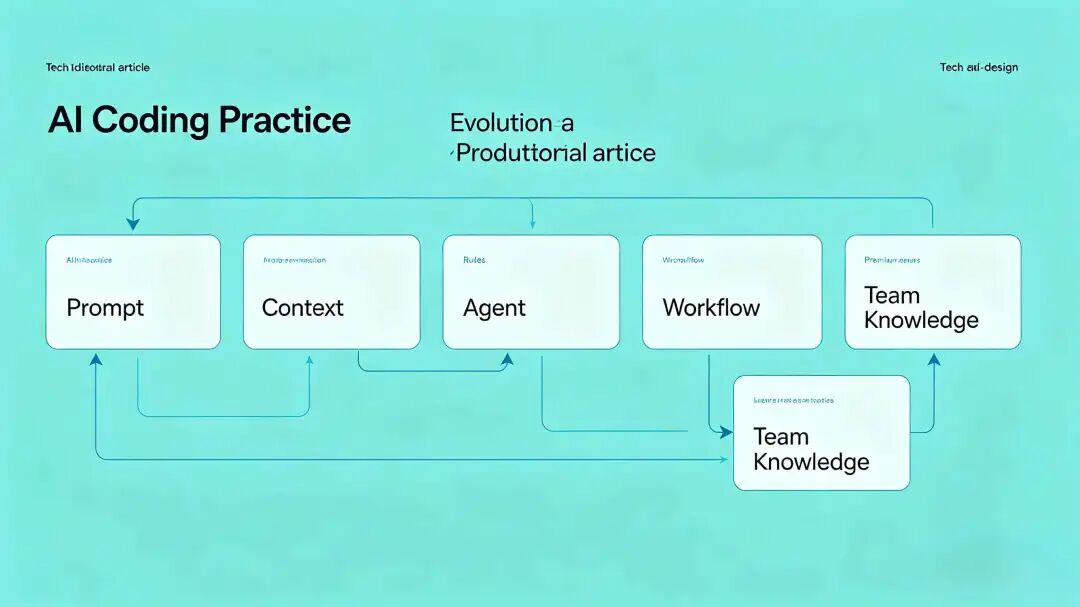

三、这类项目爆火,本质上说明 AI 编程进入了第二阶段

如果粗略划分一下,AI 编程的发展过程,大概可以分成两个阶段。

第一阶段:先证明“能不能用”

这个阶段大家最关心的是:

- 模型会不会写代码

- 能不能理解项目

- 能不能改 bug

- 能不能帮我生成脚手架

- 能不能自动执行命令

这个阶段的重点是:

先证明 AI 编程不是玩具。

所以当时最容易火的,是:

- 新模型发布

- 新 Agent 产品

- 新 IDE 插件

- 各种 benchmark 和 demo

第二阶段:开始解决“怎么用得稳”

当越来越多人接受“AI 编程可以用”之后,问题就变了。

接下来最真实的问题变成:

- 为什么同一个工具,有人用得很顺,有人一塌糊涂?

- 为什么有的人能稳定产出,有的人总在返工?

- 为什么有的团队能把 AI 接进日常开发流程,有的团队只能偶尔拿来试试?

答案通常不在模型参数里,而在 工作流设计 里。

这也是为什么最近开始火的,不只是“一个新模型”,而是“怎么用 Claude Code”的指南、模板、最佳实践项目。

因为开发者已经开始进入第二阶段了:

从验证能力,转向沉淀方法。

四、为什么“教程型项目”会变成热榜项目?

这件事其实很有代表性。

正常理解里,GitHub 热榜更容易出现的是:

而不是“教程”或者“最佳实践”。

但最近这类项目能冲上去,说明它们已经不再只是“文档附属品”,而是在承担一种新的角色:

把零散的个人经验,整理成可以复制的工程方法。

这在 AI 编程 场景下尤其重要。

因为 AI 编程不像传统代码库那样,只要 API 固定、文档清楚,团队就能很快统一起来。它里面有大量隐性经验,例如:

- 什么提示方式更稳

- 什么上下文信息必须给

- 什么事情交给 Agent 容易翻车

- 怎样设计规则文件能减少来回修正

- 怎样把重复工作变成模板

这些东西如果不被整理出来,团队内部就会变成一种很低效的状态:

- 每个人都在各自摸索

- 每个人都重复踩坑

- 有效经验无法传递

- 工具明明很强,但整体产出不稳定

所以从这个角度看,这类开源社区项目火起来很正常。它们不是在提供“新能力”,而是在提供:

AI 编程时代最稀缺的中间层:可复用的方法论。

五、这背后真正变化的,不是工具,而是开发者的关注点

如果把这波热榜再往前拉长一点看,会发现一个很明显的变化。

以前大家更爱讨论:

- 哪个模型最强

- 哪个 Agent 最聪明

- 哪个 benchmark 分数更高

现在越来越多人开始讨论:

- 规则文件怎么写

- context 怎么收敛

- prompt 怎么模板化

- Agent workflow 怎么设计

- token 怎么控制

- 团队怎么沉淀最佳实践

这其实说明了一件很重要的事:

AI 编程正在从“模型消费”转向“工作流工程”。

这个变化非常像软件工程本身的发展过程。

软件行业早期,大家比的是:

后来比的是:

- 结构好不好

- 性能稳不稳

- 工程体系完不完整

- 团队能不能复制成功经验

AI 编程现在也在经历类似的过程。

一开始比的是“能不能让 AI 帮我写代码”。接下来比的就是:

- 你有没有一套稳定的上下文组织方式

- 有没有一套规则和模板

- 有没有适合团队的执行边界

- 有没有办法把一次成功,变成下次还能成功

也就是说,未来真正拉开差距的,很可能不是“你有没有 AI 编程工具”,而是:

你有没有把 AI 编程变成一套可复用、可扩展、可协作的流程。

六、为什么这对技术团队尤其重要?

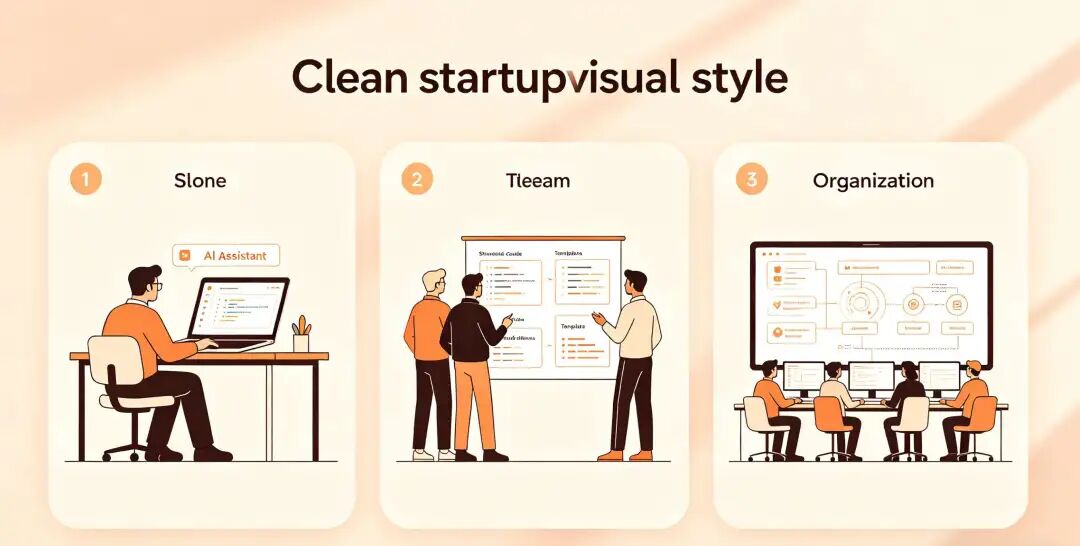

因为个人层面的“会用 AI”,和团队层面的“把 AI 用进开发流程”,是两回事。

个人会用,通常意味着:

- 你知道怎么提问

- 你知道怎么让它改代码

- 你知道怎么把结果拿回来自己判断

但团队能用,意味着你还要解决:

- 规则怎么统一

- 风格怎么统一

- 风险怎么控制

- 哪些任务允许自动执行

- 哪些任务必须 review

- 如何复用已有 prompt / workflow

- 如何让新成员快速接入同样的方法

这时候,“方法论开源项目”的价值就上来了。

它们的真正作用,不只是给个人看,而是给团队一个可借鉴的起点。

对技术团队来说,这种项目最值得关注的地方不是某一条具体 prompt,而是它们在尝试做的事情:

- 把经验结构化

- 把流程显性化

- 把可复用部分模板化

- 把隐性技巧变成团队资产

这件事本身,甚至比某个单独模型升级更重要。

七、从热榜现象回到判断:Claude Code 生态为什么突然爆了?

如果只看表面,会觉得是 Claude Code 相关内容突然热起来了。

但如果往深一点看,我更愿意把它理解成:

围绕 Claude Code 的“使用层生态”开始成形了。

一个工具什么时候真正进入扩张期?通常不是只有官方在讲它,而是社区开始自发生产下面这些东西:

- 指南

- 模板

- 最佳实践

- 案例库

- 工作流沉淀

- 团队玩法总结

因为这说明它的使用已经从“少数人会玩”进入到“很多人开始认真使用”。

而从最近热榜出现的项目看,Claude Code 至少已经出现了这个信号。

这并不意味着它已经赢了什么,但至少说明了一点:

开发者社区已经不再只是围观 Claude Code,而是在围绕它构建可复用的使用方法。

这正是生态开始变厚的标志。

八、这件事对普通开发者最现实的启发是什么?

我觉得不是“赶紧去收藏两个项目”。

更重要的启发是:

1. 不要只盯着模型升级

未来对开发效率影响更大的,未必是模型再提升 5%,而是你有没有更好的使用框架。

2. 尽早沉淀自己的规则和模板

如果你已经在用 AI 编程,最值得做的事情之一就是把有效经验整理出来,例如:

- 哪类任务交给 AI

- 哪类任务要人工接管

- 常用 prompt 模板

- 项目规则文件

- 常见错误恢复方式

3. 把一次成功,变成可复用流程

真正的效率不是“这次它帮我搞定了”,而是“下次类似任务还能稳定搞定”。

4. 开始把 AI 编程当成工程问题,而不是聊天技巧

这可能是最关键的一点。当你把 AI 编程理解成工程问题之后,你关注的重点会自然变化:

- 上下文组织

- 模板设计

- 规则约束

- 任务拆分

- 失败恢复

- 协作边界

而这些,才是决定长期效率的东西。

九、最后

如果你问我,这波热榜现象最值得记住的是什么,我的答案不是:

“Claude Code 很火。”

而是:

开源社区最近开始爆火的,不只是 AI 编程工具,而是 AI 编程的方法论。

这说明一件事:

AI 编程正在从“会不会用”进入“怎么用得更稳、更快、更可复用”的阶段。

而一旦进入这个阶段,未来真正重要的资产就不再只是模型本身,而是围绕模型形成的:

从这个意义上说,最近冲上热榜的这两个项目,热的不是“Claude Code 教程”这五个字,而是开发者社区正在集体补上的那层东西:

把 AI 编程,从个人技巧,变成组织能力。

如果你只是把 AI 编程工具当作一个会写几行代码的助手,那么最近这波热榜可能只是“又火了两个项目”。

但如果你把它放进更长期的技术演进里看,会发现信号其实很清楚:

开发者社区已经开始不满足于“把模型接进来”,而是在认真讨论怎么把模型用稳、用顺、用成一套可以复用的方法。

这件事,可能比又一个新模型发布更重要。

因为模型能力会不断迭代,但真正能沉淀下来的,是围绕模型形成的使用结构。

而最近这两个项目爆火,本质上就在说明:

AI 编程正在从“工具热”,走向“方法论热”。

这很可能就是下一阶段最值得关注的变化。这一变化也常成为 云栈社区 中技术讨论的焦点。

参考资料