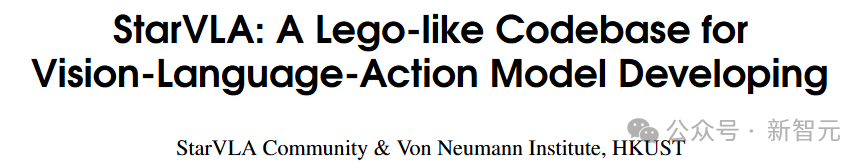

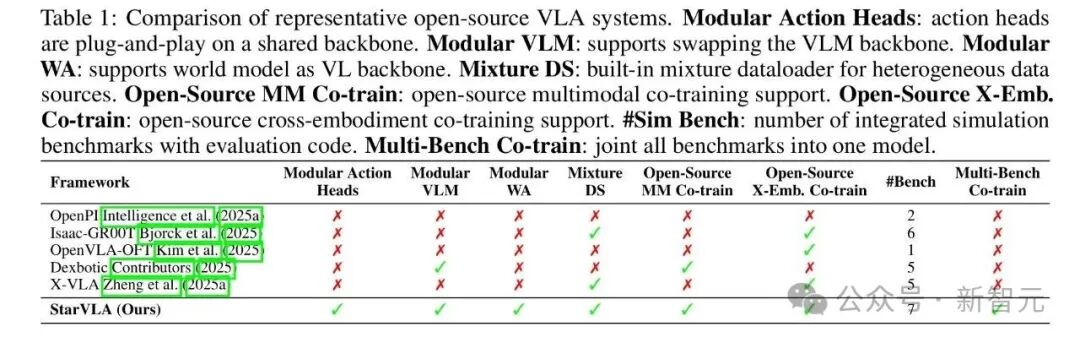

当前,视觉-语言-动作模型正成为推动具身智能发展的核心范式。然而,这个领域却陷入了一种典型的“碎片化”困境:不同的研究团队采用异构的动作解码方法、强耦合的数据处理管线以及互不兼容的评估协议。这直接导致不同方法之间难以进行公平的横向对比,而模型的复现成本也居高不下。

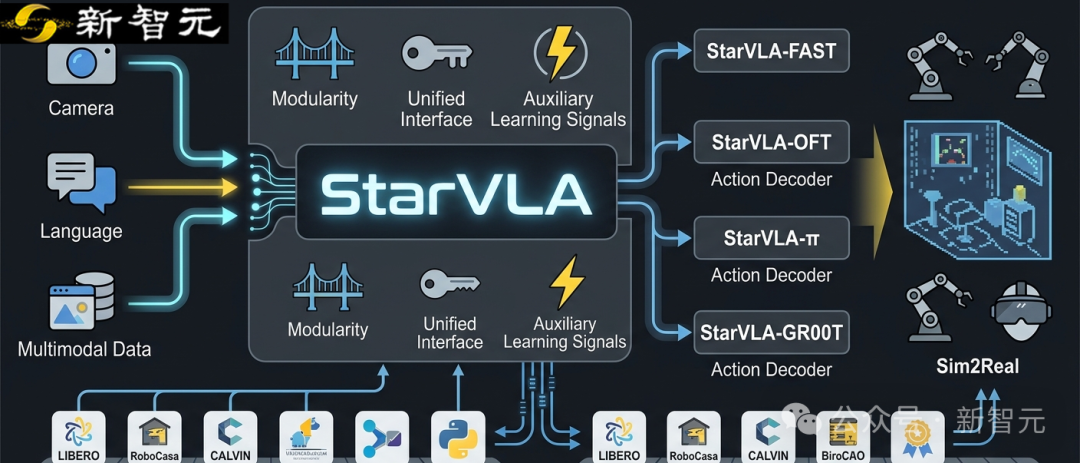

一个典型的开源项目 StarVLA 选择了一条不同的道路。它没有盲目地堆砌算力或在排行榜上刷分,而是从系统抽象的层面直击痛点,提出了一套名为“乐高式”的统一架构。这套架构的核心思想是将模型主干与动作头解耦,为研究者提供了一个高度模块化的实验平台。

VLA研究的“巴别塔”困境

尽管VLA模型已经成为主流,但学术研究实际上正面临着三重挑战:

- 架构割裂:自回归的离散Token生成、并行的连续回归、基于流匹配的去噪、双系统推理……这些不同的动作解码范式背后,是完全不同的代码实现和接口假设。

- 管线强耦合:现有的许多开源框架都是为单一方法定制的。数据预处理、训练循环、评估协议深度绑定在一起,导致模块无法在不同项目间复用。

- 评测标准不一:各篇论文往往只在互不相交的基准子集上报告结果,且数据预处理和推理协议不够透明,使得公平对比几乎成为不可能的任务。

这种碎片化的现状,严重拖慢了具身基础模型的迭代与验证节奏。

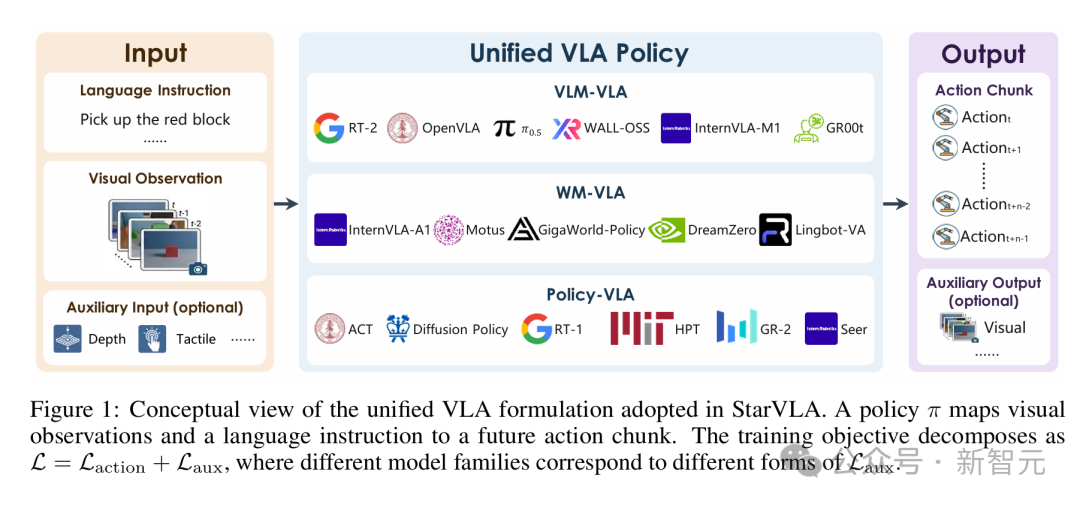

香港科技大学开源的StarVLA项目,其核心洞察在于:基于视觉语言模型和基于世界模型的VLA方法,并非根本对立的两种范式。它们实际上可以被统一视为同一策略框架下,仅辅助学习信号(L_aux)不同的变体。

基于这一理论洞察,团队构建了一个高度模块化、接口统一的开源底座。研究者现在可以像搭乐高积木一样,自由地组合不同的主干网络和动作头,并在完全受控的实验条件下,验证单一设计变量的真实影响。

项目资源:

- 开源地址:

https://github.com/starVLA/starVLA

- 项目主页:

https://starvla.github.io

- 论文链接:

https://arxiv.org/abs/2604.05014

架构解码:以策略为中心的“乐高”抽象

StarVLA在系统层面引入了一个统一的、以策略为中心的数学表述。它将多模态历史观测、语言指令与未来的动作块映射到同一个计算图中:

$π(a_{t:t+k}, y_{aux} | x_{<t}, ℓ)$

其中 $x_{<t}$ 代表多模态历史观测,$ℓ$ 是语言指令,$a_{t:t+k}$ 是模型预测的未来动作块,$y_{aux}$ 则是可选的辅助输出。整个训练目标被统一分解为:

$L = L_{action} + L_{aux}$

- 直接VLA:此时 $L_{aux} = 0$,即纯粹的模仿学习动作监督。

- 基于VLM的VLA:引入语言对齐作为辅助目标,例如子任务规划或空间指代理解。

- 基于世界模型的VLA:引入对未来观测的预测作为辅助目标或隐式先验。

在这一统一抽象之下,StarVLA实现了双向模块化的设计:

- 可插拔的主干网络:支持诸如Qwen3-VL、InternVL等经过指令微调的视觉语言模型,也支持像Cosmos-Predict2这样的世界模型。它们只需经过轻量的适配层,就能接入统一的表示契约。

- 可插拔的动作头:框架内置了四种具有代表性的动作解码器,它们共享完全相同的

forward() 与 predict_action() 接口:

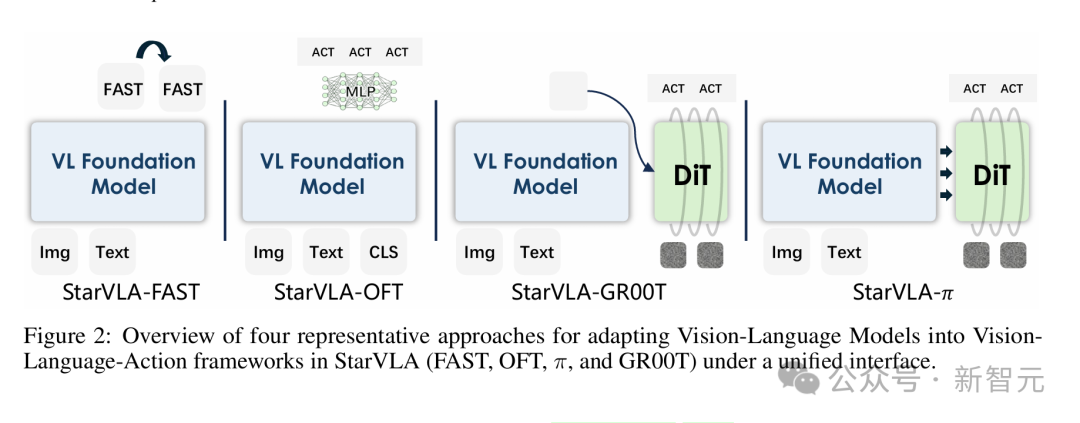

StarVLA-FAST:基于自回归的离散Token生成。StarVLA-OFT:基于轻量级MLP的并行连续回归。StarVLA-π:基于层间交叉DiT模块的流匹配去噪。StarVLA-GR00T:System 2(慢速推理)与 System 1(快速动作)结合的双系统架构。

所有变体都共享同一套数据接口、训练循环和评估管线,研究者只需替换主干网络或动作头即可完成范式的切换。 这从根本上消除了跨方法对比时,那些难以察觉的“隐性变量”所带来的干扰。

训练范式:从单基准微调走向多模态协同

StarVLA将训练策略抽象为一系列与模型架构解耦的、可复用的配置,主要支持以下三种核心范式:

1. 行为克隆与监督微调

项目提供了完整的分布式训练脚本,支持全参数微调与子模块冻结。优化器采用了多参数组独立学习率、bfloat16混合精度与余弦衰减调度器,确保了异构组件在训练过程中的稳定性。

2. 多目标协同训练

单纯的机器人动作微调很容易导致视觉语言模型主干发生“灾难性遗忘”,丢失原有的多模态理解能力。StarVLA内置了一套双数据流协同机制:交替执行VLA的动作前向传播和VLM的语言建模前向传播,并通过 trainer.loss_scale.vlm 参数动态平衡动作学习与多模态表征保留之间的权重。

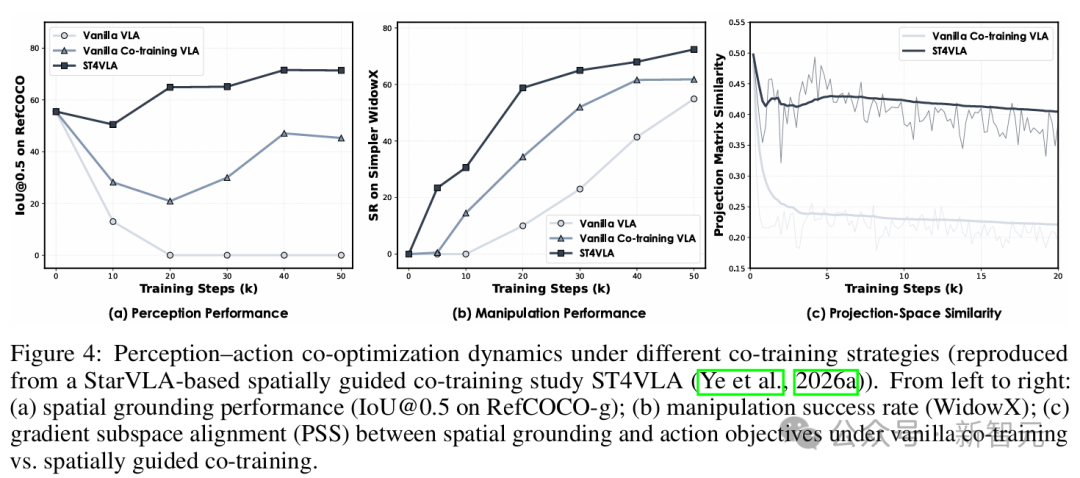

实验表明,这种协同训练策略可以显著提升模型的空间指代理解能力,并在WidowX和Google Robot等测试平台上带来约4%到10%的成功率提升。

3. 跨形态混合训练

通过 LeRobotMixtureDataLoader,用户只需在YAML配置文件中声明任意机器人数据集的组合与采样权重,框架便会自动处理不同机器人之间的动作空间对齐与形态标签追踪。这一设计使得复杂的“跨形态预训练”从需要定制脚本的任务,变成了一个标准化的配置选项。

评测与部署:Server-Client架构打通仿真到现实

为了避免评测基准的依赖污染模型运行环境,StarVLA采用了一套轻量级的WebSocket Server-Client评测抽象:

- 模型侧仅需暴露一个

predict_action() 接口。加载训练好的模型权重后,启动一个策略服务即可。

- 评测侧(如LIBERO、SimplerEnv、RoboTwin 2.0的官方仿真环境)通过独立的Client封装观测字典,以msgpack格式与服务端通信,并接收归一化后的动作指令。

- 真实机器人部署时无需修改任何核心代码:只需将机器人控制器替换为上述Client,并向其提供相同格式的相机观测和语言指令,即可将模型无缝迁移到物理世界。

目前,StarVLA已经集成了7大主流机器人仿真基准,并提供了完整的基准适配器,用于处理动作反归一化、动作块拆分、绝对/相对动作转换等后处理逻辑。

性能与效率:极简配置下的强泛化能力

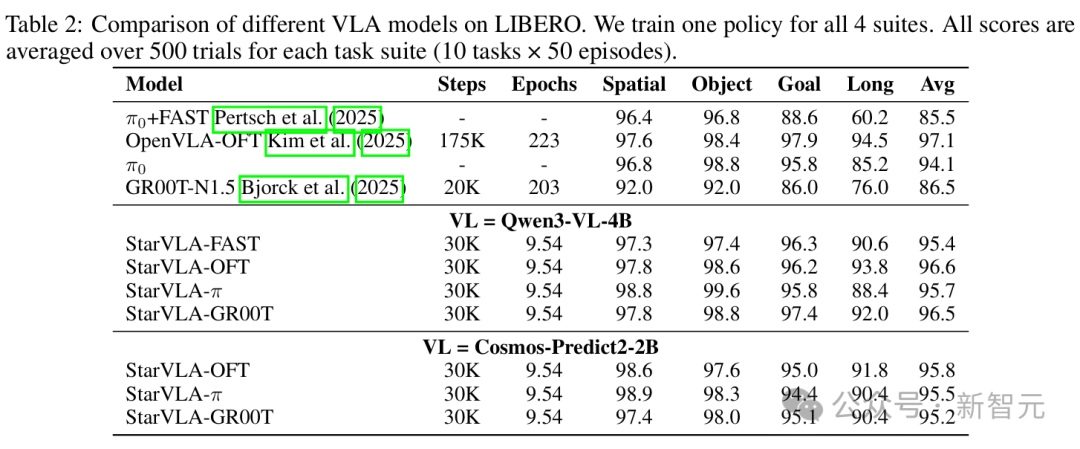

StarVLA有意避免了复杂的数据工程和在线优化算法,仅使用公开的视觉语言模型预训练权重,并在各基准官方提供的演示数据集上进行微调,便达到了极具竞争力的性能水平。

更关键的是,更换主干网络几乎不会导致性能显著下降。例如,将主干从Qwen3-VL-4B替换为Cosmos-Predict2-2B后,在LIBERO基准上的平均成功率依然稳定在95.2%以上,这验证了StarVLA架构本身的泛化与鲁棒性。

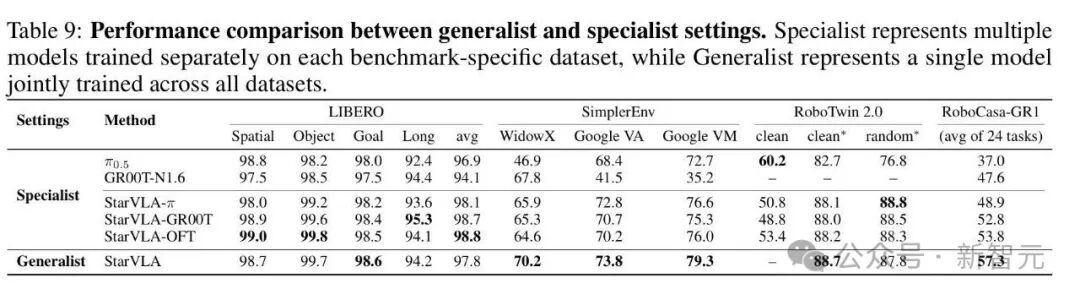

在“通才”模型的测试中,使用单一模型联合训练LIBERO、SimplerEnv、RoboTwin 2.0和RoboCasa-GR1四个数据集。结果显示,在RoboCasa上的平均成功率从“专才”模型最优的48.8%提升到了57.3%,这证明了在统一架构下进行All-in-One联合训练的可行性。

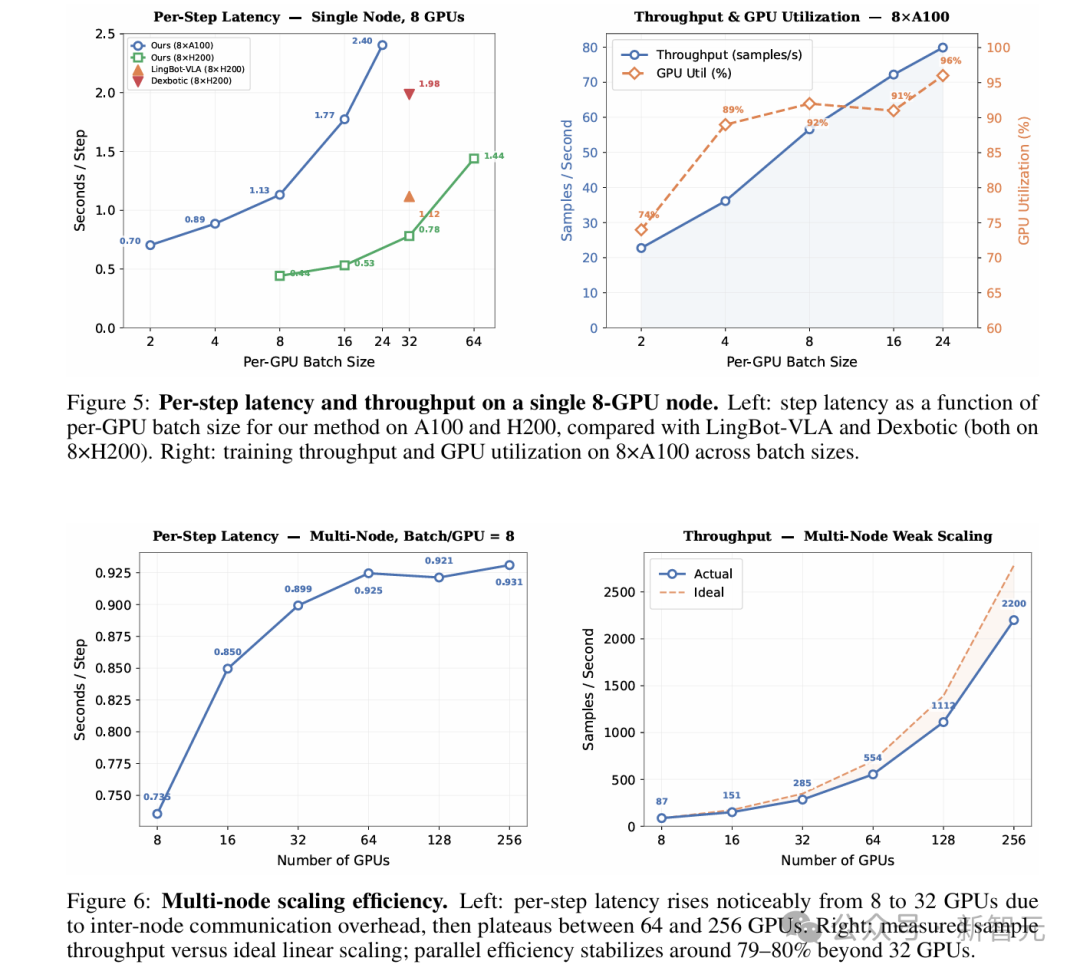

在计算效率方面,8块A100的单节点测试显示,当每GPU批大小为8时,GPU利用率可达92%,样本吞吐量为56.6 samples/s。当扩展到256块GPU的多节点环境时,通信开销仅在从8块GPU扩展到32块GPU时产生一次显著跃升,之后趋于稳定,并行效率维持在79%到80%之间,为大规模分布式训练提供了清晰的扩展指南。

总结与展望

StarVLA的核心价值在于,它为整个具身智能社区提供了一套可复现、可对比、可组合的基础设施标准。它通过工程上的克制——统一的输入输出契约、声明式的YAML配置、服务端与客户端的解耦——以及理论上的深刻洞察(将策略统一视为 $L = L_{action} + L_{aux}$),旨在终结VLA研究的“巴别塔”时代。

- 对研究者而言,它是一个验证新动作头或新主干网络的即插即用沙盒。

- 对工程师而言,它是一个从仿真环境到真实机器人无需修改核心代码的部署底座。

- 对整个社区而言,它是一个能够降低复现门槛、推动标准化评测的公共产品。

随着更多研究者和开发者基于此框架进行创新与验证,我们有望在云栈社区的 开源实战 板块看到更多关于VLA模型架构的深度分析与最佳实践分享,共同推动人工智能在具身智能领域的可靠发展。