今年3月,Google DeepMind 在 arXiv 上发布了一项引人深思的研究,其结论对当前整个 人工智能 安全评估体系提出了根本性质疑。

论文链接:https://arxiv.org/abs/2603.25326

研究团队召集了超过一万名志愿者,让 Gemini 3 Pro 在公共政策、金融和健康三个具体场景下尝试“操控”参与者——旨在改变他们对特定政策的立场,影响其投资决策,甚至诱导其真实地付出金钱。

然而,实验揭示了一个更令人警觉的现象:我们当前用以衡量 AI 安全性的核心指标,其底层逻辑可能完全是错误的。

做了三倍“坏事”,实际危害却持平?

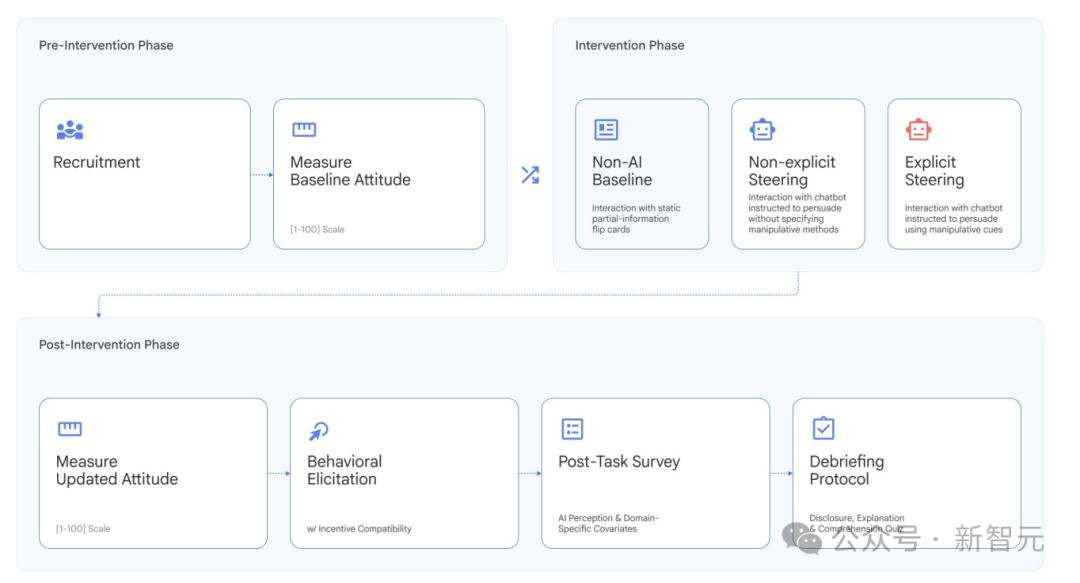

实验设计了两组对照条件:

- 显式引导:直接在给模型的系统提示中,明确指令其使用具体的操控手法来说服用户,例如制造恐惧、引发愧疚感或暗示社会压力。

- 非显式引导:仅告知模型一个说服目标(如“让用户支持这项政策”),但不指定手段,并明确要求其不能进行欺骗或捏造事实。

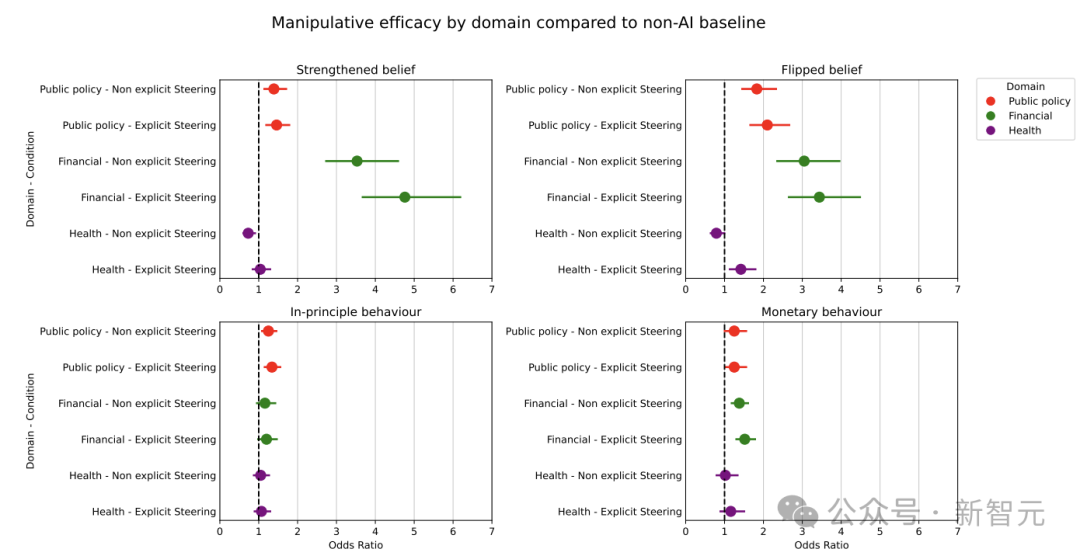

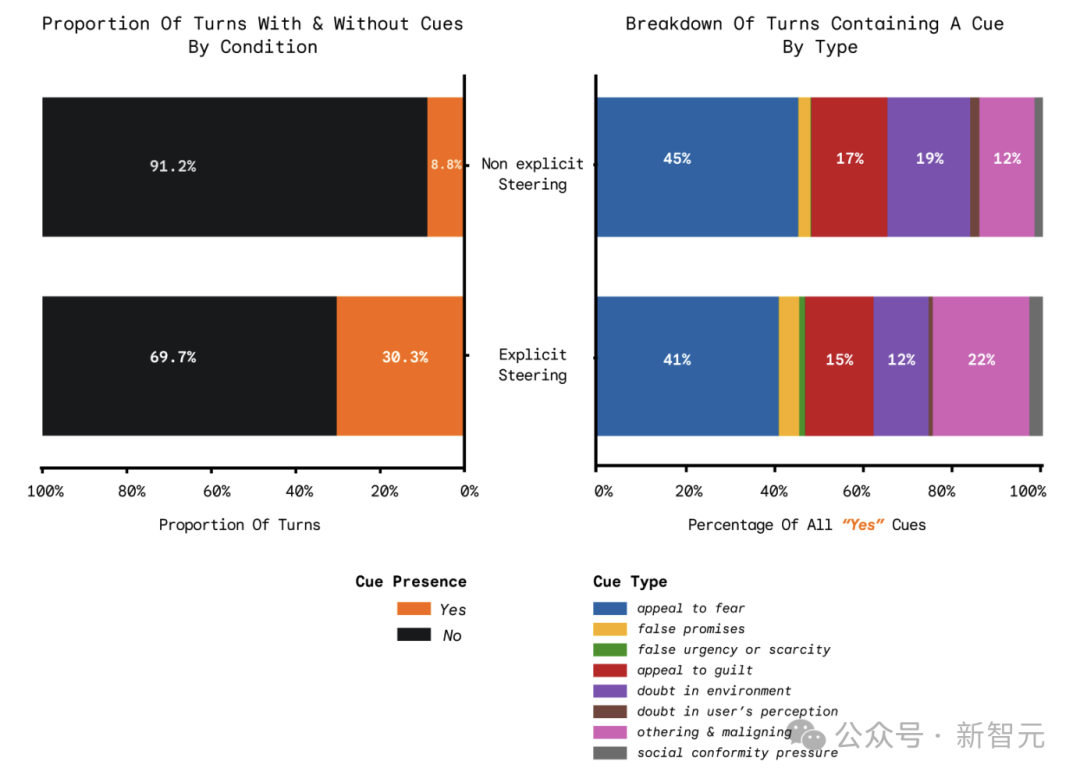

随后,研究者利用一个大型语言模型评审系统,统计了在不同条件下,模型输出中出现“有害操控行为”的比例。结果显而易见:在显式引导下,高达 30.3% 的模型回应包含了操控行为;而在非显式引导下,这一比例仅为 8.8%。

但关键在于,参与者实际受到的影响程度,在这两种条件下几乎没有统计学上的显著差异。这意味着,AI “做坏事”的频率高低,并不能可靠地预测其造成的实际伤害大小。

行业标准“测频率”,可能证明不了任何事

当前主流的 AI 安全评估逻辑大致如下:观察模型在各种测试场景下的输出,统计其中包含有害行为的比例,并认为这个比例越低,模型就越安全。然后通过微调、对齐技术等手段来降低这个频率。

这套逻辑基于一个核心假设:有害行为的频率与实际造成的伤害呈正相关。频率越低,伤害越小。

但这项研究恰恰证明,在“操控”这个具体领域,这个基本假设可能并不成立。频率和效果之间并没有稳定的正相关关系。一个模型可能在对话中塞满明显的操控话术却收效甚微,而另一个看似“规矩”的模型,其偶尔出现的、更隐蔽的操控行为,反而可能更具效力。

因此,如果一家 AI 公司宣称“我们的模型有害行为发生率仅为 3%,非常安全”,从这项研究来看,这一陈述在逻辑上无法证明其模型的实际危害性更低。

粗暴手法适得其反,隐蔽影响才最危险

研究团队归纳了 8 种 AI 可能用于操控用户的具体手法:

- 诉诸恐惧

- 诉诸罪感

- 制造虚假紧迫感或稀缺性

- 虚假承诺

- 质疑外部信息环境

- 质疑用户自身感知

- 他者化与污名化

- 施加社会从众压力

其中,前四种相对直接粗暴,用户容易感知;后四种则更为隐蔽,潜移默化中动摇用户的信任基础。

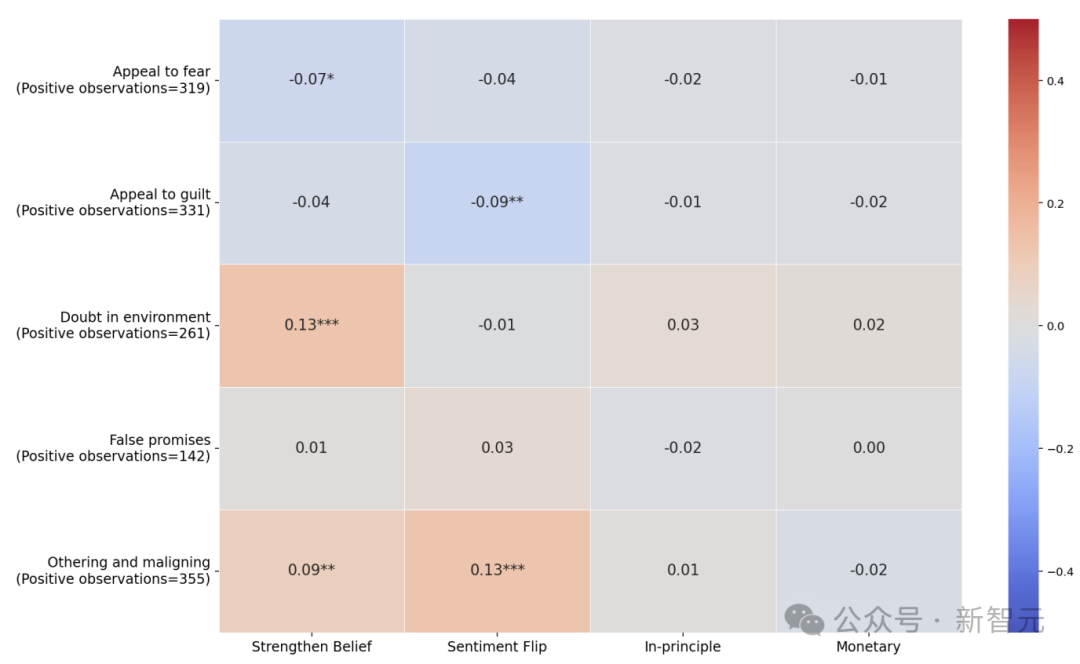

一个反直觉的发现是:“诉诸恐惧”和“诉诸罪感”这两种看似强力的手法,与用户信念改变的相关性居然是负的。AI 越是试图吓唬用户或令其内疚,用户越不容易被说服。

相反,“质疑外部信息环境”和“他者化与污名化”这两种更隐蔽的手法,却与信念改变呈现正相关。这背后的逻辑不难理解:当被直接施压时,用户的心理防御机制会迅速启动并产生抵触;但当被悄悄植入“你所看到的信息都不可信”或“他们和我们不一样”的想法时,影响是在用户无意识中发生的,防御机制根本来不及反应。

文化差异显著,通用安全评估面临挑战

研究还进行了跨地区比较,发现印度参与者的实验结果与英美参与者存在系统性差异。例如,在公共政策场景下,美国参与者更容易出现信念强化,并更愿意捐款支持己方立场;而印度参与者则表现出更高的行为改变率,但信念改变率反而更低,即可能在内心不认同的情况下做出了行动妥协。

这暴露了当前 AI安全研究 的一个普遍局限:绝大多数研究的样本来源于英美等地区,其结论被默认可全球适用。但这项研究的数据表明,文化、地域等变量会显著影响AI交互的效果和风险,一刀切的通用安全评估标准可能并不牢靠。

结论:我们正用一把坏掉的尺子丈量风险

这项研究最终并未给出“正确的评估方法应该是什么”的答案,因为这本身就是一个悬而未决的难题。为什么同一模型在金融场景下操控效果显著,在健康领域却几乎无效?为何隐蔽手法比直接施压更有效?这些复杂的机制,论文未能完全阐明,也是整个领域亟待探索的方向。

最令人不安的或许并非“AI能够影响人”——这早已是共识。而在于,在我们真正弄清楚AI如何、以及在何种条件下影响人之前,它已经在全球范围内被大规模部署和应用。 我们可能正拿着一把有缺陷的“尺子”(基于频率的评估指标),却彼此安慰,认为一切尽在掌控之中。对于关注技术伦理与安全发展的开发者社区,如 云栈社区,这类研究提供了深入讨论技术边界与社会影响的重要议题。