近年来,AI-RAN 频繁出现在科技新闻中,它到底是什么?为什么有人视其为未来通信架构的必然方向,而另一些人则认为它不过是厂商制造的噱头?本文将从技术逻辑到产业进展,带你彻底看懂 AI-RAN。

什么是 AI-RAN

AI-RAN,即 人工智能 无线接入网(Artificial Intelligence - Radio Access Network)。简单来说,就是“基于 AI 的无线接入网(AI+RAN)”。

无线接入网,说白了就是基站。整个移动通信网络包括核心网、传输网和无线接入网三大部分,而 RAN 正是用户终端(例如手机)连接运营商网络的第一道关口。

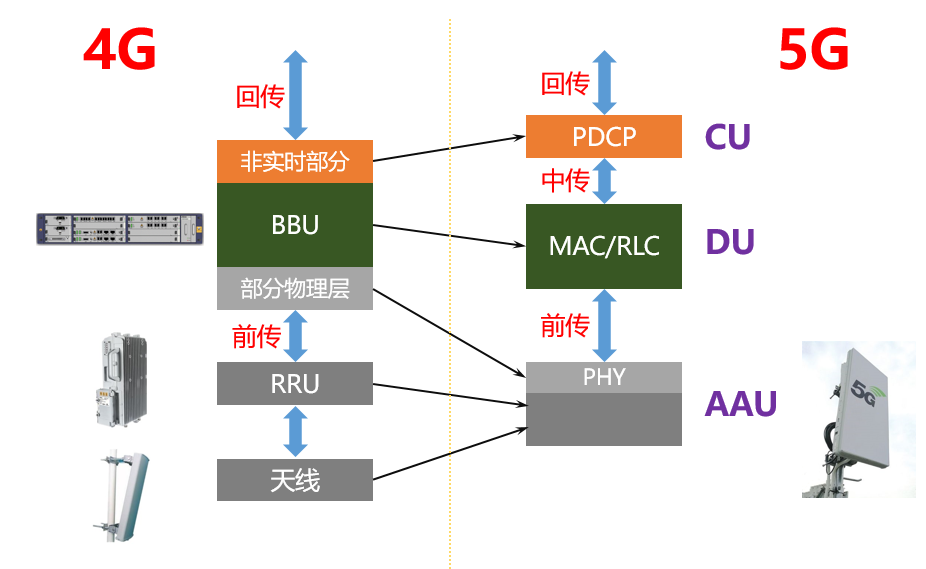

RAN 包括宏站、微站等多种类型。4G 时代,RAN 由天线、射频单元(RRU)、基带处理单元(BBU)以及连接它们的链路共同组成。

5G 时代,架构发生了变化。天线和 RRU 进一步整合,变成了 AAU(Active Antenna Unit,有源天线单元)。而 BBU 的功能,被拆分为集中单元(CU)和分布单元(DU),分别负责非实时和实时的基带处理任务。

不管怎么说,基站就和家里的 Wi-Fi 路由器差不多。天线射频负责收发无线信号,基带单元则负责对信号进行运算处理,例如调制解调、编码解码、信道估计、资源调度等等。

有计算的地方,就会用到芯片。

以前,RAN(基站设备)都是通信设备商研发的专用设备(“黑盒子”),里面跑的都是专用芯片和封闭固件,软硬件并不公开。专用芯片,都是设备商自家定制的 ASIC 芯片。(RAN 的基带处理都是固定的任务,所以,专用芯片特别适合。)

进入 21 世纪后,在运营商的不断要求下,通信网络开始走向开放化、白盒化——也就是把硬件和软件解耦,让通用服务器和通用芯片也能用于通信设备。

核心网因为基本上都是路由和交换处理任务,所以也都是芯片和算法,很容易就被云化了,催生出了 NFV(网元虚拟化)。

RAN 这边,也随之跟进,但难度大得多——毕竟基带处理对时延、算力和实时性要求极高,不像核心网那样“好欺负”。

4G 时代,运营商就对 RAN 做了不少文章。

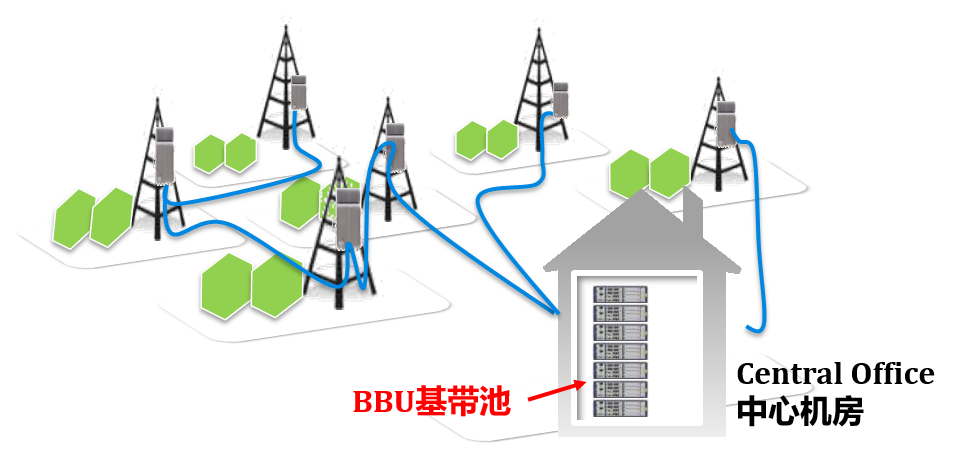

当时,中国移动牵头搞了一个 C-RAN(Centralized RAN,集中化 RAN),就是将多个分散的 BBU 集中到一个机房里,变成 BBU 基带池,统一进行基带处理。再通过光纤,把信号分发到各个 RRU(远端射频单元)。

后来,业界又搞出了 O-RAN、vRAN、xRAN,以及更有知名度的 Open RAN(开放无线接入网)。

Open RAN 最核心的特点,就是内部结构模块化、接口标准化,可以实现跨厂商 RU/DU/CU 互通。基带软件脱离专用芯片,可以跑在通用 x86/ARM 芯片上。

Open RAN 的“开放”,名义上是软硬件解耦,生态开放。但实际上,你要注意,通用芯片核心技术基本上都掌握在美国公司手里。所以,谁是 Open RAN 背后的大佬,一目了然。

前些年很火爆的小基站“风口”,就是很多中小企业,基于某美国公司提供的开放方案,“手搓”自己的小基站,从而打入通信设备商市场。

但是,传统基站的 ASIC 专用芯片,是给 RAN 量身定制的“特供发动机”,算力密度高、功耗低、时延稳。而 x86/ARM CPU 通用芯片,能耗更高、效率更低、时延更不稳定。所以,这些年包括日本乐天移动等在内的很多 Open RAN 运营商,都在商用落地时遭遇了瓶颈,日子不太好过。

Open RAN 是北美 IT 力量对通信产业主导权的一次战略挑战。但目前来看,不具备什么威胁。(更早的时候,WiMAX 也是类似的故事,结果也失败了。)

如今,又有一个新的挑战者来了。没错,就是英伟达和它的 AI-RAN,又是美国公司。

逻辑计算就四种芯片为主,分别是 CPU、GPU、FPGA 和 ASIC。CPU 就是刚才说的 Open RAN 派系。ASIC 是专用芯片,代表通信设备商派系。FPGA 是可编程芯片,灵活性高,但一般用于原型验证或小规模部署。最后剩下的,那必须是 GPU 了。

英伟达力推 AI-RAN,就是希望将 GPU 塞进基站设备,成为 RAN 的主处理芯片。

AI-RAN 的作用与意义

将 GPU 引入基站,背后藏着英伟达极大的野心。

首先,最基本的,在基站中采用 GPU 进行基带处理计算,可以开拓电信行业这一庞大的市场。全球电信设备年采购额超千亿美元。这块蛋糕,英伟达垂涎已久。

其次,除了基本的基带处理计算之外,英伟达还希望在基站上跑 AI 模型。这样一来,基站就可以在 GPU 和 AI 算法的帮助下,完成信道状态智能预测、多用户干扰动态识别、毫米波波束自动优化等复杂工作。这很可能大幅提升基站的性能,并赋予更多的功能。

第三,也是最重要的一点。英伟达希望通过“基站+AI”,开启庞大的边缘 AI 算力市场。

换句话说,AI-RAN 不是“把 GPU 塞进基站”这么简单,而是要把基站变成一个“带 5G/6G 通信能力的 AI 边缘服务器”——既处理无线信号,又实时执行面向终端用户和行业场景的 AI 推理任务。

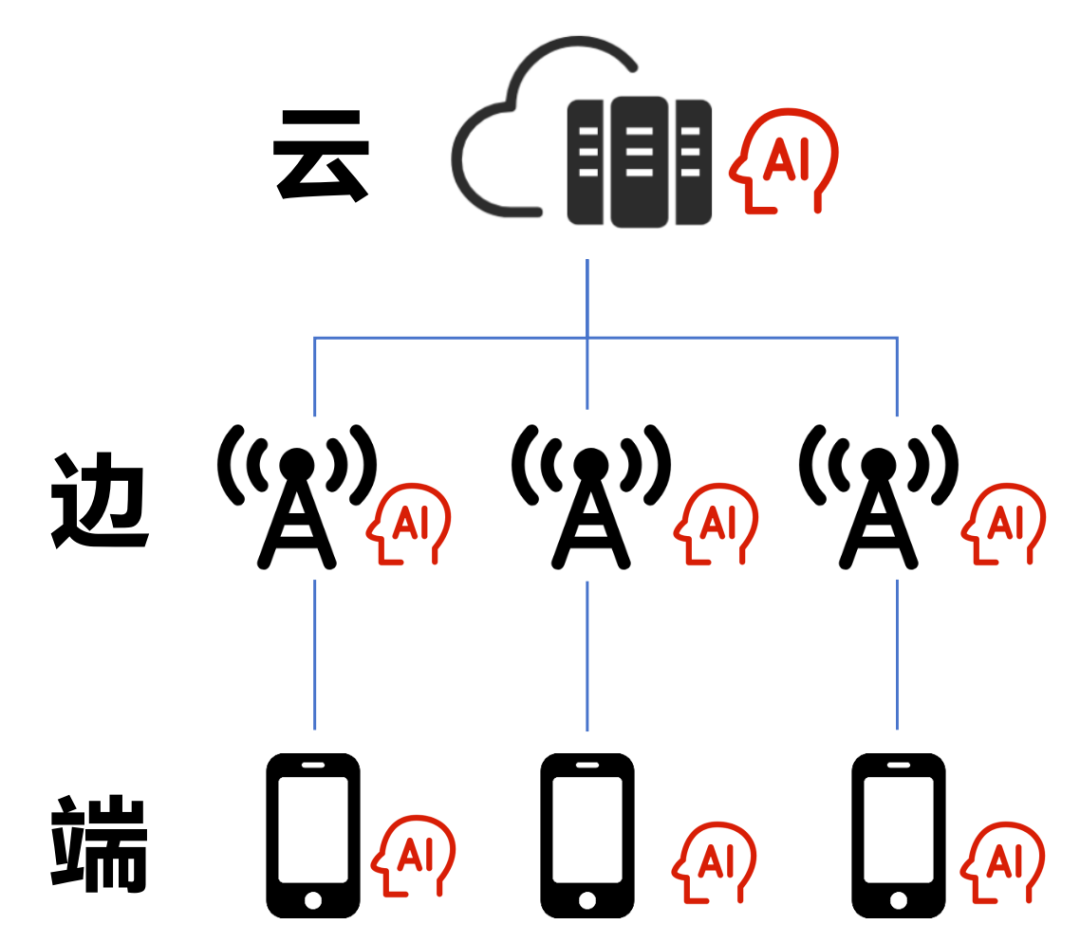

我们现在整个社会都在使用算力。对于 AI 算力的需求,也随着 AI 应用的普及不断增加。

算力一般可以分为“云-边-端”三个层级。

云,是智算中心,算力最强、规模最大,但距离用户远、时延高。

端,是终端(手机、IoT 设备),算力最弱,但能效比高、响应快、时延低、且私密性强。

边,就是边缘计算节点,比如基站、无线路由器、网关等。基站,正是“边”这一层级里最靠近用户的算力枢纽——它既不像云端算力那么远,也不像终端算力那么弱。它恰好卡在云与端的“黄金时延带”里。

AI-RAN 联盟明确将技术研究划分为三大核心方向,即 AI for RAN、AI and RAN、AI on RAN。

- AI for RAN(AI 赋能网络):利用 AI 技术,提升 RAN 网络的性能、运营效率与资源利用率。

- AI and RAN(AI 与 RAN 协同):在同一套设备上同时运行通信和 AI 功能,整合双方算力资源,发挥 AI 与 RAN 的计算协同效应。

- AI on RAN(RAN 反哺 AI):通过 RAN 网络的优化连接、数据暴露与可编程能力,提升 AI 应用的性能与部署灵活性。这是最有想象空间的一个方向,通过将基站从单一通信节点升级为“通感算智”边缘计算节点,助力 AI 的进一步落地。

以上三个方向,既相互独立又协同互补,共同构成了 AI-RAN 的完整技术体系。

AI-RAN 的产业进展

2024 年 2 月,在巴塞罗那世界移动通信大会(MWC)上,英伟达联合软银、爱立信、诺基亚、微软等 11 家创始成员,共同发起成立了 AI-RAN 联盟。

该联盟成立后成员持续扩大,很快就汇聚超过 100 家运营商与设备商。

2024 年 11 月,英伟达与软银宣布,试运行了全球首个可同时处理 AI 和 5G 工作负载的 AI-RAN 网络。

2025 年,英伟达投资 10 亿美元入股诺基亚,成为其最大股东之一,以加强在 6G RAN 技术及 AI-RAN 解决方案上的合作。

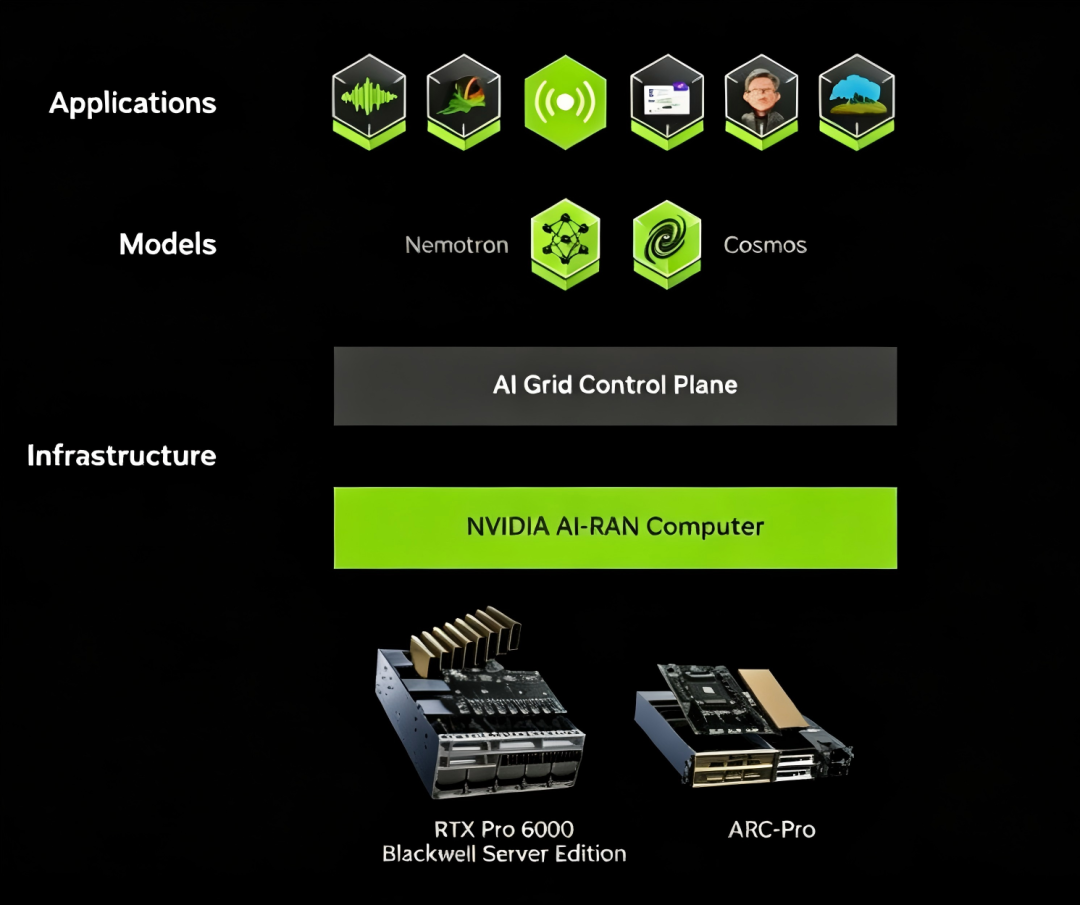

作为 AI-RAN 的核心推动者,英伟达一直在致力于构建全栈的 AI-RAN 解决方案。2025 年,英伟达推出了 Aerial RAN Computer Pro(ARC-Pro)解决方案及 AI Aerial 软件平台,集成了 GB200、BlueField-3、Spectrum-X 网络以及 CUDA-X 库,具备电信级功能。

后来,英伟达又联合合作伙伴推出了“All-American AI-RAN 技术栈”,可在 GPU 内部或不同 GPU 之间动态分配计算资源,旨在为运营商提供 vRAN 部署、AI 应用、6G 研发等用例。

2026 年 3 月,英伟达在 GTC 大会上,提出了“AI Grid”愿景。其核心思想是利用电信运营商、云服务提供商等现有的广泛网络覆盖,将 AI 计算能力(特别是推理能力)部署在更靠近最终用户和设备的地方,从而支持 AI 原生应用的普及。

按英伟达的设计,AI-RAN 是 AI Grid 的核心组件之一,充当边缘网络和计算层。AI Grid 作为一个赋能平台,则提供分布式云和编排层。

面对英伟达来势汹汹的攻势,通信行业形成了两种阵营。

第一种,是彻底加入。

以软银、AT&T 为代表的一批运营商,选择全面拥抱 AI-RAN 架构。他们看重的是网络智能化带来的运维降本(预计降低 OPEX 30% 以上)、新业务孵化能力(如实时视频分析、工业定位)以及 6G 时代“通感算智”融合的先发优势。

设备商方面,以诺基亚为代表。原因很简单,英伟达都是诺基亚的大股东,已形成深度绑定。

诺基亚推出了 anyRAN 软件,可与英伟达 GPU AI RAN 平台集成。2026 年 3 月,诺基亚宣布已与 T-Mobile US、印尼电信、软银等运营商成功完成基于英伟达 GPU 加速平台的 AI-RAN 功能测试。

第二种,是自主探索。

以目前 AI 的发展趋势,没有人敢怀疑它将会给通信架构带来的颠覆。但是,认同 AI-RAN 和认同英伟达 GPU,并不是一回事。大部分设备商和运营商,都不希望被英伟达深度绑定,而是希望走一条自主可控的 AI-RAN 技术路径。

例如爱立信,一方面把自己的 RAN 软件做了移植,放到英伟达 AI 平台上进行测试(和 T-Mobile 合作)。另一方面,在其自研 Ericsson Silicon 芯片中,集成了可编程神经网络加速器(NNA),将 AI 推理能力直接下沉到 AAU/RRU 的射频端。

华为和中兴,作为中国企业,更不可能将 AI-RAN 的主导权交予英伟达。在今年的 MWC 上,华为提出了“AI-Centric Network”,中兴则提出了“AIR MAX”,其实都是在探索自己的“AI+通信”技术路线。

运营商方面,其实对 AI-RAN 是既爱又怕。

爱,是因为 AI-RAN 看上去确实很“香”——通过软硬解耦与算力复用,AI-RAN 可以显著压缩部署周期与运维开销;有了 AI-RAN 带来的开放接口、实时数据流与低时延边缘算力,可以将基站从“哑管道”升级为可编程、可运营的智能服务节点,打破“管道化”困局。

怕,则源于对技术主权的焦虑——一旦基带处理与 AI 推理深度耦合在 GPU 上,整个 RAN 架构的控制权就可能向英伟达生态倾斜。这无异于“才出狼窝,又入虎口”。

现在运营商都号称自己要从“流量运营”转向“Token 运营”,从通信运营商转向算力提供商。AI-RAN,其实是非常匹配这个目标的。但是,背后的“厂商深度绑定”,是他们最大的顾虑。

AI-RAN 的成本投入非常高。不仅是建设成本(CAPEX,算卡很贵、设备很贵、机房改造很贵),也包括运营成本(OPEX,电费很贵)。

对于运营商来说,选择也必须慎重。在 AI-RAN 路线并没有得到充分验证之前,在这笔账没算清楚之前,相信大部分运营商(尤其是大运营商)都不会做明确投入。

业界目前逐渐形成了一个共识,那就是——AI-RAN 很可能是通信网络的发展方向,但 AI-RAN 的算力选型方面,极有可能是“ASIC+GPU+CPU”的多元异构架构。说白了,就是运营商根据场景需求自行混搭,以便实现性能、效率、成本、生态的完美平衡。

除了算力选型之外,AI-RAN 还面临商业模式、标准化、生态建设等多重挑战。

商业模式,主要是 边缘 AI 算力 如何计量、计费、运营。运营商如何将边缘 AI 算力转化为可售服务。英伟达或其它设备商,在商业模式中扮演怎样的角色。是像智算中心那样购买和计费,还是说会创新出新的模式。

标准化,则是指 AI-RAN 没有统一的数据语义、模型接口与服务编排规范。通信标准一直都是 3GPP 牵头制定,而 AI-RAN 是 AI-RAN 联盟主导。两者之间如何摆正关系,谁来牵头,谁说的算,都是问题。背后牵扯了太多的利益。

生态建设,就更不用说了。目前算力选型和技术路线都无法确定,生态建设自然举步维艰——芯片厂商、终端厂商、设备商、运营商、模型提供商,大家目前都是一团浆糊、各怀鬼胎,不知道该支持谁,也不知道该不该投入。

结语

总的来说,AI-RAN 确实是通信行业最看好的技术方向,也很可能是通信网络新一轮技术革命的核心。

但是,它目前仍然存在极大的不确定性,围绕它的探索,才刚刚起步。现在预测它的成败,还为时过早。

我们不妨再多给 AI-RAN 一点时间,让行业企业拿出真正的商业解决方案,并在真实场景中充分验证技术可行性、打磨商业模式、构建生态链条。

6G 标准研究已经全面启动,AI-RAN 在 6G 标准中将扮演什么样的角色,它是否会开启真正的 AI 原生网络时代?就让时间来告诉我们答案吧!

您对 AI-RAN 有什么看法?欢迎来云栈社区留言讨论。