推理速度提升约400%、时延降低60%、成本下降80%。

智东西4月24日报道,阶跃星辰今日正式发布其新一代自动语音识别模型——StepAudio 2.5 ASR。

该模型专为语音转写与长音频处理而生。架构上,它引入了 Multi-Token Prediction(多Token预测)技术用以提升推理效率,同时通过扩展上下文窗口来强化对长内容的识别能力。

官方数据显示,其推理速度提升约400%,时延降低了60%,推理峰值可达500tokens/s,成本则下降了80%,并且在一系列公开测试集中,它的错误率都维持在较低的水平。

在精度方面,阶跃星辰称StepAudio 2.5 ASR已在多项主流评测基准上达到业内领先水平;在效率上,一段5分钟左右的音视频内容可在极短时间内完成转写,它还支持最长30分钟音频的一次性完整转写。

至于定价,StepAudio 2.5 ASR为每小时0.15元,仅仅是上一代产品Step ASR 2的十分之一。不过在我们实际的测试中发现,该模型在面对不同的音频输入源时,表现存在差异:部分上传的音频文件未能成功识别,但在实时录音场景下表现则相对稳定,整体转写的准确度也比较高。

不同模式下的语音识别效果差异

在官方的演示场景中,面对大段连续的口述内容,StepAudio 2.5 ASR能实现长时间、连贯的文本输出,在识别过程中保持了文本还原的稳定和语义的完整,长音频的转写质量表现均衡。与此同时,模型展现出更强的复杂语境适配能力。无论是日常高频出现的中英文混杂表达,还是发音紧凑、咬字复杂的绕口令句式,它都能稳定地完成精准识别与完整转写,抗干扰能力与语言包容性均有进一步提升。

我们也依托阶跃星辰的在线体验平台进行了实测,选取了一段张雪峰的高考志愿填报课程录音作为测试素材,旨在检验该模型在长音频场景下的真实识别能力。

该功能模式主要面向会议纪要整理、采访录音转写、课程内容归档、语音备忘提取以及客服录音质检等场景,支持 WAV、MP3、OGG、PCM 等主流音频格式,单文件大小限制在20MB以内,同时支持中文、英文以及中英混合的识别。

但奇怪的是,在多次上传该音频文件后,系统均提示未检测到清晰语音,没能完成有效转写,具体原因尚不明确。

接着,我们改用现场的录音功能进行测试。该模式主要服务于快速语音备忘、现场会议纪要、口述转写及语音笔记等需求,同样支持中文、英文及中英混合识别,单次录音时长上限为2分钟。识别结果如下:

在这个场景下,模型能够正常完成识别,整体的转写结果也相当准确,对口语化内容的还原度很高。在细节上,当说话人出现较长停顿时,模型会自动插入额外的逗号;同时,算法也完整保留了日常口语中自然的重复、口头复述等表达特征,原汁原味地还原了原始说话的语言状态。

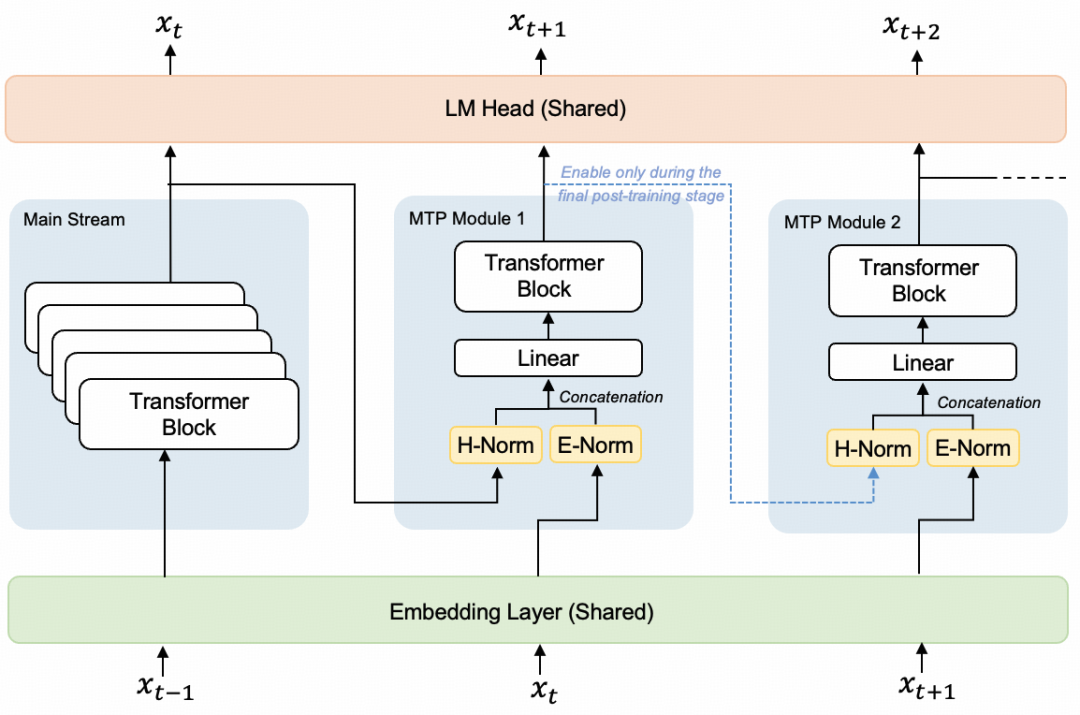

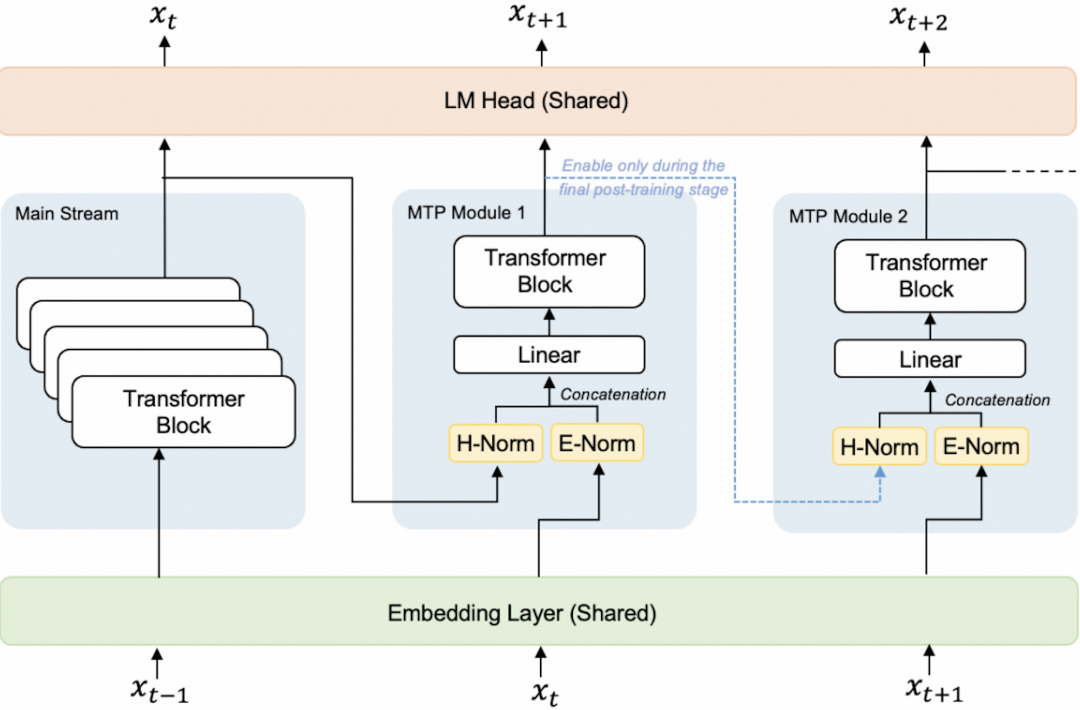

Multi-Token Prediction 优化推理效率

StepAudio 2.5 ASR 创新性地将 Multi-Token Prediction 技术引入语音识别领域,它沿用了与 Step 3.5 Flash 同款的技术方案,依托 Audio Encoder + Linear Adapter + LLM + MTP-5 的融合架构,打破了传统模型串行输出的限制。这种设计使得模型能够单次预判多组候选Token,并配合并行验证机制快速输出识别结果,从底层架构上优化了推理效率。

官方的实测数据表明,相较于传统的识别方案,该模型推理速度提升了400%,整体时延压缩了60%,推理运行成本下降了80%,峰值推理速率可达 500 tokens/s,极大地提升了音视频转写的实时性与性价比。在推理效率方面,阶跃星辰官方数据显示,StepAudio 2.5 ASR 的表现优于 Qwen3 ASR(1.7B)、FunASR-Nano 以及 Doubao-ASR-2603。

长音频处理一直是语音识别领域的一个老大难问题。当前的主流方案通常采用音频切片、分段识别再后期拼接的处理模式,但切割后的片段相对独立,极易造成上下文信息的割裂,在长内容识别时容易出现语义断层、信息遗忘等问题。对此,StepAudio 2.5 ASR 复用了 LLM 原生的 32K 上下文窗口能力,支持端到端一次性处理最长30分钟的连续音频,无需分段切割,全程保留完整的上下文关联,从而保障了长时段对话、会议、访谈等场景的识别连贯性。

在识别精度层面,该模型在多组权威的公开数据集上表现稳健。在 LibriSpeech clean/other 等五组主流的英文开源测试集中,其词错误率优于同期的同类模型,能以更低的算力消耗实现更高质量的转写效果。针对长达30分钟的满负荷长音频所开展的专项测试也显示,模型的识别精度始终维持在顶尖水平,并未出现长文本识别中常见的精度逐级衰减问题,长时序内容识别的稳定性显著提升。

结语:关键指标提升,真实场景仍是考场

整体来看,StepAudio 2.5 ASR 的改进方向非常明确,主要集中于推理效率与长上下文建模能力,而这两点恰恰是当前衡量语音识别系统性能的关键指标。但我们的实测情况也表明,它仍需在不同音频输入条件下进一步提升其稳定性。尤其是在面对复杂或非标准的音频时,其适配能力还有待更多真实应用场景和第三方评测的进一步验证。这或许也说明,在 人工智能 的赛道上,从纸面参数领先到实际体验出色,还有很长的路要走。