XBridge 不训练 LLM,就将低资源甚至未见语言的理解与生成能力提升到接近组合 NMT 模型的水平,大幅缩小了高、低资源语言之间的性能差距,同时维持甚至拔高了高资源语言的表现。

近几年,大语言模型(LLM)在通用问答和复杂推理上屡创佳绩,可一碰到多语言场景就跛脚了:英语等高资源语言处理得行云流水,低资源与未见语言却频频出错,甚至完全无法理解。表面看是训练数据不足,根子却在于表示空间的不匹配。已有研究指出,LLM 其实早已编码了丰富的跨语言知识,只是在处理多语言时总会途经一个以英文为中心的语义空间。因此,LLM 的多语言瓶颈并非缺乏知识,而是难以把已有知识精准映射到多语言表示空间。

另一边,多语言神经机器翻译(NMT)模型却天生擅长跨语言表示。它们通过 encoder-decoder 架构建构起统一的跨语言语义空间,能在上百种语言间实现稳定的语义转换。这引出一个自然的想法:何不将 LLM 的知识处理能力和 NMT 的多语言能力组合起来,取长补短?

沿着这个思路,中国科学院计算技术研究所 NLP 团队提出了一种新的多语言扩展范式 —— XBridge。它把 LLM 以英文为中心的通用能力,与现有多语言 NMT 模型的理解生成能力拼接,实现优势互补,组合成一个多语言通用模型。说白了,就是把多语言理解与生成卸载给外部 NMT 模型,让 LLM 专心做以英文为中心的通用知识处理。

该成果已被 ACL 2026 主会接收。

XBridge:模型组合的多语言扩展方案

XBridge 的核心理念,是将多语言能力完全卸载给 NMT 模型,同时保持 LLM 作为知识处理和推理的中枢。

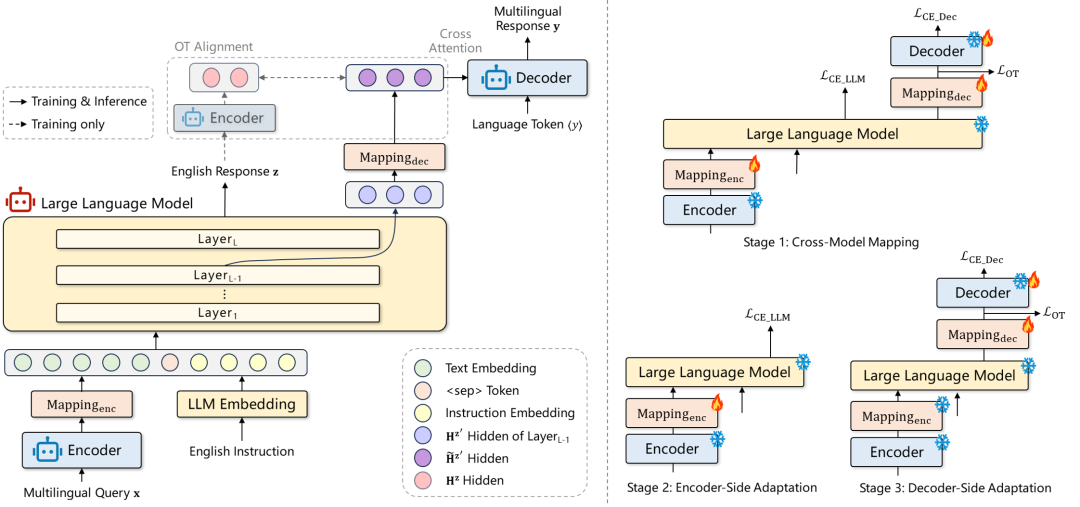

1. 模型架构

XBridge 采用 encoder-LLM-decoder 三段式结构,各模块之间用轻量的 MLP 映射层连接:

- NMT encoder:将多语言输入映射到共享语义空间。

- LLM:以英文为中心的知识处理与推理核心。

- NMT decoder:生成目标语言输出。

直观地看,多语言输入先被 encoder 编码成共享语义表示,再由 LLM 进行知识处理和推理,最后 decoder 将其映射到目标语言,形成完整的“理解 - 处理 - 生成”闭环。

2. 最优运输对齐

不同模型的表示空间天然存在差距,尤其在 token 粒度上严重错位,单纯靠 MLP 做跨模型表示映射很难保持语义一致。为此,团队引入了最优运输(Optimal Transport, OT)对齐目标,自适应地学习 token 粒度的软匹配,从而在异构表示空间之间建立细粒度的语义对齐,实现稳定的语义转换和高质量多语言生成。

3. 三阶段训练策略

为了在不同模型之间建立稳定对齐,XBridge 设计了三阶段训练流程,全程不训练 LLM:

- 跨模型对齐阶段:学习 encoder-LLM-decoder 之间的基础语义映射。

- 编码器适配阶段:让 LLM 学会利用 encoder 表示完成下游任务。

- 解码器适配阶段:进一步提升 decoder 的多语言生成质量。

这种分阶段的训练能有效避免不同优化目标间的冲突,让模型逐步建立起稳健的跨模型映射,并顺畅适配下游任务。

实验结果:不训练 LLM 就能实现高质量未见语言问答

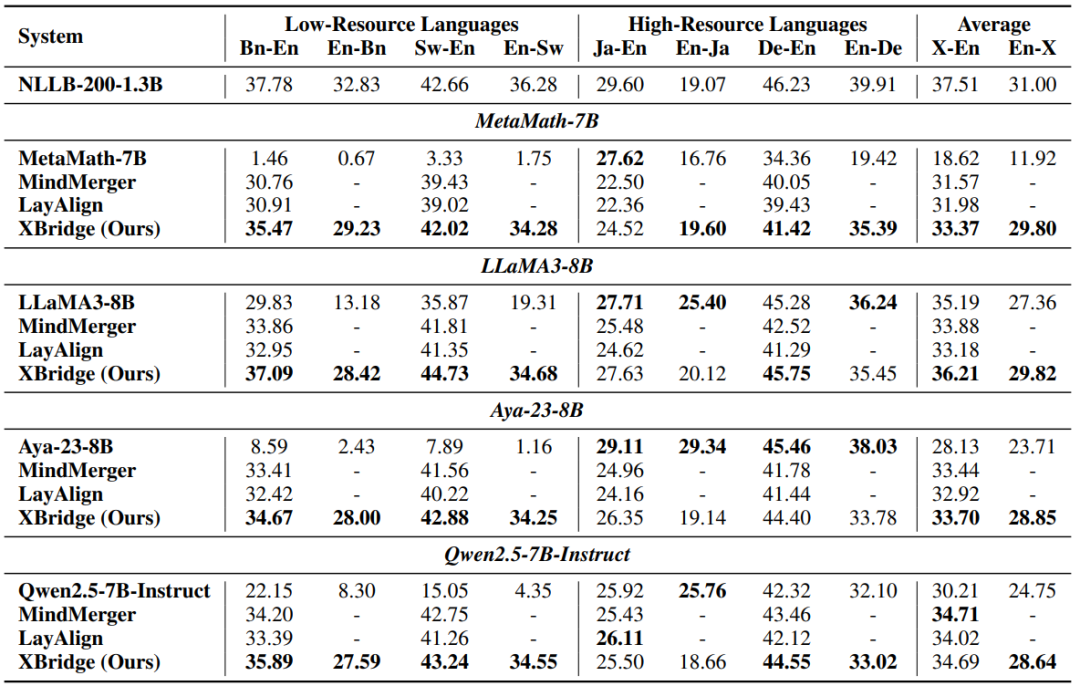

1. 多语言能力成功卸载到 NMT 模型

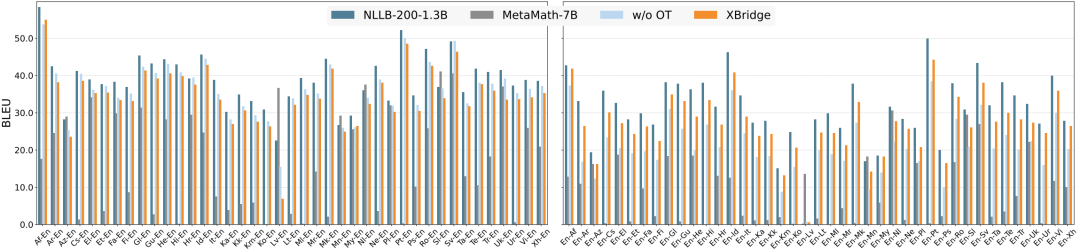

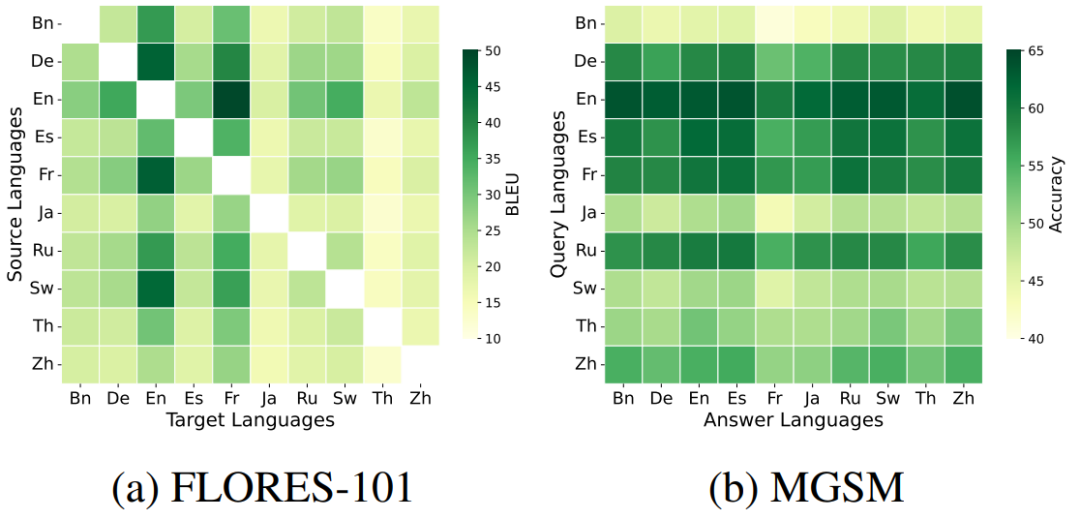

在 FLORES-101 翻译任务上,XBridge 显著提升了 LLM 在低资源语言及未见语言(如孟加拉语、斯瓦西里语)上的理解与生成能力,性能接近甚至超越外部 NMT 模型。这表明 LLM 的多语言能力确实可以卸载到外部 NMT 模型中。

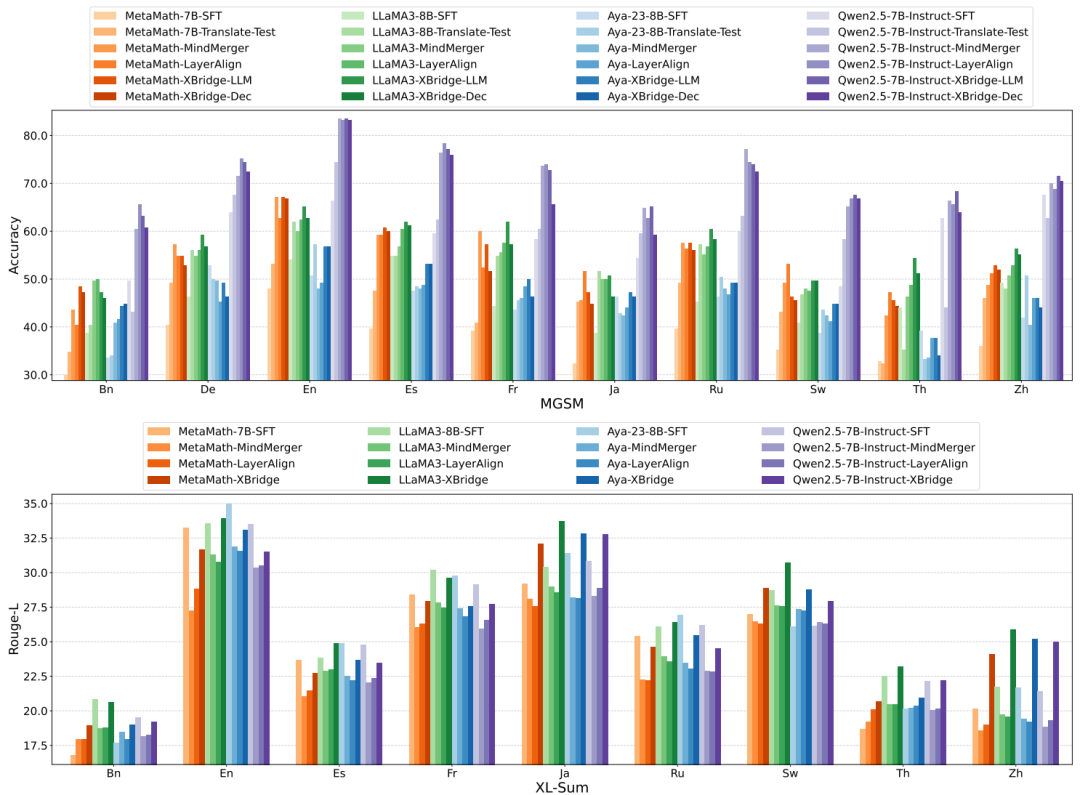

2. 下游任务显著提升

在多语言数学推理(MGSM)和摘要生成(XL-Sum)任务中,XBridge 在低资源语言上带来大幅提升,明显缩小了高、低资源语言间的性能差距,同时高资源语言的性能持平或略有提升。而且这一切都不需要训练 LLM。

3. 可泛化、语言无关的跨模型映射

XBridge 在未参与训练的语言上仍展现出良好的泛化能力,性能甚至逼近外部 NMT 模型,说明它学到的是语言无关的跨模型映射。此外,OT 对齐对多语言生成泛化至关重要。

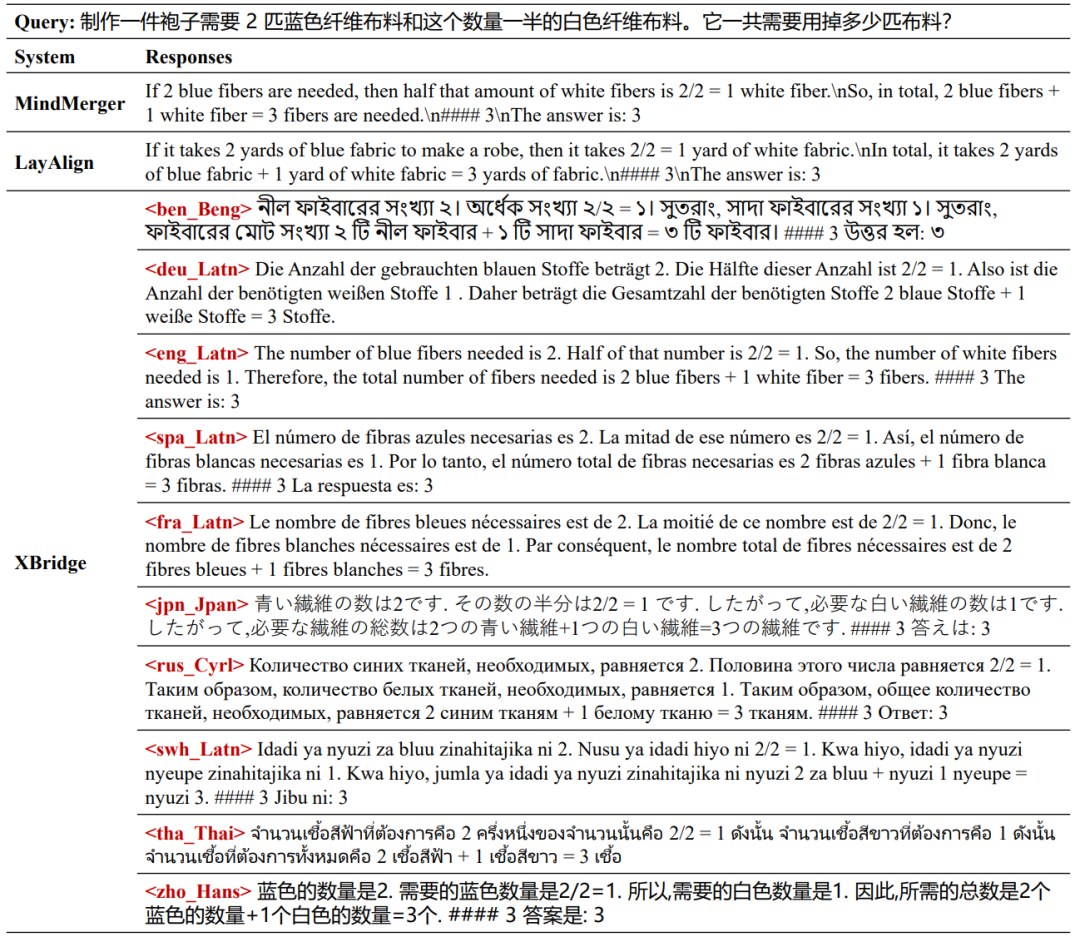

4. 可控语言生成与无损语言切换

通过控制输入 decoder 的语言标签,XBridge 可以灵活指定输出语言,在任意语言对之间进行跨语言生成,并且切换过程完全没有性能损失。

以下是一个语言切换的示例。

5. 系统演示

团队借助一阶段的泛化能力,在 50 种语言的通用指令遵循数据上直接训练 XBridge。演示效果清晰展现了多语言问答能力和顺畅的语言切换。

总结与展望

XBridge 在不训练 LLM 的前提下,将多语言能力卸载给 NMT,从而实现了对低资源与未见语言的高质量支持。其更大的意义在于,它为 LLM 的多语言扩展打开了一条新思路:扩展 LLM 的多语言能力,或许不必再死磕大规模、高质量、多任务的多语言训练数据。通过组合现有模型,就能实现低成本的扩展。