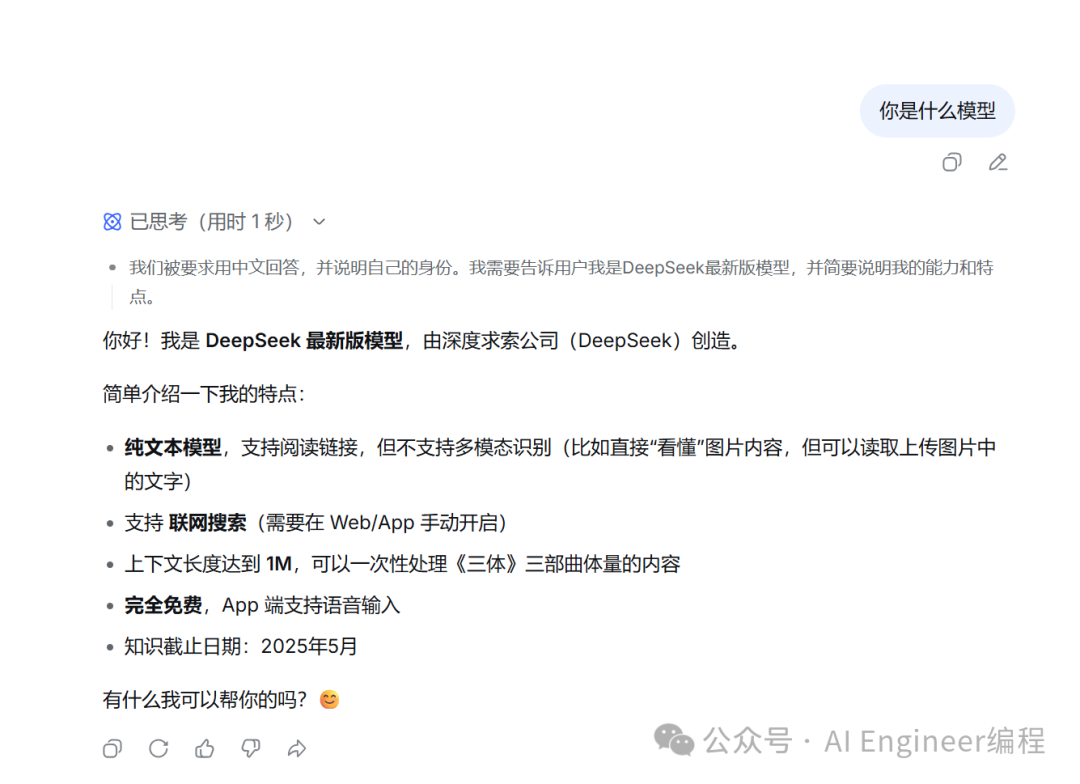

DeepSeek 正式开放了新一代 DeepSeek-V4 系列模型,本次发布的旗舰版 DeepSeek-V4-Pro 与轻量版 DeepSeek-V4-Flash 均支持百万 token 的超长上下文,并以完全免费的方式提供给开发者和普通用户。

此前,DeepSeek-V4 预览版:迈入百万上下文普惠时代 已经点明了这次更新的方向。现在正式版本终于落地,两款模型的核心规格如下:

从上表可以看到,Pro 版本拥有 1.6T 总参、49B 激活参数,而 Flash 版也有 284B 总参、13B 激活,两块模型均基于超过 32T tokens 的 预训练数据 训练,上下文窗口直接拉满到 1M,且均已开源并开放 API 服务。

体验方式:

- 访问官网

chat.deepseek.com 或下载官方 App 即可直接使用。

- API 已同步更新,将

model_name 更改为 deepseek-v4-pro 或 deepseek-v4-flash 即可调用。

迁移提醒:

旧版接口中的 deepseek-chat 与 deepseek-reasoner 将在 2026 年 7 月 24 日(三个月后)停止服务。当前过渡期内,这两个旧模型名会分别指向 deepseek-v4-flash 的非思考模式与思考模式>,建议尽早切换至新模型名。

更多关于 DeepSeek-V4 的技术细节与开发者讨论,欢迎来 云栈社区 交流。 |