“不诱于誉,不恐于诽,率道而行,端然正己”——DeepSeek在长达58页的技术报告文末,以《荀子》中的这句话,为其历时十五个月的V4研发周期定调。这既是对外界长期猜测与期待的回应,更是对中国AI产业坚持技术本位、拒绝浮躁喧嚣的“长期主义”路线的宣告。

跳票三次后终于登场的V4

从2025年底到2026年2月、3月、4月初,DeepSeek V4的发布窗口一连推迟了三次。市场预期的节奏——春节前后、2月中旬、3月初一次次落空,换来的只有永不停歇的连环追问:“V4今天发了吗?”整个AI行业在同期保持着极高频率的新陈代谢:全球主流厂商基本维持1-2个月一次迭代甚至“月更”,而DeepSeek在此期间却显得异常“安静”。

延期并非单纯因为模型性能不到位——真相藏在其背后的一次系统性迁移:从英伟达CUDA生态全面转向华为CANN框架,完成训练与推理全链条的国产化适配。从2025年初开始,外部环境的政策压力、业内人士对国产化路线的期待,以及黄仁勋口中“如果中国团队用非美国芯片做出同等水平的模型,对美国AI生态将是结构性威胁”的判断,都构成了一条不容回避的压力传导线。

与此同时,核心成员相继外流、万亿级参数模型的算力支出规模跃升至十亿美元级别,以及行业竞争全面升格,都被外界看作DeepSeek V4跳票的原因。

破局,V4带来了什么

经历了大半年的等待与三次跳票,DeepSeek V4在无声无息中上线了,却比任何一场高调发布都更具轰动效应。

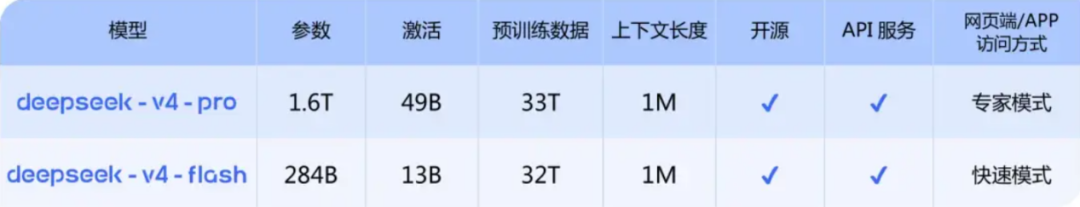

V4系列一口气推出了两款双剑合璧的模型:旗舰版V4-Pro与轻量版V4-Flash。Pro版本以1.6万亿的总参数量(激活490亿参数)对标GPT-5、Gemini等顶级闭源模型;Flash版本则以2840亿参数(激活130亿参数)主打性价比,两者均采用混合专家(MoE)架构。

更令人印象深刻的是,百万token的超长上下文不再是需要单独付费的“特权”,而是全系标配的基础能力。按照约75万汉字/百万token的标准换算,V4相当于可以一次性消化整部《三国演义》。

除了记忆能力的大幅提升,V4在动手干活这件事上也实现了质的飞跃。过去的AI更像一位学识渊博的讲解员:你问它问题,它能给你答案,但真正的事情还得你自己去做。

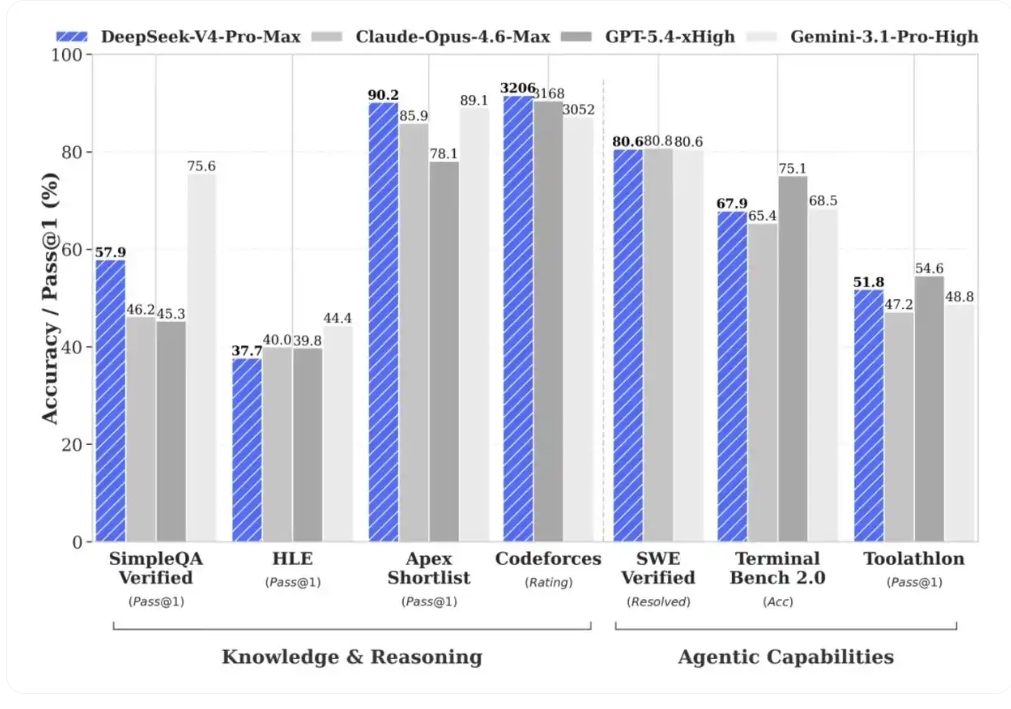

V4的Agent能力相当于让这位讲解员长出了手和脚,它不仅能出主意,还能直接操作你的电脑环境(在安全的测试区里),帮你创建文件、写入代码、运行测试、修复错误,最后把能直接使用的成品交到你手上。这种能力的跃升可以用一个实测数据来佐证:在著名的编程竞赛平台Codeforces上,V4-Pro拿到了3206分,在全球人类程序员中排名第23位,超过了绝大多数专业选手。

DeepSeek自己的工程师也承认,在日常开发中已经把它当成了主力编程助手,写代码的效率比之前用的Claude 4.5还要高。你可以这样理解——以前的AI是个只会出谋划策的参谋,而V4变成了参谋加施工队的合体,你跟它说“帮我做个能记账的小程序”,它不再只扔给你一堆代码,而是会一步步把成品做好端到你面前。

这一切变化的背后,还有一个更底层的故事:成本被大幅压缩了。由于V4采用了全新的注意力架构,处理长文本时消耗的算力只有前代产品的27%(Pro版)甚至10%(Flash版)。这就像原本跑一百公里要烧三十升油,现在只需要烧三升。

省下来的油钱直接体现在了API定价上:Flash版读一百万个Token的输入,在缓存命中的情况下最低只要两毛钱人民币,输出部分也只需两块钱;Pro版输入十二块,输出二十四块。而就在同一天发布的GPT-5.5,读同样多的内容要花三十到一百八十美元,换算下来是两百到一千三百元人民币。正是这种极致的成本控制,让V4的破局不再停留于跑分高低,而是真正落到了“谁用得起、谁用得上”的日常场景里。

坦承性能不如GPT-5.4

DeepSeek每一次迭代,性能都是市场关注的焦点,尤其是V4和OpenAI GPT-5.5同一天发布,更让科技粉们好奇中外两大AI大模型在性能上的差异。然而,有意思的是,DeepSeek主动选择了对差距画出一条界线:V4在技术报告中直白承认,其能力水平仍落后于GPT-5.4与Gemini-3.1-Pro,滞后前沿闭源模型3至6个月。

抛开行业惯用的溢美之词,DeepSeek不仅在测评图表中主动留出对比差距,同时指出了预采样对比策略之外的方向:当OpenAI聚焦天花板定位而提高定价时(GPT-5.5输出定价每百万token30美元,Pro版高达180美元),V4以更低的成本、一整套系统级开源架构,以及对长文本与Agent工作流的实质性深耕,走出了自己的务实路径。

账单解读:百倍价差的底气从何而来

2026年4月24日,DeepSeek在沉默15个月后,携V4预览版与OpenAI GPT-5.5同日发布。这不仅是技术对决,更是效率与生态路径的对决。V4以1.6万亿参数MoE架构、百万Token原生上下文、推理成本降至前代27% 的三重突破,将长上下文从“技术可行”推入“经济普惠”时代。

DeepSeek V4采用双版本策略,精准卡位不同市场需求。从最直观的API调用成本来看,DeepSeek V4对比GPT-5.5的使用成本可谓“极低”。

有意思的是,在OpenRouter平台上综合评估,DeepSeek V4-Flash每百万token的平均输出价低至0.279美元,仅为GPT-5.5 Pro的1.55‰。按输入输出综合成本估算,GPT-5.5 Pro实际使用成本约为V4的32倍。这种人工智能模型的成本颠覆,甚至让“价格战”这个词都显得过于温和了。

什么叫颠覆?不是把对手价格打对折,而是直接打到对方的零头,还顺手把零头再切下去一大截。

当然,V4的激进定价并非一日之功。回看DeepSeek历次“价格战”,会发现这是一条经过精心设计的、陡峭的成本下降曲线。最早引发行业地震的是2024年5月的V2——训练成本仅为GPT-4 Turbo的七十分之一,却以输入1元、输出2元的API定价,直接掀起了国内大模型价格战。此后V3、R1每一代都将成本再压一个量级,到2026年4月的V4,更是把百万token的长上下文推理成本打到前代的三成以下。

四代产品,每一代都在向下打一个数量级。就连OpenAI首席执行官奥尔特曼也承认,AI的使用成本每12个月下降至1/10,“比摩尔定律还强劲”。而DeepSeek自研的混合注意力架构(DSA稀疏注意力+CSA/HCA混合机制),正是驱动这条指数级成本曲线下探的技术“引擎”,其核心思路是对文本按关联程度差异化处理——不重要的内容跳过,核心信息精读,实现算力和显存的双重节省。

价格背后的成本账

V4的成本优势不只是“算法优化”这么简单,它背后有一整套国产算力生态的支撑。而在本轮定价中,最值得关注的信号来自一行“小字注释”:“受限于高端算力,目前Pro的服务吞吐十分有限,预计下半年昇腾950超节点批量上市,Pro的价格会大幅下调。”

这行字蕴含的信息量极其丰富。它意味着:第一,DeepSeek V4-Pro当前的价格远不是“成本价”,未来还有下探空间;第二,DeepSeek与华为昇腾的技术绑定,已经推进到了“芯模联动”的深水区。

更为重要的是,DeepSeek-V4发布当天,华为昇腾、寒武纪、海光信息等国产AI芯片厂商实现了“Day 0适配”:全栈兼容、性能优化和稳定性验证在发布当天全部完成,实现“开箱即用”。这一能力此前仅有英伟达能够实现。

同时,华为官方宣布昇腾超节点全系列产品已全面支持DeepSeek V4系列模型。在DeepSeek V4的技术报告中,华为昇腾NPU与英伟达GPU被首次并列写入硬件验证清单——细粒度专家并行方案在两个平台上同时完成了验证。

黄仁勋在一个播客中直言,DeepSeek在昇腾上跑通这件事是“灾难性的”:英伟达的护城河从来不只是GPU算力本身,而是CUDA作为默认起点的软件生态。如今,中国的芯片厂商已经集体跨越了这道护城河。

国产大模型新标杆

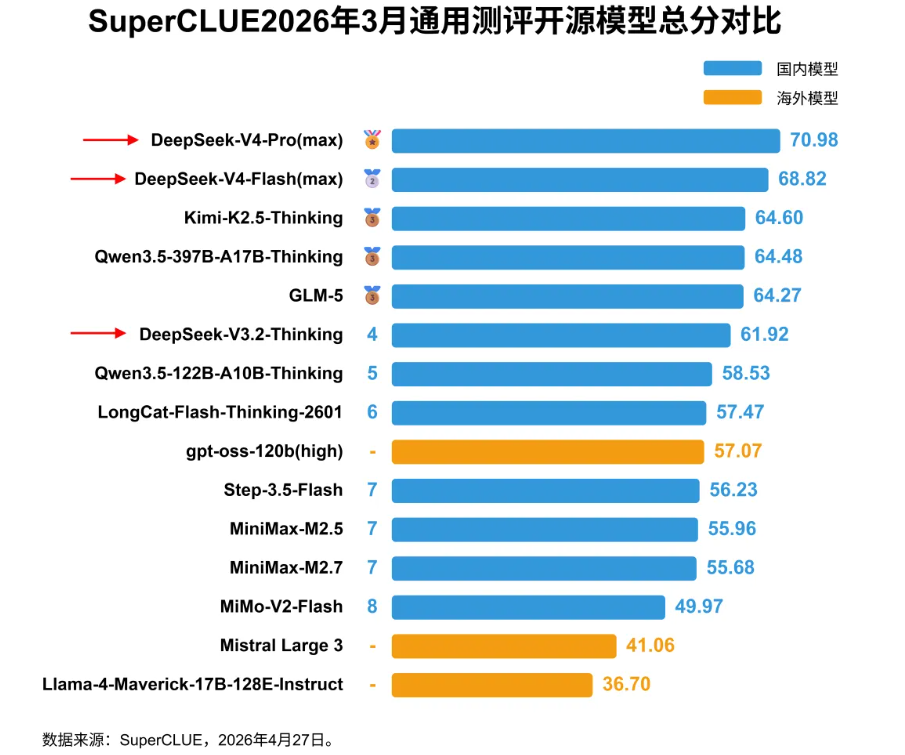

虽然V4在技术报告中直白承认,其能力水平仍落后于GPT-5.4与Gemini-3.1-Pro,但其作为国产大模型的明星产品,在一众中文大模型中的性能表现依旧是大众关注的焦点。而就在4月28日,SuperCLUE团队最新发布的中文大模型测评结果给了我很大信心。数据显示,DeepSeekV4-Pro凭借综合表现拿下国内第一,Flash版本紧随其后位居第二,国产开源模型再次迎来突破。

测评指标或许有些抽象,但对于我们这种日常需要大量沟通、采访和内容产出的科技记者来说,一个工具好用不好用,得在真实的工作场景里见真章。

在DeepSeek V4发布之前,每次采访超过30分钟,就让我有点头疼。因为语音转文字之后,基本2万字以上的采访文本,我通常都需要在多个大模型之间来回进行内容删改整理。比如之前有一段3万字的长篇访谈,当我尝试把原文本发送给几家国内外主流大模型寻求整理时,有的直接提示内容超过10,000字,报错无法操作;有的付费版本虽然可以处理,但分析结果不理想。

DeepSeek V4在这方面带来了实质性的改变。100万token的上下文能力意味着,一部长篇访谈的逐字稿、多篇参考文献,甚至整本书籍级别的内容,都可以一次性提交处理。

过去需要反复切分粘贴的流程,现在简化为一步操作,从文字整理到信息提炼的周期明显缩短。这种体验的提升不在于技术参数的炫技,而在于实实在在省下了记者和编辑手中最稀缺的资源——时间。

编辑点评:Agent落地的“账本”

如果说长文本处理解决了“能不能用”的问题,那么V4真正的战略方向,是解决Agent“用不用得起”的问题。

DeepSeek V4的产品发布文章中,“Agent”一词出现了多达11次,这不是巧合。DeepSeek-V4-Pro的Agent能力已在内部经过实际检验,成为公司员工日常使用的Agentic Coding模型,实测体验优于Claude Sonnet 4.5,交付质量接近Opus 4.6非思考模式,但与Opus 4.6思考模式仍有一定差距。V4还针对Claude Code、OpenClaw、OpenCode、CodeBuddy等主流Agent产品进行了专项适配和优化。

这意味着DeepSeek V4有望成为“Agent”时代的数字基座——当Flash版负责高频轻量调用,Pro版兜底复杂任务,Agent才有机会真正从实验室走向规模化部署。像云栈社区这样的技术论坛里,大家讨论的焦点早已从“模型能不能用”转向了“Agent用不用得起”,而V4恰好在这两个维度上都给出了有说服力的答案。