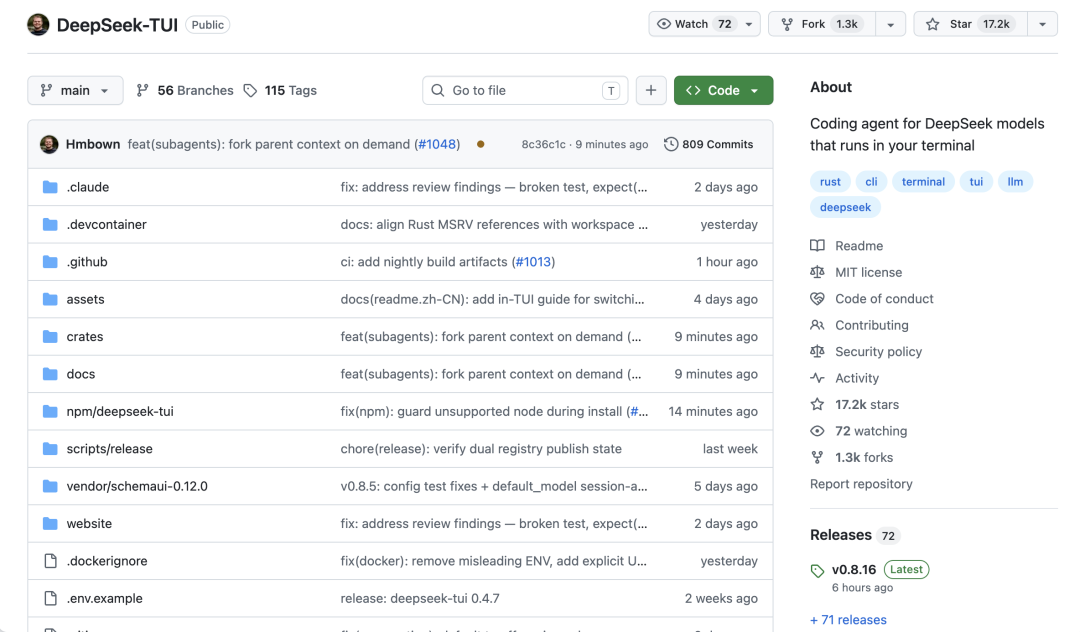

最近,一个名叫 DeepSeek-TUI 的开源项目突然在 GitHub 彻底火了——短短几天时间,Star 数从 8.7k 飙升至 16.3k,迅速冲上 GitHub Trending 前列。它不是 DeepSeek 官方产品,而是一名个人开发者基于 DeepSeek V4 打造的终端原生编程智能体。因为这个项目,很多人开始把它称为“DeepSeek 版 Claude Code”“国产 Codex CLI”,或者更本土味的“鲸鱼”。开发者 Hunter Bown 也顺势将用户叫作“鲸鱼兄弟(whale bros)”。

但问题来了:我们已经有 DeepSeek V4 的网页版、APP 和 API,为什么还需要一个终端里的 TUI?这个疑问本身就点中了今年大模型行业最核心的变化——模型之上的 Agent 框架。GPT‑5.5 很强,但真正重塑开发者工作流的,是 GPT‑5.5 + Codex;Anthropic 能在开发者圈子里建立统治力,同样因为 Claude 模型配上了 Claude Code。DeepSeek V4 显著提升了代码、推理、长上下文和多轮理解能力,却始终缺少一个围绕自家模型专门打造的 Agent 框架。

更不用说,Codex 最近一次升级将推理接口从“聊天补全”全面切换到“响应 (Responses API)”,直接导致 V4 在 Codex 里失效。DeepSeek V4 急需自己的 Codex。可问题在于,作为一个第三方个人开源项目,DeepSeek-TUI 真的能撑起大家的期待吗?

不到 10 块钱,小白也能开发 macOS 应用、修 Bug

我是在 macOS 上实际部署并体验 DeepSeek-TUI 的。说句实话,这玩意儿终究是个面向开发者的工具,没有图形化引导,也没有“面向普通用户”的包装,整个过程里依然充满了命令行、环境依赖和工具链的味道。它比 Codex 那种完全图形化的安装要复杂,但又没有 OpenClaw(龙虾)那么折腾。

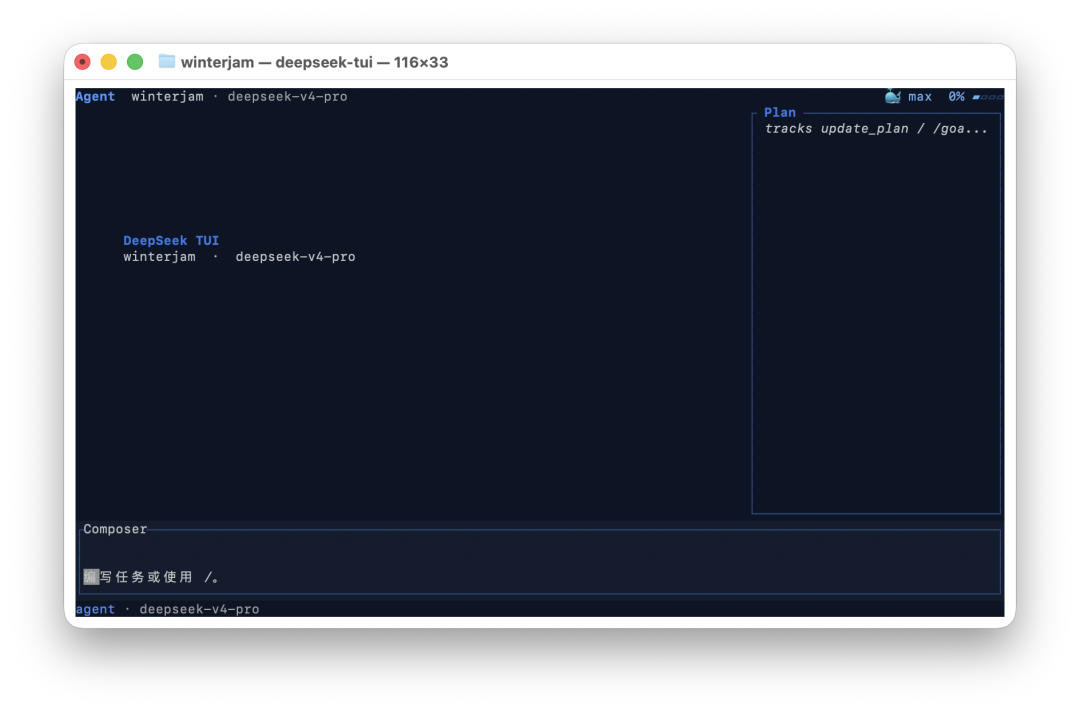

DeepSeek-TUI 提供了 npm、Cargo、Homebrew 和直接下载二进制四种安装方式。我直接选的 Homebrew,刚起步就碰了壁:系统提示 Your Command Line Tools are too outdated. 还好,问题不大,到苹果官网更新最新版本后重新执行 brew 命令,两行指令便一键成功安装。完成后输入 deepseek-tui 启动引导配置,一路确认、输入 DeepSeek API 就进入了对话界面。

这里需要特别提一下,DeepSeek-TUI 默认有三种模式:Plan、Agent 和 YOLO。Plan 更像是观察模式——它会先分析项目、生成计划、列出 Todo,但不会真的动手;Agent 模式则会调用工具,比如读文件、改代码、执行 shell 命令,只是很多关键步骤仍然需要用户确认;YOLO 模式最激进,几乎等于“放权模式”,让 AI 自动推进整个任务链。这种设计思路跟 Claude Code 非常相似。

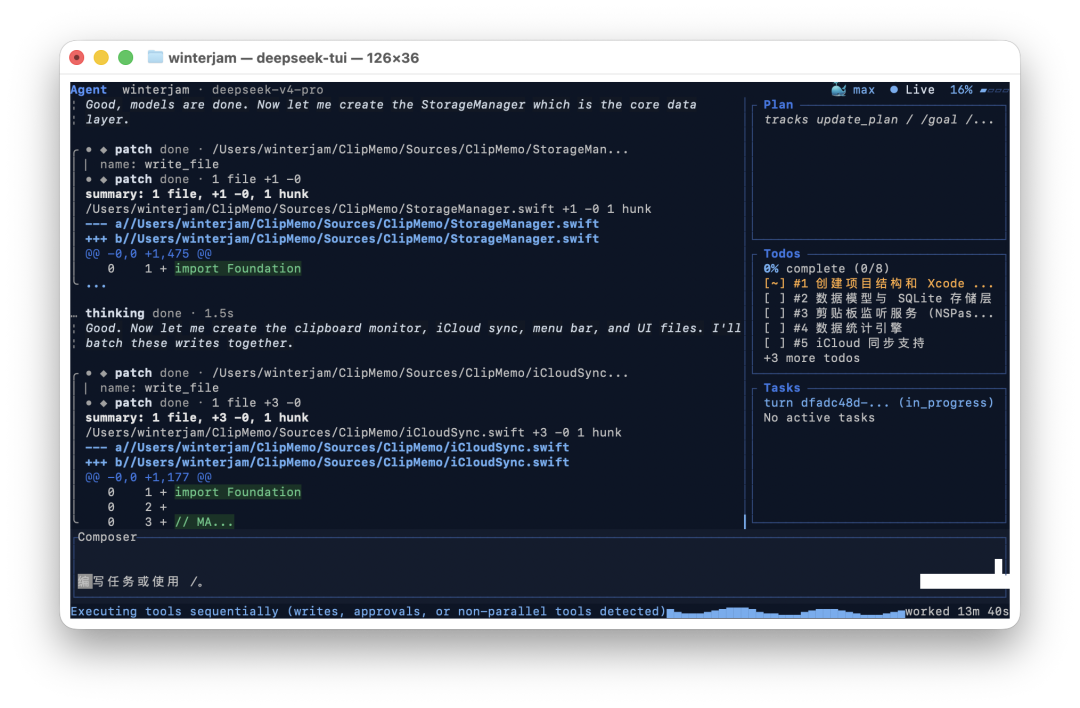

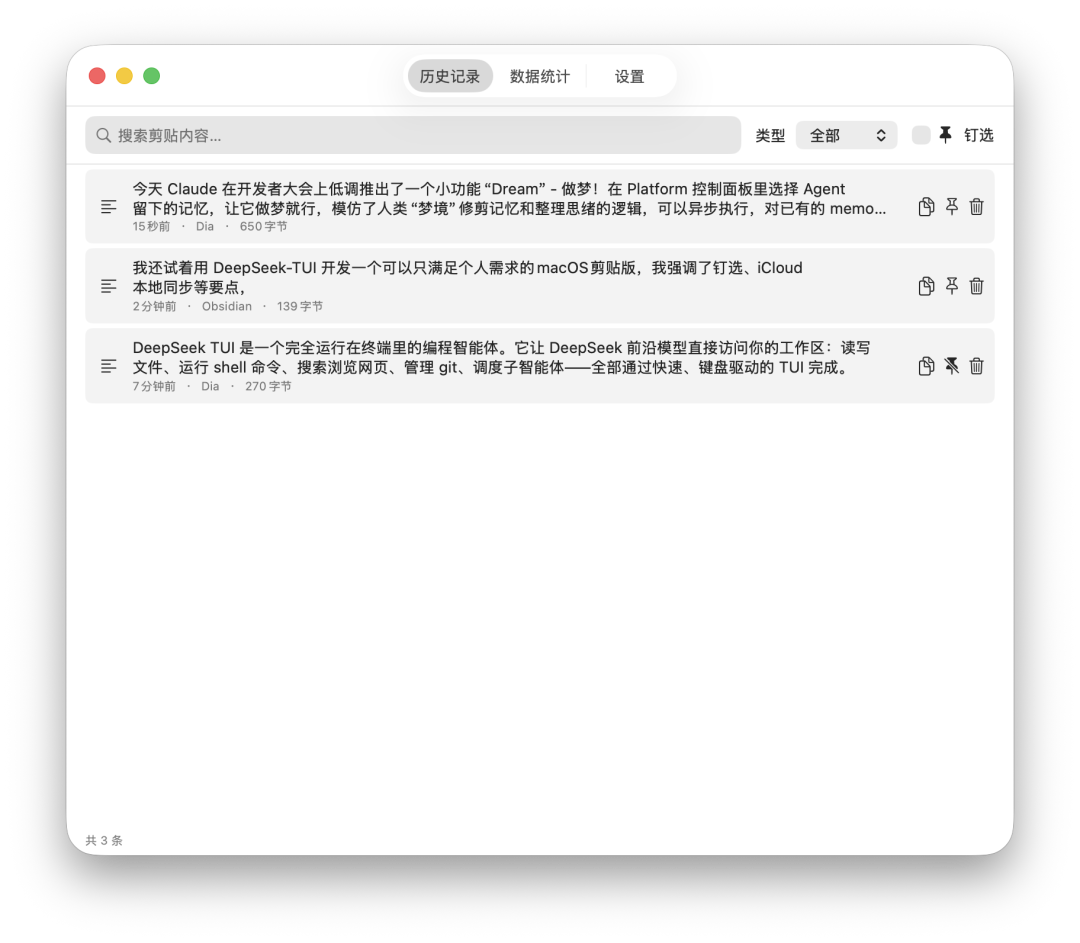

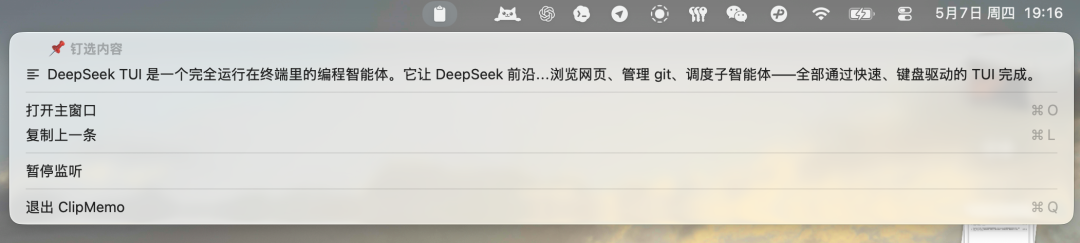

真正让我觉得这工具“有点东西”的,还是后面的实测。我试着用它开发一个只满足个人需求的 macOS 剪贴板,钉选、iCloud 本地同步、菜单栏支持这些需求都一一强调。整个过程,加上最后的编译打包,花了不少时间。

最终生成的 ClipMemo 应用完全可用,我提出的功能基本都能正常运行,甚至还附赠了一些我根本没提的重要特性,比如定期清理和去重。UX 和 UI 设计谈不上惊艳,但绝对够用。

美中不足的是,虽然 iCloud 同步的功能开关摆了在那里,但实际并不能在 iCloud 下生成保存剪贴内容的文件。

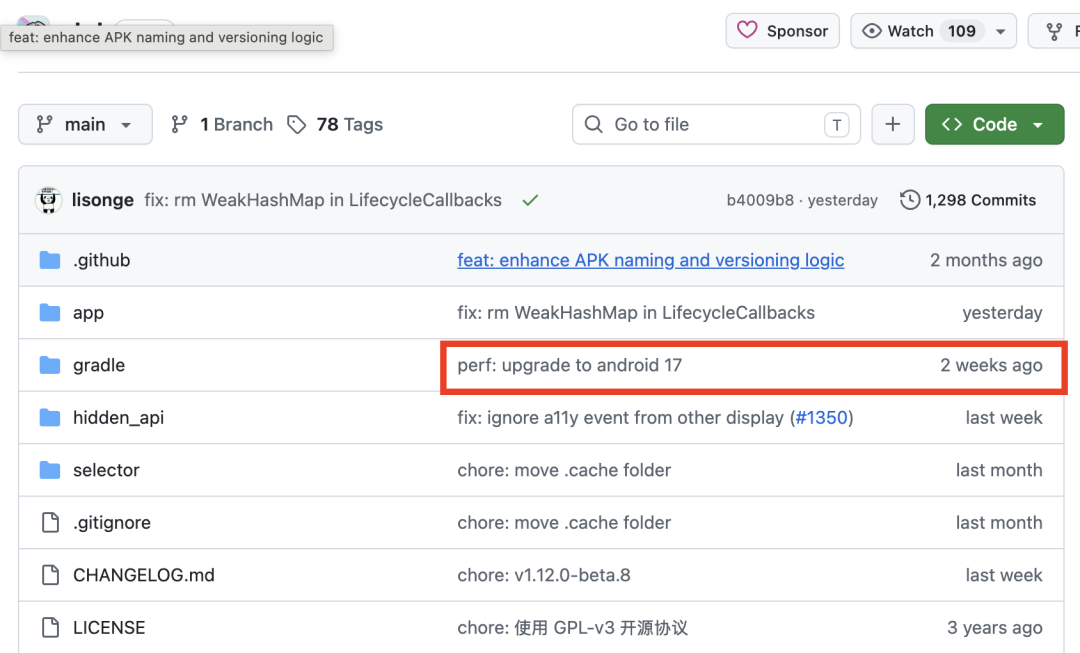

为了进一步考验,我挑了一个真实的 开源项目 GKD(gkd-kit/gkd)来做 bug 修复测试。GKD 是一个 Android 自动化工具,采用 Kotlin + Android Framework 架构,代码量不小,涉及 AccessibilityNodeInfo、缓存深度、事件服务等底层逻辑。它的上一次版本更新还在 2025 年底,不过仓库记录显示,开发者两周前刚刚为它升级了 Android 17 的支持。

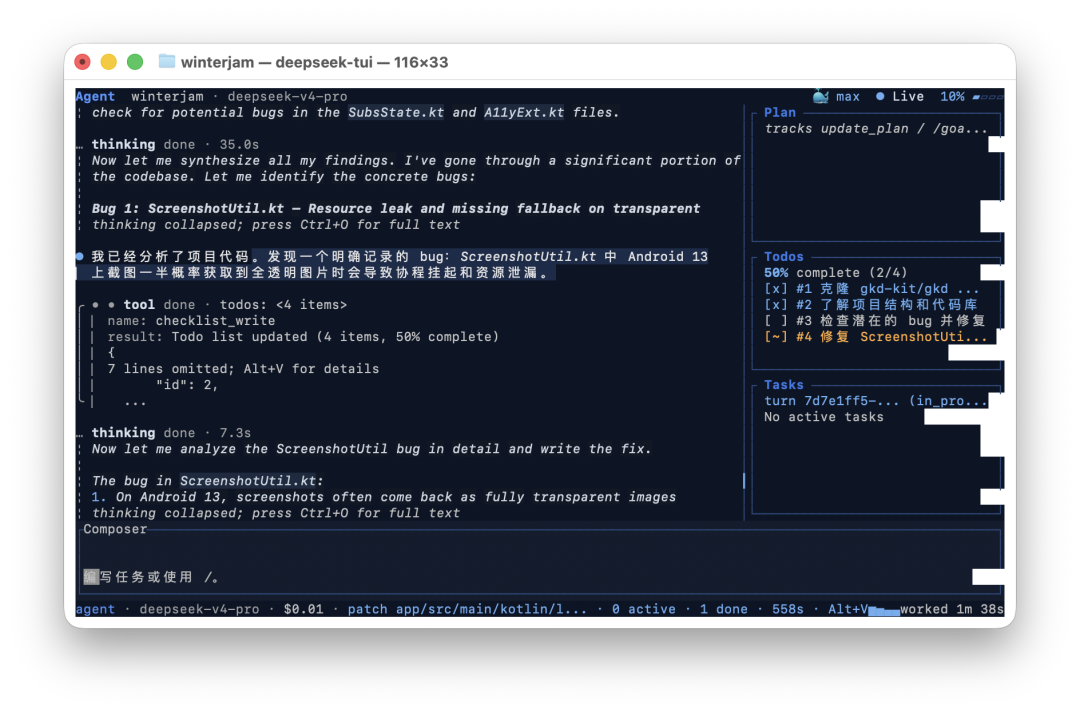

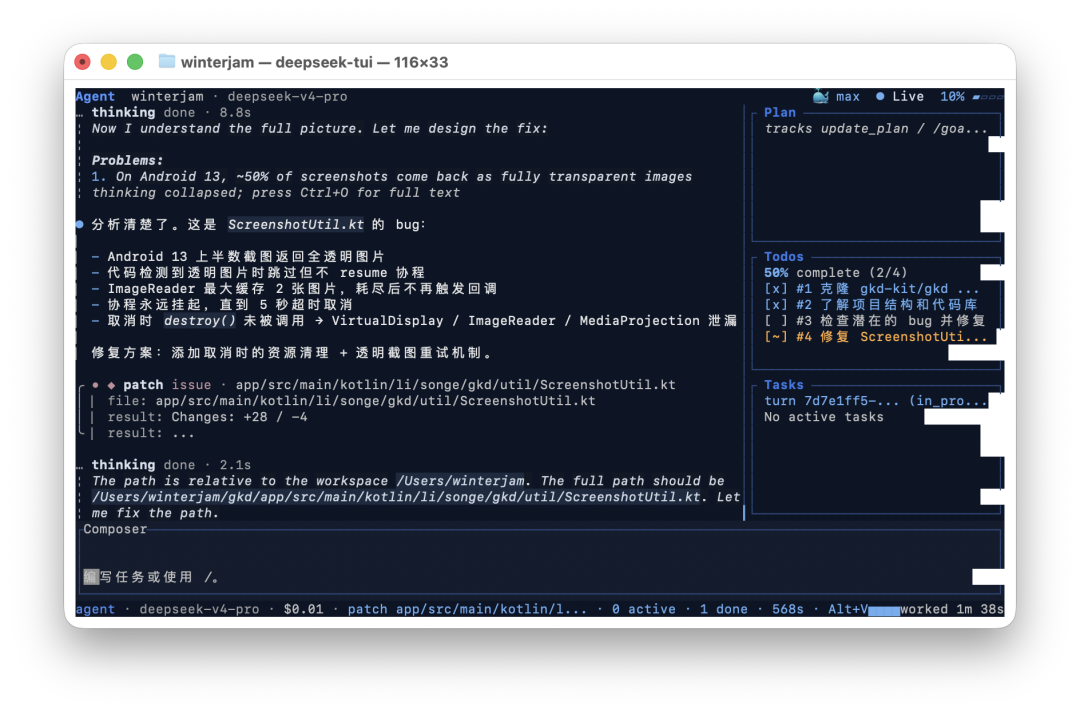

在 DeepSeek-TUI 中,我不仅让 AI 自行将项目克隆到本地,还给它下了一个工作量不低的任务:检查潜在 bug 并尝试修复。随即,DeepSeek-TUI 开始自己克隆仓库、阅读项目结构、分析 Kotlin 文件、查找函数调用关系、生成 patch、运行 git diff、验证修改结果,整个过程持续了十几分钟。期间它还会自发形成 debugging loop:先读代码,再修改,再运行,再看结果,再继续改。右侧不断刷新的 Todos 尤其有“工作流”的味道——克隆项目、了解代码库、检查 bug、修复问题,一项接一项。

这就是 DeepSeek-TUI 和网页版 DeepSeek 最根本的区别。网页版本质上还是“聊天”,哪怕你上传代码、贴日志,它给的仍然是“建议”。但 DeepSeek-TUI 已经可以自己读文件、自己跑命令、自己维护任务状态、自己验证 patch、自己持续推进任务。AI 不再只是告诉你“应该怎么做”,而是真的开始去做。

很多人会把 Agent 简单理解成“更聪明的大模型”,可一旦实际体验就会发现,真正重要的其实是围绕模型构建的那一整套工程:边界约束、上下文工程、工具调用等等。值得一提的还有,DeepSeek-TUI 原生支持 MCP 和 skills,用户可以把自定义工作流封装成 skills。

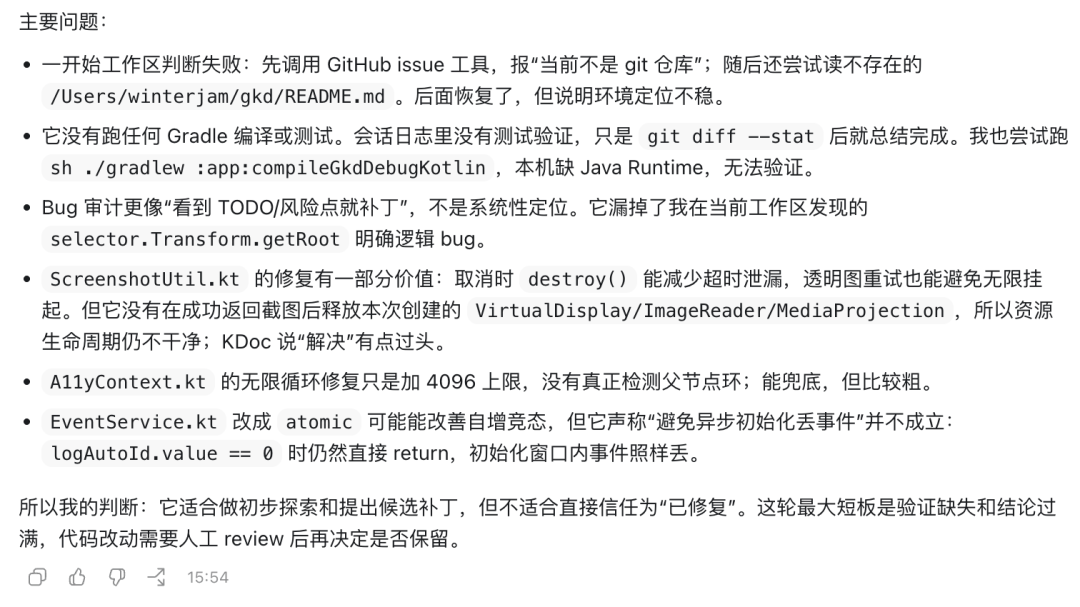

考虑到这终究还是个比较小的项目,DeepSeek-TUI 修 bug 花的时间不算短,最终找出并“修复”了三处 bug。我还特意请 Codex(GPT-5.5 高)通过 Computer Use 阅读终端对话进行审计评估,结果指出了六个问题,其中特别提到 DeepSeek-TUI 漏掉了它看到的一个明确逻辑 bug。

在界面设计上,Codex 会把很多具体细节“折叠”起来,而 DeepSeek-TUI 更倾向于把所有细节铺开,这在获取信息时会带来一些压力。如果 DeepSeek-TUI 最终要像 Claude Code、Codex 那样走向全能型 Agent,这样的设计恐怕很难让人接受。

从结果来看,DeepSeek-TUI 和 Codex 之间还存在明显差距,这不仅体现在模型层面,也体现在 Agent 工程成熟度上。不过,DeepSeek-TUI 的 Auto Mode 挺有意思:它会先用 deepseek-v4-flash 判断当前任务到底该用更便宜的小模型还是更强的 deepseek-v4-pro,简单任务省钱,复杂任务再调用更强模型。这个设计非常务实,因为今天所有 Agent 最大的痛点之一就是 token 成本,尤其是进入持续工作模式后,token 消耗会飞速膨胀。而 DeepSeek V4 这次升级给人最深的印象就是极高的性价比,再加上 DeepSeek-TUI 的这种架构和 Auto Mode 设计,确实非常便宜。一次十几分钟的 bug 修复测试,加上 ClipMemo 的开发,总共花费只有 9.47 元——当然,实际迭代和优化还要吃掉更多 token,但这已经够能说明在 DeepSeek-TUI 上使用 DeepSeek V4(主要用 Pro)的优势了。

写在最后

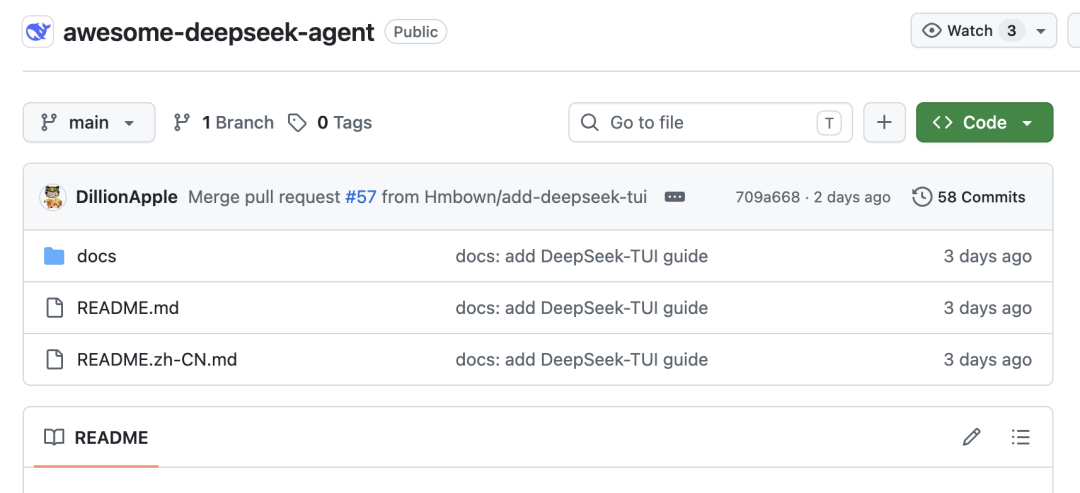

回头再看 DeepSeek-TUI,它最重要的意义或许并不只是“又一个开源 TUI”。真正重要的是,DeepSeek 生态终于开始出现真正的 Agent 外壳了。而且官方其实也已经注意到了这件事,在 awesome-deepseek-agent 中正式收录了 DeepSeek-TUI。

大模型竞争的核心,正在从“模型能力”转向“Agent 工作流”。Codex 是 OpenAI 自己做的,Claude Code 是 Anthropic 自己做的,它们最大的优势不是“功能”,而是模型团队与 Agent 工程团队的垂直整合——模型知道工具链需要什么,工具链也清楚模型擅长什么。这种协同只会越来越关键。而 DeepSeek 眼下最大的缺位,正好就是官方的 Agent 框架。DeepSeek-TUI 也许能证明 DeepSeek V4 进入 coding agent 工作流后的巨大威力,但我们仍然在等一件事:DeepSeek 官方,到底什么时候亲自下场。对 AI 开发者来说,更多这样的前沿工具与一手评测在云栈社区常有新鲜讨论,值得持续关注。

Deepseek #Agent #大模型 #Codex