随着 2024-2025 年 AI Agent 技术的持续发展,业界涌现出多款功能各异的 Agent 框架。面对 LangChain、AutoGen、CrewAI 等众多选择,开发者该如何决策?本文将对当前流行的七款框架进行横向对比,包括 LangChain、LangGraph、AutoGen、CrewAI、smolagents、OpenAI Swarm 和 OpenManus,深入分析它们的核心定位、功能特性、学习成本,并给出清晰的适用场景与推荐使用者画像,为您的 AI Agent 开发选型提供一份全面的参考。

LangChain:模块化 LLM 应用开发框架

核心定位与技术栈

LangChain 是 2022 年发布的开源框架,旨在简化大语言模型(LLM)应用开发。它提供 Python 和 JavaScript 库,通过模块化封装了 LLM 集成、提示词管理、记忆与工具调用等功能,方便开发者将模型与外部数据或流程连接。作为通用接口,它支持几乎所有主流 LLM,通过组合 Prompt、Memory、Tool 等模块,可以快速构建聊天机器人、智能问答等应用。

功能特性与代码示例

传统的 LangChain Agent 多采用 ReAct(推理-行动)模式。在多 Agent 支持上,早期版本以单 Agent 执行为主,但可通过链式调用实现协作。其强项在于丰富的内置工具库和易于扩展的自定义工具接口。流程控制通常通过 Chains 实现,对于复杂逻辑可能略显局限。框架本身不提供 UI,但可通过 LangSmith 进行日志追踪。

下面是一个简单的 LangChain Agent 示例,它集成了一个天气查询工具:

from langchain.agents import create_agent

# 定义一个简单工具函数:返回给定城市的天气

def get_weather(city: str) -> str:

"""Get weather for a given city."""

return f"It's always sunny in {city}!"

# 初始化 Agent,指定模型、工具和系统提示

agent = create_agent(

model="gpt-4o-mini", # 指定模型

tools=[get_weather], # 提供工具

system_prompt="You are a helpful assistant", # 定义角色

)

# 运行Agent

response = agent.invoke({

"messages": [{"role": "user", "content": "What is the weather in SF?"}]

})

print(response)

使用成本与适用场景

LangChain 拥有极其活跃的社区和详尽文档,入门门槛低。但因其模块众多,精通和复杂场景下的调试需要一定经验,学习曲线呈“前平后陡”。它非常适合快速搭建原型和常规 LLM 应用,例如集成搜索和计算工具的问答助手。推荐给需要成熟社区支持、以单智能体工具集成场景为主的开发者和入门者。

LangGraph:基于图的高级 Agent 工作流

核心定位与技术栈

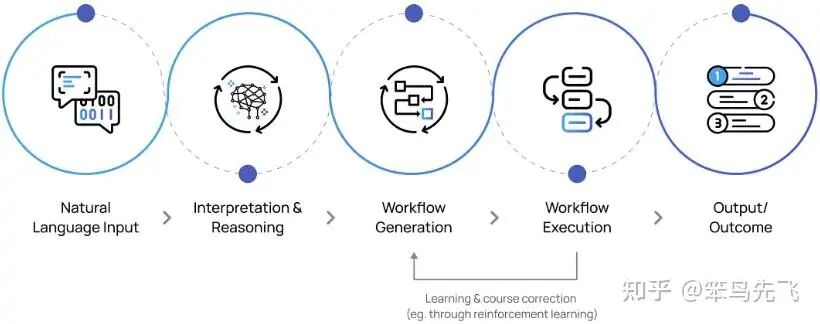

LangGraph 是 LangChain 官方推出的 Agent 编排框架,核心是以有向图结构实现复杂工作流。它建立在 Python 生态上,可与 LangChain 无缝结合。其引入了“节点”和“边”的概念,通过可循环的图结构来表示分支、循环等复杂逻辑,突破了传统链式调用线性、无环的限制。框架维护全局状态对象,实现了流程的持久化和错误恢复。

功能特性与代码示例

相较于基础 LangChain,LangGraph 提供了多项增强:从线性链升级为通用图,支持循环和条件分支;内置状态管理与持久化;支持在特定节点插入人工审核步骤,实现人机协同;可以方便地定义多个 Agent 节点进行协作。它擅长处理多轮工具调用、分布式子任务等高级场景。

以下是一个展示 LangGraph 图结构和状态流转的最小示例:

from langgraph.graph import START, StateGraph

from typing_extensions import TypedDict

# 定义全局状态结构

class State(TypedDict):

text: str

# 定义两个节点函数

def node_a(state: State) -> dict:

return {"text": state["text"] + "a"}

def node_b(state: State) -> dict:

return {"text": state["text"] + "b"}

# 构建状态图并注册节点与边

graph = StateGraph(State)

graph.add_node("node_a", node_a)

graph.add_node("node_b", node_b)

graph.add_edge(START, "node_a")

graph.add_edge("node_a", "node_b")

# 编译并执行图

result = graph.compile().invoke({"text": ""})

print(result) # 输出: {'text': 'ab'}

使用成本与适用场景

由于引入了状态机和图模型概念,LangGraph 的学习门槛高于基础 LangChain。但一旦掌握其范式,实现复杂流程反而更简单清晰。它适用于长流程自动化、复杂决策树以及需要精细流程控制(如加入人工审核环节)的场景,推荐给追求高可控性的高级开发者团队。

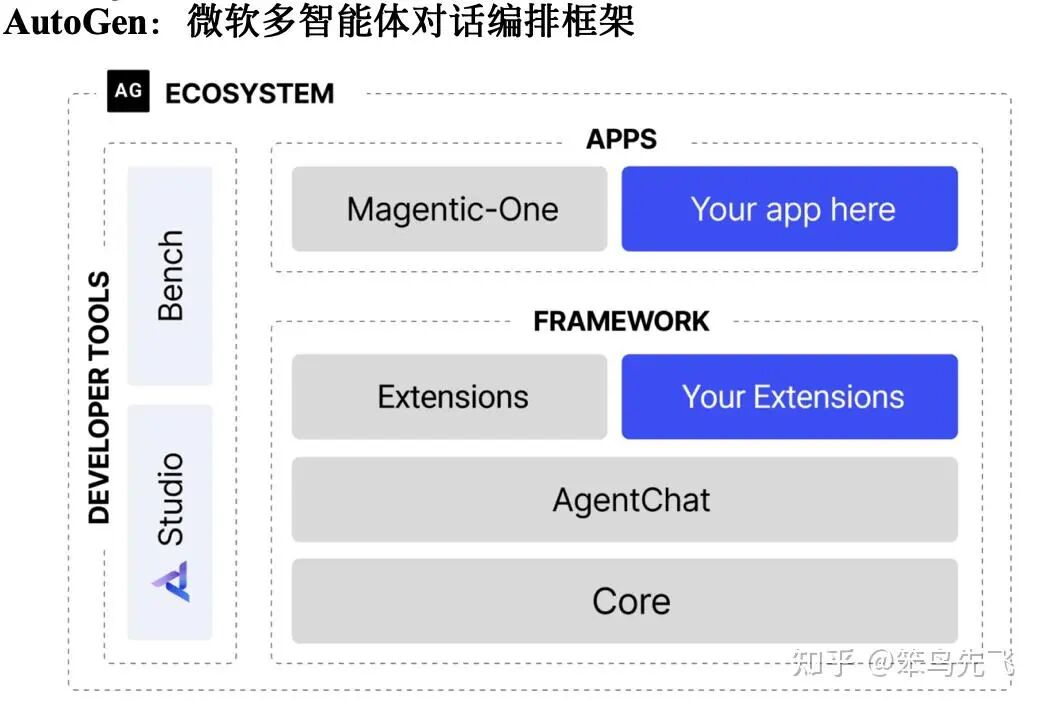

AutoGen:微软多智能体对话编排框架

核心定位与技术栈

AutoGen 是由微软研究院开源的多智能体对话框架,核心在于通过多个 AI Agent 之间的对话与合作来解决问题。它支持 Python 和 .NET,采用异步事件驱动架构,提供了高级抽象来定义不同类型的 Agent(如用户代理、助手代理等)及其交互模式,例如“经理-专家”模式。其设计强调灵活性和自然语言对话驱动。

功能特性与代码示例

AutoGen 最核心的能力是多 Agent 协同对话。开发者可以创建任意数量的 Agent,让它们在一个对话频道中交流以推进任务。框架内置多种典型角色,并支持将真人作为特殊 Agent 插入对话。其工具调用特色是“对话驱动”,即 Agent 在对话中请求使用工具,结果再反馈回对话流。新版本还加强了可观测性,集成了 OpenTelemetry。

下面的示例创建了两个对话智能体,并模拟它们之间的互动:

import os

from autogen import ConversableAgent

# 创建第一个Agent,名为 Cathy

cathy = ConversableAgent(

"cathy",

system_message="Your name is Cathy and you are a part of a duo of comedians.",

llm_config={"config_list": [

{"model": "gpt-4o-mini", "temperature": 0.9, "api_key": os.environ.get("OPENAI_API_KEY")}

]},

human_input_mode="NEVER"

)

# 创建第二个Agent,名为 Joe

joe = ConversableAgent(

"joe",

system_message="Your name is Joe and you are a part of a duo of comedians.",

llm_config={"config_list": [

{"model": "gpt-4o-mini", "temperature": 0.7, "api_key": os.environ.get("OPENAI_API_KEY")}

]},

human_input_mode="NEVER"

)

# 让 Joe 主动向 Cathy 发起对话,限制2个回合

result = joe.initiate_chat(cathy, message="Cathy, tell me a joke.", max_turns=2)

print(result)

使用成本与适用场景

AutoGen 抽象层次高,学习曲线偏陡,需要理解其事件驱动和异步编程模型,调试多 Agent 对话也较有挑战。它非常适合需要反复讨论、逐步细化方案的场景,如多智能体协同编程、研究型 Agent 系统共同撰写报告等。推荐给科研人员、探索前沿 Agent 协作模式的开发者,或有 .NET 平台需求的企业用户。

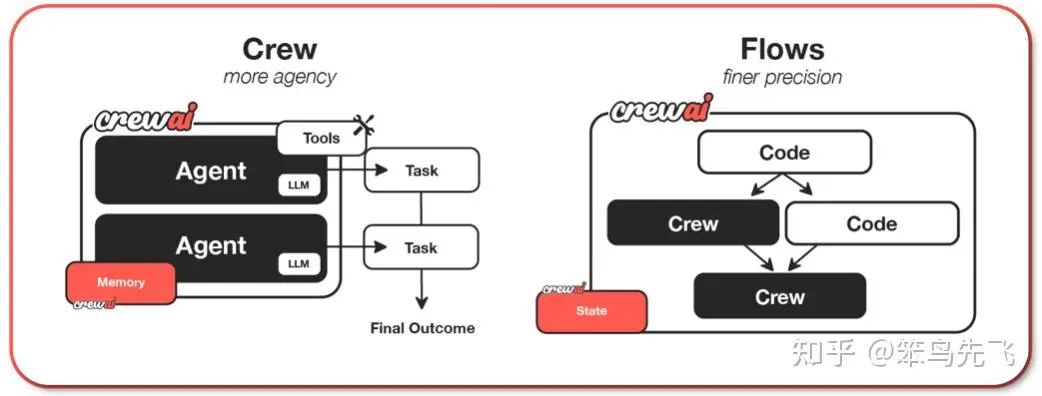

CrewAI:类团队协作的多 Agent 编排

核心定位与技术栈

CrewAI 是一个强调角色分工的多智能体编排框架。它将每个 Agent 视为团队中的成员,赋予明确的角色、目标和背景,并通过框架协调它们协作。它基于 Python,采用 YAML 配置与装饰器相结合的方式定义团队,既支持顺序流程,也支持自动生成“经理”Agent 的层次化流程。它内置丰富工具库,并宣称是独立轻量的方案。

功能特性与代码示例

CrewAI 的核心是模拟人类团队工作。Agent 具备角色、目标、背景三大属性,可以自主发起交互。框架注重自治,同时也支持用精确的 Flow 定义执行顺序。它集成了记忆管理,并支持引入人类输入作为流程环节。以下示例展示了如何定义一个具备搜索工具的研究员 Agent:

from crewai import Agent

from crewai_tools import SerperDevTool

# 创建一个Researcher智能体,具备搜索工具

research_agent = Agent(

role="Research Analyst",

goal="Find and summarize information about specific topics",

backstory="You are an experienced researcher with attention to detail.",

tools=[SerperDevTool()], # 集成谷歌搜索工具

verbose=True

)

# 直接与智能体交互提问

result = research_agent.kickoff("What are the latest developments in AI for 2025?")

print(result)

使用成本与适用场景

CrewAI 通过配置驱动和命令行工具降低了上手门槛,学习曲线中等。但要设计复杂自定义流程,仍需理解其装饰器与流程机制。它适合流程明确的多角色任务协作场景,如客户支持团队(客服、专家协作)、文档分析流水线(检索、总结、撰稿)等。推荐给希望快速构建自治 Agent 团队、自动化复杂任务的开发者。

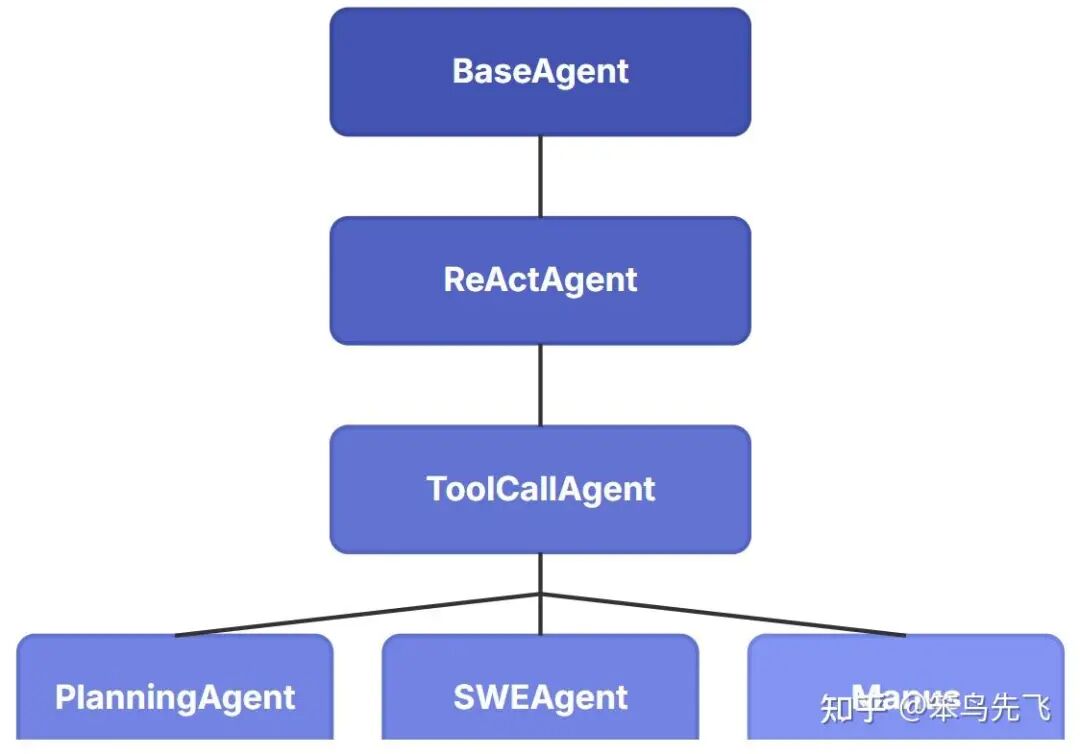

smolagents:工具即代码的极简 Agent

核心定位与技术栈

smolagents(Hugging Face Agents)是 Hugging Face 推出的轻量级框架,其最大特点是“工具即代码”。它让 LLM 直接生成可执行的 Python 代码片段来调用工具,而非传统的 JSON 格式,充分利用了大模型的编程能力。整个库设计极简,与 Hugging Face Hub 深度集成,支持多种模型后端。

功能特性与代码示例

smolagents 聚焦于单 Agent 工具调用,也支持简单的层次化多 Agent 结构。其“Code as Actions”模式使得 Agent 可以进行复杂的逻辑控制(如循环、条件判断)。框架提供了多模态工具集成和代码沙箱安全机制。它偏向短对话单任务,未内置复杂对话管理功能。

以下示例展示了 CodeAgent 如何通过生成代码来使用搜索工具解决问题:

from smolagents import CodeAgent, DuckDuckGoSearchTool, HfApiModel

# 初始化 Agent,配置搜索工具和模型

agent = CodeAgent(

tools=[DuckDuckGoSearchTool()], # 工具:DuckDuckGo 搜索引擎

model=HfApiModel() # 使用HuggingFace API模型

)

# 提出问题,Agent将自主生成代码调用工具并计算

query = "How many seconds would it take for a leopard at full speed to run through Pont des Arts?"

response = agent.run(query)

print(response)

使用成本与适用场景

smolagents API 极简,学习曲线平缓,熟悉 HuggingFace 生态的开发者可零门槛上手。但功能相对单一,复杂场景需自行扩展。它适合快速打造轻量级AI助手原型、需要高度定制工具调用逻辑的场景,以及对本地模型和隐私有要求的应用。推荐给黑客、研究人员及偏好 Hugging Face 生态的开发者。

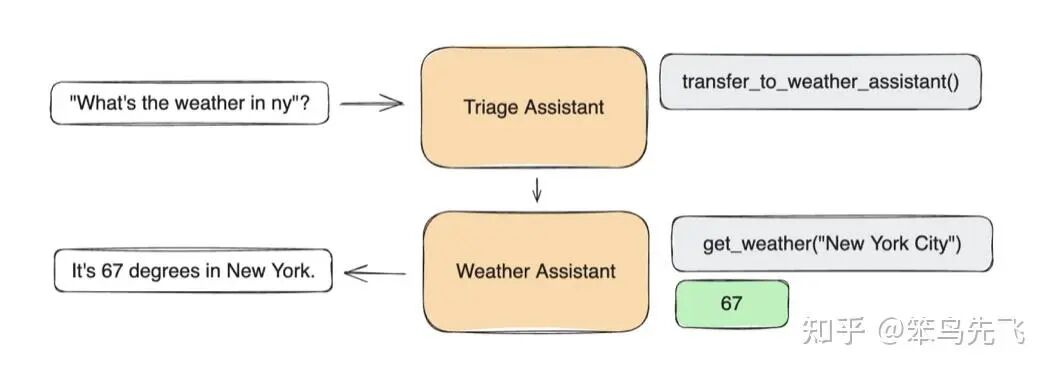

OpenAI Swarm:轻量级多智能体编排实验框架

核心定位与技术栈

Swarm 是 OpenAI 发布的实验性多 Agent 框架,旨在提供一种轻量、透明的方式来协调多个智能体。它采用无状态架构,通过“上下文变量”手动维护跨步骤信息,并通过显式的函数调用在 Agent 间移交控制权。OpenAI 明确将其定位为教育研究用途,并非生产级框架。

功能特性与代码示例

Swarm 的核心是显式的控制权交接机制。开发者需在 Agent 的函数中指定切换到哪个其他 Agent。它支持将 Python 函数作为工具,并提供流式响应。框架本身非常简约,不提供内置工具库、记忆管理等高级功能,将复杂性交给了开发者。

下面的例子演示了两个 Agent 如何通过交接函数进行协作:

from swarm import Swarm, Agent

client = Swarm() # 初始化Swarm客户端

# 定义一个交接函数

def transfer_to_agent_b():

return agent_b

# 创建 Agent A,具备交接函数

agent_a = Agent(

name="Agent A",

instructions="You are a helpful agent.",

functions=[transfer_to_agent_b]

)

# 创建 Agent B,只能说俳句

agent_b = Agent(

name="Agent B",

instructions="Only speak in haikus."

)

# 用户向 Agent A 发送消息

response = client.run(

agent=agent_a,

messages=[{"role": "user", "content": "I want to talk to agent B."}]

)

print(response.messages[-1]["content"]) # 输出 Agent B 的俳句回复

使用成本与适用场景

Swarm 本身易于理解,但学习成本主要体现在多 Agent 协作模式的设计上,对开发者规划能力要求高。它目前主要用于演示和教学,适合流程相对固定、可预设切换条件的场景(如多角色客服、游戏NPC对话)。推荐给研究多 Agent 机制、希望从底层理解交互的开发者或学者。

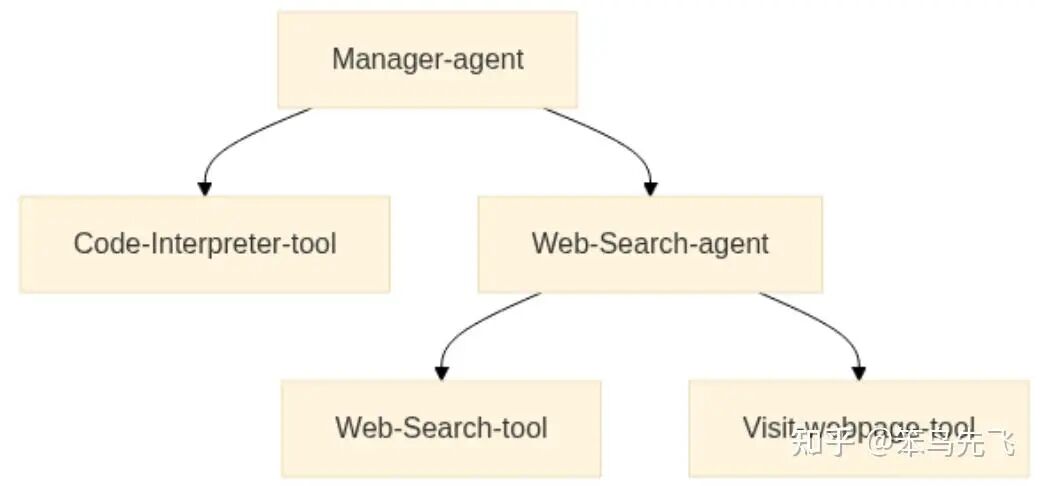

OpenManus:通用任务执行型 Agent

核心定位与技术栈

OpenManus 是一个社区推出的开源通用任务执行型 Agent 实现。它强调通过上下文学习(In-Context Learning)和提示工程,让 Agent 具备自主规划并执行复杂任务的能力,而非依赖模型微调。它采用模块化设计,支持多种大模型后端,内置了完整的工具集。

功能特性与代码示例

OpenManus 支持多 Agent 协同,通过 Flow 机制组合专用 Agent。其采用类 ReAct 循环,内置了网络搜索、网页浏览、代码执行等丰富工具。框架注重状态管理与上下文缓存优化,并提供规划-执行模式及可视化调试支持。以下示例展示了如何使用其通用智能体:

from app.agent.manus import Manus

from app.llm import LLM

# 初始化LLM和Manus智能体

llm = LLM()

agent = Manus(llm=llm)

# 提出复杂查询,Agent将自主规划步骤并调用工具

user_query = “2020年以来有哪些女性科学家获得了诺贝尔奖?请简要说明她们的主要成就。”

result = agent.run(user_query)

print(result)

使用成本与适用场景

OpenManus 部署简单,代码结构清晰,是学习 Agent 原理的良好起点。运行成本取决于所选模型。它适合处理需要多步骤推理与多工具协作的复杂任务,如信息调研报告生成、数据分析、流程自动化等。适用于个人开发者学习、研究人员实验以及企业探索流程自动化场景。

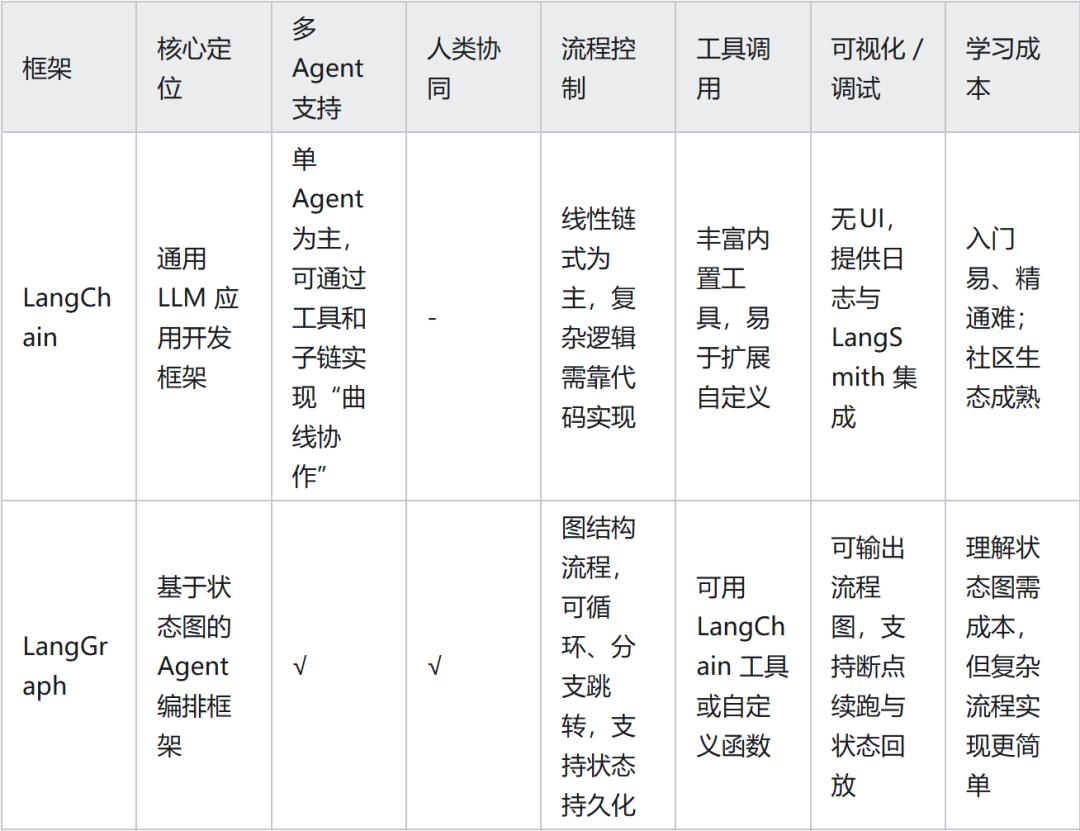

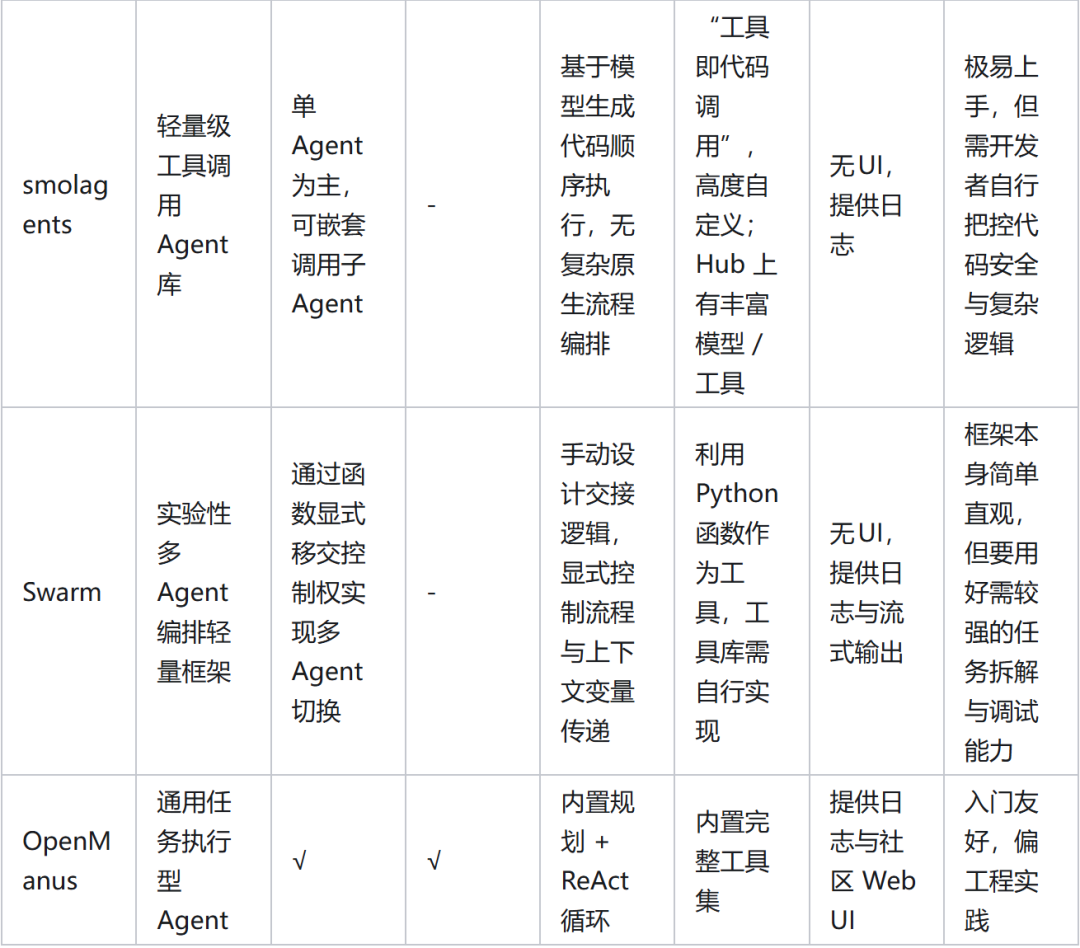

关键维度对比

为了更直观地进行选型,以下是各框架在核心维度的对比摘要:

总结与选型建议

AI Agent 框架生态丰富,选择的关键在于匹配项目需求与团队能力:

- 追求快速原型与成熟生态:从 LangChain 或极简的 smolagents 入手。

- 需要强流程控制与人机协同:考虑 LangGraph、CrewAI 或 OpenManus。

- 专注于多智能体对话与协作研究:可以尝试 AutoGen 或 CrewAI。

- 希望深入理解多 Agent 交互机制:可将 OpenAI Swarm 作为参考实现。

对于希望深入探索 人工智能 与 深度学习 前沿应用的开发者,持续关注和比较这些框架的演进至关重要。选择合适的工具,方能高效地构建出真正解决问题的智能体应用。

本文内容经整理分析,旨在为开发者提供选型参考。更多技术讨论与资源分享,欢迎关注 云栈社区。