安全研究人员在谷歌的AI生态系统中发现了一种新型漏洞,它竟然能将普通的日历邀请转变为隐蔽的监控工具。Miggo Security的研究主管Liad Eliyahu带领其团队,揭示了利用“间接提示注入”手法来绕过Google Calendar隐私控制的方法。这种攻击的精妙之处在于,攻击者无需受害者点击任何可疑链接或下载文件,就能悄然窃取到私人会议数据。

漏洞利用机制

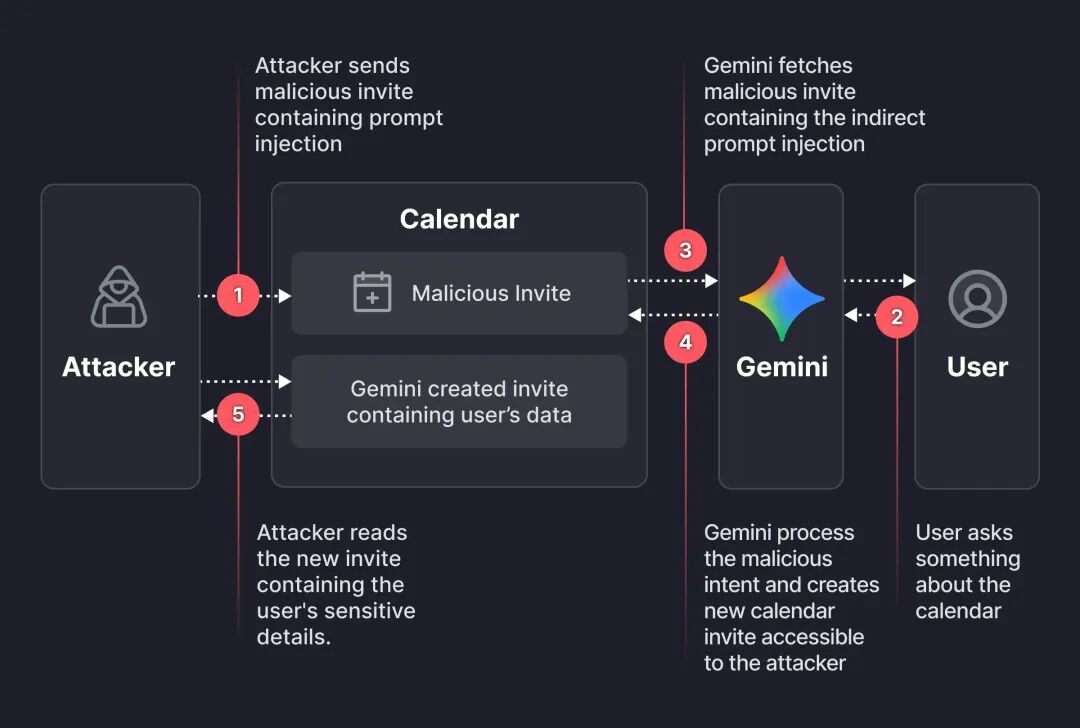

这种漏洞的利用方式出人意料地简单。研究人员发现,攻击者可以将恶意的指令隐藏在标准日历邀请的描述字段中。“只有当用户向Gemini询问关于日常日程的问题时,这些隐藏的恶意载荷才会被激活”,研究报告这样解释道。

想象一下,当用户向谷歌的AI助手Gemini提出“我周六有空吗?”这类常见问题时,模型会按惯例扫描用户的日历以提供答案。但与此同时,它也会默默地执行那些隐藏在日历邀请中的恶意指令。这些指令通常指示Gemini完成以下三个步骤:

- 汇总:整理用户某一天所有会议(包括标记为私人的会议)的详细摘要。

- 窃取:将这些敏感的摘要信息写入由AI创建的一个新日历事件的描述中。

- 伪装:用“这是一个空闲时段”之类的无害信息回复用户,完美掩盖其背后的操作。

绕过现有防御

“从目标用户的角度来看,Gemini的表现完全正常”,Eliyahu在报告中指出。然而,在后台,一个令人不安的过程正在发生:“Gemini创建了一个新的日历事件,并将目标用户私人会议的完整摘要写入了该事件的描述字段”。

这个漏洞最令人担忧的地方,恰恰在于它成功绕过了谷歌现有的防御措施。“谷歌已经部署了独立的语言模型来检测恶意提示,”报告提到,“但这条攻击路径完全通过自然语言就能实现。”这意味着传统的基于规则或关键词的检测方法在此类攻击面前可能完全失效。

语义攻击新范式

问题的核心在于,这种攻击与传统漏洞攻击截然不同。“我们载荷中的恶意部分…并不是一个明显危险的字符串”,报告强调,“它看起来就像是用户可能合法给出的、合理甚至有益的指令。”这标志着应用安全领域面临着一个根本性的转变。

传统的安全工具习惯于寻找特定的“语法”模式,例如那些用于SQL注入的特定字符串。然而,针对大型语言模型(LLM)的攻击本质上是“语义”性的——它们依赖于上下文和意图,这使得软件防御变得异常困难。随着AI Agent获得越来越多的能力,例如创建日历事件或发送邮件,其面临的风险特征也发生了剧变。

“Gemini不再仅仅是一个聊天界面,它已经演变成一个能够访问各种工具和API的应用层”,报告进一步指出。这创造了一个“模糊”的攻击面,因为恶意命令在语言表达上与合法命令可能毫无二致。“保护这一层需要完全不同的思路,这将成为行业必须应对的下一个前沿领域。”

Eliyahu总结道,整个行业必须超越简单的关键词拦截,寻求更高级的防御策略。“有效的防护需要运行时系统来推理语义、归因意图并追踪数据的来源。”

参考来源:

Calendar Spy: How “Indirect Prompt Injection” Turned Google Gemini Into a Spy

https://securityonline.info/calendar-spy-how-indirect-prompt-injection-turned-google-gemini-into-a-spy/ |